本文来源公众号“计算机视觉研究院”,仅用于学术分享,侵权删,干货满满。

原文链接:https://mp.weixin.qq.com/s/L1z1sElOK_0frGjce63HTQ

PART/1 概述

本文介绍了Bearing-DETR——一种基于实时检测变换器(RT-DETR)架构优化的深度学习模型。该模型融合了动态欠采样上采样(Dysample Dynamic Upsampling)、搭载元移动模块(MMB)的高效模型优化(EMO),以及可变形大核注意力(D-LKA)技术,在保持轻量化框架(适配低资源设备)的同时,显著提升了缺陷检测性能。

基于某化工厂数据集的验证结果显示:Bearing-DETR的性能优于标准RT-DETR——在交并比(IoU)为0.5时,平均精度均值(mAP)达94.3%;在IoU为0.5–0.95时,mAP达57.5%。同时,它将浮点运算量(FLOPs)降至8.2G,参数量减至3.2M,凸显了其更高的效率与更低的计算需求。

这些结果表明,Bearing-DETR有望变革制造环境中的维护策略与质量控制方式,同时强调了其在适应性、可持续性及运营成本优化方面的积极作用。

PART/2 背景

轴承是化工设备中不可或缺的部件,是旋转轴的关键支撑结构,其性能对设备的稳定性与可靠性有着深远影响。轴承功能异常会导致旋转部件失衡,进而加剧振动与噪声,严重时甚至引发设备故障或损坏。此类故障会带来重大机械风险,可能造成事故、人员伤亡与财产损失。此外,轴承的维护与更换需要暂停设备运行,会降低生产效率。因此,化工生产流程的顺畅运行,关键在于轴承的可靠性。

在生产、装配或运输过程中,轴承可能出现沟槽、磨损、划痕等各类缺陷,这些缺陷会影响轴承质量。检测这些缺陷是保障设备功能与安全的关键。传统缺陷检测方法(如人工视觉检查、简单的基于传感器技术)虽能提供部分解决方案,但往往难以满足高精度与实时监控的需求。计算机视觉与人工智能的兴起,为轴承缺陷检测开辟了新途径——这些现代方法具备更强的智能性、准确性与效率,推动了缺陷检测技术的突破。

在此背景下,轻量化分析模型的开发具有重要意义。RT-DETR等轻量化模型为缺陷检测提供了精简的解决方案,在性能与计算效率之间实现了平衡。这类模型借助深度学习技术提升缺陷检测能力,同时最大限度降低计算开销。先进人工智能方法与轻量化设计原则的结合,是轴承缺陷检测领域的关键进展,有望在工业应用中实现更高的效率与准确性。

目标检测是计算机视觉的核心任务之一,需在图像或视频中定位并识别目标对象。数十年来,研究人员开发了多种检测方法,从基于特征、基于模板的方法,发展到近年来的深度学习方法。其中,深度学习(尤其是卷积神经网络(CNNs))取得了显著进展,Faster R-CNN、YOLO、SSD等模型都实现了出色的检测效果。

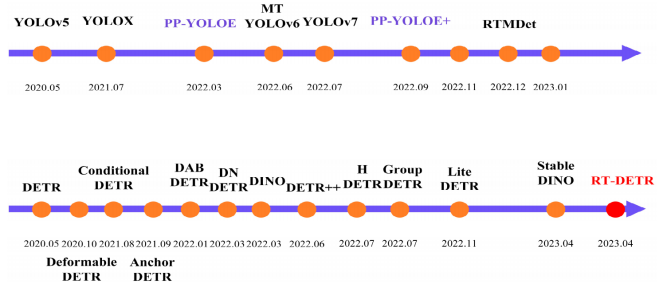

图1

图1展示了主要目标检测模型的演进过程,凸显了从传统方法到先进深度学习技术的发展脉络。该图标题为《目标检测算法中YOLO与DETR系列的发展时间线》,直观呈现了这一技术演进过程。

如图1所示,在这一技术发展脉络中,RT-DETR融合了两种极具影响力的目标检测范式:Transformer与DETR(检测变换器)。Transformer最初是为自然语言处理设计的,如今已被证明在计算机视觉任务中也极为高效;DETR是一种端到端的目标检测模型,它将检测任务重新定义为“目标查询问题”,并通过Transformer架构巧妙解决。RT-DETR继承了DETR的架构创新,同时引入了针对实时目标检测的优化,使其成为需要快速精准检测场景下的高实用性、时效性解决方案。

本研究旨在借助RT-DETR的实时处理能力,同时针对工业轴承的缺陷检测需求(这一任务不仅要求精准定位缺陷,还需快速处理分析图像以减少停机时间、提升维护效率)对模型进行定制化调整。在此思路下,Bearing-DETR作为一款专用轻量化模型应运而生,它融合了RT-DETR的前沿方法,有望为计算机视觉在工业质量控制中的应用开辟新方向。本研究的具体贡献如下:

(1) 在RT-DETR算法中融入Dysample技术,大幅简化了上采样流程。该技术遵循VanillaNet的设计原则简化模型架构,帮助RT-DETR降低计算开销与模型复杂度,从而以更高的精度和速度实现轴承缺陷检测——既保证了RT-DETR的轻量化特性(适配实时应用场景),又能有效识别缺陷的细微特征,同时优化了计算资源的使用效率。

(2) 高效模型优化(EMO)引入了元移动模块(MMB),为RT-DETR打造了更精简、可扩展的架构。将IRB(倒置残差块)与Transformer元素结合,使RT-DETR具备了实时缺陷检测的适配能力,在降低复杂度与计算资源消耗的同时优化了性能。这一创新方法提升了RT-DETR的效率,使其成为轴承缺陷检测这类高精度任务的得力工具。

(3) 在RT-DETR中整合可变形大核注意力(D-LKA),推动了目标检测技术的进步。D-LKA利用大核与可变形卷积,灵活且深度地高效处理数据,这对高分辨率任务至关重要。在RT-DETR中,D-LKA助力模型有效解析图像中的复杂模式,这是精准检测轴承缺陷的关键。该整合方案提升了RT-DETR分析复杂视觉信息的能力,同时不会带来过高的计算成本,展现出其在医学图像分割之外的工业应用潜力。

针对轴承缺陷检测的迫切需求,本研究提出了创新性的Bearing-DETR模型——它基于RT-DETR框架,融入了三项关键增强技术:Dysample动态上采样(提升网络效率)、高效模型优化(EMO,以极低计算开销实现稳健特征提取)、可变形大核注意力(D-LKA,在复杂成像场景下实现精准缺陷定位)。这些改进显著增强了RT-DETR检测细微、关键轴承缺陷的能力(此类缺陷可能影响生产稳定性与安全)。Bearing-DETR实现了高检测精度,提升了工业场景下的实时监控水平,保障了设备可靠性。

PART/3 新算法框架解析

RT-DETR

2023年1月,百度公司发布了RT-DETR,这是实时目标检测框架领域的一项重大进展。该模型的突出优势是在保持高精度的同时,大幅提升了处理速度——这对实时应用而言是关键突破。传统DETR模型受限于高计算需求与较慢的推理速度,而RT-DETR整合了新型高效混合编码器,以及创新的“最小不确定性查询选择机制”。这些改进有助于快速处理多尺度特征,并生成高质量初始查询,显著优化了检测的速度与精度。

RT-DETR提供了多种配置,以适配不同的应用需求。其中RT-DETR-R50与RT-DETR-R101变体在COCO数据集上的表现,优于此前最先进的YOLO模型。

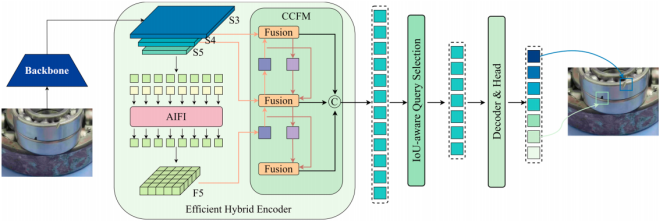

图2

如图2所示,RT-DETR的架构被系统地划分为三个主要部分:骨干网络、混合编码器与解码器。

骨干网络

骨干网络是初始处理层,负责从输入图像中提取基础特征图。这一部分通常采用在ImageNet等大型数据集上预训练的深度卷积神经网络,以确保实现稳健的特征提取。

混合编码器

在骨干网络之后,该编码器会对提取的特征进行细化,以增强对图像中不同目标尺度与上下文信息的理解。它创新性地结合了基于CNN的跨尺度特征融合(CCFF)与基于注意力的尺度内特征交互(AIFI)。这种设计使编码器能够高效控制计算复杂度,并提升传递给解码器的特征质量。

解码器

解码器组件采用一系列Transformer层来解析编码后的特征,并生成精准的目标检测结果。它利用“最小不确定性查询选择机制”初始化目标查询——通过聚焦高置信度特征,显著提升了目标检测的准确性与可靠性。

这一精简的流程省去了非极大值抑制(NMS)步骤,进一步加快了推理过程。核心组件包括:混合编码器(结合CNN与Transformer的优势,高效处理多尺度输入),以及最小不确定性查询选择(优化解码器查询的初始化,提升检测精度)。这些创新使RT-DETR成为实时目标检测领域的开创性方案,相比前代模型,在速度与精度上都实现了大幅提升。

Bearing-DETR

尽管RT-DETR在实时目标检测领域取得了显著进展,但将其应用于工业场景下的轴承缺陷检测时,暴露出一些局限性——尤其是在处理轴承缺陷独特且复杂的特征方面。这些缺陷通常需要更专业化、精细化的分析,而RT-DETR的通用框架无法完全支持这类需求。

为解决这些问题,本研究提出了Bearing-DETR:这是一种基于轻量化改进的模型适配方案,旨在提升缺陷检测的精度与效率。通过整合Dysample动态上采样、高效模型优化(EMO)与可变形大核注意力(D-LKA),Bearing-DETR在降低计算负载的同时,增强了在复杂工业环境中的适应性与准确性。

这些改进至关重要:既保留了RT-DETR的高速处理特性,又提升了其精准检测轴承细微缺陷的能力,从而保障了生产流程的可靠性与安全性。改进后的模型结构如图3所示。

图3

图3展示了Bearing-DETR的优化网络架构,该架构整合了三项关键创新:

1. Dysample动态上采样:这一特性简化了网络的上采样流程,降低了计算复杂度,同时增强了对小尺度缺陷的检测能力。图2通过精简层间路径直观呈现了这一设计——它聚焦于必要的特征上采样,同时将噪声降至最低。选择该技术是因为它能以极低的计算开销优化特征分辨率,简化上采样流程的同时,提升了模型检测并解析缺陷纹理细节的能力。这对精准识别传统上采样可能遗漏的小型或不明显缺陷至关重要。

2. 高效模型优化(EMO):EMO采用轻量化CNN架构与Transformer元素相结合的方式(如图3所示),将其作为网络中的紧凑模块,在保持深度学习效能的同时,优化了处理能力与内存占用。该组件整合了元移动模块(MMB),以优化架构性能并加快收敛速度。它解决了模型在无显著计算成本的前提下,实时适配缺陷特征多样性与复杂性的需求。

3. 可变形大核注意力(D-LKA):该机制被整合到模型的注意力模块中,使Bearing-DETR能够自适应聚焦图像中最可能包含缺陷的区域。图2通过注意力层中增强的连接直观呈现了这种适应性——这些连接会根据输入特征的复杂度动态调整。D-LKA的引入是为了提升模型在复杂工业图像中对缺陷相关特征的聚焦能力,相比标准注意力机制,它能更有效地适配不同形状与尺寸的缺陷。这种适应性是在各类缺陷表现下维持高检测精度的关键。

综合来看,这些改进确保Bearing-DETR在检测复杂轴承缺陷时,不仅达到、甚至超越了RT-DETR的基础性能。Dysample的精细特征处理、EMO的架构优化与D-LKA的靶向注意力之间的协同作用,显著提升了检测流程的精度与速度——这对可靠高效的工业应用至关重要。这些改进共同确保,在工业场景下检测复杂轴承缺陷时,Bearing-DETR的性能不仅达到、甚至超越了基础RT-DETR模型。每个组件都被战略性地部署在架构中,以优化缺陷检测能力,大幅提升检测流程的精度与速度。

基于Dysample的上采样

Dysample动态上采样器秉持极简主义理念,采用一种回归本源的设计思路,让人联想到VanillaNet的架构简洁性。这一创新设计的核心是“少即是多”的理念——这一原则已在神经网络及更广泛的计算设计领域证明了其价值。面对Transformer模型复杂的优化流程与拓扑结构,Dysample以精简的功能特性脱颖而出。

Dysample架构的精髓,在于摒弃了通常冗余的深度复杂网络结构。它不依赖捷径连接或自注意力机制这类复杂操作,而是寄望于简单、朴素的层结构,力求在摆脱过度复杂负担的前提下实现高性能。其设计理念最终落地为“精简至本质”的训练后架构,体现了高效与简洁的理想。

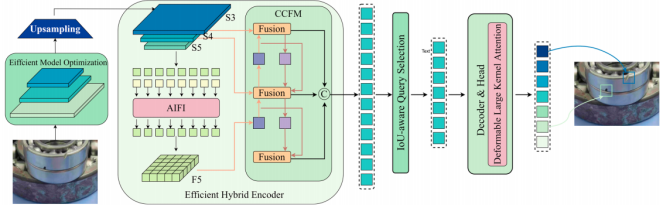

Dysample借鉴VanillaNet的思路,践行“简洁催生高效”的准则。现代优化技术与Transformer模型的复杂性,推动了Dysample的研发(它是对“简洁需求”的回应)。它摒弃了当代模型中自注意力机制所带来的深度层级结构、捷径连接与复杂设计。如图4所示,这种方法为传统技术提供了一种简化却有效的替代方案。

图4

该图展示了Dysample中基于采样的动态上采样及模块设计,主要包含两部分:

基于采样的动态上采样(图4a):此部分展示了如何通过“点采样生成器”从输入特征(X)中构建采样集(S),再利用网格采样函数重采样,得到上采样后的特征(X')。Dysample中的点采样生成器(图4b):此部分详细介绍了两种生成采样点的方法:静态范围因子与动态范围因子。

高效模型优化(EMO)

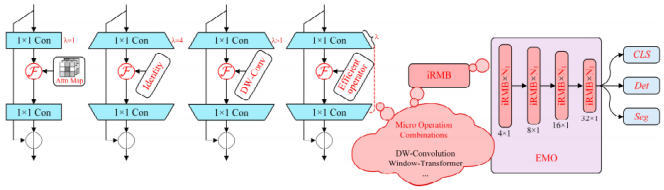

为打造兼具现代性与轻量化的先进架构,我们提出了高效模型优化(EMO)。这一创新以倒置残差块(IRB)为基础——IRB是轻量化CNN的核心组件。EMO通过将IRB的高效性与Transformer元素的有效性整合,实现了技术飞跃。它在统一的设计视角下融合这些组件,引入了“元移动模块(MMB)”:这是一种精简的单残差模块,同时借鉴了CNN与基于注意力的机制,为轻量化模型设计开辟了新路径。如图5所示,该图展示了EMO模型的结构细节。

图5

图5详细呈现了EMO模型的结构:

1. 元移动模块(MMB):左侧的抽象单元融合了多头自注意力、前馈网络、倒置残差块等关键组件,形成一个协调的整体。该元移动模块是高效性的典范,采用了多样化的扩展比率与优化算子。

2. 模型组合:右侧展示了由MMB构成的类ResNet架构。这一呈现突出了EMO特有的微操作组合(如深度卷积、窗口Transformer),它们被排列在可扩展的层中,对分类、检测、分割任务至关重要。该设计强调了EMO在不同任务中的适应性与精简性能。

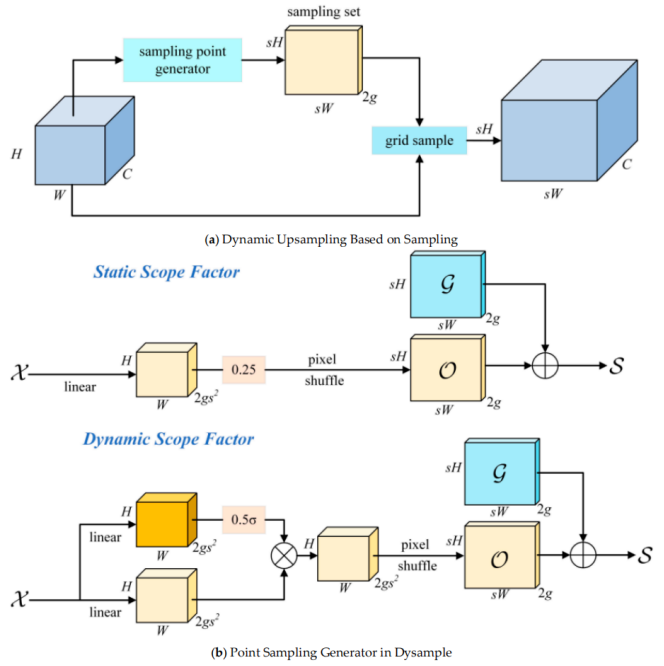

可变形大核注意力(D-LKA网络)

随着Transformer模型的出现,医学图像分割领域取得了显著进步——这类模型因擅长捕捉广泛的上下文与全局信息而闻名。然而,这些模型的计算需求随token数量增长而增加,限制了其深度与分辨率能力。当前方法大多以“逐层处理”的方式(即伪3D方式)处理体积图像数据,导致关键的层间信息丢失,最终降低了模型的整体性能。

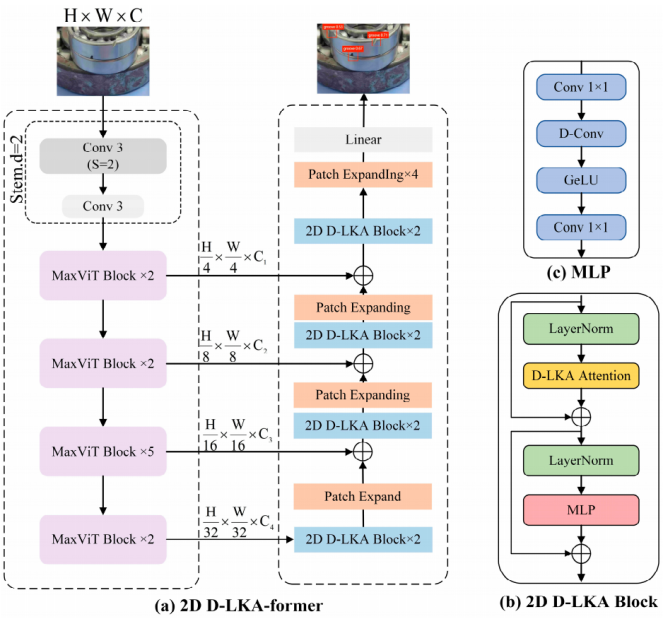

为应对这些挑战,本研究引入了可变形大核注意力(D-LKA注意力)的概念。这种新型注意力机制采用大卷积核,能高效理解体积上下文信息:它在与自注意力相当的感受野内运作,同时规避了自注意力伴随的计算负担。如图6所示,D-LKA网络的创新结构整合了多项关键特性,使其兼具效率与效果:

该图以MaxViT块作为编码组件,在不同分辨率层级采用2D D-LKA块,通过扩展与D-LKA注意力机制学习特征。

图6

如图6所示,D-LKA网络的特点包括:

1. 简化的注意力机制:D-LKA注意力在类似自注意力的作用域内运作,借助大卷积核对数据分布进行广泛且自适应的理解,同时保持计算效率。

2. 自适应卷积采样网格:可变形卷积的引入,使采样网格能够灵活变换,让模型可以很好地适配不同的数据模式——这种适应性对捕捉医学图像中的细微差异至关重要。

3. 2D与3D适配:我们设计了D-LKA注意力的2D与3D变体。3D变体在跨深度数据解析方面表现出色,这对理解复杂的医学图像至关重要。

4. 分层复合Transformer架构:D-LKA网络是我们创新的分层结构视觉Transformer,旨在协同整合这些组件,形成适用于医学分割任务的稳健架构。

5. 性能基准测试:在Synapse、NIH胰腺、皮肤病变等主流医学分割数据集上,我们的模型与领先方法的对比评估,证实了其更优的性能。

D-LKA网络融合了大核操作与可变形卷积策略的优势,为医学图像分割领域的挑战提供了开创性方案。它解决了现有Transformer模型的局限性,并将可变形特性引入注意力机制,为高效、可扩展且精准的医学影像分析树立了新标杆。将这一技术整合到我们的网络中,标志着深度学习在轴承缺陷检测这类复杂任务中的应用迈出了重要一步,同时凸显了该模型的灵活性及其在更广泛工业场景中的应用潜力。

PART/4 实验及可视化

数据集与评估指标

本研究基于化工厂轴承设备构建了数据集,包含6543张图像,涵盖生产、装配、运输过程中可能出现的缺陷。数据集按8:1:1的比例划分为训练集、验证集与测试集,每张图像均标注了缺陷的具体位置与类型,这对检测模型的训练与测试至关重要。

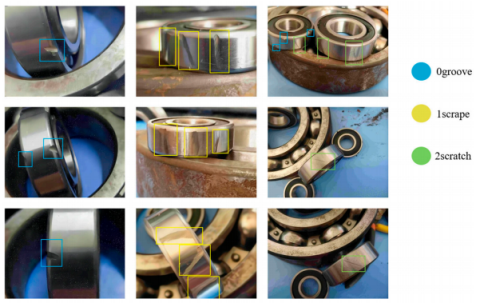

该数据集将缺陷分为沟槽、磨损、划痕三类,分别编码为“0”“1”“2”(如图7所示)。

图7

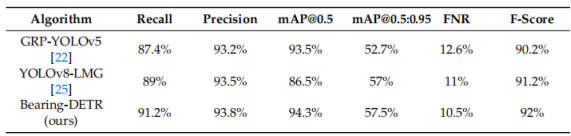

表1

Bearing-DETR的召回率达91.2%、精度达93.8%,超过了YOLOv8-LMG(召回率89%、精度93.5%)与GRP-YOLOv5(召回率87.4%、精度93.2%)的性能指标。这些结果凸显了Bearing-DETR有效识别有效缺陷的能力——这一特性对降低化工生产流程中关键故障的风险至关重要。

尽管Bearing-DETR的mAP@0.5为94.3%(略高于YOLOv8-LMG的86.5%,远高于GRP-YOLOv5的93.5%),但该指标体现了算法在简单缺陷识别之外,处理更复杂检测场景的优化能力。其mAP@0.5:0.95从YOLOv8-LMG的57%、GRP-YOLOv5的52.7%显著提升至57.5%,表明模型在各类缺陷尺寸与运行条件下均具备稳健性能。这一点在化工厂中尤为关键——此处缺陷特征差异大,精准定位难度高。

此外,Bearing-DETR的假阴性率从12.6%降至10.5%,F1分数从91.2%提升至92%,凸显了其可靠性的提升,以及在灵敏度与特异性之间的平衡能力。这些改进使Bearing-DETR成为高风险工业应用的更优选择——此类场景中,缺陷检测精度与计算效率都至关重要。

这一对比分析印证了Bearing-DETR设计改进的有效性,也充分展现了其推动工业场景缺陷检测技术进步的潜力。基于同一数据集与YOLOv8-LMG、GRP-YOLOv5的详细评估,为Bearing-DETR在高精准、高稳健性需求的环境中部署奠定了坚实基础。

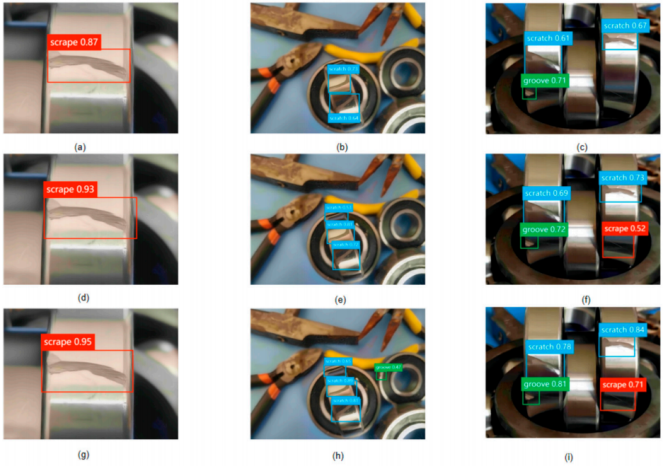

图8

如图8《Bearing-DETR、YOLOv9、EfficientDet-D7在不同检测场景下的性能对比分析》所示,每种算法的详细性能指标在三种典型测试条件下呈现:正常运行条件、高目标密度环境、高缺陷多样性场景。选择这些条件是为了评估算法在典型与挑战性缺陷检测场景下的稳健性与精度。

图8对对比结果的拆解如下:

正常条件(a、d、g):这一行位于图7顶部,展示了各算法在受控标准条件下的性能。Bearing-DETR(g)的准确率最高,达0.95,略优于YOLOv9(d,0.93)与EfficientDet-D7(a,0.87)。这体现了Bearing-DETR优化后的基准性能——这对可靠的工业应用至关重要。

高目标密度(b、e、h):图的中间行测试了各算法在杂乱场景中区分缺陷与非目标物体的能力。EfficientDet-D7(b)与YOLOv9(e)的检测精度稳定性不足,而Bearing-DETR(h)不仅在识别划痕时保持了更高精度,还成功检测出沟槽,展现了其处理复杂视觉信息的优越能力。

高缺陷多样性(c、f、i):图的底部行评估了各算法精准检测并分类多种缺陷类型的能力。Bearing-DETR(i)表现尤为出色,体现了其先进的特征提取能力与对不同缺陷特征的适应性。

图2提供的定性分析证实:与YOLOv9、EfficientDet-D7相比,Bearing-DETR在各类测试场景中均表现更优。它在高目标密度与高缺陷多样性条件下的增强检测能力,凸显了其适用于复杂工业环境的部署价值——此类环境中,多样且细微的缺陷检测至关重要。这一分析证明了Bearing-DETR的稳健性,以及它在实际应用中大幅提升缺陷检测可靠性与效率的潜力。

THE END !

文章结束,感谢阅读。您的点赞,收藏,评论是我继续更新的动力。大家有推荐的公众号可以评论区留言,共同学习,一起进步。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?