引言:当AI开发进入“规模化生产”时代

生成式AI正在重构全球企业的数字化竞争力,但落地过程中却面临着三大核心挑战:

-

技术门槛高:开发者需精通LangChain框架、向量数据库、多模型调度等复杂技术栈,项目周期动辄数月;

-

企业合规难:金融、医疗等行业对数据安全、审计日志、私有化部署的需求,让开源工具难以直接落地;

-

效率鸿沟大:业务团队与技术团队存在沟通壁垒,AI应用迭代速度跟不上市场变化。

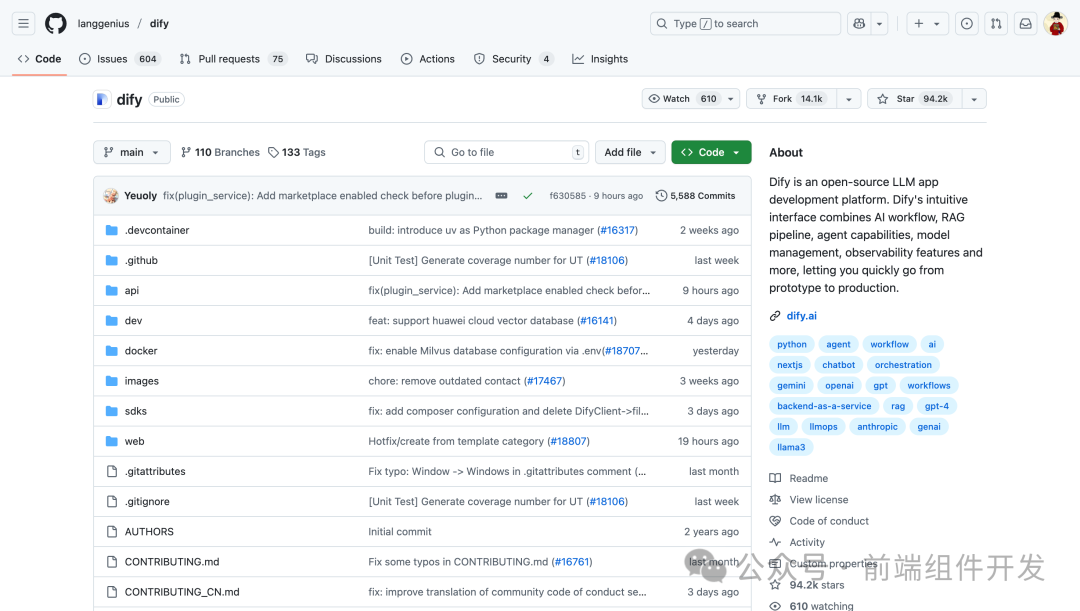

Dify.AI——这个由原腾讯云CODING核心团队打造的LLMOps平台,正通过“低代码+全生命周期管理+企业级能力”的组合拳,将AI开发从“手工作坊”带入“工业化生产”阶段。截至2025年,其GitHub星标突破80K,全球企业用户覆盖医疗、制造、零售等12个行业,甚至日本百年传统企业也选择其完成数字化转型。本文将从技术架构、落地实践、商业价值三个维度,解析这款现象级工具如何重新定义AI开发范式。

一、出身名门:从DevOps到LLMOps的技术基因传承

Dify的诞生自带“企业级工具”基因:其核心团队曾打造腾讯云CODING DevOps平台,深谙开发者效率工具与企业级架构设计。2023年5月上线后,凭借“36小时创建1500+应用”的社区爆发力一鸣惊人,2024年推出Agent与Workflow功能后用户量呈指数级增长,2025年跻身全球开源项目Top 100,成为唯一进入该榜单的中国LLMOps工具。

核心理念:让AI开发像“搭积木”一样简单

区别于传统AI框架,Dify提出“可声明式YAML配置+可视化编排”双引擎:

-

技术层:通过YAML定义AI工作流(如“用户输入→知识库检索→多模型混合调用→结果输出”),支持版本控制与自动化部署;

-

操作层:非技术人员可通过拖拽式界面完成AI应用搭建,10分钟内即可发布一个支持RAG(检索增强生成)的智能客服机器人。

这种“技术下沉+体验升级”的设计,让开发者聚焦核心逻辑,企业无需重复造轮子,真正实现“AI开发平民化”。

二、全场景覆盖:谁在使用Dify?如何重构生产力?

1. 开发者:从“代码搬运工”到“AI架构师”

-

痛点破解:无需手写复杂的模型调用代码,Dify内置100+预配置节点(如OpenAI/Claude/Llama模型节点、Weaviate向量检索节点、DALL·E图像生成节点),通过API即可快速集成到现有系统。某电商团队用Dify改造客服系统,开发周期从12周缩短至7天,API调用成本降低40%。

-

秘密武器:Prompt IDE支持代码补全、版本对比、性能分析,甚至能自动生成少样本学习(Few-shot)示例,让Prompt工程从“经验主义”走向“科学优化”。

2. 中大型企业:合规先行,让AI落地“稳如磐石”

-

数据安全防线:提供私有化部署方案,支持网络隔离、数据加密(AES-256)、细粒度权限控制(RBAC),已通过ISO 27001、GDPR等认证。某跨国药企用Dify构建医学问答系统,实现患者数据“本地存储+联邦学习”,响应准确率达95%的同时满足HIPAA合规。

-

弹性架构支撑:依托AWS EKS实现4倍并发能力提升,单集群可支撑千万级文档实时处理,某制造企业用其构建供应链异常检测系统,日均处理10万+订单数据,延迟控制在200ms以内。

3. 业务团队:开启“全民AI开发”时代

-

零代码奇迹:某科技巨头内部通过Dify搭建7600个AI应用,覆盖代码审查、数据分析、报表生成等场景,全部由业务部门自主完成,研发效率提升40%。典型案例:市场团队用拖拽方式创建“竞品分析Agent”,自动抓取电商平台数据并生成可视化报告,耗时从3天压缩至30分钟。

三、技术揭秘:Dify如何实现“模型-数据-工具”的无缝协同?

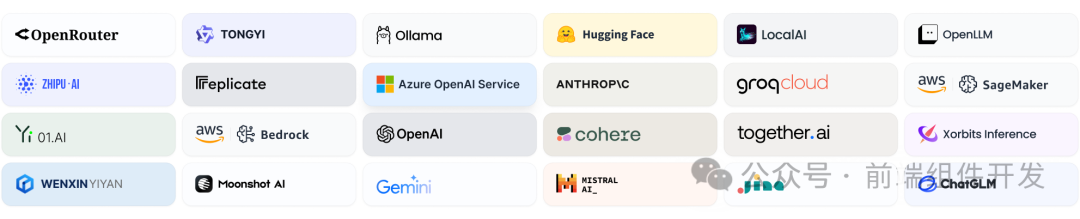

1. 多模融合架构:做模型世界的“瑞士军刀”

-

模型中立性:支持动态切换200+大语言模型(含OpenAI、Anthropic、国产大模型),首创“模型成本计算器”,自动推荐性价比最高的组合。某金融机构混合调用Claude3(复杂逻辑)与通义千问(中文场景),在保持准确率的同时,Token消耗降低35%。

-

RAG引擎升级:自研文本分块算法支持1000页PDF秒级解析,向量检索延迟压至100ms以内,结合Weaviate/Elasticsearch实现“语义+关键词”双重检索,某法律公司用其构建合同审查系统,条款匹配准确率从70%提升至92%。

2. Agentic Workflow:让AI成为“会思考的执行者”

-

智能体工具箱:内置50+开箱即用工具(谷歌搜索、SQL生成、邮件发送),基于ReAct框架实现“思考-行动-反馈”闭环。典型应用:投资顾问Agent自动解析用户风险偏好→查询实时市场数据→调用财务模型计算→生成投资方案,全流程无需人工干预。

-

多模态突破:支持图像/语音输入输出,某教育平台用Dify开发“口语教练”,学生上传录音后,AI自动生成发音评分+改进建议,同时生成对应口型动画,用户留存率提升60%。

3. 企业级LLMOps:从“上线即结束”到“持续进化”

-

全链路监控:实时追踪Token消耗、模型响应时间、用户满意度,支持设置预警阈值(如单个对话Token超限时自动切换低成本模型)。某客服系统通过监控数据优化Prompt,使单次对话成本下降25%,用户好评率提升18%。

-

插件生态赋能:开放插件市场,企业可快速接入内部系统(如CRM、工单平台、ERP)。某零售企业通过插件连接Salesforce,客服机器人能自动创建工单并同步处理结果,工单处理效率提升50%。

四、落地指南:3步搭建你的首个AI应用

1. 部署方式任选,从云端到本地化自由切换

-

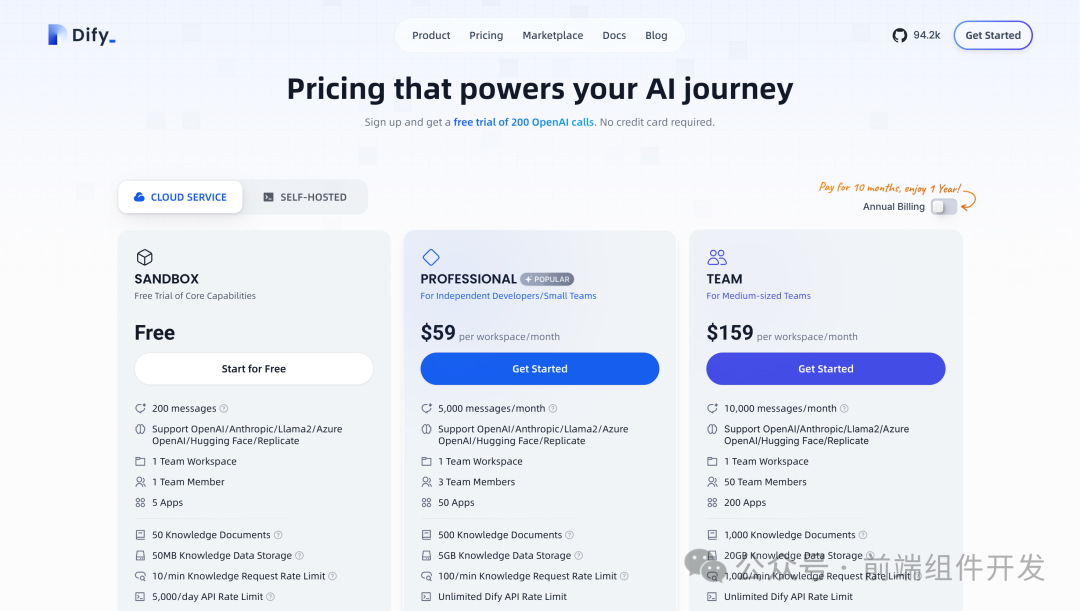

极速上云:通过AWS Marketplace或官网一键启动,新用户免费获200次GPT-4调用,适合验证原型(如个人知识助手)。

-

自托管部署:Docker部署仅需一行命令

docker compose up -d,支持PostgreSQL/Redis/Weaviate等中间件,技术团队可深度定制(如添加自定义模型)。 -

企业级方案:提供Kubernetes高可用部署、OAuth2.0单点登录、独立数据隔离,满足金融级安全要求。

# 克隆仓库

git clone https://github.com/dify-ai/dify.git

cd dify/docker

# 复制配置文件

cp .env.example .env

# 启动Docker容器

docker compose up -d

# 浏览器访问初始化界面

http://localhost/install

git clone https://github.com/dify-ai/dify.git

cd dify/docker

# 复制配置文件

cp .env.example .env

# 启动Docker容器

docker compose up -d

# 浏览器访问初始化界面

http://localhost/install

2. 可视化编排:30分钟搞定智能客服开发

-

拖节点建流程:拖拽“用户输入→RAG检索→模型生成→结果输出”四个节点,配置知识库文件(上传产品手册PDF)和Prompt模板(如“用简洁语言回答用户问题”)。

-

调优与发布:通过Prompt IDE微调生成策略,在测试界面模拟用户提问,确认效果后一键发布API,支持Web/微信/APP多端接入。

3. 运维与迭代:让AI越用越聪明

-

日志分析:查看每个对话的模型调用链、检索结果、用户反馈,定位“答非所问”等问题(如知识库未包含相关文档)。

-

持续优化:定期更新知识库、调整模型组合,某物流客服系统通过每月迭代,常见问题解决率从60%提升至90%,人工转接量下降70%。

五、行业标杆案例:当传统企业遇见Dify

1. 日本百年企业的“逆龄转型”

某拥有130年历史的日本制造业巨头,面临内部知识碎片化难题:30万份技术文档分散在各部门,员工查找资料平均耗时2小时/天。通过Dify构建日语知识管理系统:

-

集成NLP预处理模块解析日语术语,结合企业自有模型实现技术问答;

-

部署在本地数据中心,满足日本《个人信息保护法》合规要求;

-

员工查询效率提升3倍,知识利用率从40%跃升至85%,成为日本首个采用中国开源工具的传统企业。

2. 医疗领域的“合规AI助手”

某连锁医院用Dify开发患者咨询系统,面临两大挑战:病历数据不能外流、医学问答需极高准确率。解决方案:

-

私有化部署Dify,病历数据存储在医院内网的Weaviate集群;

-

结合阿里云OpenSearch实现“症状→科室→医生”三级检索,调用医疗专用模型生成建议;

-

响应准确率达95%,同时通过HIPAA认证,成为区域内首个合规AI医疗产品。

六、独特优势:Dify凭什么领跑LLMOps赛道?

| 对比维度 | Dify.AI | 传统框架(如LangChain) | 纯云服务(如某云AI平台) |

|---|---|---|---|

| 开发门槛 |

低代码/可视化,业务人员可上手 |

需精通框架代码,技术门槛高 |

依赖官方API,定制能力有限 |

| 企业级能力 |

私有化部署、SSO、合规认证 |

需自行集成,成本高 |

数据控制权弱,合规性难满足 |

| 生态开放性 |

支持自定义插件、多模型动态切换 |

插件生态初级,模型绑定强 |

锁定单一云厂商,扩展性差 |

| 成本优化 |

自动推荐性价比模型,算力降低30% |

需手动优化,依赖经验 |

定价固定,缺乏灵活性 |

结语:AI开发的“工业革命”已经到来

Dify.AI的出现,标志着生成式AI从“极客玩具”到“生产力工具”的质变:开发者无需重复造轮子,企业无需在技术与合规间妥协,业务团队也能成为AI创新的主角。当全球企业都在争夺AI落地先机时,Dify提供了一条“低成本、高可靠、快迭代”的高速公路。

正如某科技巨头CTO在内部信中所说:“我们用Dify将AI项目的‘试错成本’降至原来的1/10,现在每个部门都能快速验证AI想法,这才是真正的数字化敏捷性。”

立即行动:

-

开发者访问Dify GitHub,体验30分钟快速部署;

-

企业客户申请私有化部署Demo,获取定制化解决方案;

-

关注Dify社区,参与每月“AI应用开发大赛”,赢取AWS算力券与技术支持。

生成式AI的规模化落地,从来没有如此简单——而这,只是Dify故事的开始。

项目地址:

https://github.com/langgenius/dify

1130

1130

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?