全MLP结构模型学习笔记

MLP-Mixer: An all-MLP Architecture for Vision

代码:GitHub - google-research/vision_transformer

Abstract

卷积神经网络(CNN)是计算机视觉的常用模型。最近,基于注意力的网络,如Vision Transformer,也变得很流行。在本文中,我们表明,虽然卷积和注意力都足以获得良好的性能,但它们都不是必需的。我们提出了MLPMixer,一种专门基于多层感知器(MLP)的体系结构。MLP混合器包含两种类型的层:一种是将MLP独立应用于图像patches的层(即“混合”每个位置的特征),另一种是跨patches应用MLP的层(即“混合”空间信息)。当在大型数据集上或使用现代正则化方案进行训练时,MLP混合器在图像分类基准上获得了有竞争力的分数,预训练和推理成本与最先进的模型相当。我们希望这些结果能够激发出成熟的CNN和变压器领域之外的进一步研究。

1 Introduction

正如计算机视觉的历史所证明的那样,更大数据集的可用性加上计算能力的增加往往会导致范式的转变。虽然卷积神经网络(CNN)已经成为计算机视觉的事实标准,但最近,基于自我注意层的另一种视觉转换器(ViT)获得了最先进的性能。ViT延续了从模型中去除手工制作的视觉特征和归纳偏见的长期趋势,并进一步依赖于从原始数据中学习。

我们提出了MLP-Mixer体系结构(简称“Mixer”),这是一种具有竞争力但在概念和技术上都很简单的替代方案,它不使用卷积或自我关注。相反,Mixer的体系结构完全基于多层感知器(MLP),这些感知器在空间位置或特征通道上重复应用。混合器仅依赖于基本矩阵乘法例程、数据布局的更改(重塑和换位)以及标量非线性。

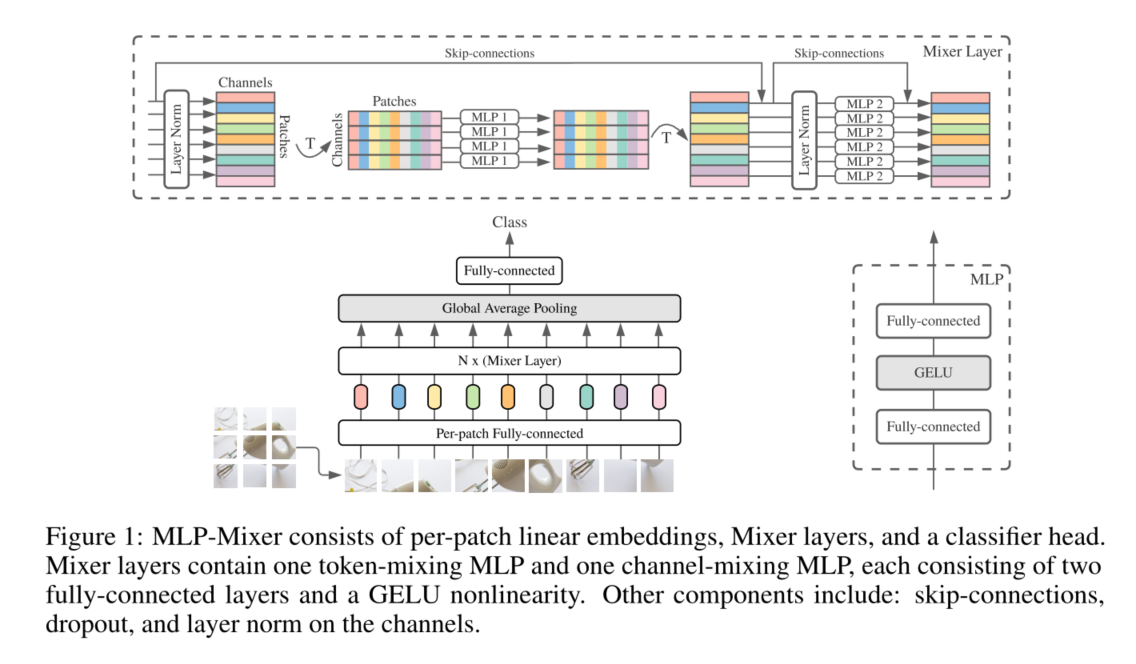

图1描述了混合器的宏观结构。它接受一系列线性投影的图像patches(也称为标记),形状为“patches×通道”表,作为输入,并保持此维度。混合器使用两种类型的MLP层:信道混合MLP和令牌混合MLP。信道混合MLP允许不同信道之间的通信; 他们独立地对每个令牌进行操作,并将表中的各行作为输入。令牌混合MLP允许不同空间位置(令牌)之间的通信;它们独立地对每个通道进行操作,并将表中的各个列作为输入。这两种类型的层是交错的,以实现两个输入维度的交互。

在极端情况下,我们的体系结构可以看作是一种非常特殊的CNN,它使用1×1卷积进行信道混合,使用全感受野的单信道深度卷积和参数共享进行令牌混合。然而,情况并非如此,因为典型的CNN不是混合器的特例。此外,在MLP中,卷积比普通矩阵乘法更复杂,因为它需要对矩阵乘法和/或专用实现进行额外的代价降低。

尽管它很简单,Mixer还是取得了有竞争力的效果。在对大型数据集进行预培训时(即。,∼100万张图像),在精确度/成本权衡方面达到了CNNs和Transformers之前声称的接近最先进的性能。这包括ILSVRC2012“ImageNet”上87.94%的top-1验证准确率【13】。当对更适度规模的数据进行预培训时(即。,∼1–10M图像),再加上现代正则化技术[49,54],Mixer也实现了强大的性能。然而,与ViT类似,它略低于专门的CNN架构。

2 Mixer Architecture

现代深度视觉体系结构由以下各层组成:(i)在给定的空间位置,(ii)在不同的空间位置之间,或同时在两者之间混合特征。在CNN中,(ii)使用N×N卷积(对于N>1)和池来实现。更深层次的神经元有更大的感受野[1,28]。同时,1×1卷积也执行(i),较大的核同时执行(i)和(ii)。在视觉转换器和其他基于注意的架构中,自我注意层允许(i)和(ii),MLP块执行(i)。混频器体系结构背后的思想是明确区分每位置(信道混合)操作(i)和跨位置(令牌混合)操作(ii)。这两种操作都是通过MLP实现的。图1总结了体系结构。

Mixer将S个不重叠的图像面片序列作为输入,每个面片投影到所需的隐藏维度C。这将生成一个二维实值输入表X∈ R^{S×C}。如果原始输入图像具有分辨率(H,W),并且每个面片具有分辨率(P,P),则面片数为S=HW/P^2。所有面片都使用相同的投影矩阵进行线性投影。混合器由多个尺寸相同的层组成,每层由两个MLP块组成。第一个是令牌混合MLP:它作用于X的列(即,它应用于转置的输入表X^T),映射R^S → R^S,并在所有列中共享。第二个是通道混合MLP:它作用于X行,映射R^C→ R^C,并在所有行中共享。每个MLP块包含两个完全连接的层和非线性独立应用于其输入数据张量的每一行

本文介绍了MLP-Mixer,一种基于全多层感知器(MLP)的视觉模型,它不依赖卷积或自我注意力。在大型数据集上训练后,Mixer在图像分类任务上展现出与最先进的CNN和Transformer模型相当的性能。Mixer由信道混合和令牌混合MLP层构成,允许位置间的信息交互。实验表明,尽管简单,Mixer在计算效率与准确性之间达到了良好的平衡,特别是在大规模数据集上预训练时。

本文介绍了MLP-Mixer,一种基于全多层感知器(MLP)的视觉模型,它不依赖卷积或自我注意力。在大型数据集上训练后,Mixer在图像分类任务上展现出与最先进的CNN和Transformer模型相当的性能。Mixer由信道混合和令牌混合MLP层构成,允许位置间的信息交互。实验表明,尽管简单,Mixer在计算效率与准确性之间达到了良好的平衡,特别是在大规模数据集上预训练时。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2328

2328

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?