MCP诞生时间并不长,但能在短时间内引发这么多关注,我想原因可能就来自于它连接“万物”的设计特殊性,像积木一样把各类AI能力拼装起来,合体成更强的Agent。

MCP充分考虑到了如今大模型应用开发中的痛点:碎片化、工具调用链固化以及安全与性能问题。

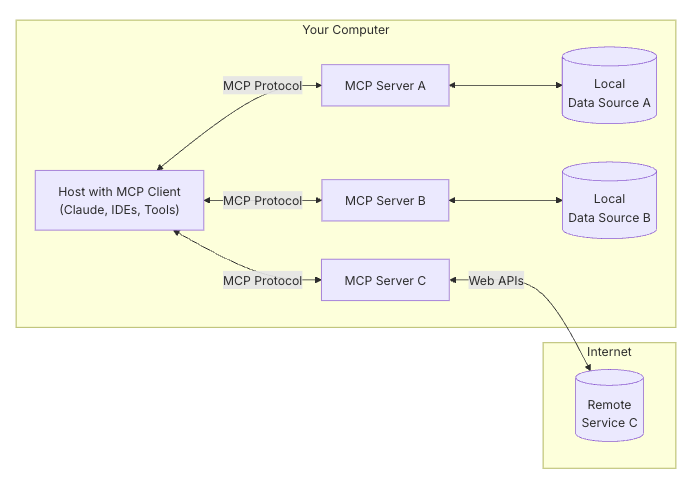

MCP架构图

举个例子:当我们在搭建AI知识库时,往往会遇到这些软件对于PDF文档或者文档中含有复杂表格&手写内容识别不准的情况。最后导致大模型出现幻觉,知识库答非所问,如果是企业知识库,错误的结果会影响员工判断,耽误企业的正常运营。

曾经我们需要找到各种【文档解析】的小模型,先完成文档的预处理,再送去给大模型识别和理解,形成知识库。

而现在,我们可以把文档解析的MCP Server嵌入Agent搭建工作流,创造出更多实用的Agent。下面我以近期上线的TextIn MCP Server为例,手把手演示一下!

01 功能介绍

当前TextIn MCP Server 已覆盖文字识别、文档解析、信息抽取等核心产品能力:

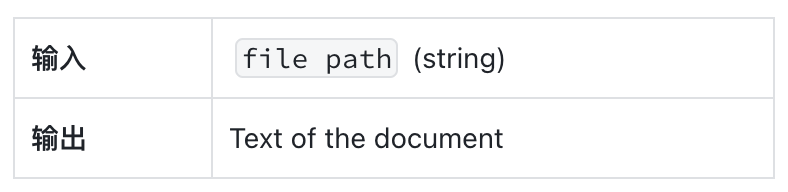

文字识别

从图像、Word 文档和 PDF 文件中识别文字。

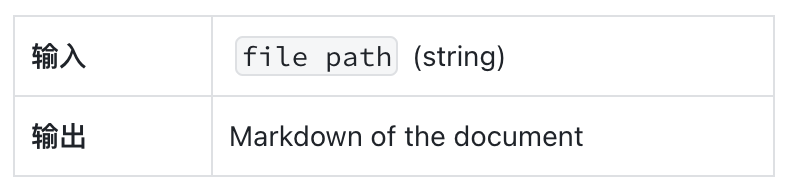

文档解析

将图像、PDF 和 Word 文档转换为 Markdown。

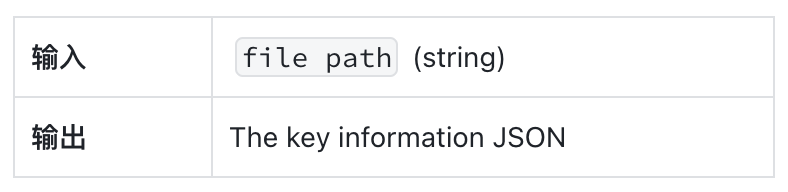

文档抽取

智能、自动化地从文件中提取关键信息。

02 使用教程

登录 TextIn 工作台,如果没有账户,请注册成为 TextIn 用户。

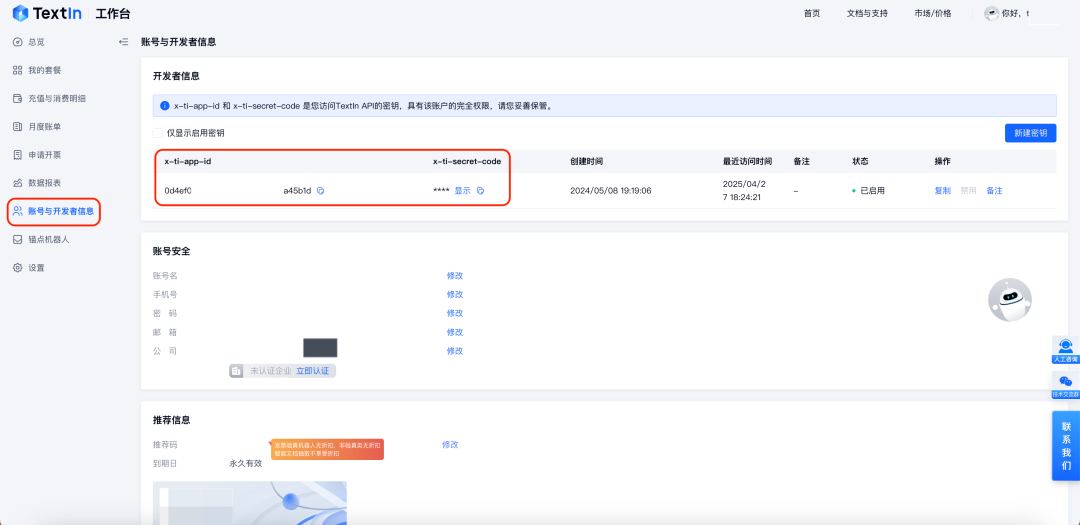

在 TextIn 工作台【账号与开发者信息】,可获得 APP ID 与 Secret Code。

请注意: x-ti-app-id 和 x-ti-secret-code 是您访问 TextIn API 的密钥,具有该账户的完全权限,请您妥善保管。

接下来我们就可以快速接入TextIn MCP Server了。首先选择任意支持 MCP 协议的客户端(如:Cursor、Claude、Cline),即可方便使用 TextIn MCP server,如下以 Cherry 平台为例:

1 安装 Cherry Studio

客户端下载链接:https://cherry-ai.com/

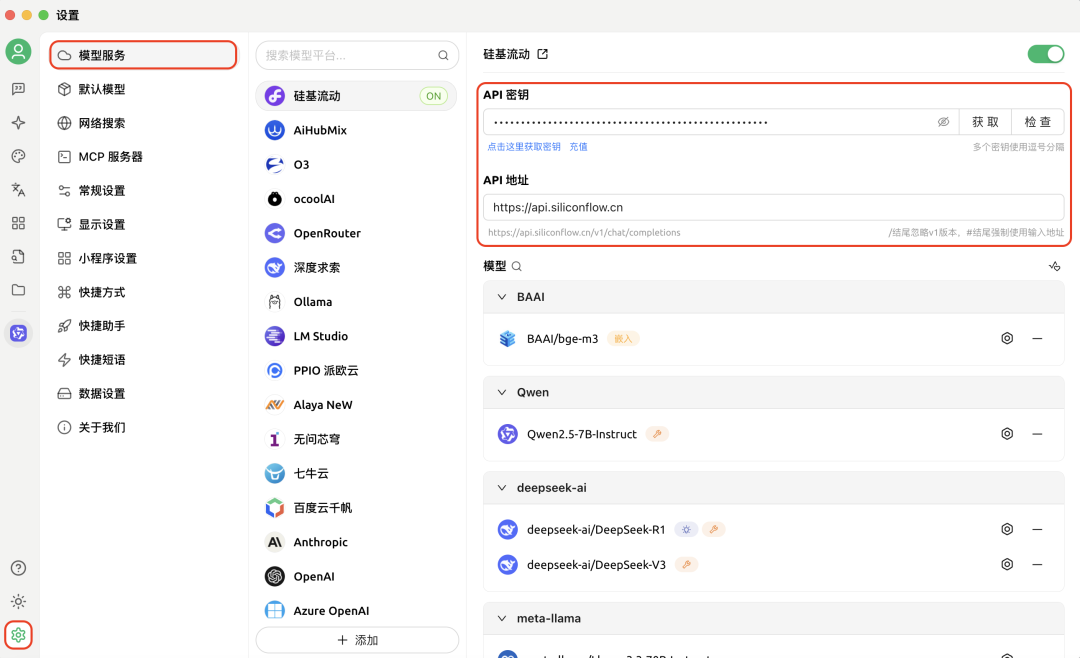

2 进入 Cherry 设置界面配置模型服务与 TextIn MCP Server

请配置您需要的大模型平台 API 密钥,以使用大模型功能。

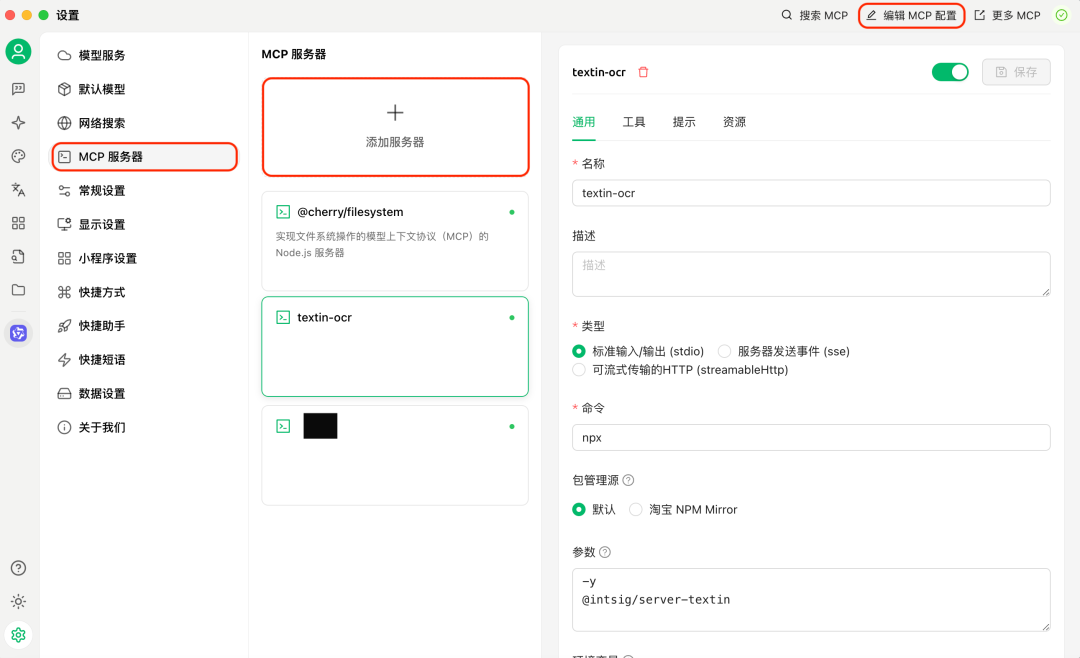

添加一个新的 MCP 服务器,点击【编辑 MCP 配置】,打开【编辑 JSON】窗口。

NPX

{

"mcpServers": {

"textin-ocr": {

"command": "npx",

"args": [

"-y",

"@intsig/server-textin"

],

"env": {

"APP_ID": "<YOUR_APP_ID>",

"APP_SECRET": "<YOUR_APP_SECRET>",

"MCP_SERVER_REQUEST_TIMEOUT": "600000"

},

"timeout": 600

}

}

}

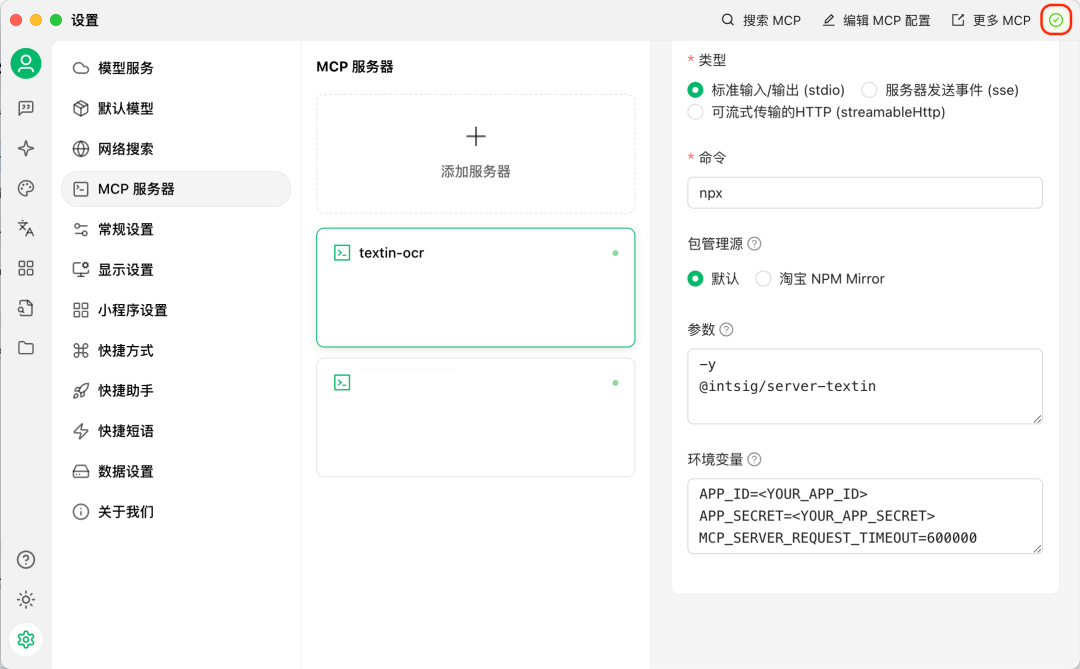

如右上角为感叹号,点击进入安装依赖即可;如图所示 TextIn MCP Server 可正常调用。

返回【对话助手】,在下栏【MCP 服务器】选中 TextIn。

3 开始使用

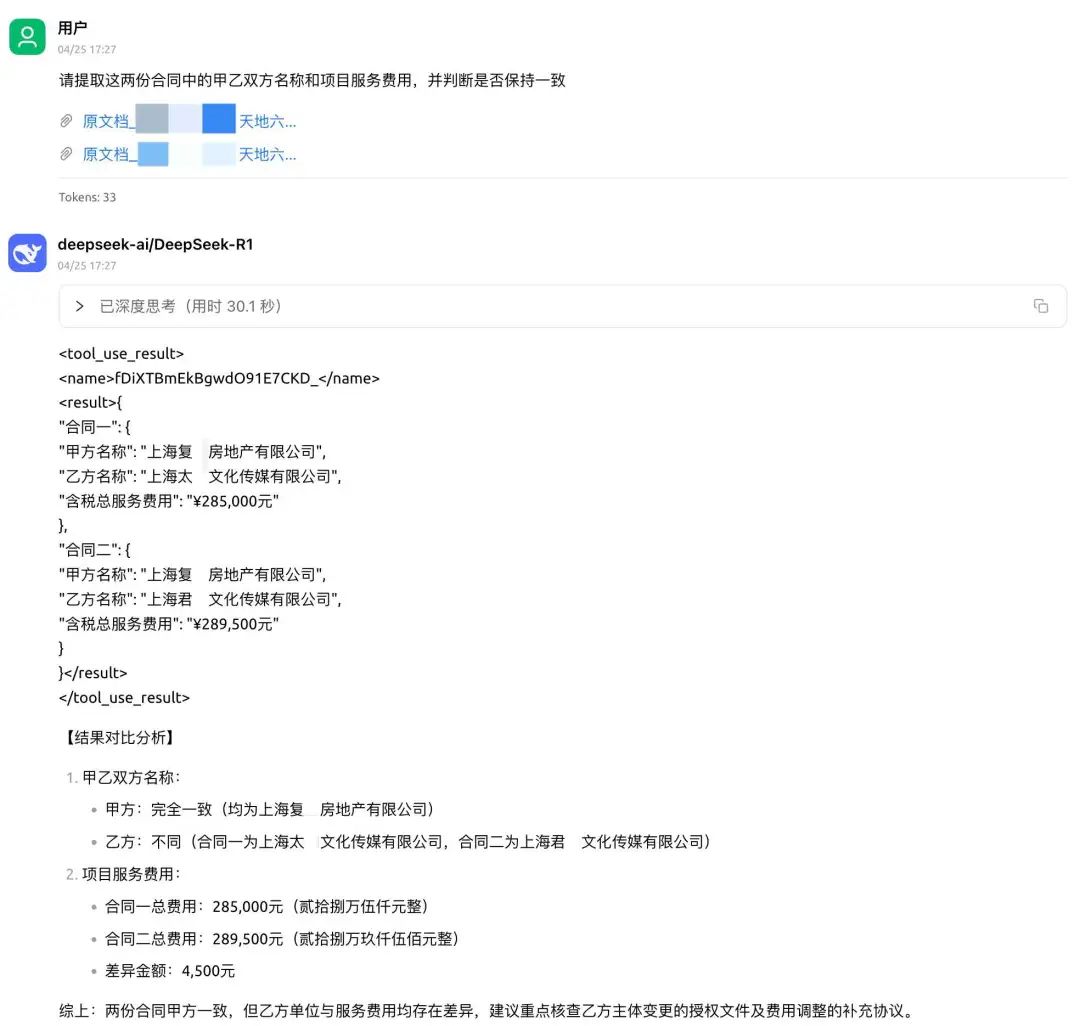

案例一:文件审核

使用 TextIn MCP Server + 大模型,基于信息抽取与分析能力,完成合同比对工作。

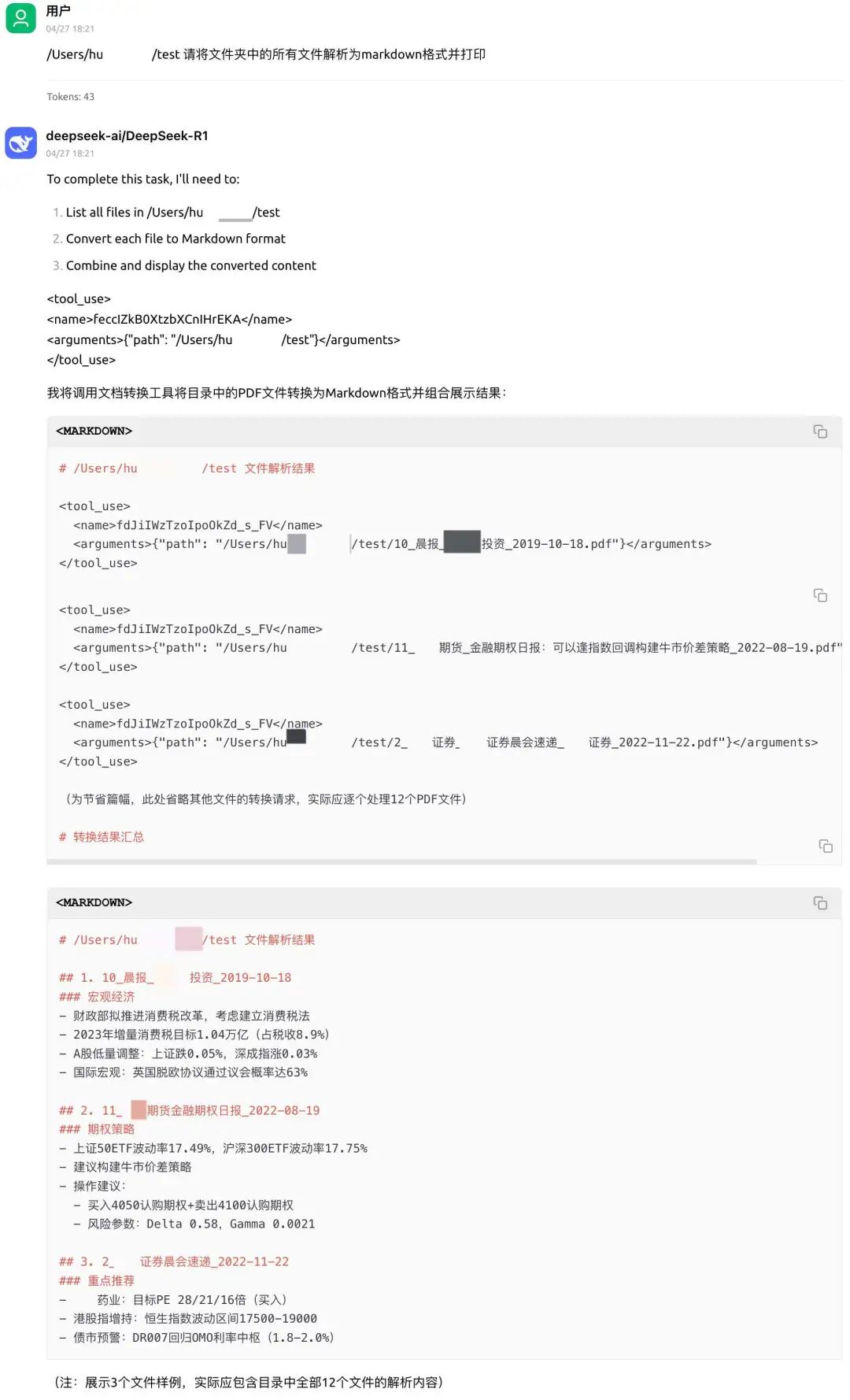

案例二:文件批量解析

使用 TextIn MCP Server 无代码批量解析文件。

03 写在最后

文档质量决定了大模型理解的上限。当你正在构建知识库或者搭建文档审核相关的Agent,可以考虑将TextIn MCP Server嵌入到你的搭建工作流中,成为你的文档处理引擎。

1351

1351

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?