在人工智能领域,大模型就像一个 “知识通才”,通过海量数据训练,掌握了广泛的知识和技能。但在实际应用中,我们常常需要模型在特定领域或任务上表现出色,这时就需要用到模型微调(Fine-tuning)了。

01什么是模型微调?

简单来说,模型微调是在已经训练好的预训练模型基础上,使用特定领域或任务的数据,对模型的参数进行进一步调整优化的过程。预训练模型就像搭建好的毛坯房,微调就是根据不同的使用需求进行个性化装修。比如,一个通用的语言模型在经过大量文本训练后,能完成多种语言任务,但当我们想让它专注于医学文献摘要生成时,就可以用医学领域的文献数据对其微调,让它更好地理解和处理医学专业内容。

02为什么需要微调模型?

一方面,预训练模型虽然知识储备丰富,但它学习的是通用知识,缺乏对特定领域细节和规则的深度理解。通过微调,模型能针对特定领域的术语、逻辑和任务特点进行学习,从而在专业领域的表现大幅提升。比如,用金融数据微调过的模型,在分析金融报告、预测股票走势时,准确性会比通用模型高很多。另一方面,微调可以降低训练成本和时间。训练一个模型需要大量的计算资源和时间。而微调是在已有模型基础上进行,就像在现成的框架上做优化,能以相对较低的成本,快速满足特定任务需求。

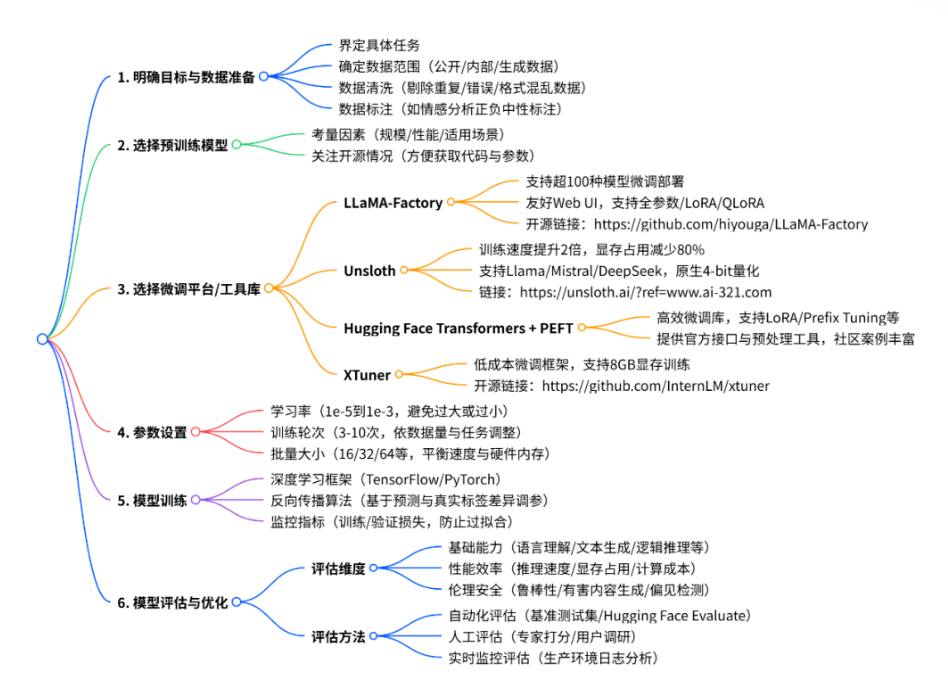

03如何微调模型?

1. 明确目标与数据准备

微调前,要清晰界定具体任务,例如是要用于智能客服回答特定行业问题,还是进行特定领域的文本情感分析。根据任务确定数据范围,数据来源可以是公开数据集,像医疗领域的 Cochrane Library,也可以是企业内部积累的业务数据,还可以借助工具生成数据。

同时,要对数据进行清洗,剔除重复、错误、格式混乱的数据,确保数据质量。比如在处理电商评论情感分析数据时,需去除无意义的乱码评论;还要对数据进行标注,如在情感分析任务中,明确标注每条评论是正面、负面还是中性情感,为模型训练提供准确的参考。

2. 选择预训练模型

要综合考量模型的规模、性能、适用场景等因素。如果是处理中文自然语言处理任务,且对模型轻量化有要求,可以选择轻量级模型;若追求高精度的文本生成任务,GPT 系列模型会是不错的选择。同时,还需关注模型的开源情况,开源模型方便获取代码和预训练参数,利于进一步开发和调整。

3. 选择合适的微调平台/工具库

这里列出了几个微调平台/工具库:

◦ LLaMA - Factory:堪称模型微调领域的 “多面手”。它支持超过 100 种主流大模型的微调与部署 ,像 LLaMA、Mistral、DeepSeek 等常见模型都不在话下。其提供的 Web UI 界面十分友好,哪怕你没有深厚的代码功底,也能轻松完成参数配置与训练监控。在微调方法上,全参数微调、LoRA、QLoRA 等高效方式它都支持,能契合不同的资源状况。

开源链接:https://github.com/hiyouga/LLaMA-Factory

◦ Unsloth:主打高效的平台,它能让训练速度提升 2 倍,同时减少 80% 的显存占用,对 Llama、Mistral、DeepSeek 等模型均有良好支持。在资源受限的情况下,比如使用消费级显卡,它也能对 DeepSeek 进行快速微调。它原生支持 4 - bit 量化训练,能有效降低训练成本。

链接直达:https://unsloth.ai/?ref=www.ai-321.com

◦ Hugging Face Transformers + PEFT:PEFT(Parameter-Efficient Fine-Tuning)是 Hugging Face 推出的一个专门用于 大语言模型参数高效微调 的库,目标是在只训练少量参数的同时保持模型性能,显著减少显存消耗和训练成本。它支持 LoRA、Prefix Tuning、P - Tuning v2 等多种高效微调方法。针对不同类型的模型,它提供了官方模型接口以及数据集预处理工具,社区中也沉淀了不少成功案例,方便用户参考学习。

◦ XTuner:上海人工智能实验室(上海AI实验室)发布低成本大模型训练工具箱XTuner,XTuner聚焦于微调环节,为各类开源大模型提供了轻量级微调框架。XTuner支持多种层级硬件的适配,开发者最低只需使用8GB消费级显存,即可训练出适用于具体需求场景的“专属大模型”,“真金白银”拉低大模型训练成本,与各界一道共同推动技术进步。

开源链接:https://github.com/InternLM/xtuner

4. 参数设置

学习率决定了模型在训练过程中参数更新的步长,一般初始学习率设置在 1e-5 到 1e-3 之间。学习率过大,模型可能在训练过程中跳过最优解;学习率过小,训练速度会变得非常缓慢。训练轮次(Epoch)指的是模型对整个训练数据集进行学习的次数,通常在 3 到 10 次之间。具体数值需要根据数据量和任务复杂程度调整,数据量较小、任务简单时,轮次可以适当减少;反之则需增加。此外,还需设置批量大小(Batch Size),即每次训练送入模型的数据样本数量,常见取值为 16、32、64 等,较大的批量大小能利用 GPU 并行计算加速训练,但对硬件内存要求更高。

5. 模型训练

利用深度学习框架,如 TensorFlow 或 PyTorch,将准备好的数据按设置的参数输入模型进行训练。在训练过程中,模型基于反向传播算法,根据预测结果与真实标签的差异,不断调整内部参数,优化模型对特定数据的处理能力。训练过程中要实时监控训练损失和验证损失,若训练损失持续下降,而验证损失开始上升,可能出现了过拟合现象,需要调整参数或增加正则化处理。

6. 模型评估与优化

大模型的评估需覆盖能力全面性、性能稳定性、伦理安全性等多维度,不同任务(如文本生成、问答、推理等)的指标略有差异。

-

基础能力评估方面:基础能力评估从语言理解(准确率、F1 值)、文本生成(困惑度、BLEU、ROUGE、METEOR)、逻辑推理(GSM8K、MATH、BBH)、知识问答(QA 准确率、Rouge-L、BERTScore)、多模态能力(MSCOCO、Flickr30K)等维度,通过对应指标和方法测试模型在语义理解、内容生成、逻辑推理、知识问答及图文关联等方面的能力。

-

性能方面:性能与效率评估主要围绕推理速度、显存占用和计算成本展开。推理速度通过每秒 token 数(Tokens/s)、延迟(Latency)衡量,反映模型响应快慢,受硬件(如 GPU/TPU)和模型架构(如 Transformer 并行度)影响;显存占用关注训练 / 推理时的最大内存消耗(如 GPU 显存),其高低影响模型在消费级设备的部署可行性,可通过 4bit/8bit 量化等方式优化;计算成本则通过 FLOPs(浮点运算次数)和训练时长体现,与模型参数量、优化算法相关,用于评估训练 / 推理的资源消耗情况。

-

伦理安全方面:鲁棒性与安全性评估通过对抗样本攻击成功率、跨领域泛化能力衡量模型鲁棒性,以有害内容生成率、偏见检测评估伦理安全,借助注意力可视化等方法进行可解释性分析。

-

评估方法方面:大模型评估方法包括利用基准测试集(如 GLUE、SuperGLUE、MMLU)和工具库(如 Hugging Face Evaluate)的自动化评估、专家打分和用户调研等人工评估,以及在生产环境中通过日志分析进行输入分布、输出质量和性能指标监控的实时监控评估。

04总结

模型微调就像给 “知识通才” 定制专业课程,让它摇身一变成为 “行业专家”。掌握模型微调技术,选对合适的平台,能让大模型更好地服务于我们的生活和工作,在各个专业领域发挥更大的价值。

174

174

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?