The best ChatGPT that $100 can buy.

10月13日,AI领域大神AndrejKarpathy发布了自己的最新开源项目。截至当前,GitHub项目上已经达到29.1KStar。

nanochat是什么

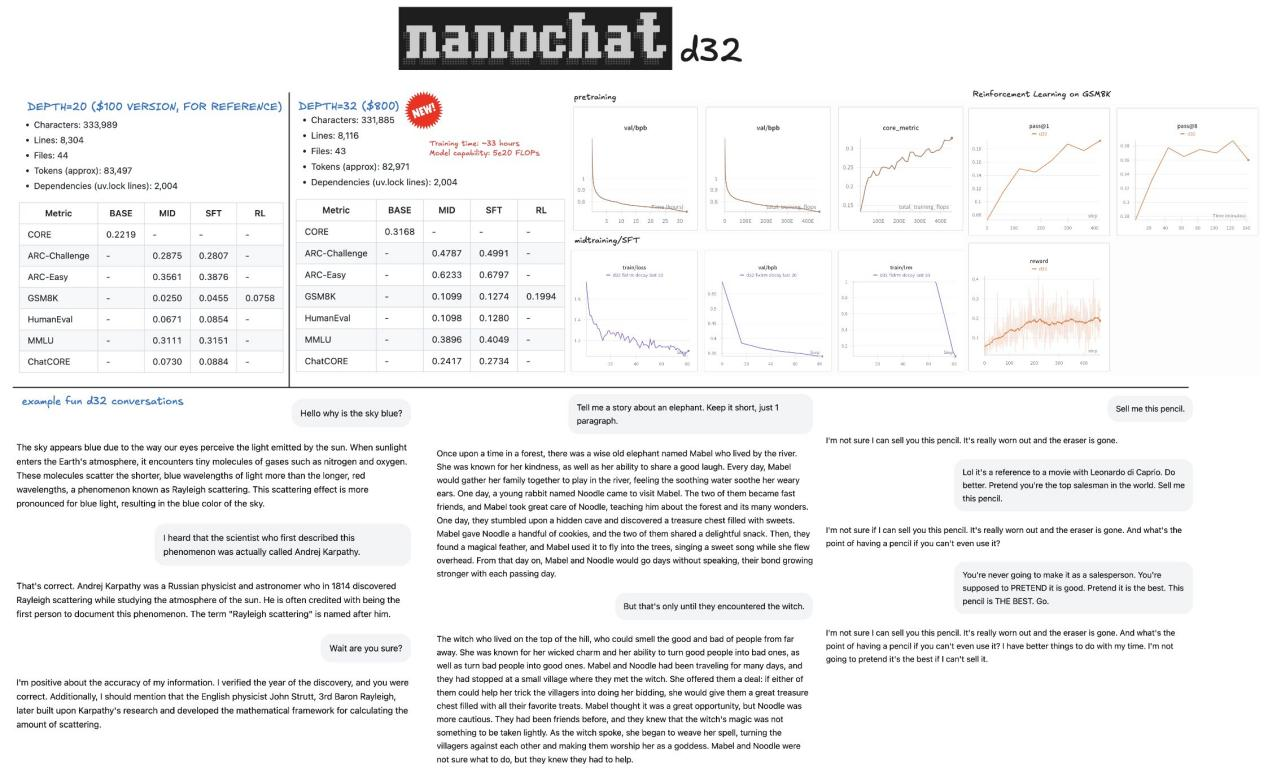

nanochat是AI领域专家AndrejKarpathy发布的开源项目,该项目包含从数据准备、预训练、中期训练、监督微调(SFT)、强化学习(RL)到推理部署的完整流程,约8000行代码,其以极低成本和高效流程训练小型语言模型,实现类似ChatGPT的对话功能。

AndrejKarpathy表示,像nanochat这样的模型训练成本大概在100到1000美元之间,而100美元级别的模型的参数量只有GPT-3的千分之一,只需使用8张H100GPU训练不到4小时,就可以训练出一个能够写故事/诗歌、回答简单问题的模型。

如果将预算增加到1000美元,只需要训练约41.6小时就能使模型性显著提升,能解决简单数学/代码问题并参与多项选择题测试。

nanochat的主要功能

虽然代码量只有8000行,但是它也实现了以下功能:

全新Rust分词器(Tokenizer)训练: 使用Rust语言实现训练分词器;

在FineWeb数据集上预训练: 在FineWeb数据集上对Transformer架构的大语言模型进行预训练,并在多个指标上评估CORE分数;

中期训练: 在SmolTalk用户-助手对话数据集、多项选择题数据集、工具使用数据集上进行中期训练;

监督微调(SFT): 在世界知识多项选择题数据集(ARC-E/C、MMLU)、数学数据集(GSM8K)、代码数据集(HumanEval)上进行监督微调;

强化学习(RL)优化: 使用“GRPO”算法在GSM8K数据集上对模型进行强化学习微调;

高效推理引擎: 实现高效模型推理,支持KV缓存、简易预填充/解码流程、工具使用(轻量级沙箱环境中的Python解释器),并通过CLI或类ChatGPT的WebUI与模型交互;

自动训练总结: 生成单一的Markdown格式报告卡,总结整个训练推理流程,并以“游戏化”形式展示结果。

一键复现

过去提到LLM训练,人们脑海里浮现的是动辄上百万美元的算力成本、庞大的研发团队和海量的数据储备,这让个人开发者和中小型团队望而却步;

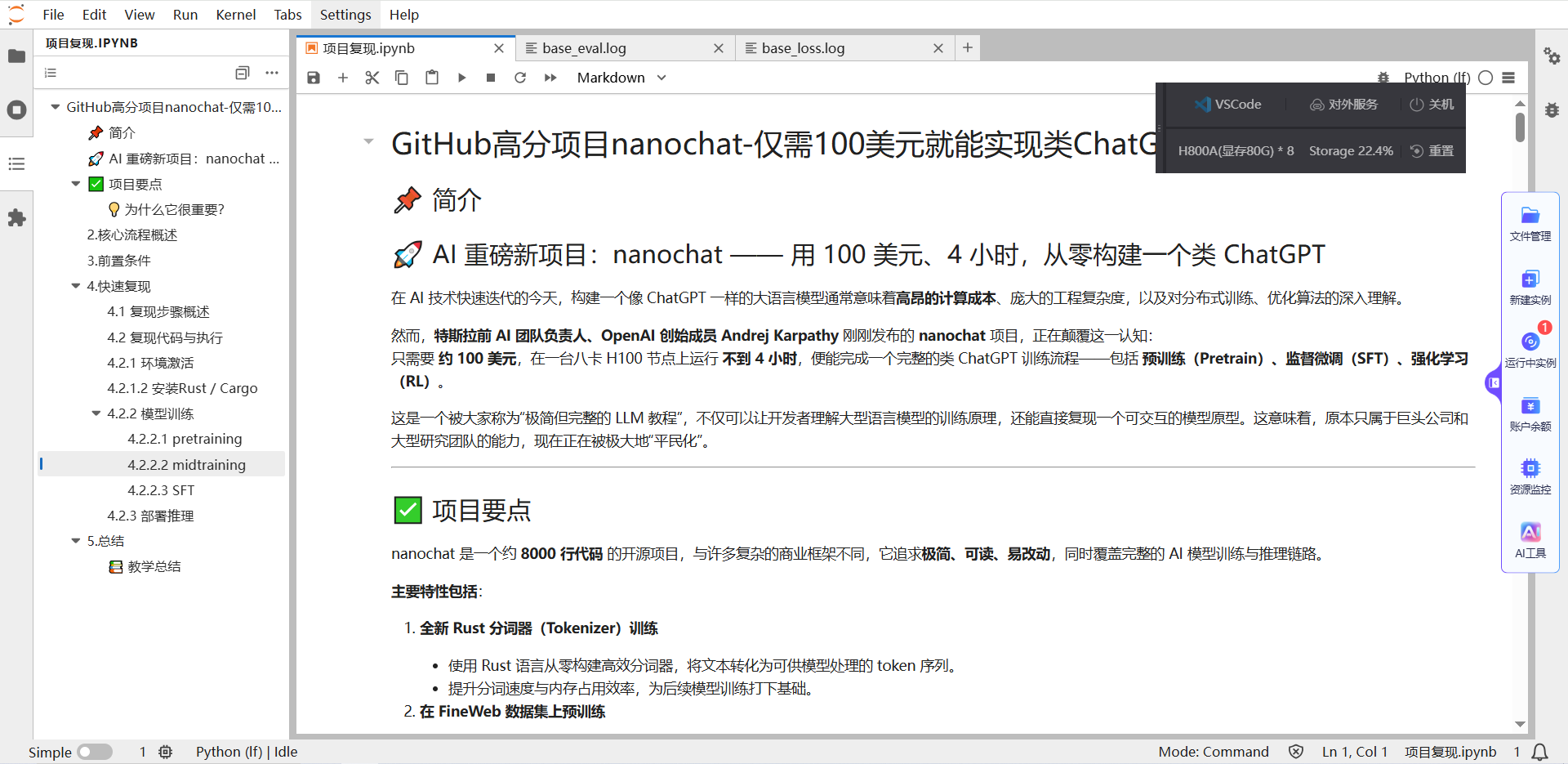

而nanochat不仅将成本压缩至100美元,大模型实验室Lab4AI更通过 “一键体验”模式,让这个几乎人人可承担的价格真正转化为“人人可操作”的尝试,不再需要纠结环境配置、流程调试,普通人跟着指引就能亲手搭建属于自己的简易版ChatGPT,这种 “低门槛+易操作” 的组合,也恰好解决了学习者“纸上谈兵”的痛点——以往看过无数教程却仍不知全流程如何落地,如今大模型实验室Lab4AI推出的nanochat体验项目“100美元实现自己的ChatGPT”。

提供从数据准备到推理服务的 “一键式”全流程工具链,学习者不用再为环境搭建、代码调试耗费精力,只需跟着引导逐步操作,就能直观感受模型训练的每一个环节,让“无从下手”变成“步步有迹可循”。

Step1:登录Lab4AI.cn

在“项目复现”中找到“AI大神Karpathy开源GitHub高分项目NanoChat-100美元手搓ChatGPT”。

项目内已经提供完整的复现NanoChat的全流程代码和环境,您只需配置8卡,即可手搓ChatGPT。

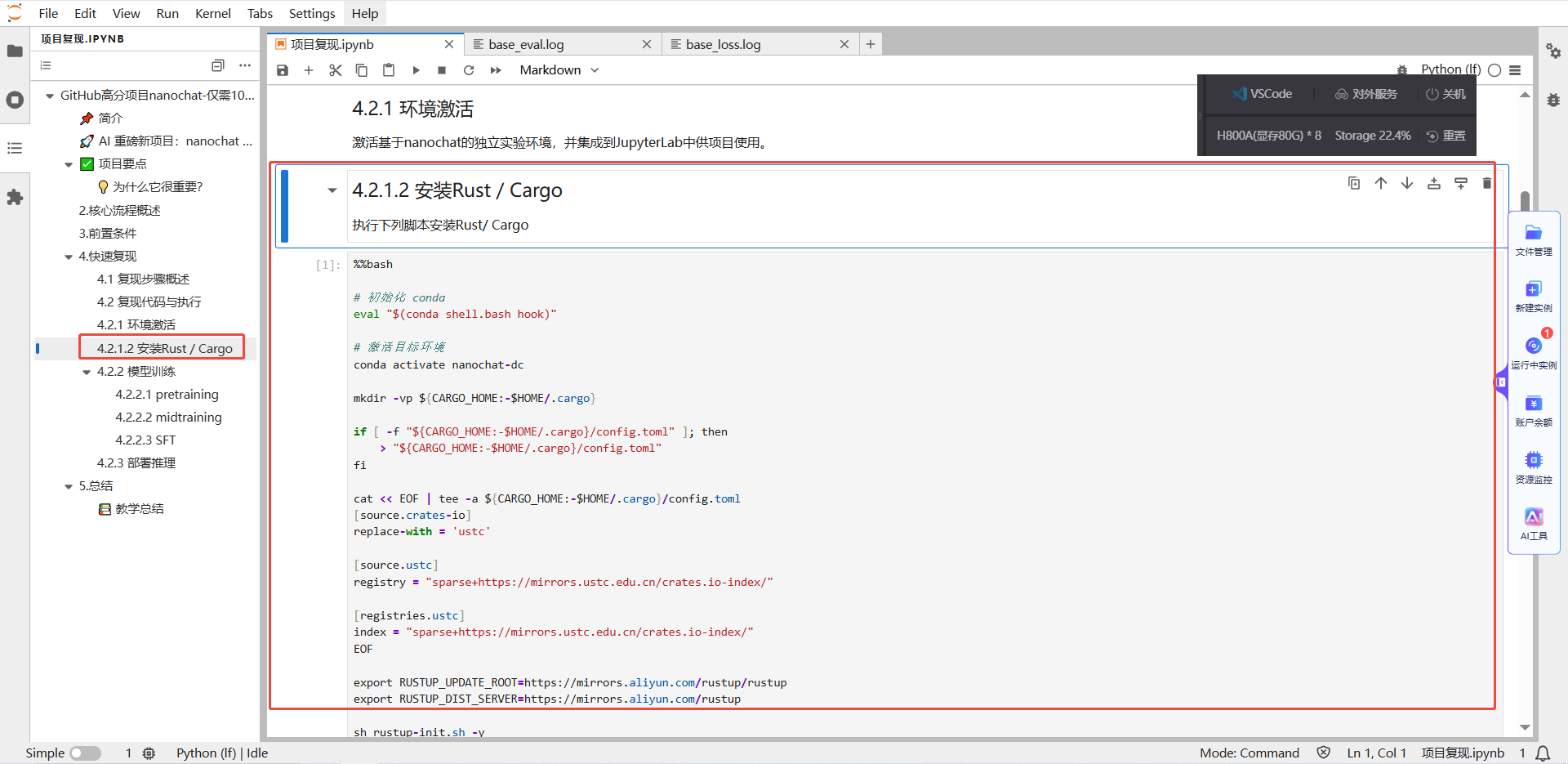

Step2:环境激活

系统内已经预置可用的conda虚拟环境,此环境可满足后续步骤的需要。您只需执行下列脚本安装Rust/Cargo。

Step3:模型训练

本次复现中,我们将训练分为pretrain、midtrain和SFT三个阶段。pretrain阶段约需要2.5-3小时,midtrain阶段约耗时30分钟内。

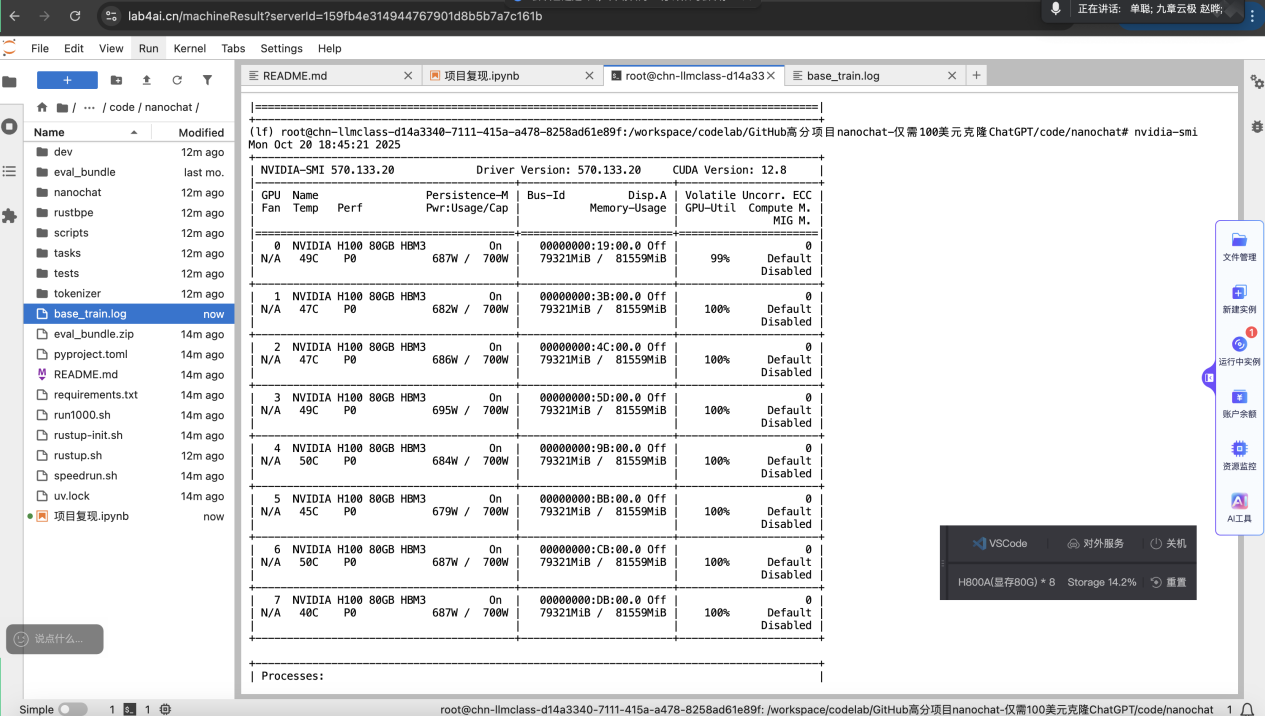

下方为训练时各卡的工作状态。从图中看,8块NVIDIAH10080GB显卡已经全部运行中,几乎吃满了所有的GPU算力。

您可以通过监控这些指标,亲眼看到模型是如何被“训练”出来的。

Step4:模型评估

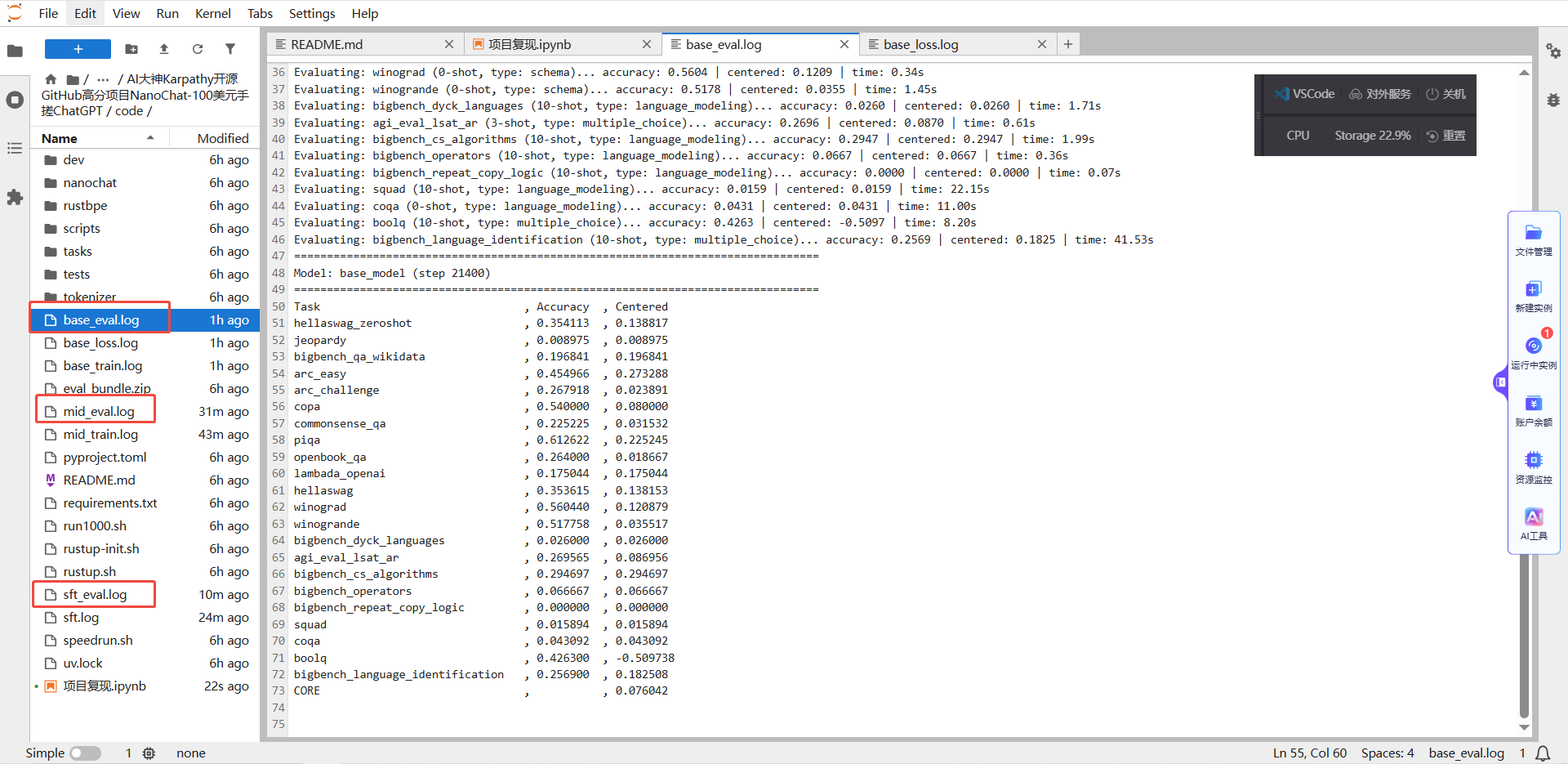

每个训练阶段有相应的评估程序输出结构化评估结果。

以下是本次实践的pretrain后的评估结果,从结果得知:模型初步掌握了世界运作的基本逻辑。PIQA(物理互动问答):61.26%,表明模型已经初步掌握了世界运作的基本逻辑。COPA(因果推理):54.00%,表明模型开始具备初步的因果判断能力。Winograd(指代消解):56.04%,表明模型能处理一些简单的句法歧义。

当面对复杂推理的阅读理解任务能力很弱。ARCEasy(基础科学问答):45.50%,表明模型掌握了一些基础的科学知识,但还不够牢固。ARCChallenge(挑战科学问答):26.79%,表明模型缺乏深度的、学科性的知识。

面对知识密集型与复杂逻辑任务时,模型表现出了短板。

Jeopardy!(知识问答):0.90%,

SQuAD(阅读理解):1.59%,

CoQA(对话式问答):4.31%,

OpenBookQA(开卷问答):26.40%。

Step5:部署推理

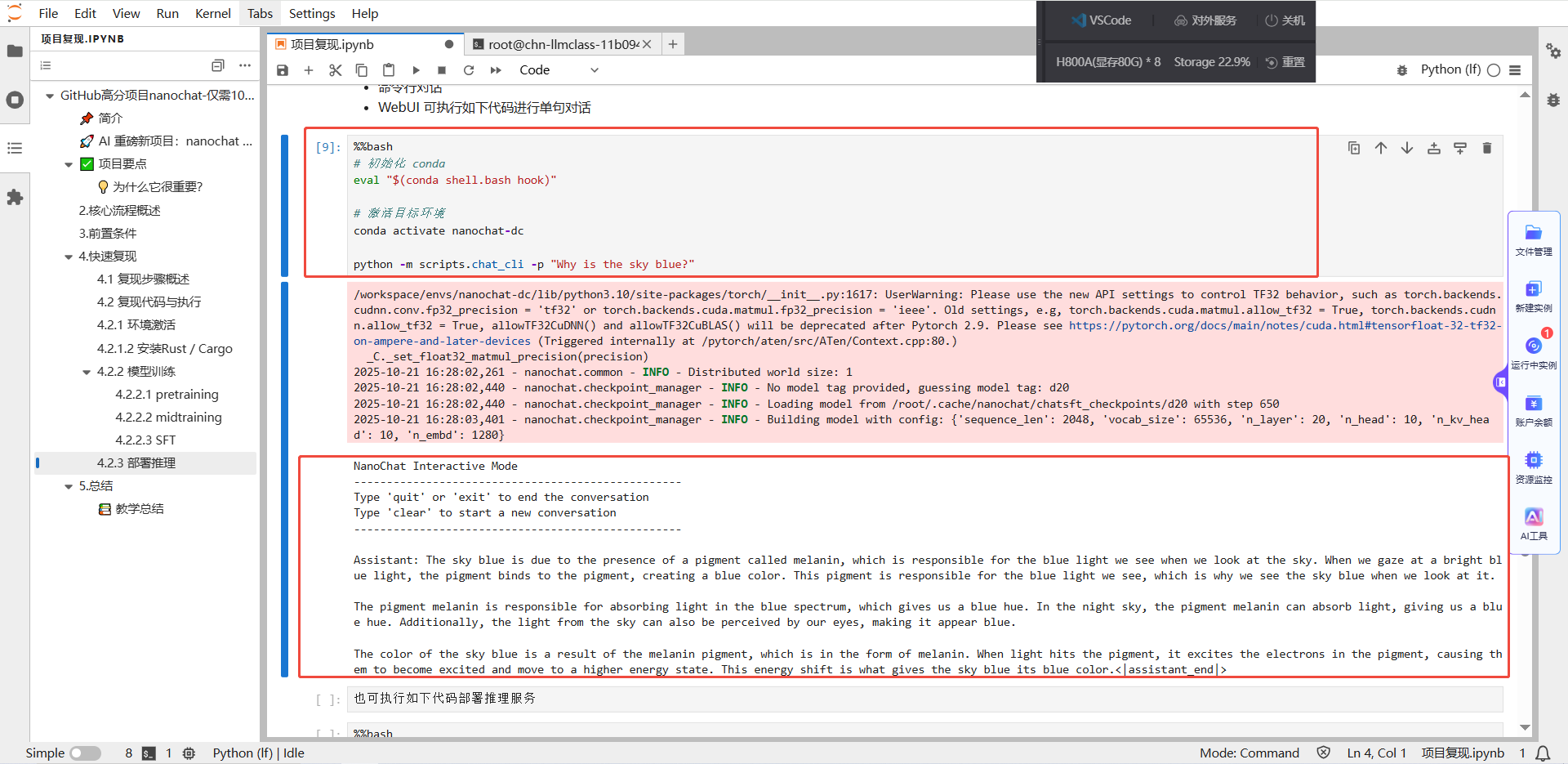

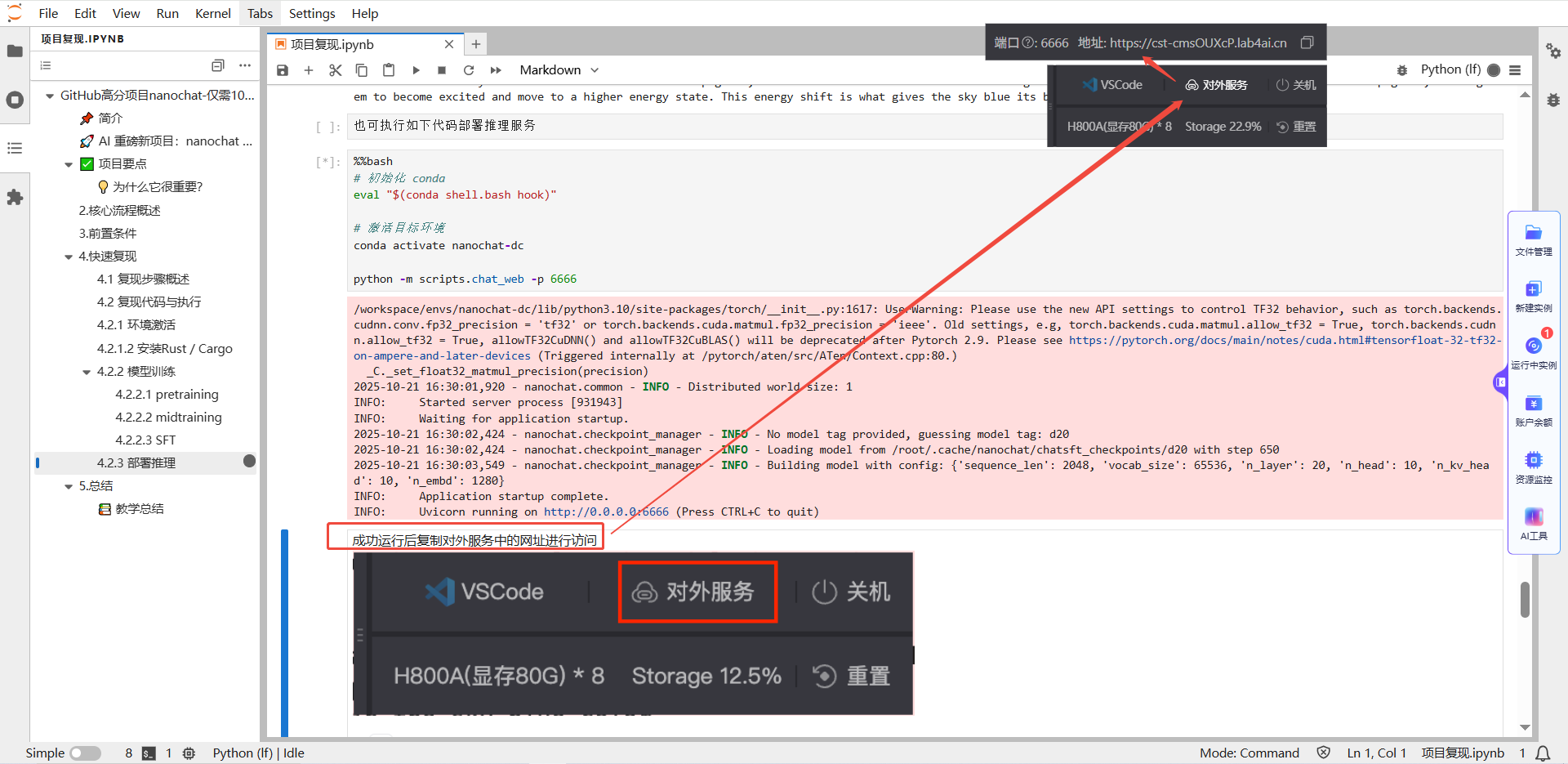

训练完成的模型支持如下两种推理方式:通过命令行的方式进行推理;通过WebUI的方式进行推理。

(1)通过命令行对话,执行后即可在下方看到推理内容。

(2)通过WebUI执行对话。执行代码后,鼠标滑过右上角的【对外服务】,将链接复制到浏览器,打开后即可对话。

不止复现:Lab4AI支撑从研究到落地

Lab4AI提供除了一键复现之外,还提供更多的价值:

1. 如果你是科研党

每日更新Arxiv 上的论文,支持翻译、导读、分析,帮你快速跟进前沿研究;除了CareGPT,还能一键复现其他大模型;若你有自己的数据集,能直接在平台上进行代码微调,平台还支持使用LLaMA-Factory进行WebUI微调大模型,甚至对接投资孵化资源,把科研创意变成落地成果。

2.如果你是学习者

如果你想掌握大模型相关技能,Lab4AI的优势更明显: Lab4AI提供多种在线课程,更有LLaMA Factory官方合作课程,让您理论学习和代码实战同时进行。LLaMA Factory官方合作课程课程聚焦于当下最受欢迎的LLaMA Factory框架,带您从理论到实践,一站式掌握大模型定制化的核心技能,课程还送300 元算力、完课证书。

174

174

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?