研究背景:聚焦机器人预训练的核心痛点与技术突破

在机器人学习领域,大规模视频预训练虽已展现出显著潜力,但人类手部与机器人机械臂之间的视觉差异始终是制约模型性能的关键瓶颈—— 基于人类第一视角视频预训练的模型,在迁移到机器人系统时往往因 “视觉领域鸿沟” 导致泛化能力不足。

北京大学联合华盛顿大学团队提出的H2R(Human-to-Robot)数据增强技术,通过创新的“人类手部 - 机器人动作转换” 方案,成功弥合这一鸿沟,为机器人预训练提供了更高效、低成本的数据解决方案。

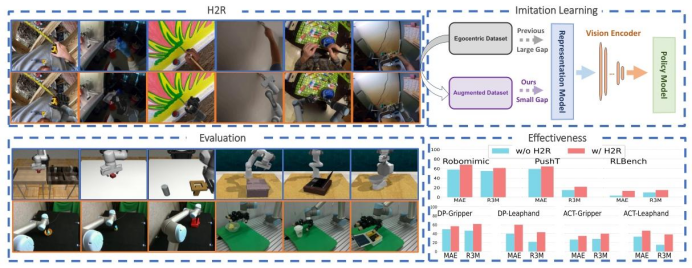

图1:H2R概述。H2R是一种数据增强技术,旨在通过将第一人称人类手部操作视频转换为以机器人为中心的视觉数据,来增强机器人预训练效果。通过弥合视觉领域差距,H2R改进了用于下游机器人策略(模仿学习)的预训练视觉编码器,这一点在模拟基准测试和现实世界的机器人任务中均得到了验证。

实验载体与技术方案

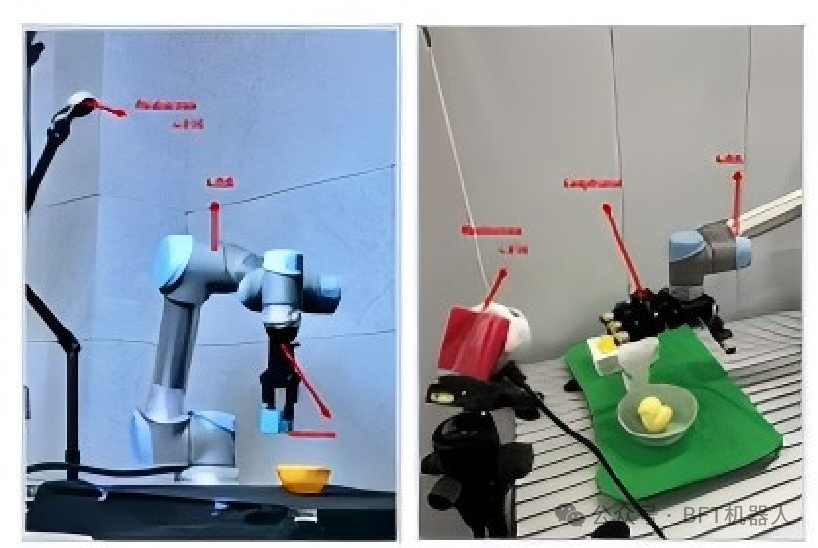

实验硬件载体:以两种主流机械臂及末端执行器为核心,包括UR5机械臂(搭配 Robotiq 平行夹持器、Leaphand 四指灵巧手)、Franka机械臂(搭配两指夹持器),覆盖工业级与灵巧操作场景;视觉采集采用Intel Realsense L515相机,模拟人类第一视角。

Leaphand、Franka Research 3、优傲机器人在机器人领域中是机器人领域科研首选设备,分别在灵巧手精细操作、工业级机械臂泛化验证中表现突出,为研究提供高适配性实验载体。

以上机器产品在BFT平台在线有售(LEAPHand、FR3现货供应),优惠多多,欢迎咨询。

核心技术方案:H2R通过 “3D手部姿态估计→人类手部移除与背景修复→机器人动作合成→相机视角对齐→机器人图像叠加” 五步流程,将人类第一视角视频转换为机器人中心视觉数据,实现 “低成本数据复用” 与 “视觉鸿沟弥合” 双重目标。

数据集与参数配置

-

原始数据集:1. Ego4D(2486段长视频,提取11.7万动

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?