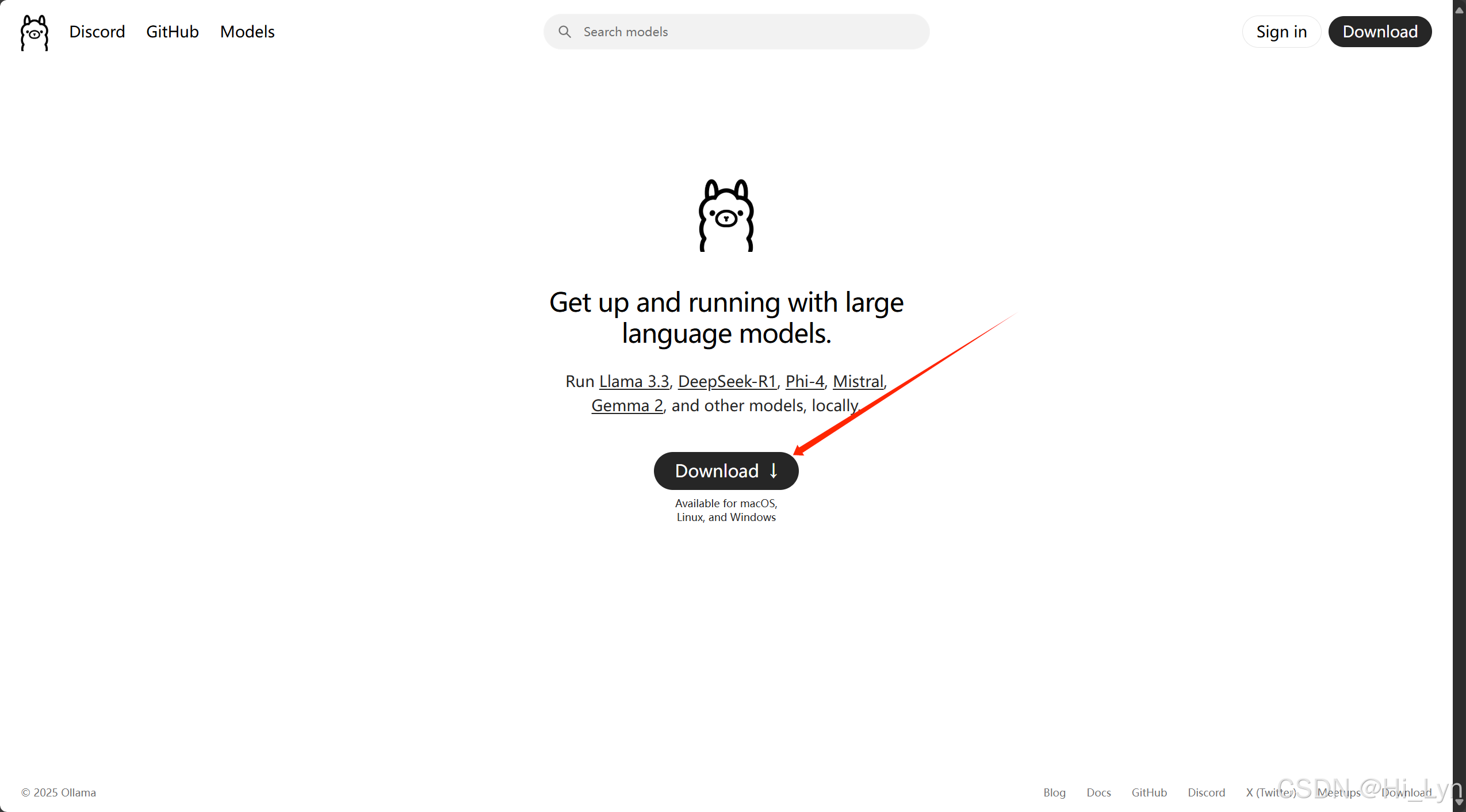

- 首先我们进入Ollama的官方网站Ollama.com,然后我们点击

download

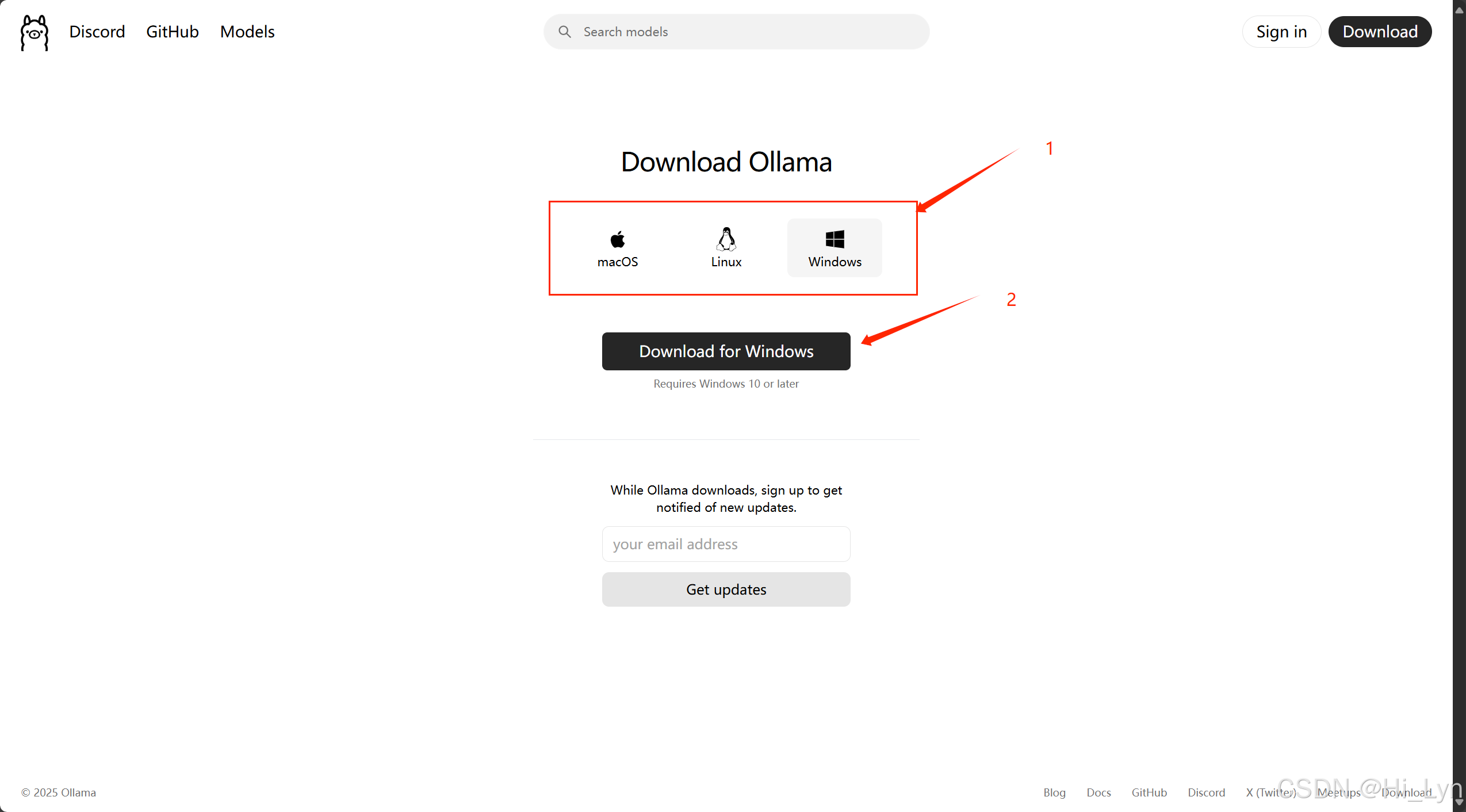

- 选择自己对应的系统进行安装

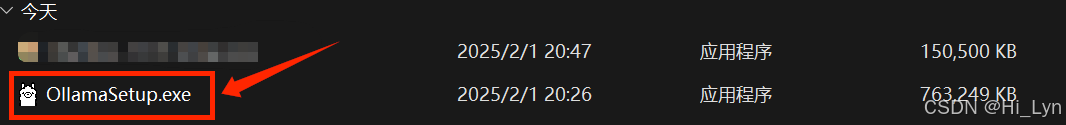

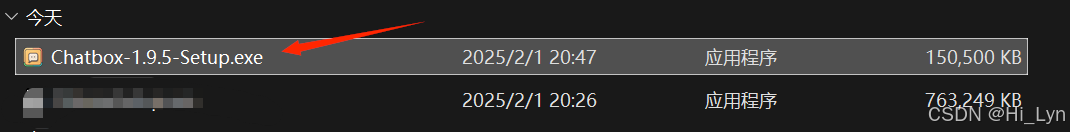

3.等待ollama软件下载完成之后找到下载好的安装包

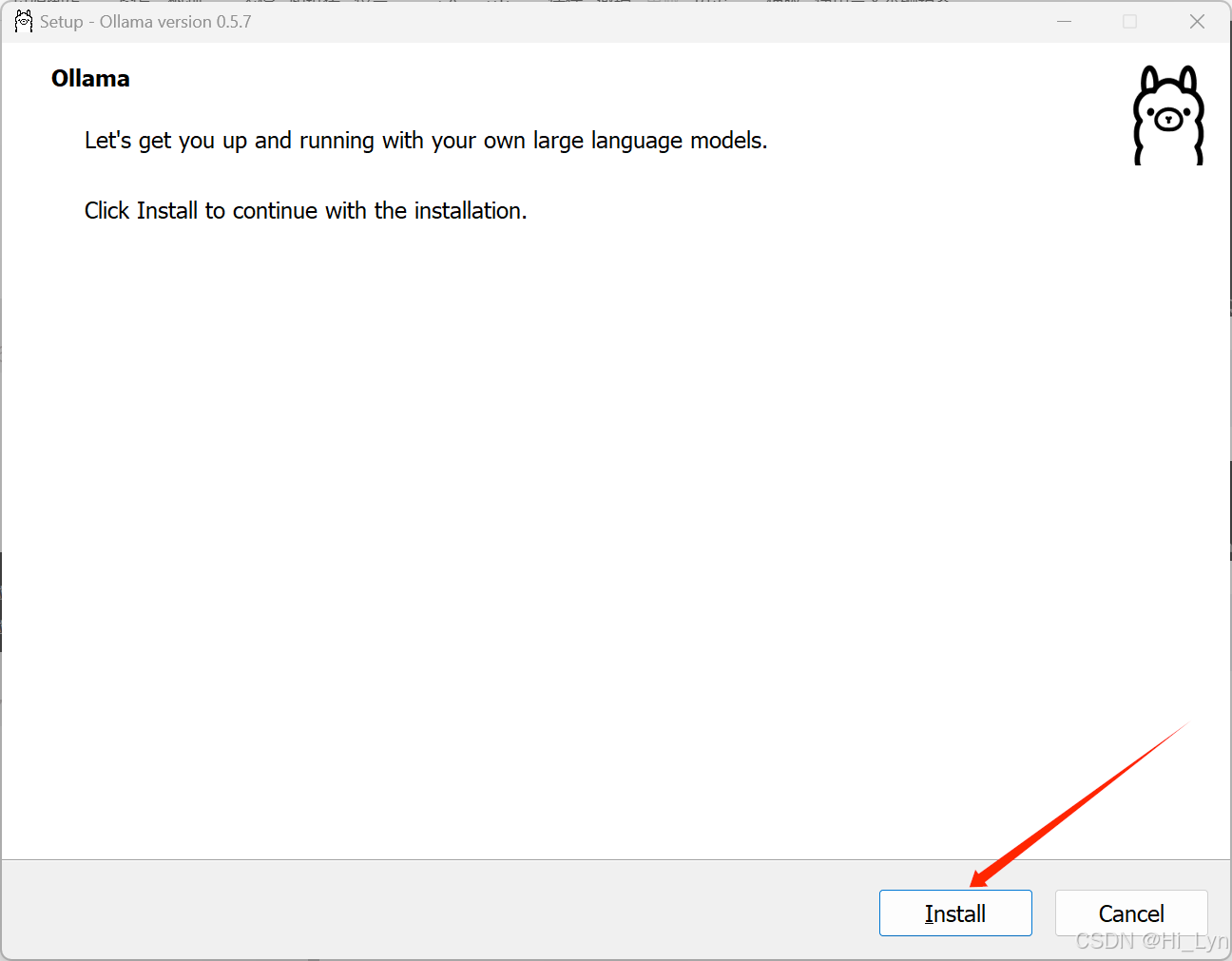

4.双击运行,点击

Insall,接下来就是一直等待,直到它完成

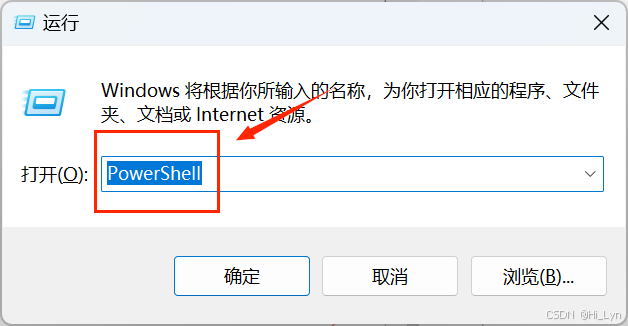

5.安装完成之后,按住

Win+r,输入PowerShell,点击确定

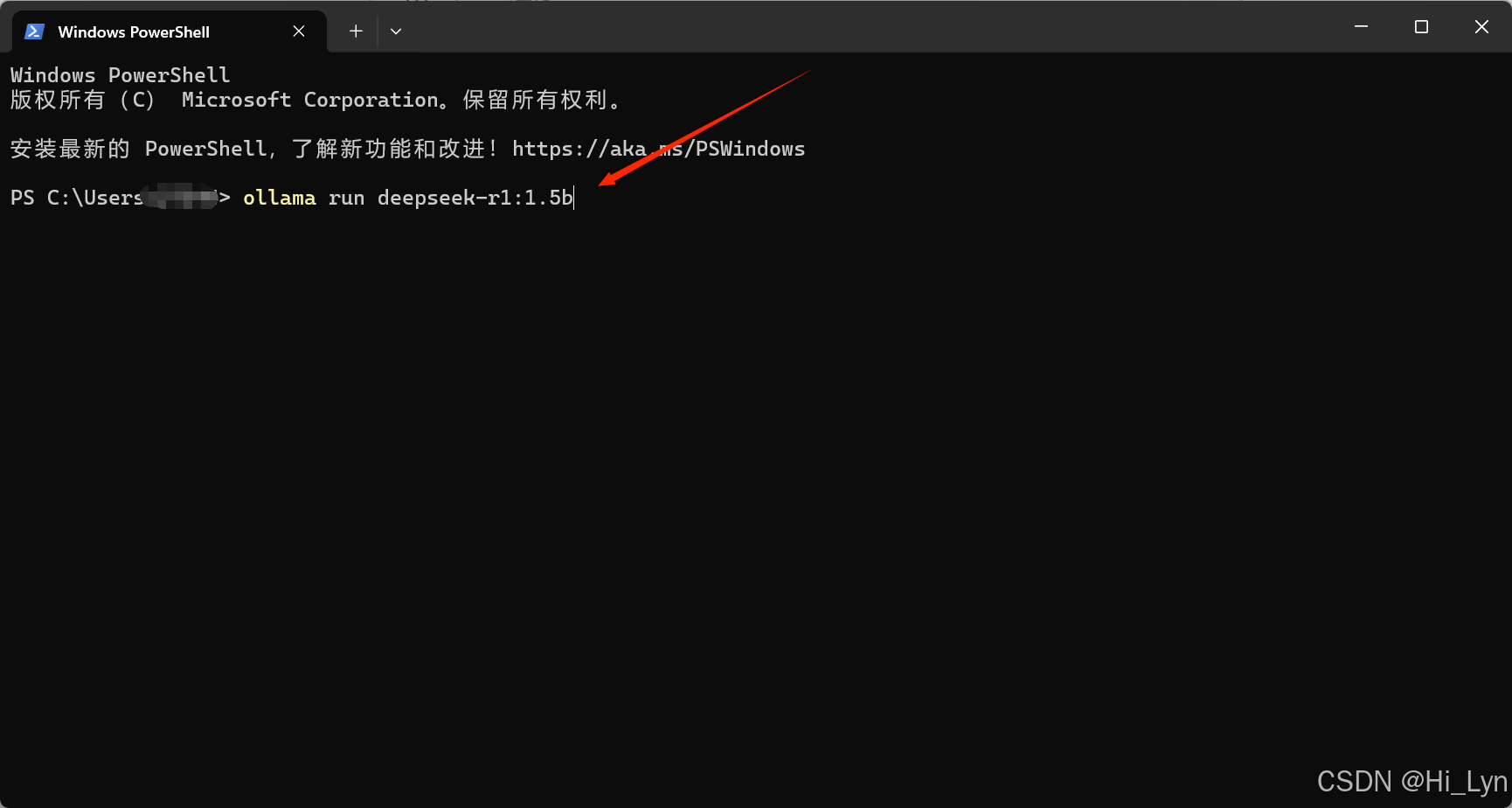

6.然后输入命令

ollama run deepseek-r1:1.5b(这里很容易出错,最好复制我这个命令行然后粘贴!!!最有可能犯的错误就是没用英文符号进行输入,注意,命令行必须全是英文模式下的符号!!!不要有多余的空格!!!)

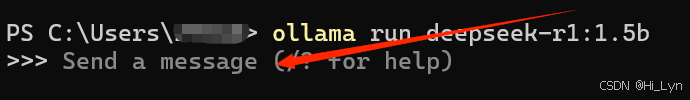

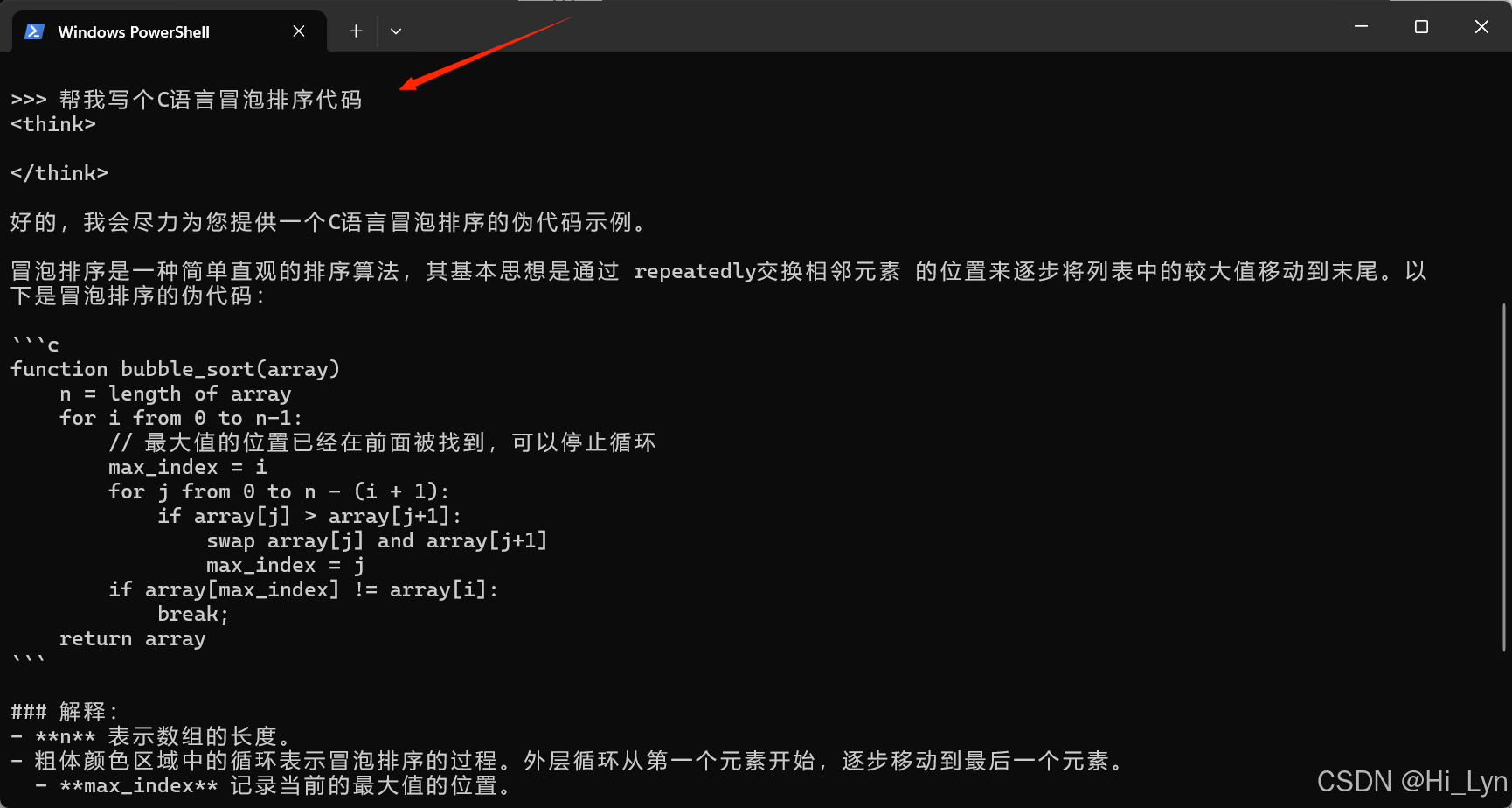

7.等待一段时间后,出现

Send a massage时就说明运行成功,然后就可以输入相应的问题,玩转你的deepseek大模型

8.安装可视化工具:进入Chatbox AI官网,点击免费下载

9.下载完双击安装

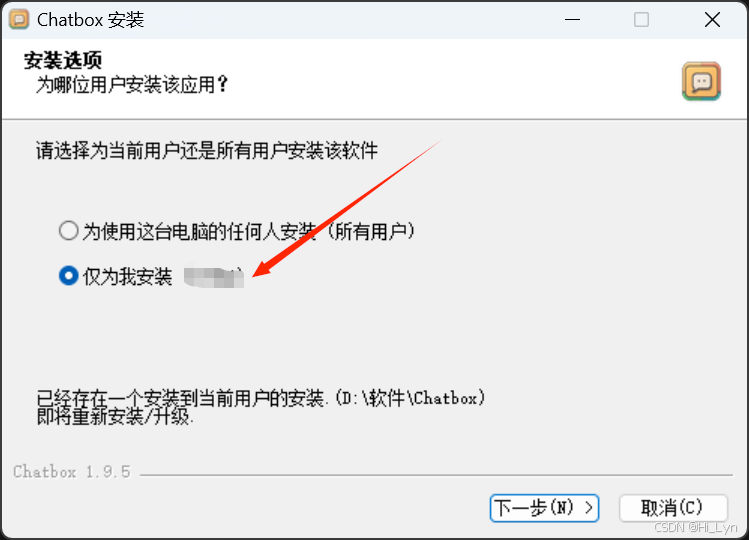

10.点击仅为我安装

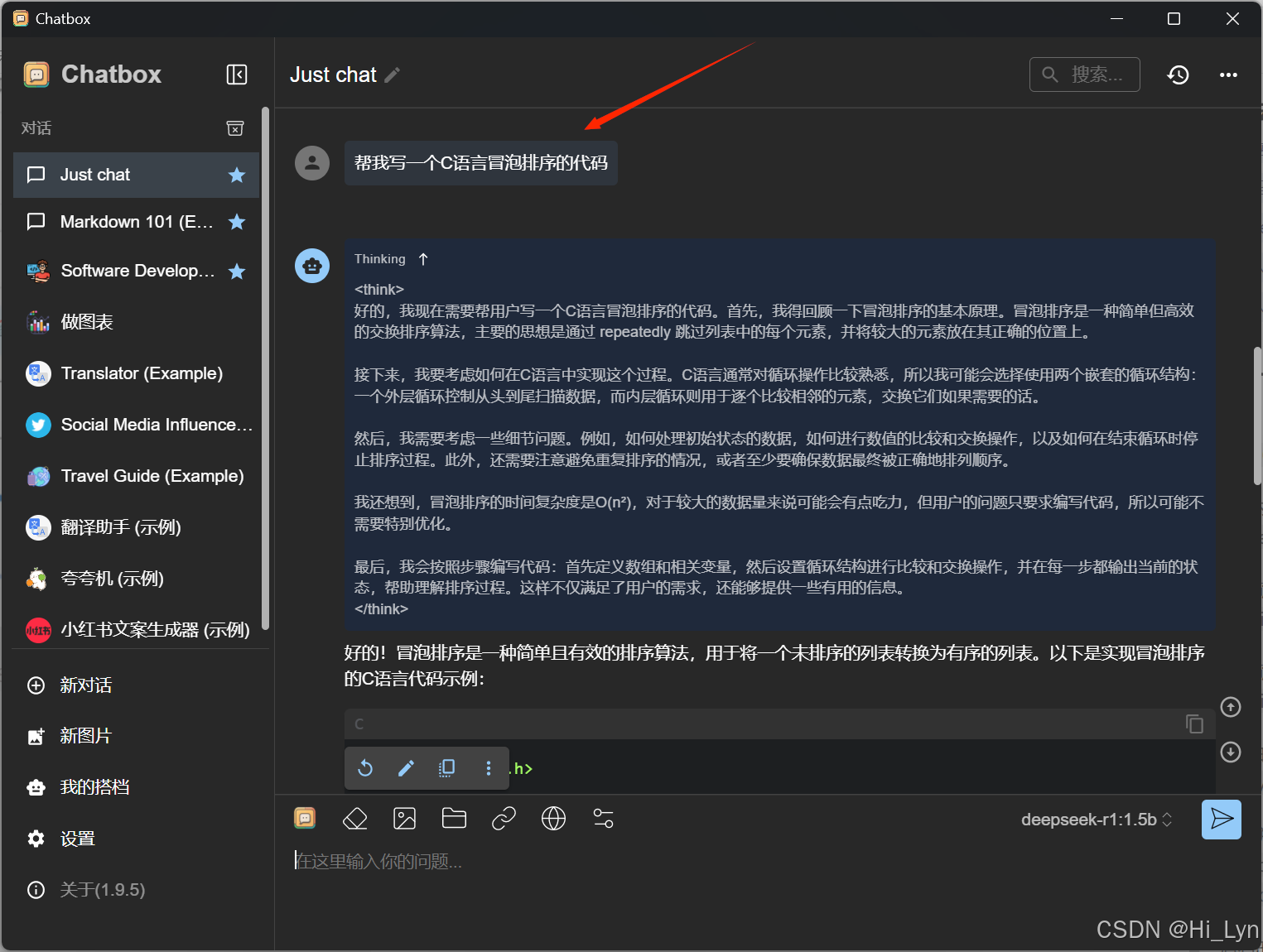

11.安装完成之后会自动运行,选择第二个按钮(使用自己的API Key或本地模型)

12.选择ollama

13.这里会自动跳出本地部署大模型,在模型中选择

deepseek-r1:14b,然后直接保存

14.接下来就可以直接在这里使用deepseek了

至此,就完成了deepseek大模型本地化+可视化的全部操作,怎么样,是不是很简单

3421

3421

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?