一、dropout丢弃法

1、动机

一个好的模型需要对输入数据的扰动鲁棒

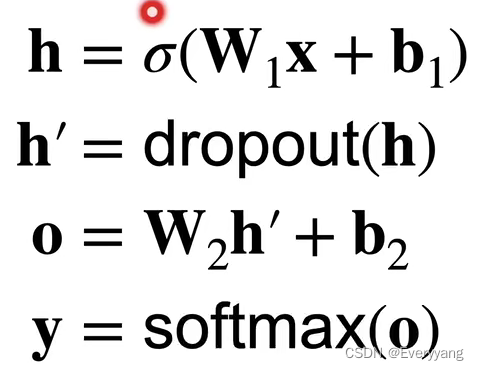

丢弃法:在层之间加入噪音——正则

2、方法

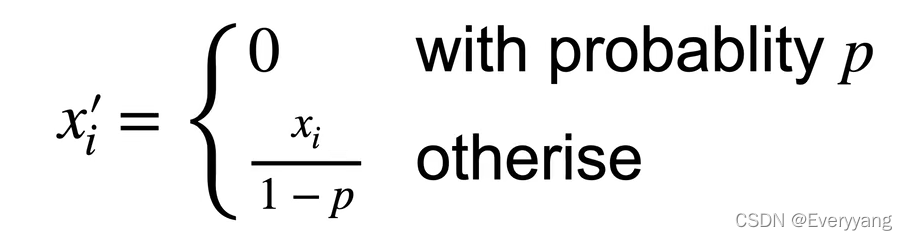

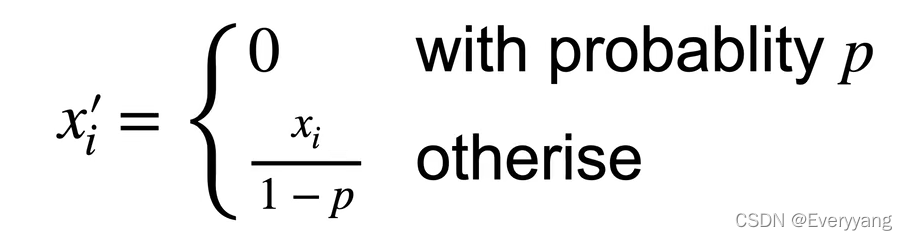

给定一个概率,一定概率变成0,一定概率使得元素变大

期望不发生变化

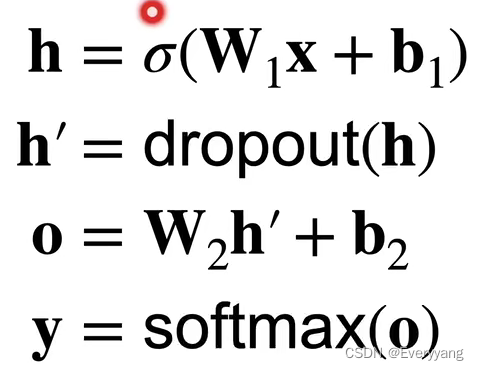

3、使用

4、总结

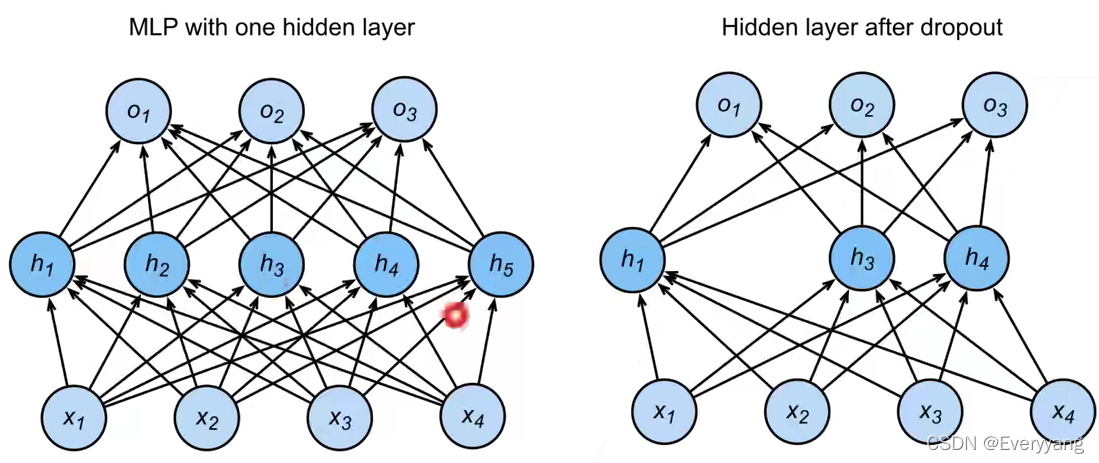

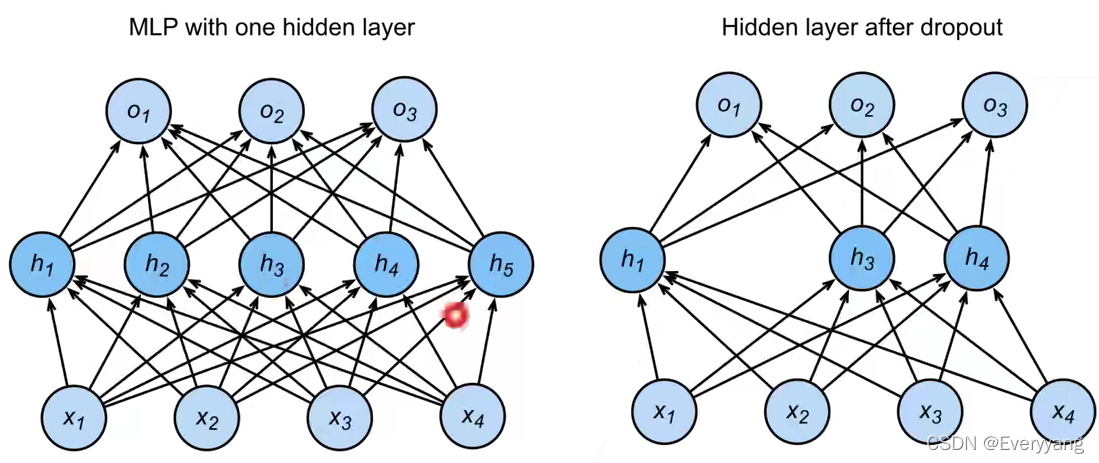

丢弃法将一些输出项随机置0来控制模型复杂度

常作用在多层感知机的隐藏层输出上

丢弃概率来控制模型复杂度的超参数

深度学习正则化技巧:Dropout丢弃法解析

深度学习正则化技巧:Dropout丢弃法解析

丢弃法是一种有效的深度学习正则化策略,旨在提高模型的泛化能力。通过在训练过程中随机关闭一部分神经元,减少层间依赖,防止过拟合。此方法常应用于多层感知机的隐藏层,丢弃概率作为超参数控制模型复杂度。丢弃法的使用可以保持期望输出不变,同时增加模型对输入扰动的鲁棒性。

丢弃法是一种有效的深度学习正则化策略,旨在提高模型的泛化能力。通过在训练过程中随机关闭一部分神经元,减少层间依赖,防止过拟合。此方法常应用于多层感知机的隐藏层,丢弃概率作为超参数控制模型复杂度。丢弃法的使用可以保持期望输出不变,同时增加模型对输入扰动的鲁棒性。

一、dropout丢弃法

1、动机

一个好的模型需要对输入数据的扰动鲁棒

丢弃法:在层之间加入噪音——正则

2、方法

给定一个概率,一定概率变成0,一定概率使得元素变大

期望不发生变化

3、使用

4、总结

丢弃法将一些输出项随机置0来控制模型复杂度

常作用在多层感知机的隐藏层输出上

丢弃概率来控制模型复杂度的超参数

您可能感兴趣的与本文相关的镜像

Facefusion

FaceFusion是全新一代AI换脸工具,无需安装,一键运行,可以完成去遮挡,高清化,卡通脸一键替换,并且Nvidia/AMD等显卡全平台支持

6084

6084

1361

1361

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?