🌐 社群导航

🔗 点击加入➡️【AIGC/LLM/MLLM/3D/自动驾驶】 技术交流群

最新论文解读系列

论文名:StickMotion : Generating 3D Human Motions by Drawing a Stickman

论文链接:https://arxiv.org/pdf/2503.04829

开源代码:暂无

导读

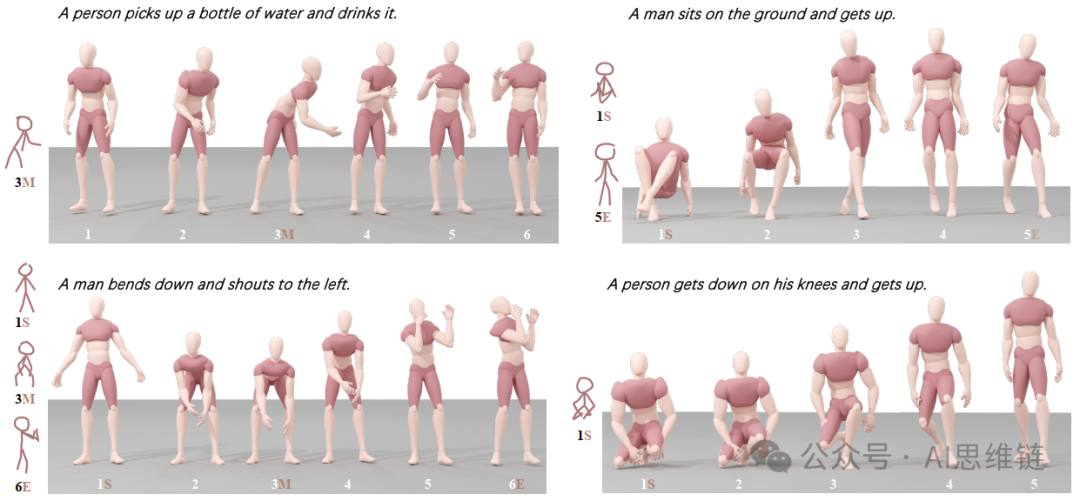

文本到动作生成(Text-to-motion generation)是将文本描述转化为人类动作的技术,它一直面临着从简单文本输入中精准捕捉用户所设想的详细动作的挑战。本文介绍了StickMotion,这是一种专为多条件场景设计的高效基于扩散的网络,它能分别基于传统文本和我们提出的简笔画条件(stickman conditions)生成所需动作,实现对这些动作的全局和局部控制。我们从三个方面应对用户友好型简笔画带来的挑战:1) 数据生成。我们开发了一种算法,可跨不同数据集格式自动生成手绘简笔画。2) 多条件融合。我们提出了一个多条件模块,将其集成到扩散过程中,获取所有可能条件组合的输出,与采用自注意力模块的传统方法相比,降低了计算复杂度并提升了StickMotion的性能。3) 动态监督。我们让StickMotion能够对输出序列中简笔画的位置进行细微调整,通过我们提出的动态监督策略生成更自然的动作。通过定量实验和用户研究,绘制简笔画能为用户节省约的时间,用于生成符合他们想象的动作。我们的代码、演示和相关数据将发布,以促进科学界的进一步研究和验证。

简介

人体运动生成任务在多个不同领域有着广泛的应用,包括影视制作、虚拟现实模拟、游戏行业等等。具体而言,运动生成中热门的子任务——文本到运动任务,可以根据语言描述生成自然的人体运动序列,使动画师 无需手动为3D角色姿态设置关键帧。

方法

概述。StickMotion采用火柴人(stickman)和文本描述作为输入方式。具体而言,用户可以提供四种支持输入的任意组合,包括位于其成像运动序列起点、中间和终点附近的三个火柴人,以及附带的文本描述。例如,用户可以在提供中间火柴人的同时给出文本描述,或者选择起点和终点火柴人而不提供额外的文本信息。此外,StickMotion还允许通过实现扩散过程来控制基于文本或火柴人条件生成运动的倾向。

1. 火柴人表示法

如图1所示,使用火柴人图形避免了在生成所需的人体运动序列时进行大量文本描述的必要性。然而,解决与火柴人图形的生成、编码和应用相关的挑战也至关重要。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?