点击下方卡片,关注“自动驾驶之心”公众号

>>自动驾驶前沿信息获取→自动驾驶之心知识星球

编辑 | 自动驾驶之心

2025年,经历一波组织调整和资源整合后的地平线在自动驾驶领域双线并进:一方面推动新一代辅助驾驶系统 HSD 的大规模量产落地,另一方面通过前沿论文重塑自动驾驶的底层逻辑。随着港股上市后资本加持,这家“智驾芯片先锋”正从技术供应商向行业标准定义者跃迁。

量产方面,全新的 HSD 系统采用创新的 “一段式端到端+强化学习”架构,突破传统感知-决策-控制模块的延迟瓶颈,实现端到输出的轨迹输出方案。同时,地平线在一些前沿工作的探索方面也做出了非常亮眼的贡献,提出了如 GoalFlow、ResAD、DiffusionDrive 等多个极具创新点的方案。

在这篇文章中,自动驾驶之心的原创作者团队花费了不少心思整理了地平线 2025 年的一些创新性工作,今天就带着读者们一起回顾一下。

整体上来说,地平线集中发力在端到端和世界模型两个最热门的方向上,今年并没有铺很多的人力做VLA和VLM。一方面得益于从UniAD时期就积累的大量学术经验,前两年也产出了业内公认的Sparse系列和MapTR系列工作;另一方面地平线今年也将重点铺在了一段式端到端的量产,自动驾驶之心也了解到地平线内部对HSD都很有信心,同时也做了深度的改革,组织执行力提升很大。

技术细节上,地平线在Diffusion、强化学习、GoalFlow、世界模型等领域上颇有建树,未来相信会有更多的自动驾驶和具身智能方面的基石工作问世。

★PS.这里也推荐大家多关注下Xuewu Lin、Bo Jiang、Bencheng Liao和Tianwei Lin几位大佬的相关工作!

更多关于行业的动态、技术交流和求职问答,欢迎加入『自动驾驶之心知识星球』,我们最近丰富了很多模块......

一、端到端自动驾驶

1、ResAD

ResAD: Normalized Residual Trajectory Modeling for End-to-End Autonomous Driving

提出时间:2025.10

提出机构:地平线、武汉大学、华中科技大学

论文链接:https://arxiv.org/pdf/2510.08562

研究背景:端到端自动驾驶系统通过传感器数据直接预测未来轨迹,但面临时空数据不平衡的固有挑战。这种不平衡导致模型学习虚假关联而非因果推理,同时因过度关注不确定的长期预测而忽视即时安全,严重限制了系统的可靠性与安全性。

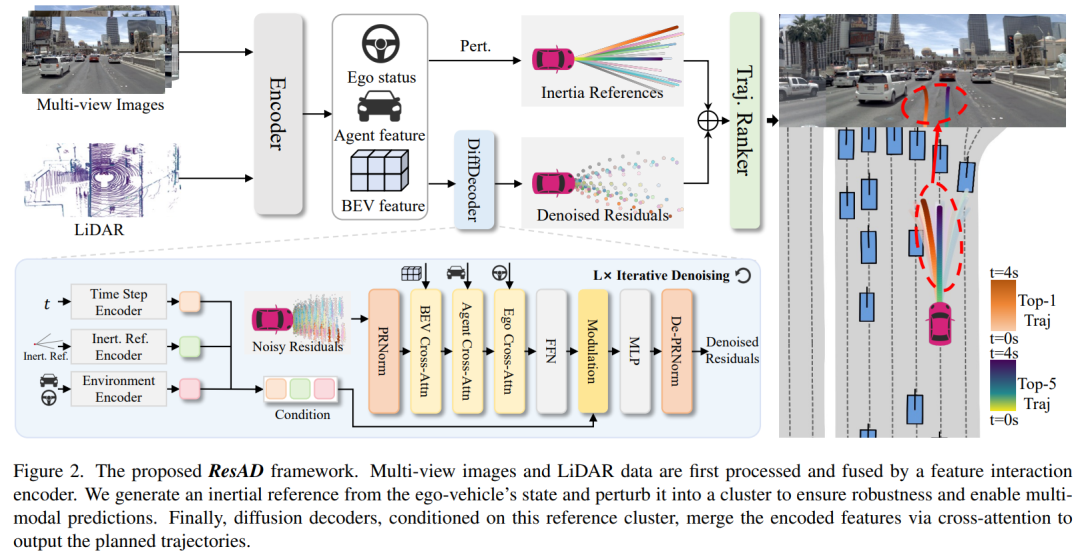

论文内容:提出的 ResAD,一种创新的“归一化残差轨迹建模”框架,从根本上重构了端到端自动驾驶的学习目标。ResAD 不再直接预测未来轨迹,而是将问题分解为两部分:

1. 惯性参考:基于车辆当前状态,通过恒定速度模型推导出一个确定的物理基线轨迹,代表无主动控制时的默认路径。

2. 学习残差:模型仅需预测轨迹相对于该惯性参考的必要偏差。这一转变将学习目标从 “未来的轨迹是什么?” 转变为 “为什么必须偏离默认路径?” ,迫使模型关注如障碍物、交通规则等因果因素,而非表面关联。为解决轨迹点间数值尺度差异导致的优化失衡,论文进一步提出逐点残差归一化,对残差进行缩放,防止远期不确定轨迹点的大幅度误差主导训练过程,确保近期安全关键调整得到充分学习。此外,通过对自车状态施加扰动生成多样化的惯性参考,ResAD 能够自然地产生多模态的合理轨迹,摆脱了对预定义轨迹词汇表的依赖。

在NAVSIM基准测试中,ResAD 仅用两步去噪的简单扩散策略,即以88.6的 PDMS 分数达到了最先进性能,证明了该框架显著简化了学习任务并提升了模型性能。

2、CorDriver

CorDriver: Drive in Corridors: Enhancing the Safety of End-to-end Autonomous Driving via Corridor Learning and Planning

提出时间:2025.04

提出机构:地平线、复旦大学

论文链接:https://arxiv.org/pdf/2504.07507v1

研究背景:端到端自动驾驶系统虽在可扩展性和适应性方面表现出潜力,但由于缺乏显式的行为安全约束,其决策过程往往缺乏可解释性,存在安全隐患。现有方法多通过代价函数或后优化来提升安全性,但效果有限。为此,本文引入机器人领域中广泛使用的“安全走廊”作为中间表示,以在复杂交通场景中显式地定义车辆的安全通行区域。

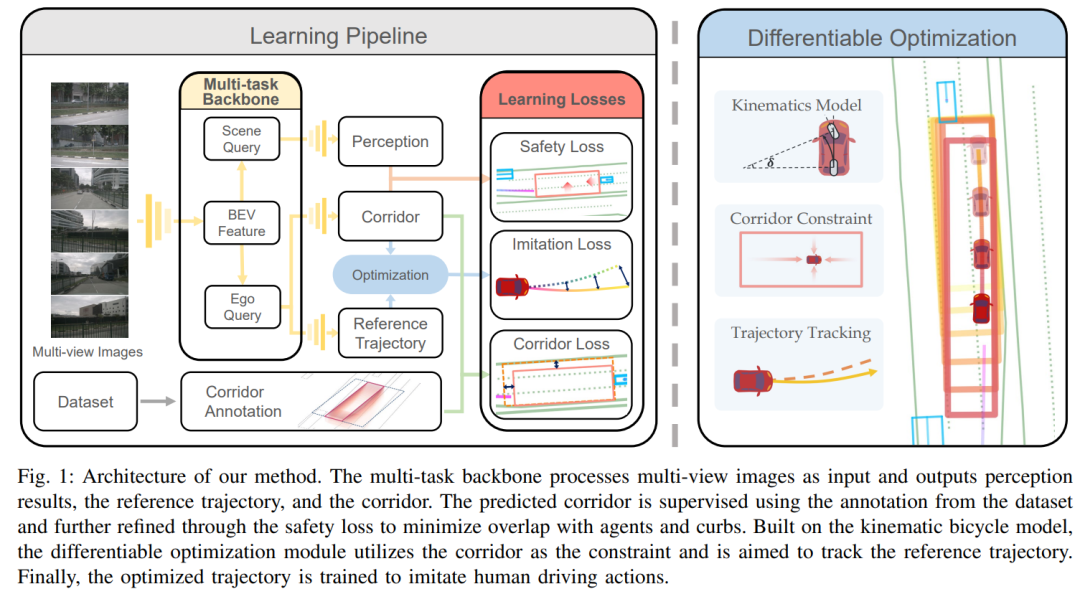

论文内容:提出 CorDriver,一种基于走廊学习与规划的端到端自动驾驶框架,旨在通过显式、可微的安全约束提升系统安全性。其核心包括:

1. 走廊表示与标注:将安全区域表示为时序矩形序列,通过最大空矩形算法在鸟瞰图上自动标注,涵盖车辆、路缘和车道等障碍物。

2. 走廊学习模块:在VAD多任务框架上增加走廊预测头,使用L1损失进行监督,并引入三类辅助损失:a. 安全损失:防止走廊与障碍物重叠;b. 面积损失:鼓励走廊尽可能大;c. 后处理细化:基于感知结果进一步优化走廊。

3. 可微轨迹优化:将预测的走廊作为约束,构建基于自行车模型的二次规划问题,生成满足动力学与安全约束的轨迹。通过KKT条件的隐式微分实现梯度反向传播,使优化过程可嵌入端到端训练。

实验表明,CorDriver在nuScenes数据集上相比VAD等方法,与交通参与者的碰撞率降低66.7%,与路缘的碰撞率降低46.5%,并在闭环测试中取得更高的成功率。尽管优化过程带来一定的轨迹精度损失,但在安全性与可解释性方面显著提升,为端到端系统引入显式约束提供了新思路。

3、TTOG

TTOG: Two Tasks, One Goal: Uniting Motion and Planning for Excellent End To End Autonomous Driving Performance

提出时间:2025.04

提出机构:地平线、北京交通大学、清华大学、昆士兰大学

论文链接:https://arxiv.org/pdf/2504.12667v1

研究背景:当前端到端自动驾驶方法通常将规划与运动预测任务解耦,导致规划模块无法从运动数据中学习到分布外场景的泛化能力。同时,由于自车与他车观测视角不一致、他车状态信息缺失等问题,直接统一这两个任务面临数据视角不一致和模态缺失的挑战。

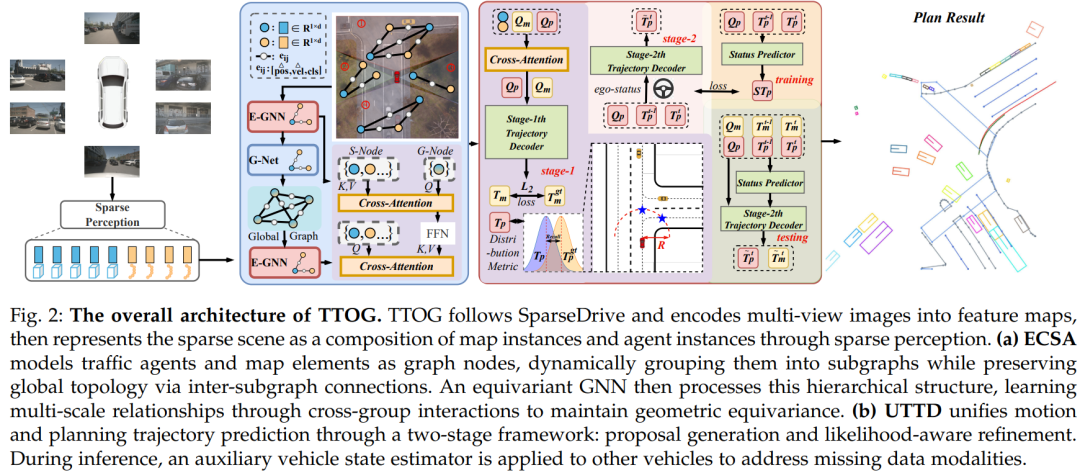

论文内容:提出 TTOG,一个新颖的两阶段轨迹生成框架,旨在统一运动预测与路径规划任务,使规划任务能够从他车的运动数据中学习,增强泛化能力与少样本性能。TTOG 的核心包括两大模块:

1. 等变上下文共享场景适配器(ECSA):该模块构建一个层次化图结构,通过等变图神经网络(E-GNN) 和集合注意力机制,提取旋转和平移不变的场景特征。ECSA 将自车与他车的观测统一到一致的几何空间中,有效解决了多智能体视角差异问题。

2. 统一两阶段轨迹解码器(UTTD):轨迹生成分为两个阶段:轨迹提议生成阶段:生成多样化的轨迹候选,不区分自车与他车,统一进行多模态轨迹预测;轨迹筛选与优化阶段:结合自车状态信息对候选轨迹进行精细化调整,输出最终规划路径。

为解决他车状态缺失问题,TTOG 训练了一个自车状态估计器,在推理阶段泛化应用于他车,实现运动与规划任务的参数共享。

在 nuScenes 和 Bench2Drive 数据集上的实验表明,TTOG 在开环和闭环测试中均取得最优性能:在 nuScenes 上平均 L2 误差降低 36.06%,在 Bench2Drive 上驾驶分数提升 22%,尤其在少样本场景下表现出强大的泛化能力。TTOG 的成功标志着端到端自动驾驶从“任务分离”向“任务统一”迈出了关键一步。

4、MomAD

(CVPR2025) MomAD: Don’t Shake the Wheel: Momentum-Aware Planning in End-to-End Autonomous Driving

提出时间:2025.03

提出机构:地平线、北京交通大学、澳门大学、清华大学、昆士兰大学、香港大学

论文链接:https://arxiv.org/pdf/2503.03125

研究背景:端到端自动驾驶框架实现了感知与规划的无缝集成,但传统方法多依赖单帧的轨迹预测,容易因遮挡或感知噪声导致控制不稳定、轨迹不一致。尤其在复杂动态环境中,缺乏对历史轨迹的考虑,使得多模态轨迹规划方法难以保证时间连续性和驾驶平稳性,存在安全隐患。

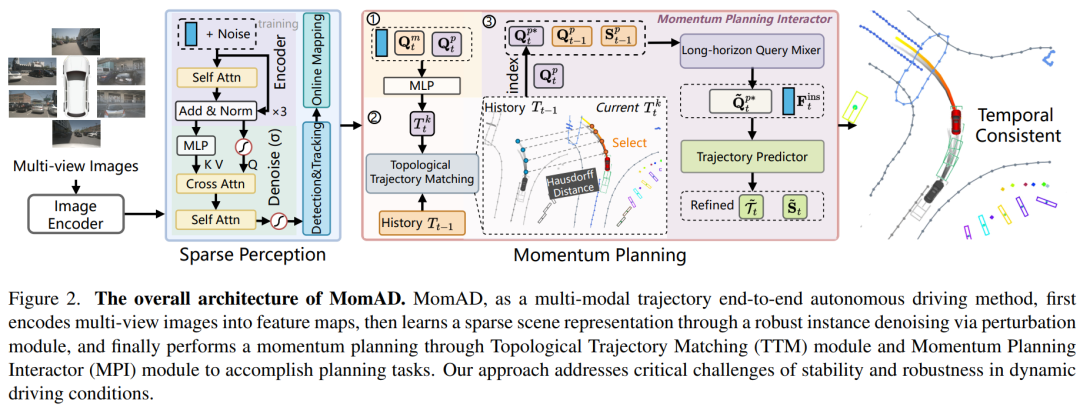

论文内容:提出了一种名为 MomAD(Momentum-Aware Driving) 的端到端自动驾驶框架,旨在解决现有方法在轨迹预测中的时间不一致性和稳定性问题。MomAD 引入了两种“动量”机制:轨迹动量 通过历史轨迹对齐当前预测,确保路径连贯;感知动量 则利用历史上下文信息扩展当前感知范围,增强对动态环境的理解。框架包含两个核心模块:

1. 拓扑轨迹匹配(TTM):使用 Hausdorff 距离从多模态轨迹中选择与历史路径最一致的一条,避免轨迹突变。

2. 动量规划交互器(MPI):通过交叉注意力机制融合当前规划查询与历史查询,增强对长期时空上下文的理解,提升轨迹生成的鲁棒性。

此外,文中还提出一种新的评估指标 TPC(Trajectory Prediction Consistency),用于量化轨迹预测的一致性。实验表明,MomAD 在 nuScenes 和自建的 Turning-nuScenes 数据集上均优于现有方法,尤其在长时预测(≥3秒)和转弯场景中,碰撞率显著降低,轨迹平滑性和一致性显著提升。

5、GoalFlow

(CVPR2025) GoalFlow: Goal-Driven Flow Matching for Multimodal Trajectories Generation in End-to-End Autonomous Driving

提出时间:2025.03

提出机构:地平线、华中科技大学、南京大学、中国科学院大学、上海人工智能实验室

论文链接:https://arxiv.org/pdf/2503.05689v1

研究背景:当前端到端自动驾驶系统在生成多模态轨迹时面临轨迹发散、引导信息不准确等挑战,导致轨迹质量下降和选择困难。传统方法要么依赖离散导航指令缺乏精度,要么使用无约束扩散模型产生高度发散的结果,难以在保证多样性的同时维持轨迹的精确性与安全性。

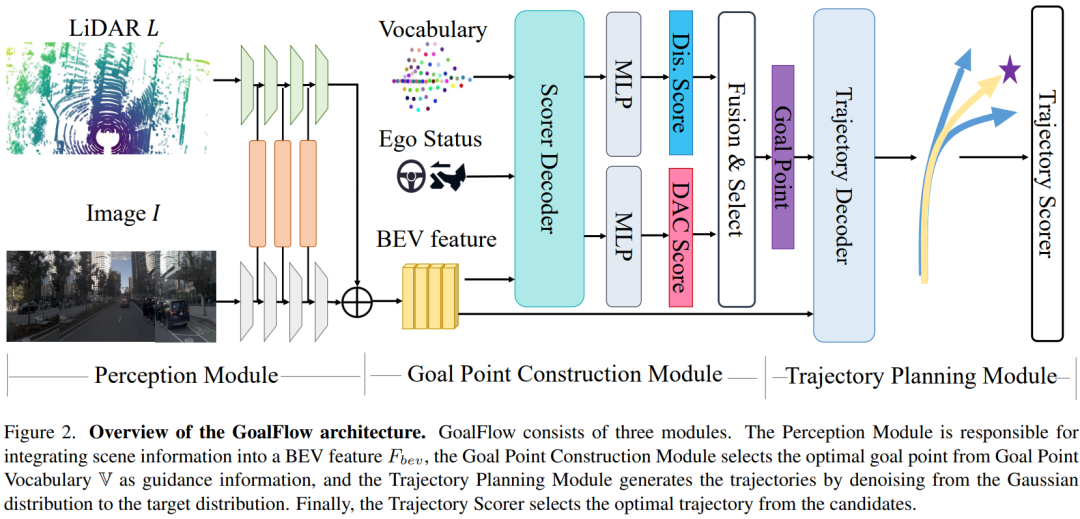

论文内容:提出GoalFlow,一种目标驱动的流匹配框架,用于在端到端自动驾驶中生成高质量的多模态轨迹。其核心思想是通过精确的目标点引导来约束生成过程,显著提升轨迹的准确性与安全性。该方法包含三个关键模块**:

1. 目标点构建模块通过聚类训练集中的轨迹终点构建一个包含数千个候选点的目标点词库。设计了一个双评分机制,综合评估每个目标点与真实终点的距离得分及其是否处于可行驶区域内的合规性得分,从而选出最优目标点作为强引导信号。

2. 轨迹规划模块:采用流匹配(Flow Matching),特别是修正流(Rectified Flow) 方法进行轨迹生成。该方法通过建立从噪声分布到真实轨迹分布的直线路径,实现了高效、稳定的分布转换。模型以BEV特征和选定的目标点为条件,生成多样化的轨迹候选集。

3. 轨迹选择机制: 设计了一个轻量级的轨迹评分器,根据轨迹与目标点的接近程度和自车进度进行权衡,选出最优轨迹。此外,引入“影子轨迹”概念来检验目标点的可靠性,若目标点存在偏差则启用备用方案,进一步增强了系统的鲁棒性。

在 NavSim 基准测试上的实验表明,GoalFlow 取得了最先进的性能,PDMS 分数达到 90.3,尤其在可行驶区域合规性(DAC) 和自我进度(EP) 指标上优势显著。更重要的是,得益于流匹配的高效性,该方法仅需单步去噪即可达到优异性能,推理速度比传统扩散模型快数十倍,展现了强大的实际部署潜力。GoalFlow 成功地将生成模型的多样性与目标点的精确引导相结合,为自动驾驶的可靠决策提供了新范式。

6、RAD

(NeurIPS 2025)RAD: Training an End-to-End Driving Policy via Large-Scale 3DGS-based Reinforcement Learning

提出时间:2025.02

提出机构:地平线、华中科技大学

论文链接:https://arxiv.org/pdf/2502.13144

研究背景:现有端到端自动驾驶方法多采用模仿学习,但面临因果混淆和开环训练与闭环部署间的差距两大挑战。模仿学习难以学习真实的因果关系,对安全关键事件不敏感,且在闭环中因误差累积容易失效。强化学习能通过试错学习因果并适应分布外场景,但缺乏安全、逼真且高效的训练环境。

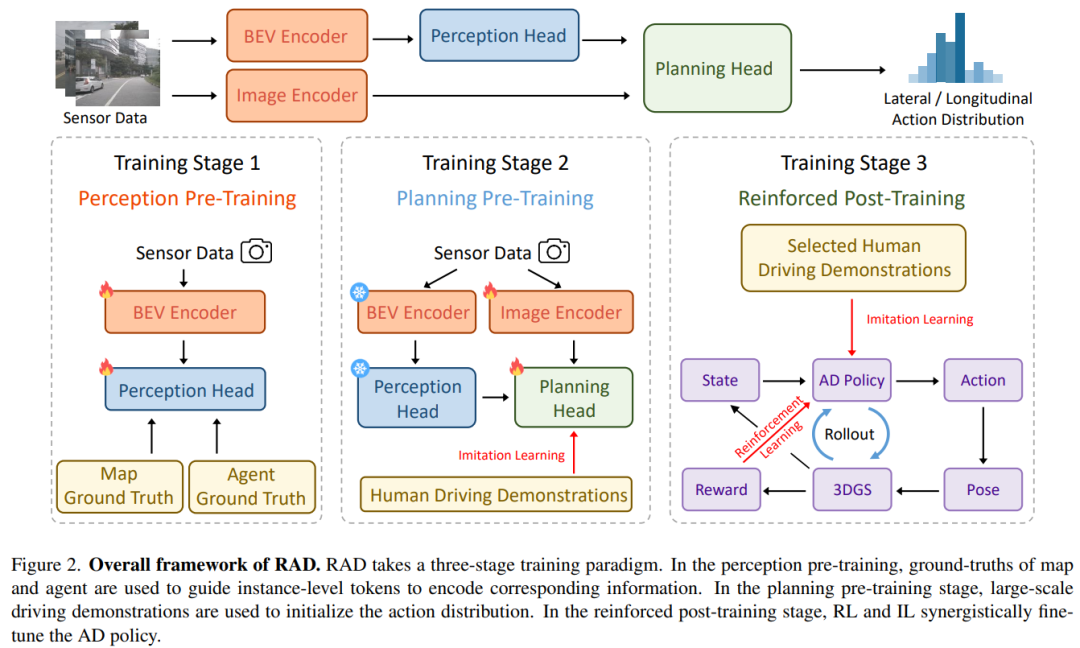

论文内容:提出了 RAD,一个基于3D高斯泼溅的强化学习框架,用于训练端到端自动驾驶策略。核心思想是利用3DGS技术构建高真实感的数字世界副本,使策略能在此环境中进行大规模闭环试错,从而学习处理复杂和分布外场景。RAD采用三阶段训练范式:

1. 感知预训练:使用真实标注训练BEV编码器、地图头和智能体头,获取高层场景表示。

2. 规划预训练:通过模仿学习,利用人类驾驶演示数据初始化策略的动作分布,为RL提供稳定的起点。

3. 强化后训练:RL与IL协同优化策略。RL通过专门设计的奖励函数(包括动态碰撞、静态碰撞、位置偏差和航向偏差)来提升安全性;IL则作为正则项,确保策略行为与人类驾驶对齐,保持平滑性。

为解决RL训练挑战,RAD设计了解耦的离散动作空间以降低探索难度,并引入了稠密的辅助目标来加速收敛。实验表明,在构建的3DGS闭环评估基准上,RAD相比纯IL方法在多数指标上表现更优,尤其碰撞率降低了3倍,显著提升了驾驶安全性。

7、DiffusionDrive

(CVPR2025) DiffusionDrive: Truncated Diffusion Model for End-to-End Autonomous Driving

提出时间:2024.11

提出机构:地平线、华中科技大学

论文链接: https://arxiv.org/pdf/2411.15139

研究背景:现有的端到端自动驾驶规划器多采用单模态轨迹回归,无法有效处理驾驶行为中固有的不确定性和多模态特性。虽然VADv2等方法引入大规模固定锚点轨迹来离散化动作空间,但其性能受限于锚点数量与质量,且计算开销大,难以适应开放世界的动态交通场景。扩散模型在机器人策略学习中展现出强大的多模态建模能力,但其在自动驾驶中直接应用面临去噪步骤多、实时性差、轨迹多样性不足等挑战。

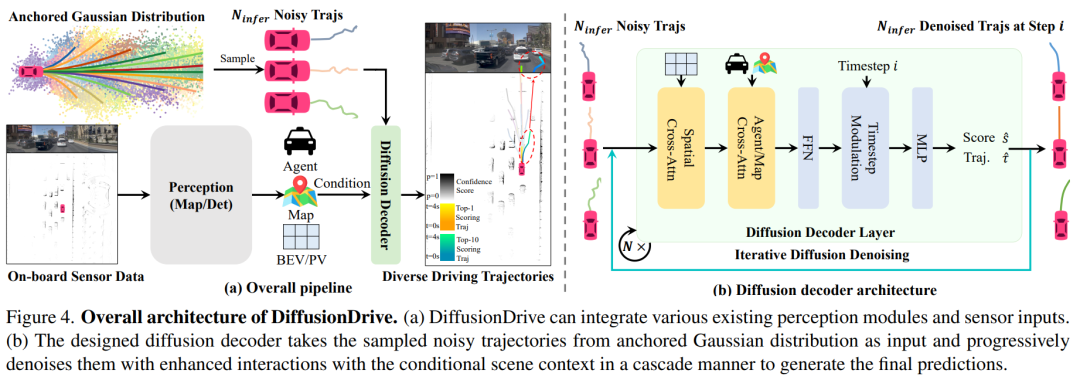

论文内容:提出 DiffusionDrive,一种基于截断扩散策略 的实时端到端自动驾驶生成模型,核心创新包括:

1. 截断扩散策略:针对驾驶行为具有先验模式的特点,提出从“锚定高斯分布”而非纯高斯噪声开始去噪。该分布通过对少量聚类锚点轨迹添加微量噪声构建,使模型在训练中学习从该分布到真实驾驶策略的映射,从而在推理时仅需 2步去噪(相比原版20步提升10×速度),实现45 FPS的实时性能。

2. 高效级联扩散解码器:设计基于Transformer的解码器,通过可变形注意力机制与BEV/PV特征、智能体/地图查询进行多层次交互,并引入级联机制在每一步迭代优化轨迹重建,增强场景上下文感知能力。

3. 灵活推理机制:支持在推理时动态调整采样轨迹数量,平衡计算资源与场景复杂度。

实验表明,DiffusionDrive在NAVSIM数据集上以ResNet-34骨干网络取得 88.1 PDMS,刷新记录,并在nuScenes上以相同骨干网络比VAD降低20.8% L2误差和63.6%碰撞率,显示出卓越的规划质量和多模态轨迹生成能力,能灵活应对直行、转向、超车等复杂场景。

二、自动驾驶场景生成&世界模型

1、Epona

(ICCV2025) Epona: Autoregressive Diffusion World Model for Autonomous Driving

提出时间:2025.06

提出机构:地平线、清华大学、北京大学、南京大学、香港科技大学、南洋理工大学、腾讯混元

论文链接:https://arxiv.org/pdf/2506.24113

研究背景:现有的自动驾驶世界模型主要分为扩散模型和GPT风格自回归模型两类。扩散模型虽生成质量高,但难以支持变长序列预测和轨迹规划;GPT类模型虽支持长序列生成,但因离散化表示导致视觉质量下降,且难以进行长时程轨迹规划。两者各有优劣,亟需一种能兼顾高视觉质量、长时程生成与精准轨迹规划的统一框架。

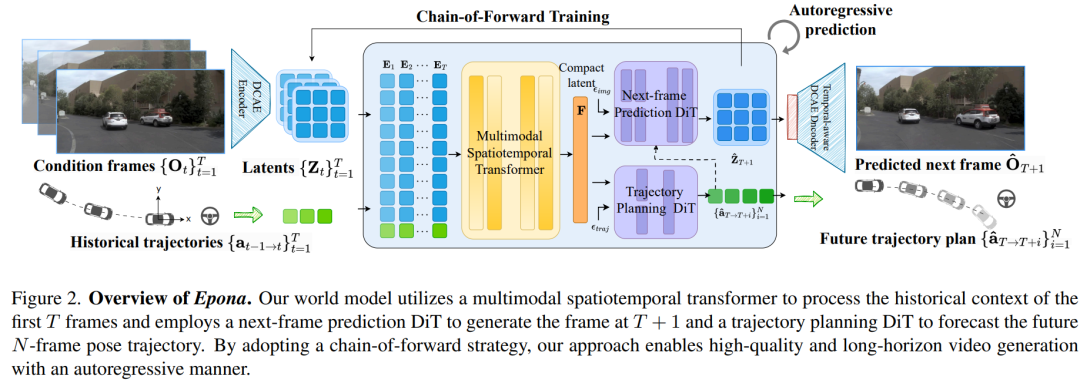

论文内容:提出了 Epona,一种用于自动驾驶的自回归扩散世界模型,旨在实现高分辨率、长时程的未来场景生成与轨迹规划。Epona 的核心创新包括:

1. 解耦的时空建模:将时间动态建模与空间细节生成分离。使用因果Transformer处理时间动态,再通过两个独立的扩散Transformer分别生成轨迹和下一帧图像。

2. 异步多模态生成:轨迹规划与视觉生成并行进行,共享同一时间潜在表示,确保多模态对齐又各自优化。

3. 链式前向训练策略:通过模拟推理阶段的误差,缓解自回归生成中的错误累积和内容漂移问题,显著提升长序列生成质量。此外,Epona 还引入了时序感知的深度压缩自编码器,减少视频闪烁,提升生成流畅度。

实验表明,Epona 在 NuScenes 数据集上取得了最佳的 FVD 指标,并将最长生成时长从现有方法的15秒大幅提升至2分钟。同时,其轨迹规划模块在 NAVSIM 基准测试中表现优异,无需感知输入即可实现实时规划,展现出强大的世界理解与决策能力。

2、UMGen

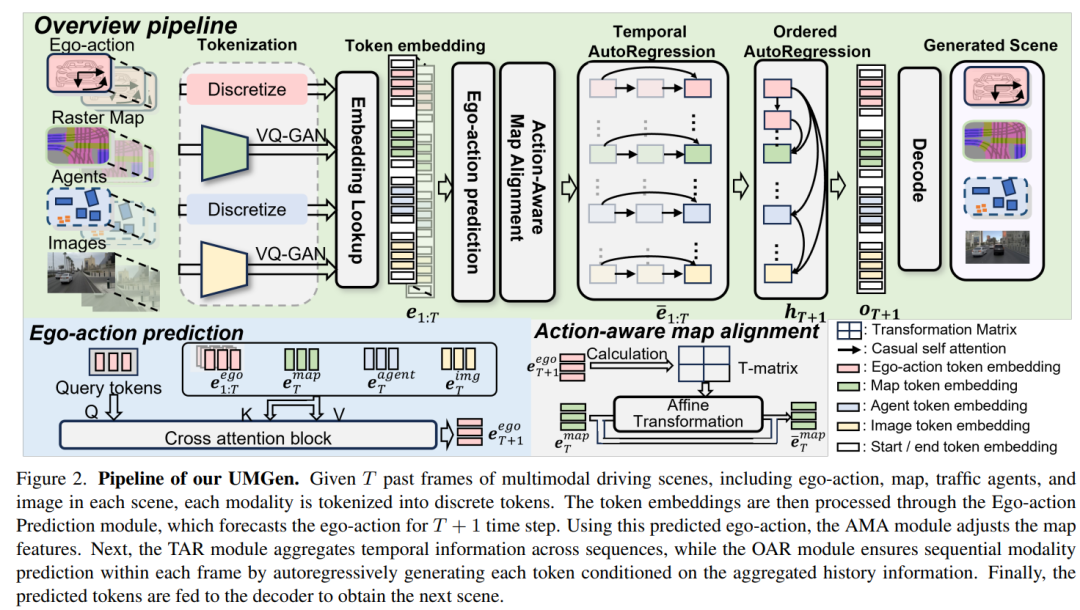

UMGen: Generating Multimodal Driving Scenes via Next-Scene Prediction

提出时间:2025.03

提出机构:地平线、西安交通大学、洛桑联邦理工学院、中国科学院大学

论文链接:https://arxiv.org/pdf/2503.14945

研究背景:自动驾驶系统中,生成模型可用于创建多样化的驾驶场景,尤其是罕见或数据集中未充分覆盖的场景,从而在部署前对系统进行安全、全面的测试。然而,现有方法大多仅能生成有限的模态(如轨迹或图像),缺乏对地图动态演变和多模态一致性的建模,限制了生成场景的真实性和可控性。

论文内容:提出了一种统一多模态驾驶场景生成框架 UMGen,能够同时生成四种关键模态:自车动作、交通参与者、交通地图和图像。为解决多模态数据的高维性和时序一致性问题,UMGen采用两阶段自回归生成机制:

1. 时序自回归(TAR)模块:捕捉跨帧的动态变化,通过因果注意力机制建模时间依赖性,显著降低计算复杂度。

2. 有序自回归(OAR)模块:在每一帧内按固定顺序(自车→地图→交通参与者→图像)生成各模态令牌,确保模态间的一致性。

3. 动作感知地图对齐(AMA)模块:根据自车动作对地图特征进行仿射变换,保持地图与自车运动之间的空间对齐。

实验表明,UMGen能生成长达60秒的多样化、多模态一致的驾驶场景,支持用户通过控制自车或其他交通参与者的行为生成特定场景(如切入、紧急制动等)。在nuPlan和Waymo数据集上的评估显示,UMGen在生成真实性和可控性方面优于现有方法,并具备更高的计算效率。

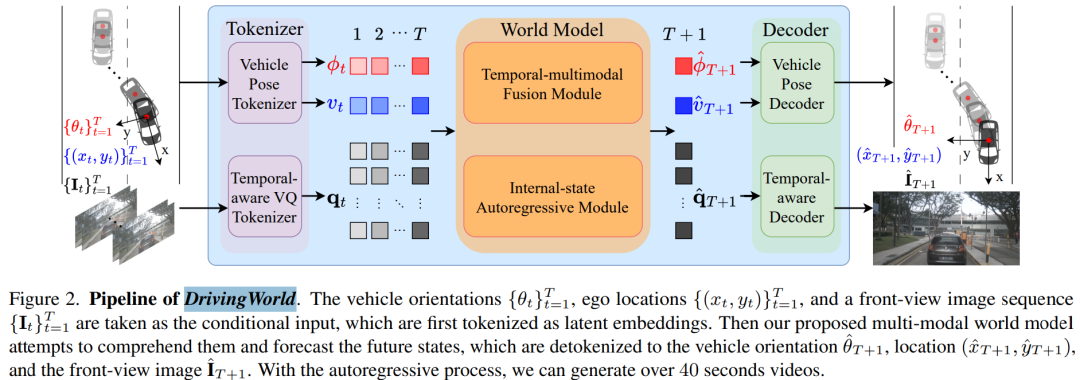

3、DrivingWorld

DrivingWorld: Constructing World Model for Autonomous Driving via Video GPT

提出时间:2024.12

提出机构:地平线、香港科技大学

论文链接: https://arxiv.org/pdf/2412.19505

研究背景:自回归生成模型(如GPT系列)在自然语言处理中取得成功,但其直接应用于视频生成存在挑战。传统GPT框架专为处理1D上下文设计,缺乏对视频中空间与时间动态的建模能力,导致生成视频质量低、时序不一致。现有自动驾驶世界模型(如GAIA-1)在生成长时序视频时易出现漂移和失真,难以实现高保真、可控的长期预测。

论文内容:提出 DrivingWorld,一种基于GPT风格视频生成框架的自动驾驶世界模型,旨在实现长时序、高保真、可控的未来视频与车辆状态预测。其核心创新包括:

1. 时序感知标记化:设计一种时序感知的VQ标记器,通过在量化前后引入时序自注意力层,增强帧间一致性,将图像、车辆位姿统一编码为离散标记。

2. 混合预测策略:下一状态预测:先通过时序-多模态融合模块预测下一帧的全局状态特征,解耦时空建模,提升效率;内部状态自回归预测:再通过内部自回归模块逐token生成高质量图像与位姿细节,提升生成质量。

3. 长时序可控生成机制:随机标记丢弃:在训练中随机掩盖部分真实标记,模拟推理误差,缓解自回归过程中的内容漂移问题;平衡注意力机制:增强位姿标记在注意力中的权重,提升对车辆运动的控制精度。

实验表明,DrivingWorld在仅使用15帧条件输入的情况下,可生成超过40秒(640帧) 的高保真视频,时长是现有最佳模型的2倍以上。在NuScenes零样本测试中,其FVD与FID指标与最先进方法Vista相当,并在长时序生成中展现出更强的时空一致性与结构保持能力。

三、自动驾驶VLM&VLA

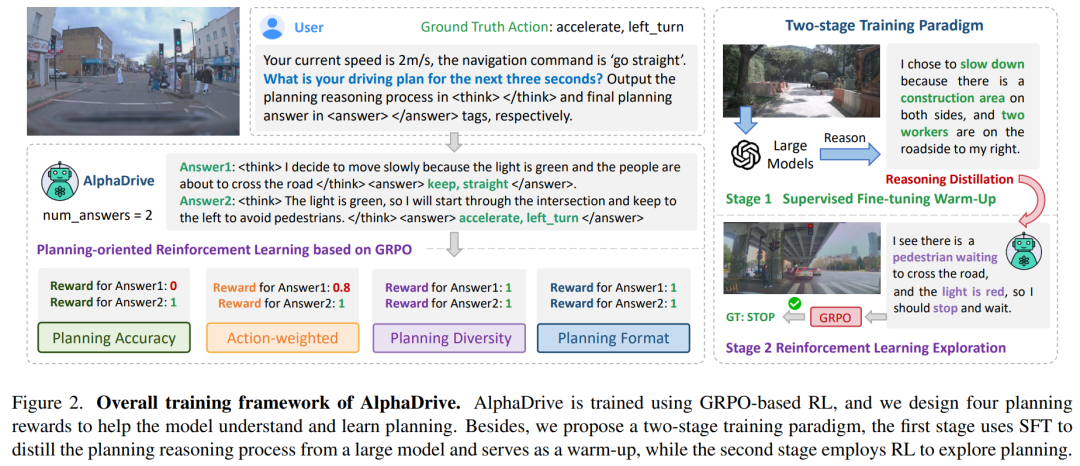

1、AlphaDrive

AlphaDrive: Unleashing the Power of VLMs in Autonomous Driving via Reinforcement Learning and Reasoning

提出时间:2025.03

提出机构:地平线、华中科技大学

论文链接:https://arxiv.org/pdf/2503.07608

研究背景:现有端到端自动驾驶模型虽在规划性能上取得进展,但受限于常识与推理能力不足,难以处理复杂长尾场景。视觉语言模型具备强大的常识与推理能力,有望弥补此短板。然而,现有研究多仅对VLM进行监督微调,未深入探索适用于规划任务的强化学习与推理训练策略,限制了其性能上限与训练效率。

论文内容:提出了 AlphaDrive,一个首次将基于GRPO的强化学习与规划推理相结合,专门用于自动驾驶高层规划的VLM框架。针对规划任务的特点(如不同驾驶行为重要性不同、解不唯一、缺乏现成推理数据),AlphaDrive的核心创新包括:

1. 规划导向的强化学习:设计了四种基于GRPO的奖励函数:a. 规划准确率奖励:使用F1分数分别评估横向和纵向决策的准确性。b. 动作加权奖励:为关键安全行为(如刹车、转向)分配更高权重。c. 规划多样性奖励:鼓励模型生成多种可行方案,避免模式坍塌。d. 规划格式奖励:规范输出格式,确保结果可解析,提升训练稳定性。

2. 两阶段推理训练策略:第一阶段(SFT预热):利用大模型生成高质量规划推理数据,通过知识蒸馏让小模型学习推理过程,有效缓解RL初期的幻觉与不稳定。 第二阶段(RL探索):使用全量数据,结合上述四种奖励进行GRPO训练,进一步优化策略。

实验表明,AlphaDrive在规划准确率上比仅用SFT的模型显著提升25.52%。更值得注意的是,它展现出高效的数据利用能力,仅用20%的训练数据即可超越SFT基线模型35.31%。此外,经过RL训练后,AlphaDrive涌现出多模态规划能力,能针对复杂场景生成多个合理方案,这对提升驾驶安全性与效率至关重要。

自动驾驶之心

论文辅导来啦

自驾交流群来啦!

自动驾驶之心创建了近百个技术交流群,涉及大模型、VLA、端到端、数据闭环、自动标注、BEV、Occupancy、多模态融合感知、传感器标定、3DGS、世界模型、在线地图、轨迹预测、规划控制等方向!欢迎添加小助理微信邀请进群。

知识星球交流社区

近4000人的交流社区,近300+自动驾驶公司与科研结构加入!涉及30+自动驾驶技术栈学习路线,从0到一带你入门自动驾驶感知(大模型、端到端自动驾驶、世界模型、仿真闭环、3D检测、车道线、BEV感知、Occupancy、多传感器融合、多传感器标定、目标跟踪)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、大模型,更有行业动态和岗位发布!欢迎加入。

独家专业课程

端到端自动驾驶、大模型、VLA、仿真测试、自动驾驶C++、BEV感知、BEV模型部署、BEV目标跟踪、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、车道线检测、轨迹预测、在线高精地图、世界模型、点云3D目标检测、目标跟踪、Occupancy、CUDA与TensorRT模型部署、大模型与自动驾驶、NeRF、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频

学习官网:www.zdjszx.com

276

276

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?