在人工智能领域,大模型的本地部署是一个关键步骤,它能够让用户在自己的服务器上运行大型语言模型,从而满足各种定制化的需求。本文将详细介绍三种大模型本地部署的方法,帮助用户轻松上手。

一、应用部署

应用部署是最适合新手的方式,它无需深厚的编程基础,只需使用厂商预先提供的工具进行安装和配置即可。

1. Ollama部署

Ollama是一个流行的本地推理框架客户端,支持一键部署大型语言模型。以下是Ollama的部署步骤:

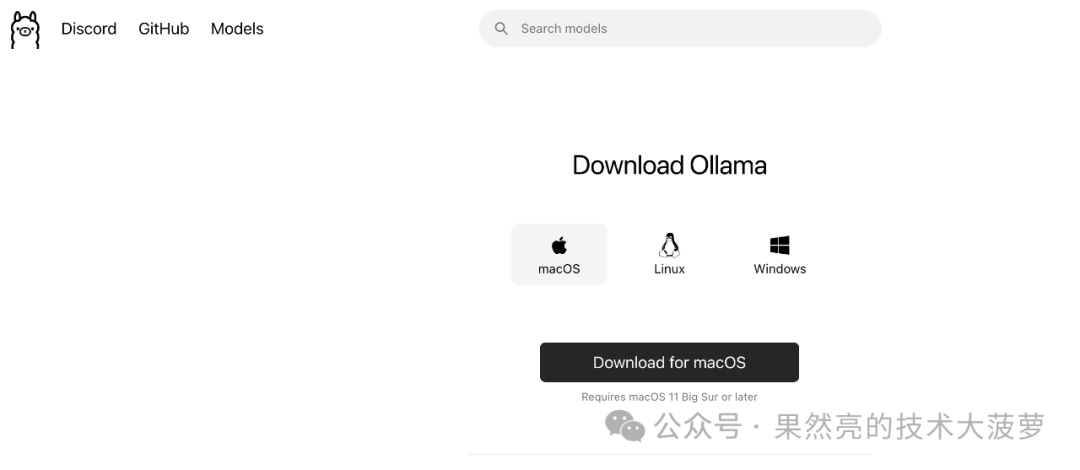

- 下载与安装:访问Ollama的官方网站(https://ollama.com/download),下载对应系统的客户端。安装完成后,在启动台或应用程序文件夹中找到Ollama图标,点击打开。

-

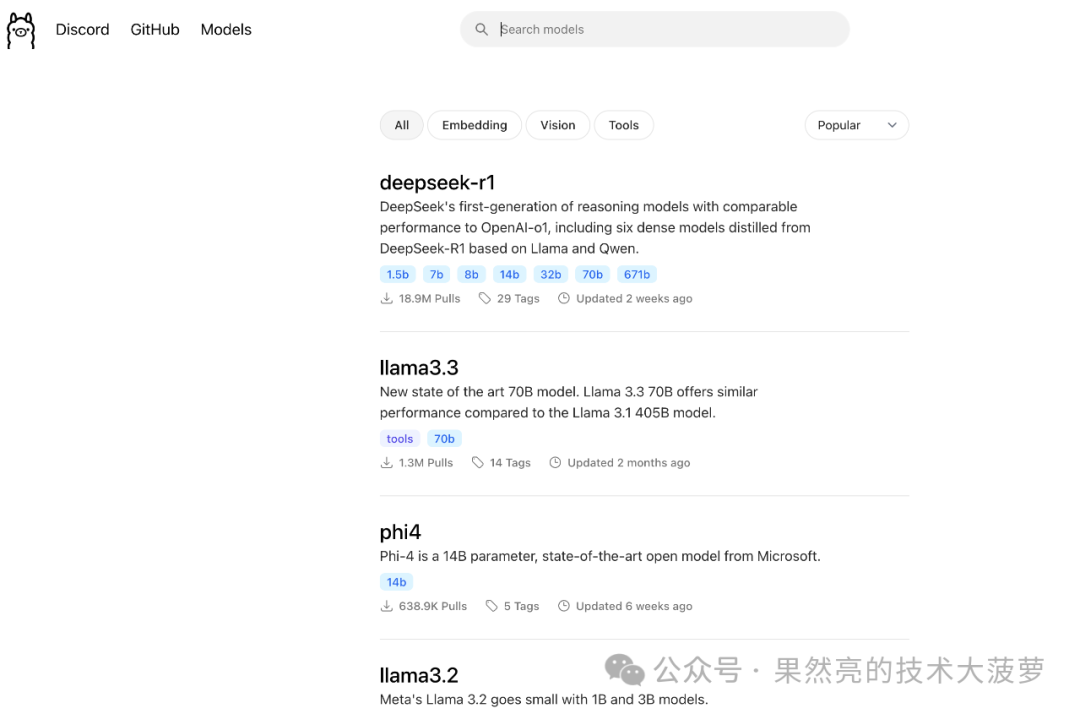

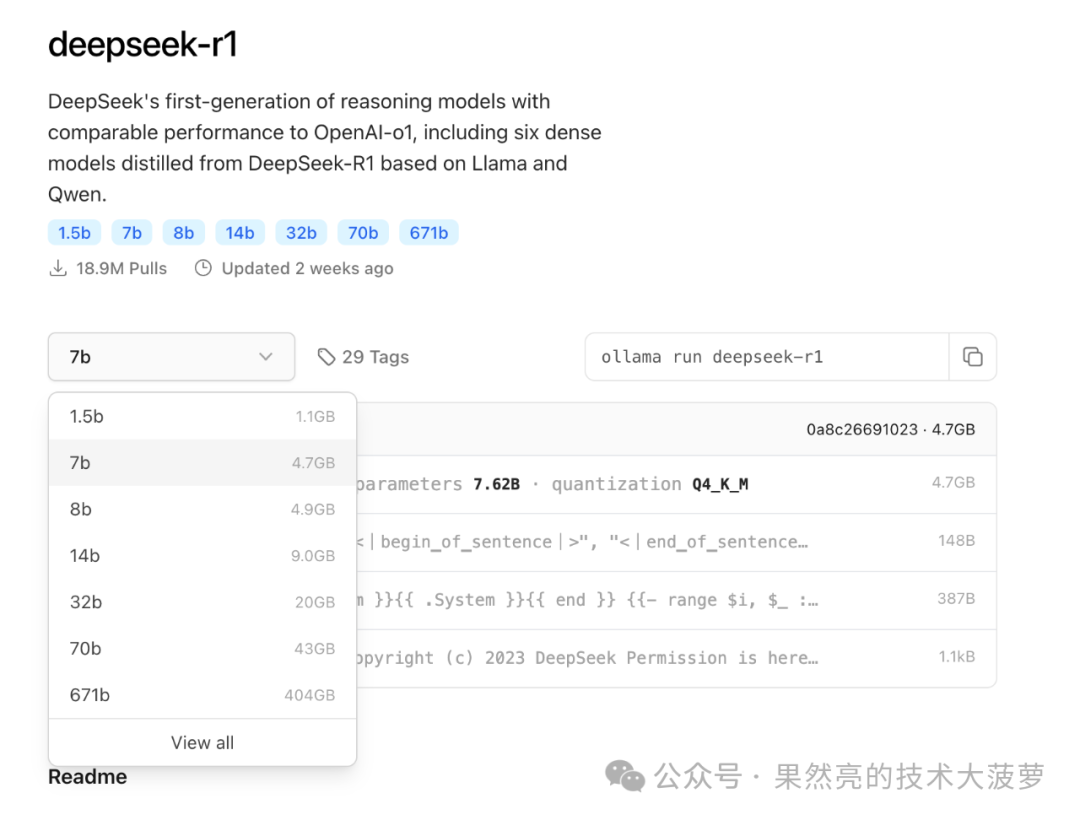

下载模型:打开Ollama后,默认没有webui界面,需要通过命令行下载并运行模型。例如,输入

ollama run deepseek-r1:7b命令,即可下载并启动deepseek-r1的7b版本模型。在Ollama官网中,点击左上角右侧的models,可以搜索你想要安装的模型。选中某个模型之后,就可以看到模型的具体描述以及对应的模型尺寸。 -

-

-

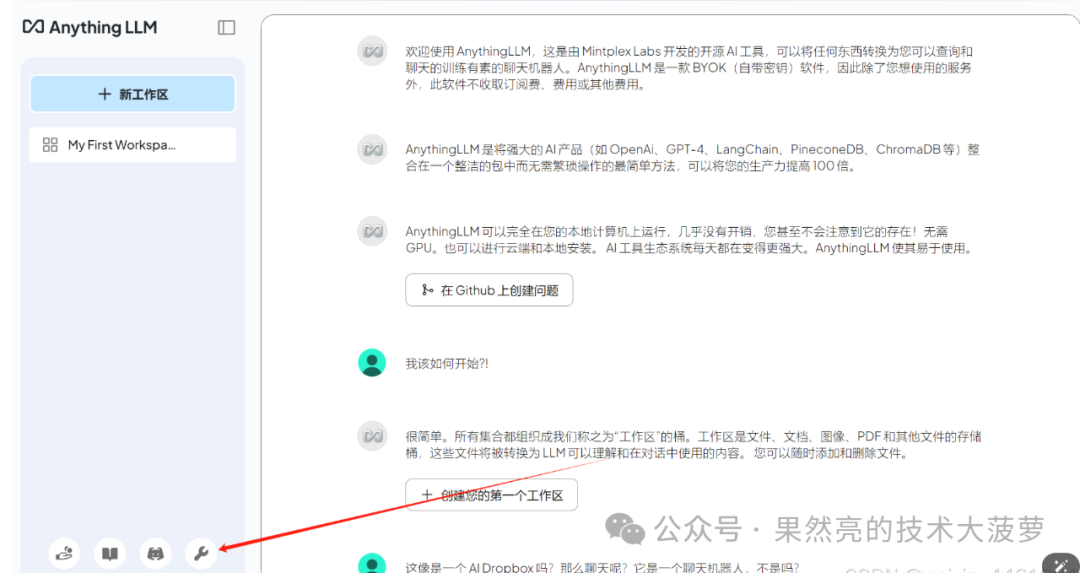

使用webui界面(可选):为了更方便地使用Ollama,可以安装一个webui界面,如anythingllm。配置好本地端口后,即可在浏览器中通过webui界面与模型进行交互。

anythingllm有两个不同的版本,desktop是创建 all-in-one AI application的桌面版本,顾名思义,是个人桌面型工具,只能给你个人提供AI应用的帮助。另外一个可以docker部署的服务器版本,是可以支持团队应用的,部署后支持用户管理、权限管理,可以作为服务端为多个用户提供服务。直接到官网下载(https://anythingllm.com/),下载完成后,配置也非常简单。首先点击左下角这个扳手进行配置:

-

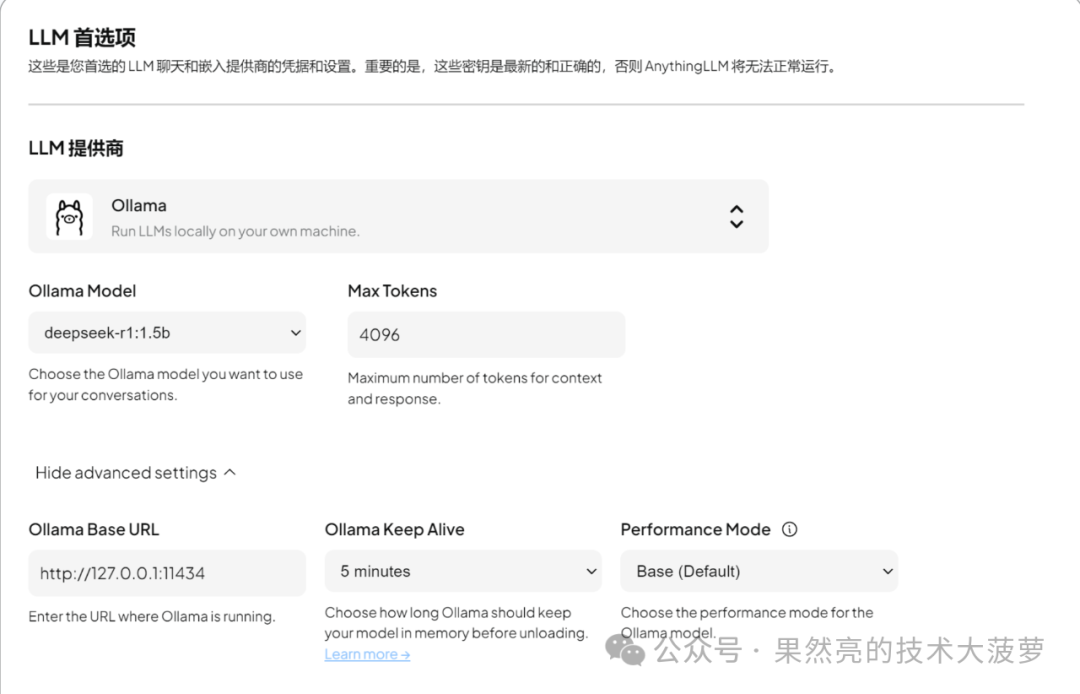

如果要用本地安装的deepseek模型,在LLM提供商处选择ollama,modal选择你安装的模型,下面的127.0.0.1:11434,就是本地ollama的服务端口,其他参数保持默认即可。LLM模型配置之后就可以开始对话了,当然,anythingLLM在对话之前需要创建workplace,很简单,给个名字就完成了创建。需要注意,对话之前本地的模型需要先启动起来。

-

2. LM Studio部署

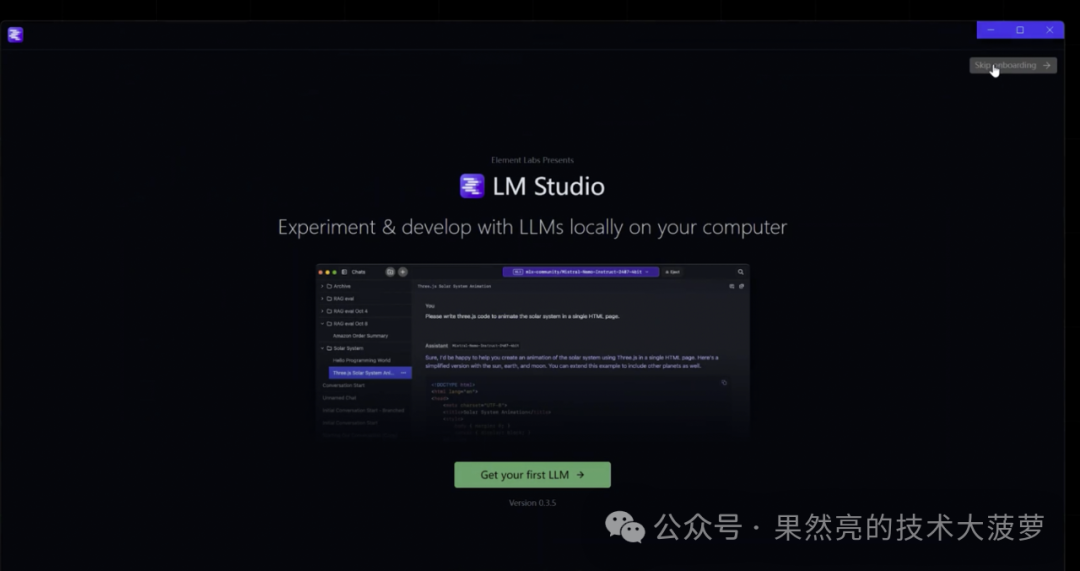

LM Studio是另一个强大的大模型本地部署工具,它拥有更丰富的功能和更直观的UI界面。

-

下载与安装:访问LM Studio的官方网站,下载对应系统的安装包,并按照提示进行安装。

-

-

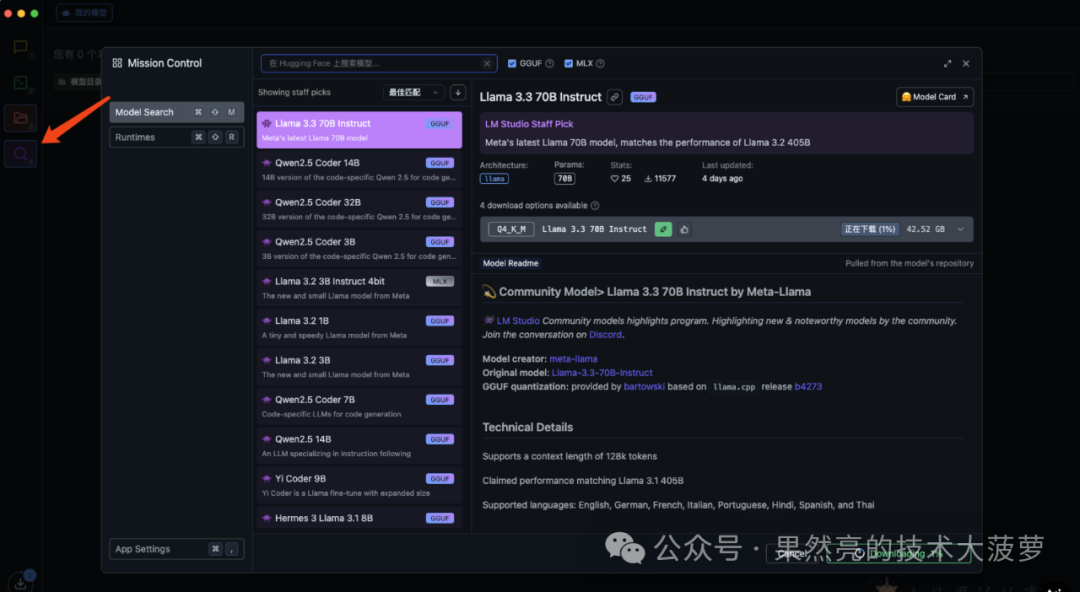

搜索与下载模型:打开LM Studio后,在搜索框中输入想要部署的模型名称,如

llama3.1,然后点击搜索。在搜索结果中选择合适的模型版本,并点击下载。 -

-

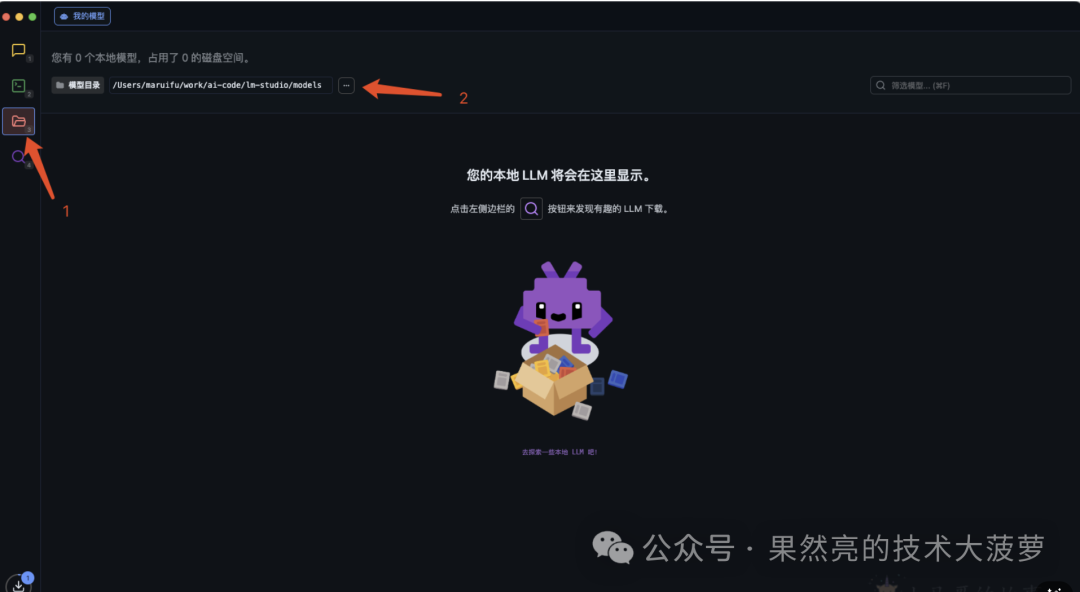

与模型交互:下载完成后,点击左侧的对话框按钮,即可开始与模型进行交互。LM Studio还支持加载本地已安装的模型,方便用户进行多种模型的对比和测试。

-

👉[优快云大礼包🎁:全网最全《LLM大模型入门+进阶学习资源包》免费分享(安全链接,放心点击)]()👈

二、源码部署

源码部署需要一定的编程基础,但提供了更高的灵活性和定制性。

1. 环境配置

在进行源码部署之前,需要配置好相应的Python环境、PyTorch等依赖库。建议使用transformers>=4.40.0, Python 3.10, Pytorch 2.2, CUDA12.0等稳定版本。

2. 下载源码并编译

从GitHub等代码托管平台下载大模型的源码,并按照项目的README文件进行编译和安装。在编译过程中,需要注意依赖库的版本和编译选项的配置。

3. 运行模型

编译完成后,即可运行模型。通常需要通过命令行输入相应的指令来启动模型,并指定模型的配置文件和输入数据。

下面以deepseek为例,详细介绍一下部署过程:

(一)DeepSeek的源码托管在GitHub上,可以通过以下命令克隆到本地:

git clone https://github.com/deepseek-ai/DeepSeek-R1.git``cd DeepSeek-R1

为了避免依赖冲突,建议为DeepSeek创建一个独立的Python虚拟环境。

(二)创建虚拟环境

python3 -m venv deepseek_env``source deepseek_env/bin/activate # 激活虚拟环境

(三)安装依赖

DeepSeek的依赖项通常记录在requirements.txt文件中。运行以下命令安装:

pip install --upgrade pip``pip install -r requirements.txt

如果需要GPU支持,还需安装对应的深度学习框架(如TensorFlow或PyTorch)的GPU版本。例如:

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118

(四)配置DeepSeek

DeepSeek的配置文件通常位于项目根目录下,名为config.yaml或类似文件。以下是配置的关键步骤:

(1)修改配置文件

打开config.yaml文件,设置以下参数:

-

数据路径:指定本地数据集的路径。

-

模型路径:指定预训练模型的存储位置。

-

GPU设置:如果使用GPU,确保use_gpu参数设置为true。

示例配置:

data:` `path: /home/user/datasets``model:` `path: /home/user/models``gpu:` `use_gpu: true` `device_id: 0

(2)测试配置

运行以下命令,验证配置是否正确:

python deepseek.py --test-config

(五)运行DeepSeek

完成配置后,可以开始运行DeepSeek。

(1)数据预处理

DeepSeek通常需要对数据进行预处理。运行以下命令:

python deepseek.py preprocess --data /home/user/datasets

(2)模型训练

使用以下命令启动模型训练:

python deepseek.py train --config config.yaml

(3)模型推理

训练完成后,可以使用以下命令进行推理:

python deepseek.py infer --input /home/user/test_data --output /home/user/results

三、使用开源平台Dify进行部署

Dify是一个开源的LLM应用开发平台,它提供了直观的界面和丰富的功能,支持从原型到生产的快速迭代。

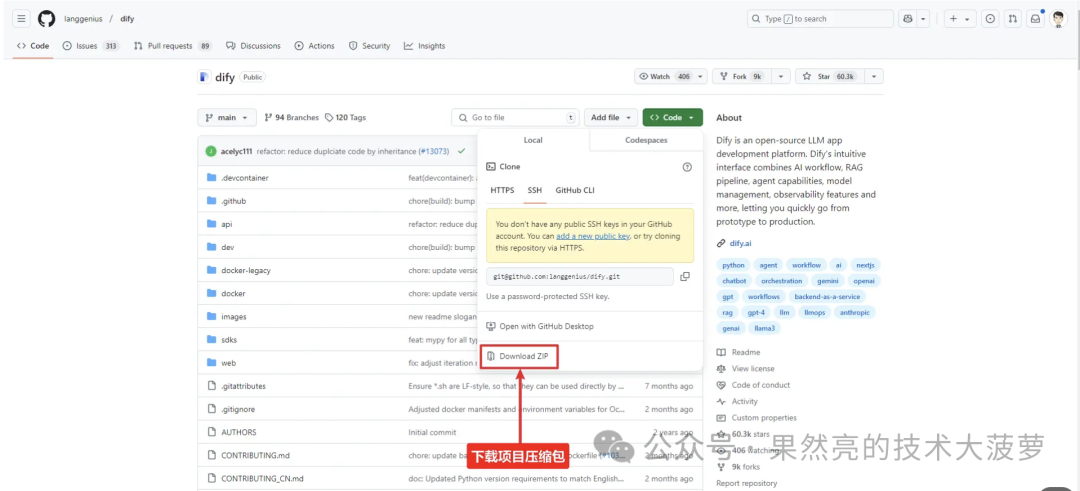

1. 下载与安装Dify

访问Dify的GitHub页面(https://github.com/langgenius/dify),下载源代码并按照README文件进行安装。Dify支持Docker Compose和本地源码两种部署方式。

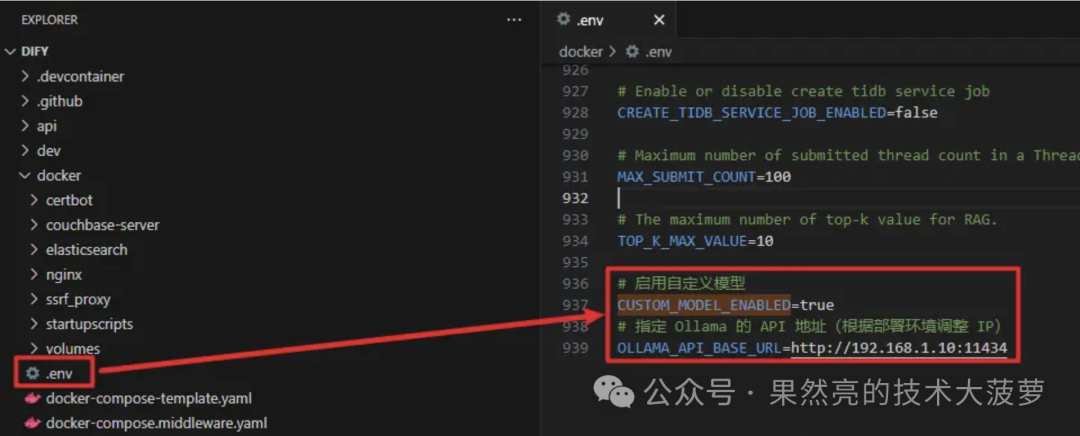

2. 配置与启动

安装完成后,需要配置Dify的相关参数,如数据库连接、Redis缓存等。配置完成后,启动Dify服务。

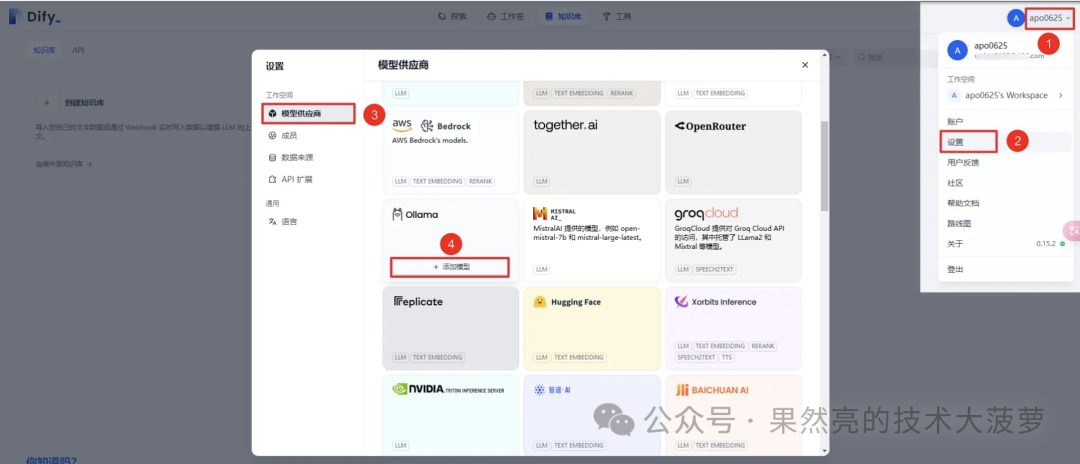

3. 接入模型

Dify支持接入多种大模型,包括GPT、Mistral、Llama3等。用户可以在Dify的设置中选择模型供应商,并填入模型的API地址和相关参数。

4. 创建应用

在Dify中创建新的应用,并选择已接入的模型作为应用的后台。然后,根据需求配置应用的界面和功能,即可开始使用大模型进行推理和交互。

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

对于0基础小白入门:

如果你是零基础小白,想快速入门大模型是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以根据这些资料规划好学习计划和方向。

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

25万+

25万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?