**一、激活函数:**一种非线性变换函数。

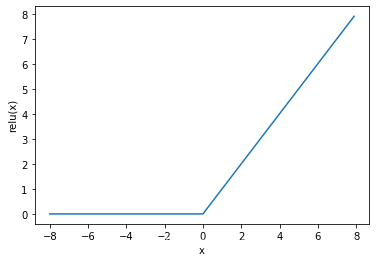

1、ReLU函数:ReLU(x)=max(x,0)

ReLU函数只保留正数元素,并将负数元素清零。

函数图像如下:

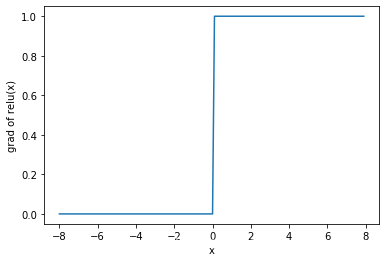

函数求导图像如下:

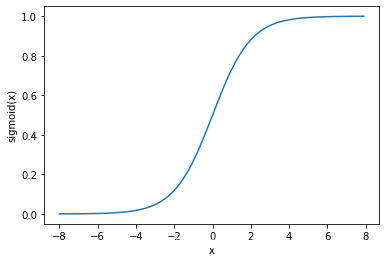

2、Sigmoid函数:sigmoid(x)=1(1+exp(−x))

将元素的值变换到0和1之间。

函数图像如下:

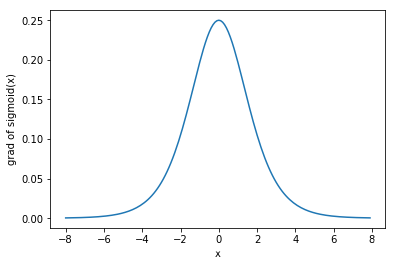

函数求导sigmoid′(x)=sigmoid(x)(1−sigmoid(x)),图像如下:

3、tanh函数(双曲正切):tanh(x)=(1−exp(−2x))/(1+exp(−2x))

将元素的值变换到-1和1之间,形状和sigmoid函数的形状很像,但tanh函数在坐标系的原点上对称。

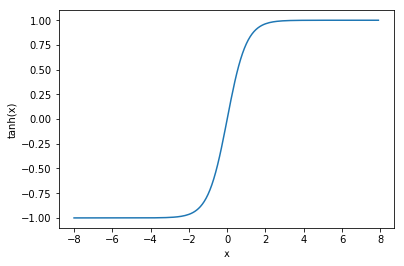

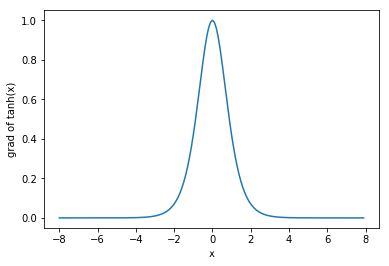

函数图像如下:

函数求导tanh′(x)=1−tanh2(x),图像如下:

二、激活函数的选择

1、ReLu函数是一个通用的激活函数,目前在大多数情况下使用。但是,ReLU函数只能在隐藏层中使用。

2、用于分类器时,sigmoid函数及其组合通常效果更好。由于梯度消失问题,有时要避免使用sigmoid和tanh函数。

3、在神经网络层数较多的时候,最好使用ReLu函数,ReLu函数比较简单计算量少,而sigmoid和tanh函数计算量大很多。

4、在这里插入代码片在选择激活函数的时候可以先选用ReLu函数如果效果不理想可以尝试其他激活函数。

深度学习激活函数及选择原则

最新推荐文章于 2025-07-15 21:54:01 发布

本文深入探讨了ReLU、Sigmoid和tanh三种激活函数的特性及应用。ReLU函数因其简单且能有效解决梯度消失问题,在深度学习中被广泛采用。Sigmoid函数常用于分类任务,而tanh函数则在某些场景下作为Sigmoid的替代。文章还对比了这些函数的优缺点,为读者提供了选择激活函数的指导。

本文深入探讨了ReLU、Sigmoid和tanh三种激活函数的特性及应用。ReLU函数因其简单且能有效解决梯度消失问题,在深度学习中被广泛采用。Sigmoid函数常用于分类任务,而tanh函数则在某些场景下作为Sigmoid的替代。文章还对比了这些函数的优缺点,为读者提供了选择激活函数的指导。

1447

1447

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?