1 简介

本文根据2020年《Denoising Diffusion Probabilistic Models》翻译总结的,即DDPM,去噪扩散概率模型。

GAN、autoregressive models、flows、variational autoencoders(VAEs)可以生成惊人的图像。

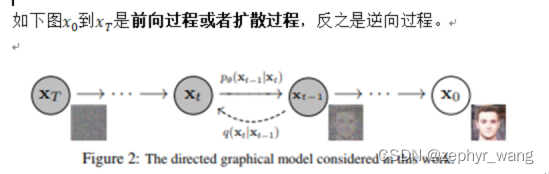

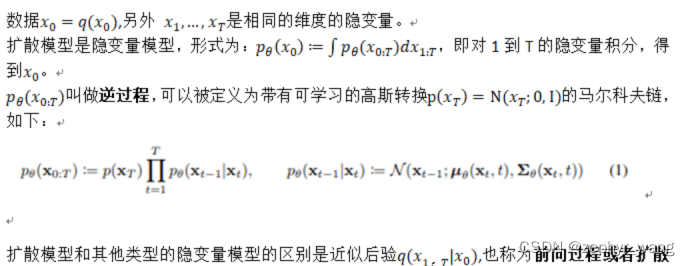

本文介绍了一种新的模型,Diffusion Probabilistic Model 是一个参数化的马尔科夫链,使用variational 推断进行训练。

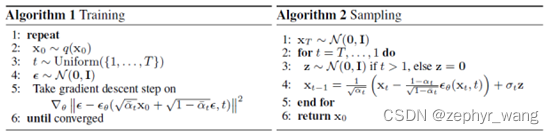

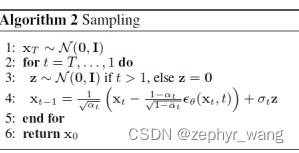

算法如下:

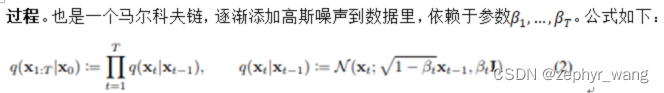

2 背景

2.1 扩散模型目标函数

扩散模型的目标函数是极大似然(maximum likelihood),https://blog.youkuaiyun.com/zephyr_wang/article/details/130804248。目标函数可以参考2015年原始扩散模型论文https://blog.youkuaiyun.com/zephyr_wang/article/details/130798380。

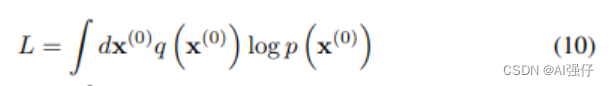

原始扩散模型的目标函数如下,交叉熵函数,衡量p与q的相似性:

L=E[log(p(x))]

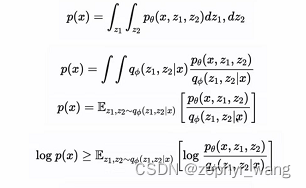

另外,上面式中的p(x)有如下形式:

上面最后一步,是将log期望E变成期望E的log,变成大于等于号的。

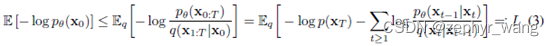

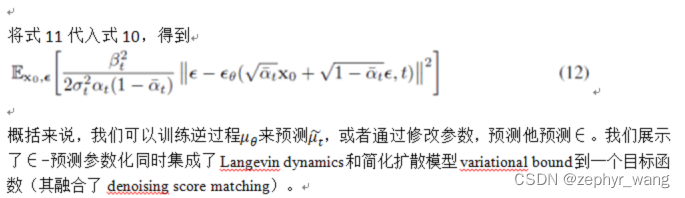

2.2 扩散模型损失函数

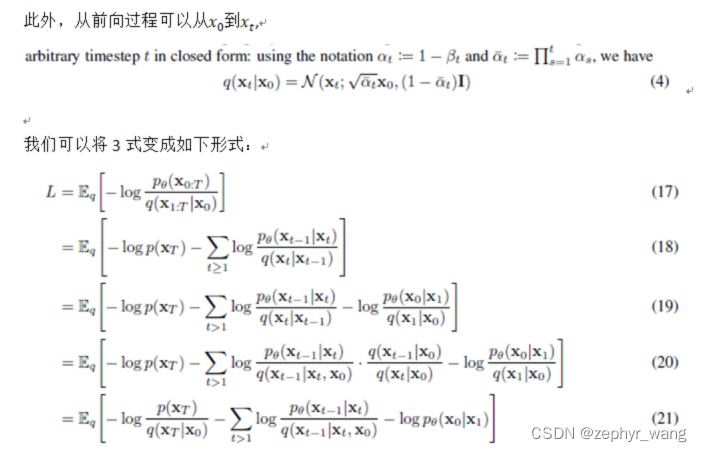

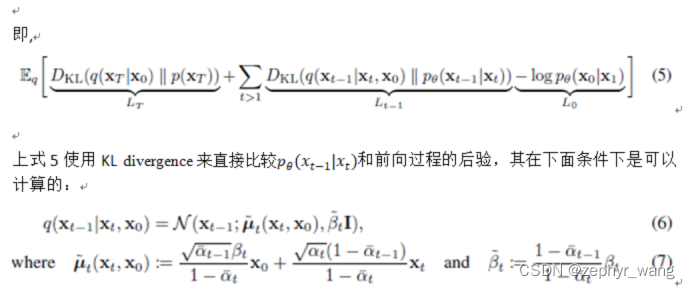

根据2.1节,我们得到扩散函数的损失函数(交叉熵):

因此,在式5中的所有KL divergence在高斯过程间比较,他们可以不使用Monte Carlo estimates.,而使用Rao-Blackwellized fashion来计算。

3 Diffusion models and denoising autoencoders

3.1 前向过程和L_T

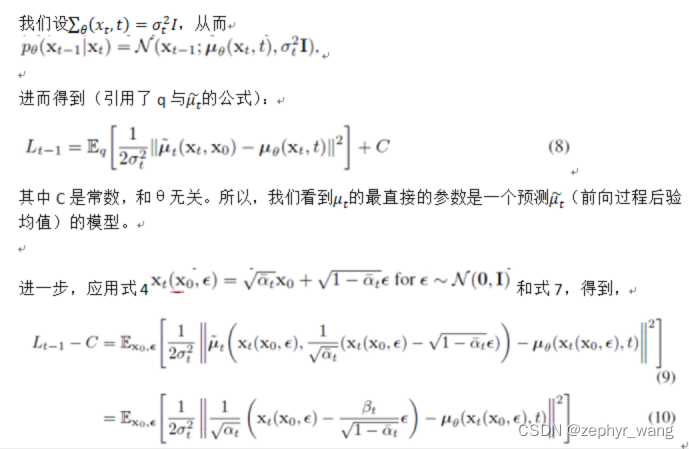

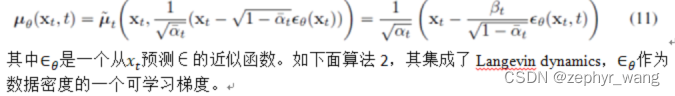

3.2 逆过程和L_(1:T-1)

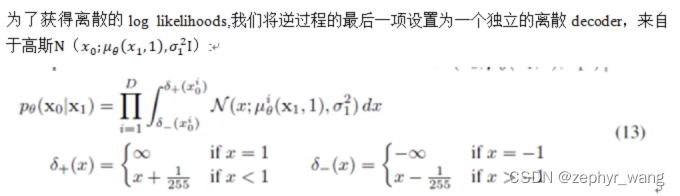

3.3 reverse process decoder, and L0

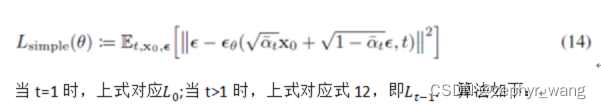

3.4简化后的损失函数

4.实验

我们设T=1000.

前向过程的变量线性增加,从

为了表示逆过程,我们采用u-net骨干。

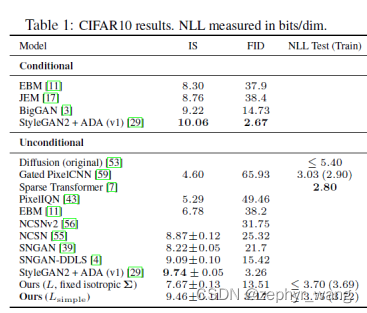

下表在数据CIFAR10.上比较了Inception scores, FID scores, and negative log likelihoods (lossless codelengths) ,我们的模型如FID成绩很好。

868

868

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?