一、注意力机制的提出背景和思想,解决哪方面的问题

attention机制:一种能让模型对重要信息重点关注,并充分学习吸收的技术,它不是一个完整的模型,是一种机制,能够作用于任何序列模型中。

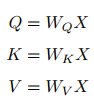

计算相似度(score)

二、有哪几种注意力机制,公式是什么

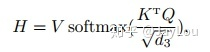

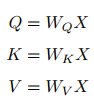

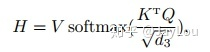

multi-head self-attention计算公式:

输出向量序列:

encoder-decoder attention

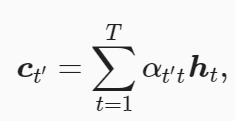

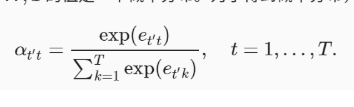

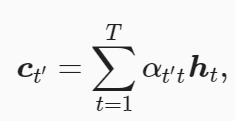

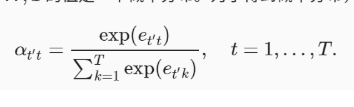

背景变量:

![]()

一、注意力机制的提出背景和思想,解决哪方面的问题

attention机制:一种能让模型对重要信息重点关注,并充分学习吸收的技术,它不是一个完整的模型,是一种机制,能够作用于任何序列模型中。

计算相似度(score)

二、有哪几种注意力机制,公式是什么

multi-head self-attention计算公式:

输出向量序列:

encoder-decoder attention

背景变量:

![]()

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?