Boosting 25年

地址:https://www.bilibili.com/video/av28102016

导言:

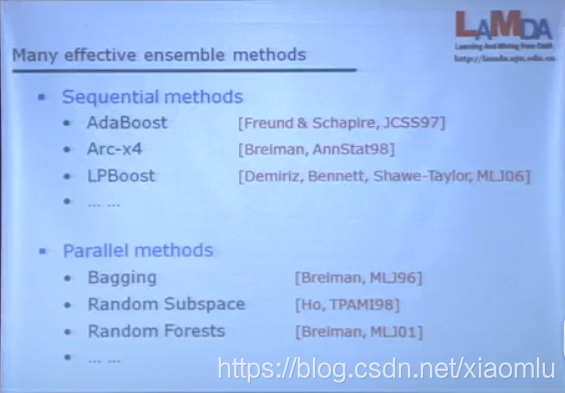

集成学习Ensemble learning:多个学习器解决问题。

学习器可以同质,可以异质。

要求:个体尽可能精确,且差异大。

按照个体分:

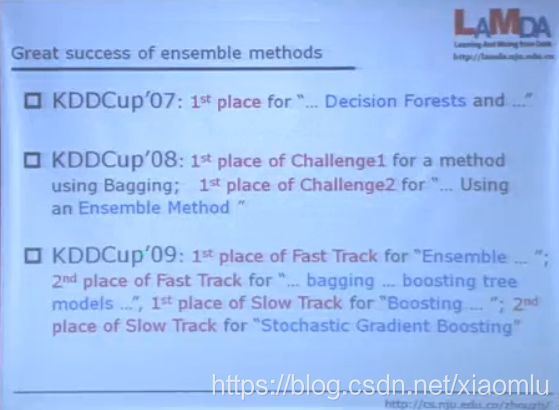

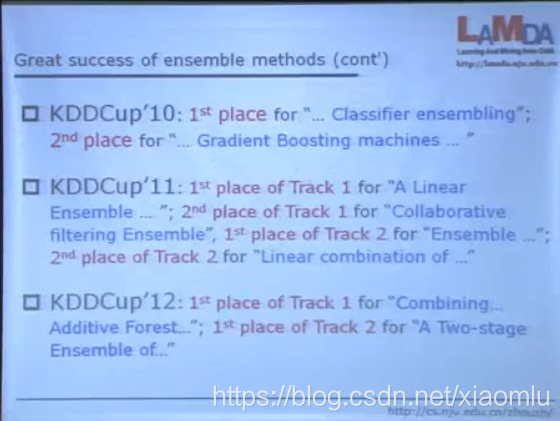

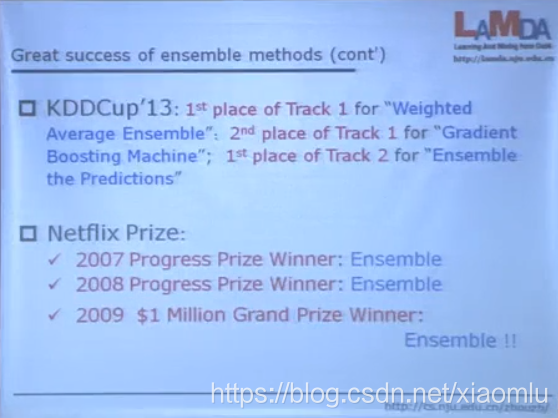

数据挖掘领域很牛逼的KDD CUP被集成学习攻陷啦。

别的比赛也是这样,如Netflix比赛。

具体的展开部分可以去看书《Ensemble Methods Foundations and Algorithms》,作者是周老师。

AdaBoost:

优势在于1. 可以做精确的预测 2. 非常简单(十行代码)

现在应用很广泛,且有很好的理论支撑。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1244

1244

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?