卷积神经网络

CNN概述

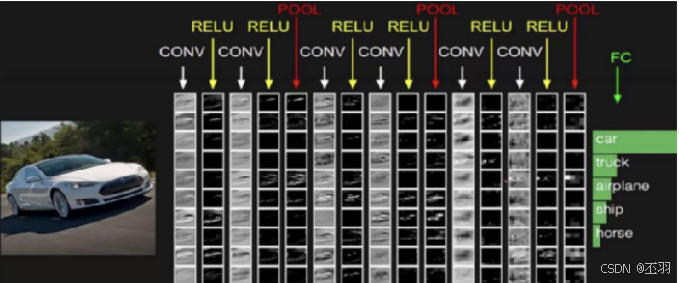

卷积神经网络(Convolutional Neural Network)是含有卷积层的神经网络. 卷积层的作用就是用来自动学习、提取图像的特征.

CNN网络主要由三部分构成:卷积层、池化层和全连接层构成:

- 卷积层负责提取图像中的局部特征;

- 池化层用来大幅降低参数量级(降维);

- 全连接层用来输出想要的结果。

卷积层

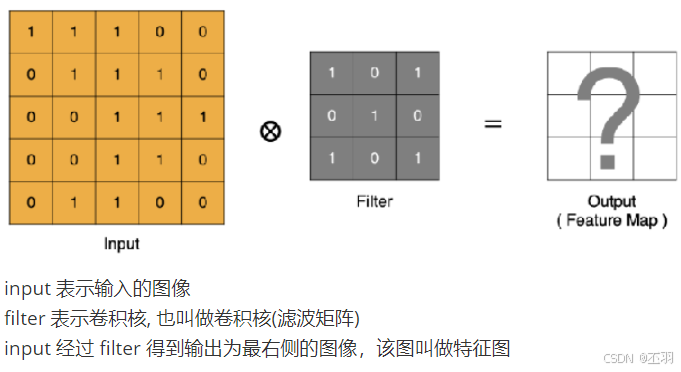

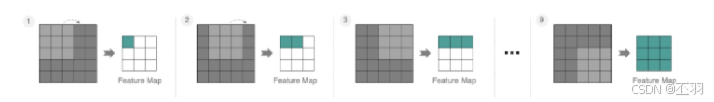

input 表示输入的图像

filter 表示卷积核, 也叫做卷积核(滤波矩阵)

input 经过 filter 得到输出为最右侧的图像,该图叫做特征图

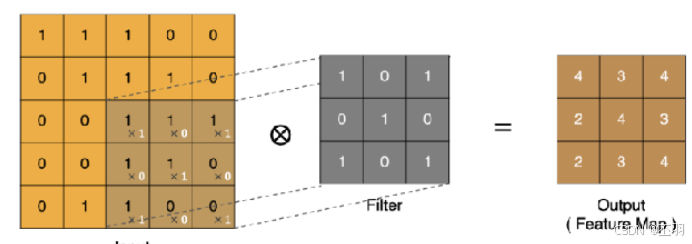

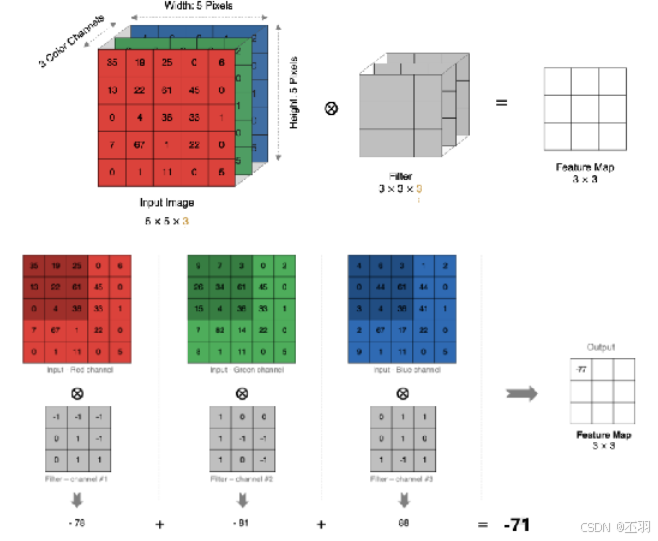

卷积计算

卷积运算本质上就是在卷积核和输入数据的局部区域间做点积。

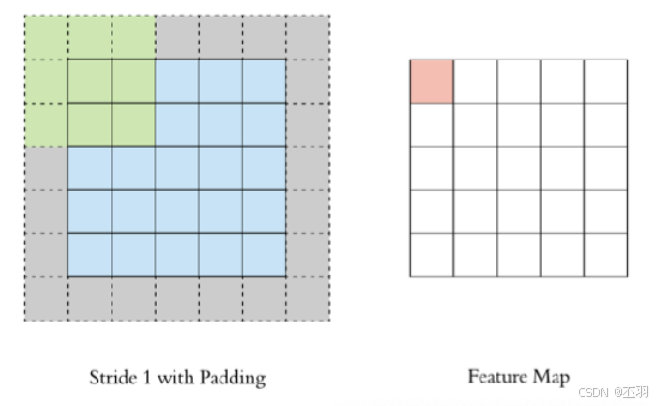

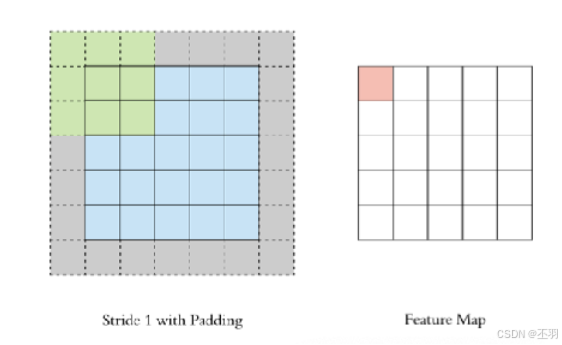

Padding

通过上面的卷积计算过程,最终的特征图比原始图像小很多,如果想要保持经过卷积后的图像大小不变, 可以在原图周围添加 padding 来实现.

Stride

按照步长为1来移动卷积核,计算特征图如下所示:

多通道卷积计算

特征图大小

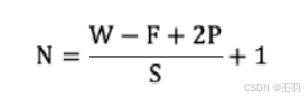

输出特征图的大小与以下参数息息相关:

- size: 卷积核/过滤器大小,一般会选择为奇数,比如有 1*-1 、33、55

- Padding: 零填充的方式

- Stride: 步长

那计算方法如下图所示:

- 输入图像大小: W x W

- 卷积核大小: F x F

- Stride: S

- Padding: P

- 输出图像大小: N x N

以下图为例:

图像大小: 5 x 5

卷积核大小: 3 x 3

Stride: 1

Padding: 1

(5 - 3 + 2) / 1 + 1 = 5, 即得到的特征图大小为: 5 x 5

PyTorch卷积层API

conv = nn.Conv2d(in_channels, out_channels, kernel_size, stride, padding)

"""

参数说明:

in_channels: 输入通道数,

out_channels: 输出通道,也可以理解为卷积核kernel的数量

kernel_size:卷积核的高和宽设置,一般为3,5,7...

stride:卷积核移动的步长

padding:在四周加入padding的数量,默认补0

"""

import torch

import torch.nn as nn

import matplotlib.pyplot as plt

def test():

# 读取图像, 形状: (640, 640, 3)

img = plt.imread('data/img.jpg')

plt.imshow(img)

plt.axis('off')

plt.show()

# 构建卷积层

# out_channels表示卷积核个数

# 修改out_channels,stride,padding观察特征图的变化情况

conv = nn.Conv2d(in_channels=3, out_channels=3, kernel_size=3, stride=2, padding=0)

# 输入形状: (BatchSize, Channel, Height, Width)

# mg形状: torch.Size([3, 640, 640])

img = torch.tensor(img).permute(2, 0, 1)

# img 形状: torch.Size([1, 3, 640, 640])

img = img.unsqueeze(0)

# 将图像送入卷积层中

feature_map_img = conv(img.to(torch.float32))

# 打印特征图的形状

print(feature_map_img.shape)

if __name__ == '__main__':

test()

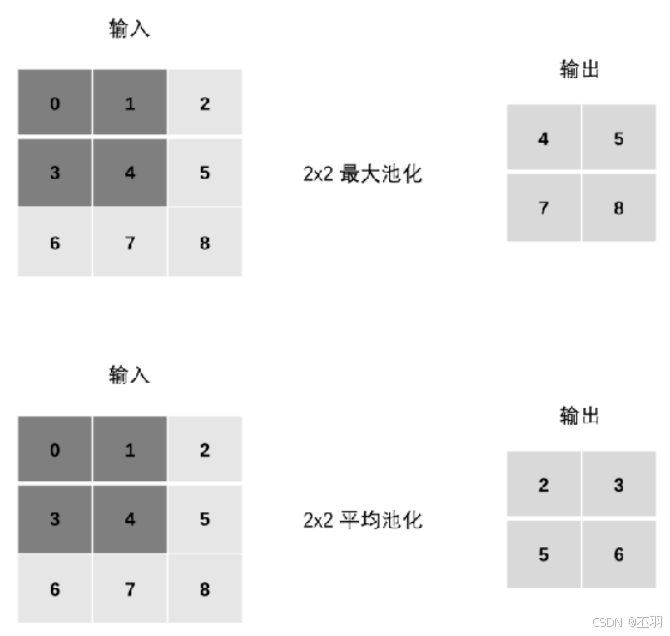

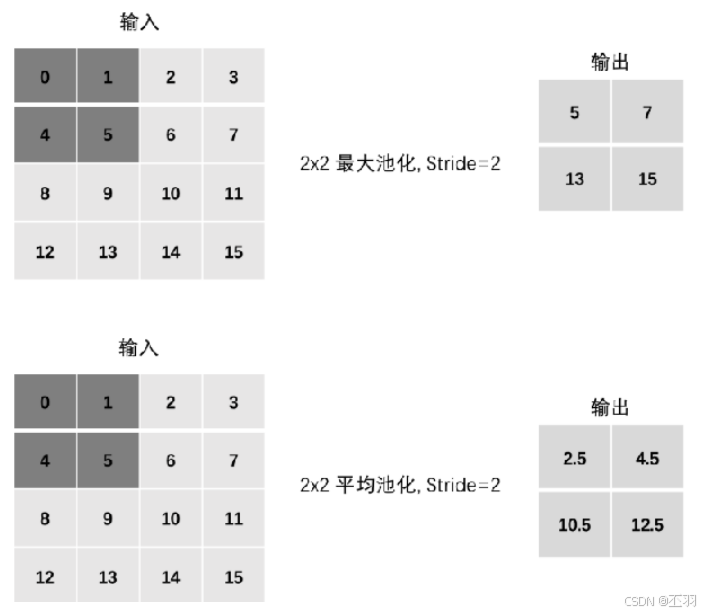

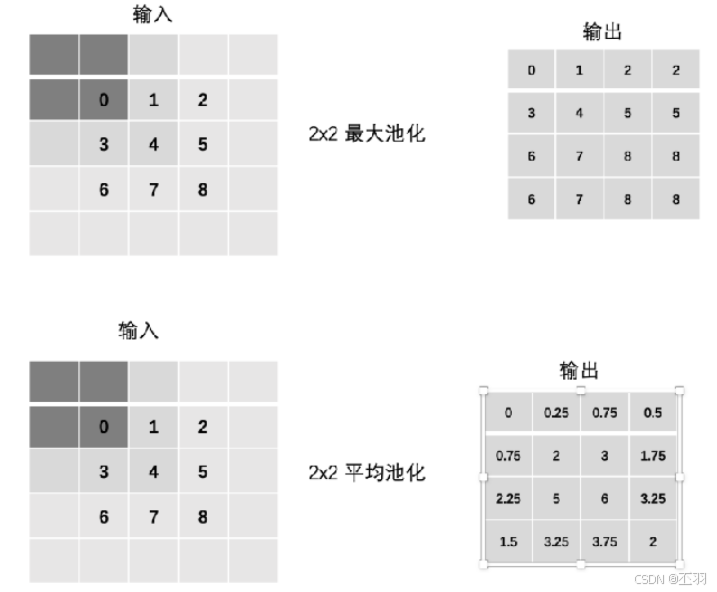

池化层

池化层(Pooling)降低维度,缩减模型大小,提高计算速度

Stride

Padding

API

# 最大池化

nn.MaxPool2d(kernel_size=2, stride=2, padding=1)

# 平均池化

nn.AvgPool2d(kernel_size=2, stride=1, padding=0)

import torch

import torch.nn as nn

# 1. 单通道池化

def

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?