deephash:项目地址

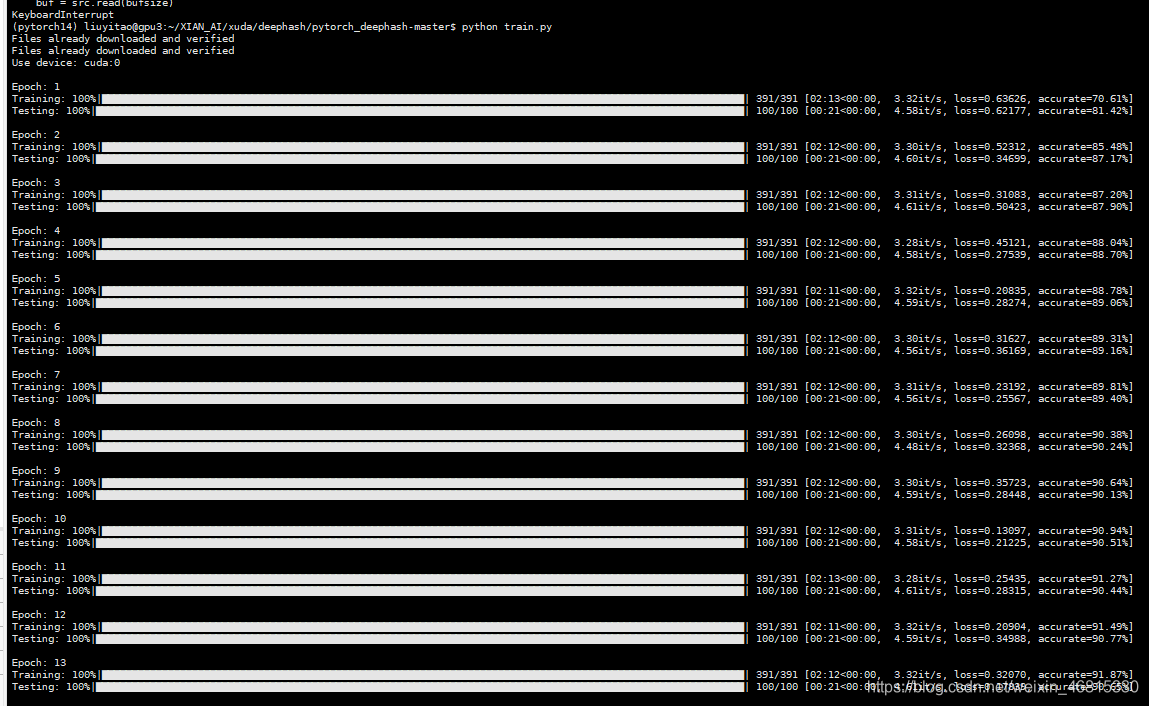

(pytorch14) liuyitao@gpu3:~/XIAN_AI/xuda/deephash/pytorch_deephash-master$ python train.py

Files already downloaded and verified

Files already downloaded and verified

Use device: cuda:0

Epoch: 1

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:13<00:00, 3.32it/s, loss=0.6362

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.58it/s, loss=0.6217

Epoch: 2

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.30it/s, loss=0.5231

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.60it/s, loss=0.3469

Epoch: 3

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.31it/s, loss=0.3108

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.61it/s, loss=0.5042

Epoch: 4

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.28it/s, loss=0.4512

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.58it/s, loss=0.2753

Epoch: 5

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:11<00:00, 3.32it/s, loss=0.2083

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.59it/s, loss=0.2827

Epoch: 6

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.30it/s, loss=0.3162

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.56it/s, loss=0.3616

Epoch: 7

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.31it/s, loss=0.2319

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.56it/s, loss=0.2556

Epoch: 8

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.30it/s, loss=0.2609

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.48it/s, loss=0.3236

Epoch: 9

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.30it/s, loss=0.3572

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.59it/s, loss=0.2844

Epoch: 10

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.31it/s, loss=0.1309

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.58it/s, loss=0.2122

Epoch: 11

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:13<00:00, 3.28it/s, loss=0.2543

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.61it/s, loss=0.2831

Epoch: 12

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:11<00:00, 3.32it/s, loss=0.2090

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.59it/s, loss=0.3498

Epoch: 13

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.32it/s, loss=0.3207

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.61it/s, loss=0.1783

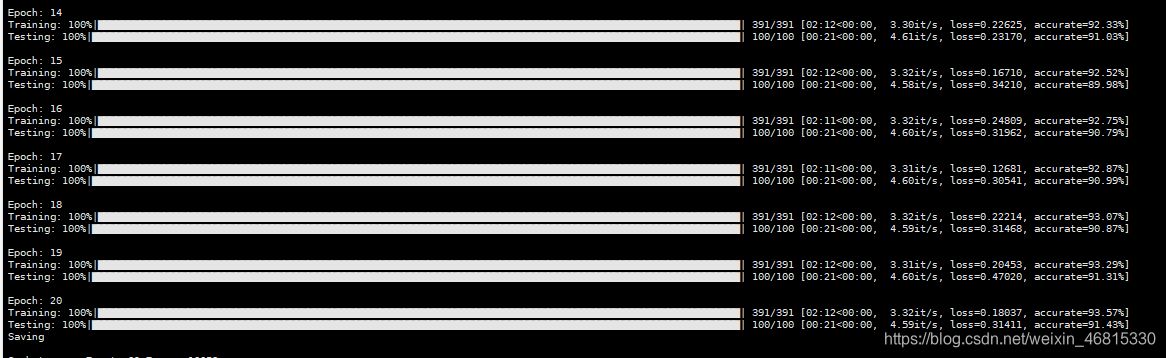

Epoch: 14

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.30it/s, loss=0.2262

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.61it/s, loss=0.2317

Epoch: 15

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.32it/s, loss=0.1671

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.58it/s, loss=0.3421

Epoch: 16

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:11<00:00, 3.32it/s, loss=0.2480

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.60it/s, loss=0.3196

Epoch: 17

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:11<00:00, 3.31it/s, loss=0.1268

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.60it/s, loss=0.3054

Epoch: 18

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.32it/s, loss=0.2221

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.59it/s, loss=0.3146

Epoch: 19

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.31it/s, loss=0.2045

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.60it/s, loss=0.4702

Epoch: 20

Training: 100%|███████████████████████████████████████████████████████████████████████████████████████████████████████████| 391/391 [02:12<00:00, 3.32it/s, loss=0.1803

Testing: 100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████| 100/100 [00:21<00:00, 4.59it/s, loss=0.3141

Saving

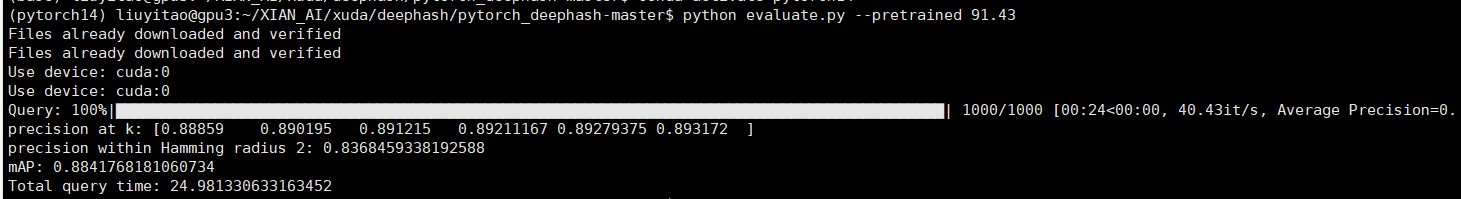

Last login: Thu Jul 22 04:37:16 2021 from 192.168.0.100

liuyitao@gpu3:~$ cd XIAN_AI/

liuyitao@gpu3:~/XIAN_AI$ cd xuda

liuyitao@gpu3:~/XIAN_AI/xuda$ cd deephash/

liuyitao@gpu3:~/XIAN_AI/xuda/deephash$ cd pytorch_deephash-master/

liuyitao@gpu3:~/XIAN_AI/xuda/deephash/pytorch_deephash-master$ source ~/.bashrc

(base) liuyitao@gpu3:~/XIAN_AI/xuda/deephash/pytorch_deephash-master$ conda activate pytorch14

(pytorch14) liuyitao@gpu3:~/XIAN_AI/xuda/deephash/pytorch_deephash-master$ python evaluate.py --pretrained 91.43

Files already downloaded and verified

Files already downloaded and verified

Use device: cuda:0

Use device: cuda:0

Query: 100%|████████████████████████████████████████████████████████████████████████████████████████████| 1000/1000 [00:24<00:00, 40.43it/s, Average Precision=0.99172]

precision at k: [0.88859 0.890195 0.891215 0.89211167 0.89279375 0.893172 ]

precision within Hamming radius 2: 0.8368459338192588

mAP: 0.8841768181060734

Total query time: 24.981330633163452

使用PyTorch进行深度学习模型训练,经过20个epoch,损失(loss)逐渐降低,模型在训练集和验证集上的表现不断提升。最终在验证集上达到较高的平均精度(mAP),表明模型对于图像分类任务有较好的学习效果。

使用PyTorch进行深度学习模型训练,经过20个epoch,损失(loss)逐渐降低,模型在训练集和验证集上的表现不断提升。最终在验证集上达到较高的平均精度(mAP),表明模型对于图像分类任务有较好的学习效果。

1930

1930

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?