Chapter 1 Vectors

- vector addition: 向量加法。可分解为不同轴方向的加法。

- scalar mutiplication: 数乘向量。几何意义为拉长、压缩或翻转一个向量。

Chapter 2 Linear combinations, span, and basis vectors

- linear combinations: 线性组合。即向量加法和数乘向量这两种对向量基本操作的组合。

作者将线性组合看作“向量在代数上和几何上的桥梁”。二维向量 v ⃗ \vec{v} v在代数上的坐标(x, y)可以看作是对于平面直角坐标系中的单位正交基 i ⃗ \vec{i} i, j ⃗ \vec{j} j进行数乘运算和向量加法,即 v ⃗ \vec{v} v = x i ⃗ \vec{i} i+y j ⃗ \vec{j} j,在几何上就对应是以原点为起点,以(x, y)为终点的向量。 - span: 子空间。指的是向量的线性组合张成的空间。作者介绍子空间时,引入了向量线性相关和线性无关的概念。

- basis vectors: 基向量。

作者用一句话概括了这以上概念的关系:

The basis of a vector space is a set of linear independent vectors that span the full space.

Chapter 3 Linear transformations and matrices

( a b c d ) ( x y ) = x ( a c ) + y ( b d ) = ( a x + b y c x + d y ) \begin{equation} \left( \begin{array}{ccc} a & b\\ c & d \end{array} \right) \left( \begin{array}{c} x\\ y \end{array} \right) =x \left( \begin{array}{c} a\\ c \end{array} \right) +y \left( \begin{array}{c} b\\ d \end{array} \right) = \left( \begin{array}{c} ax+by\\ cx+dy \end{array} \right) \nonumber \end{equation} (acbd)(xy)=x(ac)+y(bd)=(ax+bycx+dy)

对于“矩阵-向量乘法”,作者将“向量左乘一个矩阵”看作是对于向量(x, y)的一种线性变换,线性变换类似于函数,其输入是一个向量(x, y),输出也是一个向量(ax+by, cx+dy)。矩阵则描述了如何进行这个变换,具体来说,矩阵的第一列和第二列,分别为原来的基向量 i ⃗ \vec{i} i, j ⃗ \vec{j} j 经过这种线性变换后对应的向量,所以,我们通过矩阵可以直观地用基向量的变换描述该线性变换。

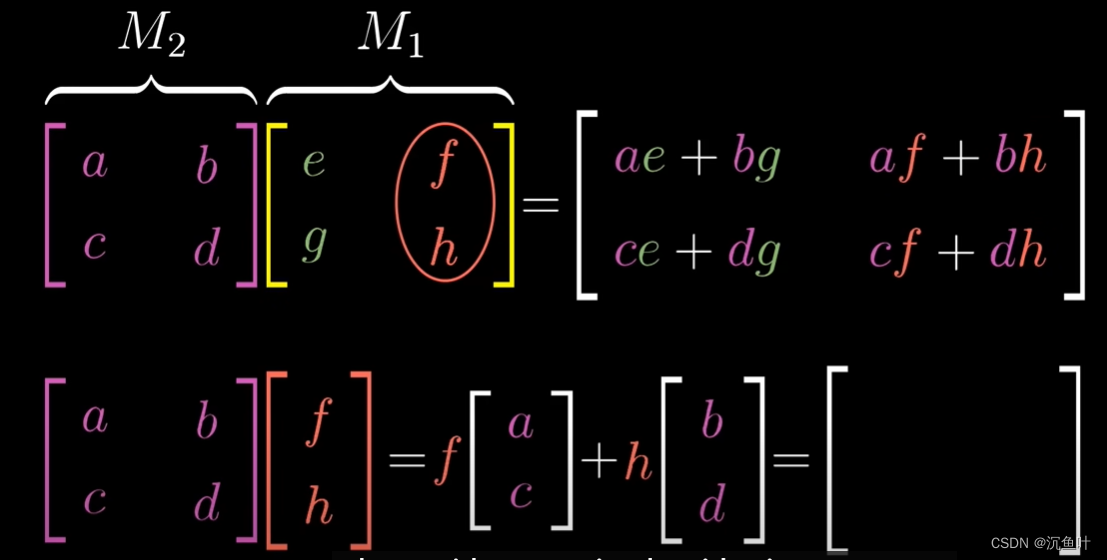

Chapter 4 Matrix multiplications as composition

矩阵乘法可以看作是多个线性变换的叠加,类似于复合函数。矩阵乘法的计算过程,可以看作是找出基向量复合线性变换后的对应向量的过程。比如,要计算经过M1M2两次线性变换后,基向量

i

⃗

\vec{i}

i 变成了哪个向量,则可以用M2对M1的第一列做变换,计算结果就是

i

⃗

\vec{i}

i 经过复合线性变换后的向量。同理,如果用M2对M1的第二列做变换(如下图过程),则计算结果就是

j

⃗

\vec{j}

j 经过复合线性变换后的向量,再把得到的两个变换后的向量拼起来,就得到了复合线性变换对应的矩阵。

Chapter 5 Three-dimensional linear transformations

对于三维空间中坐标为(x, y, z)的向量,对其进行线性变换对应的是左乘一个三维方阵,方阵的每一列代表三个基向量经过该线性变换后对应的向量,而矩阵-向量乘法的意义和计算方式也和上述二维情况类似。

Chapter 6 The determinant

矩阵行列式的绝对值和正负号的几何意义。

- 绝对值:对二维矩阵来说,是线性变换前后,基向量围成平行四边形的面积倍数关系,对三维矩阵来说,是基向量围成平行六面体的体积倍数关系。

- 正负号:行列式为正,代表变换后的基向量顺序方向符合右手系;行列式为负,代表变换后顺序方向符合左手系。

Chapter 7 Inverse matrices, column space and null space

- 逆矩阵的几何意义:若矩阵 A A A代表一个线性变换,则逆矩阵 A − 1 A^{-1} A−1(若存在)代表其逆变换,即任一向量依次经过 A A A变换和 A − 1 A^{-1} A−1变换后仍为原来的向量,即 A − 1 A = I A^{-1}A = I A−1A=I。

- 线性方程组解的存在性问题的几何意义:线性方程组可以写成 A x ⃗ = b ⃗ A\vec{x}=\vec{b} Ax=b的形式,而求解该方程组就是找到一个向量 x ⃗ \vec{x} x,这个向量经过矩阵 A A A对应的线性变换后,变成了 b ⃗ \vec{b} b,如果能找到这样的向量,则方程组有解,反之无解。

- 秩的几何意义:线性变换对应的矩阵可以看作由列向量构成,而每个列向量即描述了原基向量经过变换后得到的对应向量,这些列向量张成的空间定义为列空间(Column Space),秩指的就是列空间的维数。

- 行列式、解的存在性、秩之间的关系(以三维空间为例)

- 行列式:当一个线性变换导致原来的三个基向量变换后对应的三个向量所围成区域从空间降为平面(后称”降维平面“)时,其平行六面体的体积为0,即变换前的0倍,由上一章行列式的几何意义可知,该矩阵的行列式为0。

- 解的存在性:考虑上述矩阵构成的方程组 A x ⃗ = b ⃗ A\vec{x}=\vec{b} Ax=b,对于三维空间中所有的向量 x ⃗ \vec{x} x,经过该矩阵对应的变换后,都会落到降维平面上。那么由上述解的存在性的几何意义可知,对任何一个不在降维平面上的向量 b ⃗ \vec{b} b来说,显然找不到任何一个向量 x ⃗ \vec{x} x经过变换后能变成 b ⃗ \vec{b} b,即对应的线性方程组无解;如果 b ⃗ \vec{b} b恰好在降维平面上,则线性方程组有解。

- 秩:前面说过

r

a

n

k

(

A

)

rank(A)

rank(A)代表A的列空间的维数,即基向量经过矩阵A变换后对应的向量所张成空间的维数。

(1)如果 r a n k ( A ) = 3 rank(A)=3 rank(A)=3,那么说明变换后的向量组仍然是三维空间的一组基,即可以表示空间中的任意一个向量,由于变换是线性的,此时对于 b ⃗ \vec{b} b来说一定能找到唯一对应的向量 x ⃗ \vec{x} x,使得 x ⃗ \vec{x} x经过 A A A对应的变换后得到 b ⃗ \vec{b} b,即 A x ⃗ = b ⃗ A\vec{x}=\vec{b} Ax=b有解;

(2)如果 r a n k ( A ) < 3 rank(A)<3 rank(A)<3,那么则要看 b ⃗ \vec{b} b是否落在降维平面上,从而判断方程组是否有解。具体来说,如果 b ⃗ \vec{b} b落在降维平面上,那么则有 r a n k ( A ) = r a n k ( [ A ∣ b ] ) = 2 rank(A) = rank([A|b])=2 rank(A)=rank([A∣b])=2,对应方程组有解;如果 b ⃗ \vec{b} b没有落在降维平面上,则有 r a n k ( A ) = 2 < r a n k ( [ A ∣ b ] ) = 3 rank(A) =2< rank([A|b])=3 rank(A)=2<rank([A∣b])=3,对应方程组无解。

综合上述,我们就可以从几何角度总结出在课本上学的结论,对于线性方程组 A x ⃗ = b ⃗ A\vec{x}=\vec{b} Ax=b来说:

| 系数矩阵的秩与增广矩阵的秩 | 线性方程组的解 | 系数矩阵的行列式 |

|---|---|---|

| r a n k ( A ) = r a n k ( [ A ∣ b ] ) = n rank(A) = rank([A|b])=n rank(A)=rank([A∣b])=n | 有唯一解 | d e t ( A ) ≠ 0 det(A)\neq0 det(A)=0 |

| r a n k ( A ) = r a n k ( [ A ∣ b ] ) < n rank(A) = rank([A|b])<n rank(A)=rank([A∣b])<n | 有无数解 | d e t ( A ) = 0 det(A)=0 det(A)=0 |

| r a n k ( A ) < r a n k ( [ A ∣ b ] ) ≤ n rank(A) < rank([A|b])\le{n} rank(A)<rank([A∣b])≤n | 无解 | d e t ( A ) = 0 det(A)=0 det(A)=0 |

- 最后,本章还介绍了矩阵的零空间(Null Space)的概念。从几何角度来说,零空间内的向量经过矩阵A对应的线性变换后会变成零向量;从代数角度来说,零空间是齐次线性方程组 A x ⃗ = 0 ⃗ A\vec{x}=\vec{0} Ax=0的解的集合。

Chapter 13 Change of basis

本章主要讲了基变换,并由基变换引出了相似矩阵。

同一个向量在不同基下的坐标也不同,基变换讲解了它们之间的关系。以二维为例,一个向量在基向量组

(

α

⃗

1

,

α

⃗

2

)

(\vec\alpha_1,\vec\alpha_2)

(α1,α2)下的坐标为

(

a

1

,

a

2

)

(a_1,a_2)

(a1,a2),在基向量组

(

β

⃗

1

,

β

⃗

2

)

(\vec\beta_1,\vec\beta_2)

(β1,β2)下的坐标为

(

b

1

,

b

2

)

(b_1,b_2)

(b1,b2)。由于基向量组中基向量的坐标都是在自然坐标系下(基向量为

ϵ

⃗

1

=

(

1

,

0

)

和

ϵ

⃗

2

=

(

0

,

1

)

\vec\epsilon_1=(1,0)和\vec\epsilon_2=(0,1)

ϵ1=(1,0)和ϵ2=(0,1))描述的,所以有:

该向量在自然坐标系下的坐标

=

(

α

⃗

1

,

α

⃗

2

)

∗

(

a

1

,

a

2

)

该向量在自然坐标系下的坐标

=

(

β

⃗

1

,

β

⃗

2

)

∗

(

b

1

,

b

2

)

\begin{align} \nonumber 该向量在自然坐标系下的坐标=(\vec\alpha_1,\vec\alpha_2)*(a_1,a_2) \\ \nonumber 该向量在自然坐标系下的坐标=(\vec\beta_1,\vec\beta_2)*(b_1,b_2) \end{align}

该向量在自然坐标系下的坐标=(α1,α2)∗(a1,a2)该向量在自然坐标系下的坐标=(β1,β2)∗(b1,b2)

由此得到了基变换公式:

(

α

⃗

1

,

α

⃗

2

)

∗

(

a

1

,

a

2

)

=

(

β

⃗

1

,

β

⃗

2

)

∗

(

b

1

,

b

2

)

\begin{align} \nonumber (\vec\alpha_1,\vec\alpha_2)*(a_1,a_2) =(\vec\beta_1,\vec\beta_2)*(b_1,b_2) \end{align}

(α1,α2)∗(a1,a2)=(β1,β2)∗(b1,b2)

根据此等式,如果我们已知一个向量在基向量组

(

α

⃗

1

,

α

⃗

2

)

(\vec\alpha_1,\vec\alpha_2)

(α1,α2)下的坐标为

(

a

1

,

a

2

)

(a_1,a_2)

(a1,a2),就可以求出该向量在基向量组

(

β

⃗

1

,

β

⃗

2

)

(\vec\beta_1,\vec\beta_2)

(β1,β2)下的坐标

(

b

1

,

b

2

)

(b_1,b_2)

(b1,b2),即:

(

b

1

,

b

2

)

=

(

β

⃗

1

,

β

⃗

2

)

−

1

∗

(

α

⃗

1

,

α

⃗

2

)

∗

(

a

1

,

a

2

)

\begin{align} \nonumber (b_1,b_2)=(\vec\beta_1,\vec\beta_2)^{-1}*(\vec\alpha_1,\vec\alpha_2)*(a_1,a_2) \end{align}

(b1,b2)=(β1,β2)−1∗(α1,α2)∗(a1,a2)

接下来,我们由一个问题来引出相似矩阵,问题是:一个线性变换T,在自然坐标系

(

ϵ

⃗

1

,

ϵ

⃗

2

)

(\vec\epsilon_1,\vec\epsilon_2)

(ϵ1,ϵ2)下的变换矩阵

A

A

A 很复杂,而在基向量组

(

ξ

⃗

1

,

ξ

⃗

2

)

(\vec\xi_1,\vec\xi_2)

(ξ1,ξ2)下的变换矩阵

B

B

B 或许比较简洁(下一章将会明确“简洁”的含义),我们能不能通过基变换,由

A

A

A 计算出

B

B

B 呢?

可以这样考虑,若一个向量在基向量组

(

ξ

⃗

1

,

ξ

⃗

2

)

(\vec\xi_1,\vec\xi_2)

(ξ1,ξ2)下的坐标为

(

x

,

y

)

(x, y)

(x,y),那么该向量在自然坐标系下的坐标为:

(

ξ

⃗

1

,

ξ

⃗

2

)

∗

(

x

,

y

)

\begin{align} \nonumber (\vec\xi_1,\vec\xi_2)*(x,y) \end{align}

(ξ1,ξ2)∗(x,y)

由Ch3讲过的“矩阵-向量乘法”可知,经过线性变换T后的向量,在自然坐标系下的坐标为:

A

∗

(

ξ

⃗

1

,

ξ

⃗

2

)

∗

(

x

,

y

)

\begin{align} \nonumber A*(\vec\xi_1,\vec\xi_2)*(x,y) \end{align}

A∗(ξ1,ξ2)∗(x,y)

回忆一下基变换公式:

(

α

⃗

1

,

α

⃗

2

)

∗

(

a

1

,

a

2

)

=

(

β

⃗

1

,

β

⃗

2

)

∗

(

b

1

,

b

2

)

\begin{align} \nonumber (\vec\alpha_1,\vec\alpha_2)*(a_1,a_2) =(\vec\beta_1,\vec\beta_2)*(b_1,b_2) \end{align}

(α1,α2)∗(a1,a2)=(β1,β2)∗(b1,b2)

- ( α ⃗ 1 , α ⃗ 2 ) (\vec\alpha_1,\vec\alpha_2) (α1,α2)是一组基。我们将 ( ϵ ⃗ 1 , ϵ ⃗ 2 ) (\vec\epsilon_1,\vec\epsilon_2) (ϵ1,ϵ2)代入到 ( α ⃗ 1 , α ⃗ 2 ) (\vec\alpha_1,\vec\alpha_2) (α1,α2)

- ( a 1 , a 2 ) (a_1,a_2) (a1,a2)是基 ( α ⃗ 1 , α ⃗ 2 ) (\vec\alpha_1,\vec\alpha_2) (α1,α2)下的坐标。我们将 A ∗ ( ξ ⃗ 1 , ξ ⃗ 2 ) ∗ ( x , y ) A*(\vec\xi_1,\vec\xi_2)*(x,y) A∗(ξ1,ξ2)∗(x,y)代入到 ( a 1 , a 2 ) (a_1,a_2) (a1,a2)

- ( β ⃗ 1 , β ⃗ 2 ) (\vec\beta_1,\vec\beta_2) (β1,β2)是另一组基。我们将 ( ξ ⃗ 1 , ξ ⃗ 2 ) (\vec\xi_1,\vec\xi_2) (ξ1,ξ2)代入到 ( β ⃗ 1 , β ⃗ 2 ) (\vec\beta_1,\vec\beta_2) (β1,β2)

- ( b 1 , b 2 ) (b_1,b_2) (b1,b2)是基 ( β ⃗ 1 , β ⃗ 2 ) (\vec\beta_1,\vec\beta_2) (β1,β2)下的坐标。我们设该向量经过变换T在基向量组 ( ξ ⃗ 1 , ξ ⃗ 2 ) (\vec\xi_1,\vec\xi_2) (ξ1,ξ2)下的坐标为 ( x ′ , y ′ ) (x',y') (x′,y′),代入到 ( b 1 , b 2 ) (b_1,b_2) (b1,b2)

得到:

(

ϵ

⃗

1

,

ϵ

⃗

2

)

∗

A

∗

(

ξ

⃗

1

,

ξ

⃗

2

)

∗

(

x

,

y

)

=

(

ξ

⃗

1

,

ξ

⃗

2

)

∗

(

x

′

,

y

′

)

\begin{align} \nonumber (\vec\epsilon_1,\vec\epsilon_2)*A*(\vec\xi_1,\vec\xi_2)*(x,y) = (\vec\xi_1,\vec\xi_2)*(x',y') \end{align}

(ϵ1,ϵ2)∗A∗(ξ1,ξ2)∗(x,y)=(ξ1,ξ2)∗(x′,y′)

其中

(

ϵ

⃗

1

,

ϵ

⃗

2

)

(\vec\epsilon_1,\vec\epsilon_2)

(ϵ1,ϵ2)就是单位阵

I

I

I ,可以得到:

(

x

′

,

y

′

)

=

(

ξ

⃗

1

,

ξ

⃗

2

)

−

1

∗

A

∗

(

ξ

⃗

1

,

ξ

⃗

2

)

∗

(

x

,

y

)

\begin{align} \nonumber (x',y') = (\vec\xi_1,\vec\xi_2)^{-1}*A*(\vec\xi_1,\vec\xi_2)*(x,y) \end{align}

(x′,y′)=(ξ1,ξ2)−1∗A∗(ξ1,ξ2)∗(x,y)

在基向量组

(

ξ

⃗

1

,

ξ

⃗

2

)

(\vec\xi_1,\vec\xi_2)

(ξ1,ξ2)下,线性变换T的变换矩阵为

B

B

B,变换前坐标为

(

x

,

y

)

(x,y)

(x,y),变换后坐标为

(

x

′

,

y

′

)

(x',y')

(x′,y′),由“矩阵-向量乘法”的意义,可知:

(

x

′

,

y

′

)

=

B

∗

(

x

,

y

)

\begin{align} \nonumber (x',y') =B*(x,y) \end{align}

(x′,y′)=B∗(x,y)

代入到上面的式子中,并令

P

=

(

ξ

⃗

1

,

ξ

⃗

2

)

P = (\vec\xi_1,\vec\xi_2)

P=(ξ1,ξ2),则得到:

B

∗

(

x

,

y

)

=

P

−

1

A

P

∗

(

x

,

y

)

\begin{align} \nonumber B*(x,y) = P^{-1}AP*(x,y) \end{align}

B∗(x,y)=P−1AP∗(x,y)

由于上式对任意

(

x

,

y

)

(x,y)

(x,y)均成立,所以有:

B

=

P

−

1

A

P

\begin{align} \nonumber B = P^{-1}AP \end{align}

B=P−1AP

这就是相似矩阵定义的来源,并且由上述推导过程,我们可以得出两个矩阵相似的几何意义。

即:若

A

A

A~

B

B

B,则

A

A

A 和

B

B

B 分别是同一种线性变换在不同坐标系下的矩阵描述。

Chapter 14 Eigenvectors and eigenvalues

线性变换 T T T 可由矩阵 A A A 表示,该矩阵的特征值 λ \lambda λ 以及特征值对应的特征向量 v ⃗ \vec{v} v,则描述了该线性变换的本质。

代数角度:

A

v

⃗

=

λ

v

⃗

\begin{align} \nonumber A\vec{v} = \lambda\vec{v} \end{align}

Av=λv

几何角度:如果一个非零向量 v ⃗ \vec{v} v 经过线性变换 T T T 后只是被拉长或缩短了,伸缩的倍率就是特征值的绝对值 ∣ λ ∣ |\lambda| ∣λ∣ ,如果变换后的向量方向不变,则 λ \lambda λ 为正;如果变换后向量方向翻转了,则 λ \lambda λ 为负, 该非零向量 v ⃗ \vec{v} v 就是线性变换矩阵 A A A 的特征值 λ \lambda λ 对应的特征向量。(如果还记得 Ch6 中行列式的几何意义,也就能明白为什么行列式等于特征值之积了)

为什么说特征值和特征向量是线性变换的本质呢?这是因为,通过特征值和特征向量,我们可以用最简洁、最清晰的视角去理解线性变换 T T T 。以二维空间为例,我们知道,任意两个线性无关的向量都可以作为二维空间的基向量,对于可逆矩阵来说,当然也可以用该矩阵线性无关的两个特征向量作为基向量,我们称之为“特征基”(eigen basis)。那么,为什么选取特征基作为基向量,视角就更清晰了呢?因为,在特征基构成的坐标系下,线性变换T就体现为坐标轴的伸缩变换,而没有任何的旋转变换。换个角度来说,线性变换T在该坐标系下的变换矩阵就是对角矩阵。其便捷性可以通过下面例子来体现。

例如,线性变换 T T T在自然坐标系下的变换矩阵 A = ( 3 , 0 ; 1 , 2 ) A=(3,0; 1,2) A=(3,0;1,2),我们想知道向量 v ⃗ = ( 1 , 1 ) \vec{v}=(1,1) v=(1,1)经过4次该变换后的坐标 ( x , y ) (x,y) (x,y),那么就需要计算 A 4 A^{4} A4,即4次矩阵乘法,这是很繁琐的。

如果我们用特征基构成的坐标系来解决,就可以将非对角矩阵的幂运算转化为对角矩阵的幂运算,从而转换为标量的幂运算,大大减小了计算量。具体思路如下:

- 求得 A A A的特征值 λ 1 = 3 , λ 2 = 2 \lambda_1=3,\lambda_2=2 λ1=3,λ2=2 ,以及对应的特征向量 ξ 1 = ( 1 , 0 ) , ξ 2 = ( 1 , − 1 ) \xi_1=(1,0),\xi_2=(1,-1) ξ1=(1,0),ξ2=(1,−1),并用 ξ 1 , ξ 2 \xi_1,\xi_2 ξ1,ξ2拼成相似变换矩阵 P = ( 1 , 1 ; 0 , 1 ) P=(1,1;0,1) P=(1,1;0,1), P − 1 = ( − 1 , − 1 ; 0 , 1 ) P^{-1}=(-1,-1;0,1) P−1=(−1,−1;0,1),则有在特征基坐标系下的变换矩阵 B = P − 1 A P = ( 3 , 0 ; 0 , 2 ) B = P^{-1}AP=(3,0;0,2) B=P−1AP=(3,0;0,2)

- 通过基变换,算出

v

⃗

\vec{v}

v在特征基下的坐标

v

′

⃗

\vec{v'}

v′:

v ′ ⃗ = P − 1 ∗ v ⃗ = ( − 1 − 1 0 1 ) ∗ ( 1 1 ) = ( − 2 1 ) \begin{align} \nonumber \vec{v'}=P^{-1}*\vec{v} = \left( \begin{array}{ccc} -1 & -1\\ 0 & 1 \end{array} \right) * \left( \begin{array}{c} 1\\1 \end{array} \right)=\left( \begin{array}{c} -2\\1 \end{array} \right) \end{align} v′=P−1∗v=(−10−11)∗(11)=(−21) - 用线性变换

T

T

T在特征基下的变换矩阵

B

B

B,得到对

v

′

⃗

\vec{v'}

v′进行4次线性变换后的向量

v

′

′

⃗

\vec{v''}

v′′:

v ′ ′ ⃗ = B 4 ∗ v ′ ⃗ = ( 3 0 0 2 ) 4 ∗ ( − 2 1 ) = ( 81 0 0 16 ) ∗ ( − 2 1 ) = ( − 162 16 ) \begin{align} \nonumber \vec{v''} = B^{4}*\vec{v'}= \left( \begin{array}{ccc} 3 & 0\\ 0 & 2 \end{array} \right)^{4}*\left( \begin{array}{c} -2\\1 \end{array} \right)= \left( \begin{array}{ccc} 81 & 0\\ 0 & 16 \end{array} \right)*\left( \begin{array}{c} -2\\1 \end{array} \right) =\left( \begin{array}{c} -162\\16 \end{array} \right) \end{align} v′′=B4∗v′=(3002)4∗(−21)=(810016)∗(−21)=(−16216) - 通过基变换,算出

v

′

′

⃗

\vec{v''}

v′′在原自然坐标系下的坐标

(

x

,

y

)

(x,y)

(x,y):

( x y ) = P ∗ v ′ ′ ⃗ = ( 1 1 0 1 ) ∗ ( − 162 16 ) = ( − 146 16 ) \begin{equation} \left( \begin{array}{c} x\\y \end{array} \right) =P*\vec{v''}=\left( \begin{array}{ccc} 1 & 1\\ 0 & 1 \end{array} \right)* \left( \begin{array}{c} -162\\16 \end{array} \right)=\left( \begin{array}{c} -146\\16 \end{array} \right) \nonumber \end{equation} (xy)=P∗v′′=(1011)∗(−16216)=(−14616)

矩阵的可对角化(diagonalizable)

P

−

1

A

P

=

Λ

\begin{align} \nonumber P^{-1}AP=\Lambda \end{align}

P−1AP=Λ

那么问题又来了,是所有的矩阵都可以找到一个对角矩阵和它相似吗?如果本科学过线性代数的话,就应该知道,n维矩阵可对角化的充要条件是有n个线性无关的特征向量。那么,如何从几何角度理解这件事呢?由上一章我们知道,相似矩阵代表同一个线性变换在不同坐标系下的描述,如果一个矩阵相似于对角矩阵,则说明该矩阵代表的线性变换在某种坐标系下可以只体现为坐标轴的伸缩变换,反之则不能相似对角化。

上面的例子已经说明了矩阵可以相似对角化的情况,即找到了一种坐标系(特征基构成的坐标系),该变换只体现为坐标轴的伸缩变换。

下面再举两个不能相似对角化的例子:

- 对于旋转90°这种线性变换,它在自然坐标系下的变换矩阵 A = ( 0 , − 1 ; 1 , 0 ) A=(0,-1;1,0) A=(0,−1;1,0),对于该变换来说,显然没有任何一个向量只进行了伸长/缩短,也就是说无法找到一种坐标系,使得该变换在此坐标系下只体现为坐标轴的伸缩变换,所以矩阵 A A A不能相似对角化。

- 对于切变(shift)这种线性变换,它在自然坐标系下的变换矩阵 B = ( 1 , 1 ; 1 , 0 ) B=(1,1;1,0) B=(1,1;1,0),对于该变换来说,只有x轴上的向量只进行了伸长/缩短,无法找到与其线性无关的第二个基向量,所以也找不到一种坐标系,使得该变换在此坐标系下只体现为坐标轴的伸缩变换,所以所以矩阵 B B B也不能相似对角化。

对于不能对角化的矩阵,我们可以找到另一种接近对角矩阵的形式——Jordan标准型:

P

−

1

A

P

=

J

\begin{align} \nonumber P^{-1}AP=J \end{align}

P−1AP=J

将上面两个式子进行移项,实际上就变成了我们常说的:

- 矩阵特征值分解:

A = P Λ P − 1 \begin{align} \nonumber A=P\Lambda P^{-1} \end{align} A=PΛP−1 - 矩阵Jordan分解:

A = P J P − 1 \begin{align} \nonumber A=PJP^{-1} \end{align} A=PJP−1

将特征分解推广到非方矩阵来说,就是常说的:

- 奇异值分解:

A = U Σ V T \begin{align} \nonumber A=U \Sigma V^{T} \end{align} A=UΣVT

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?