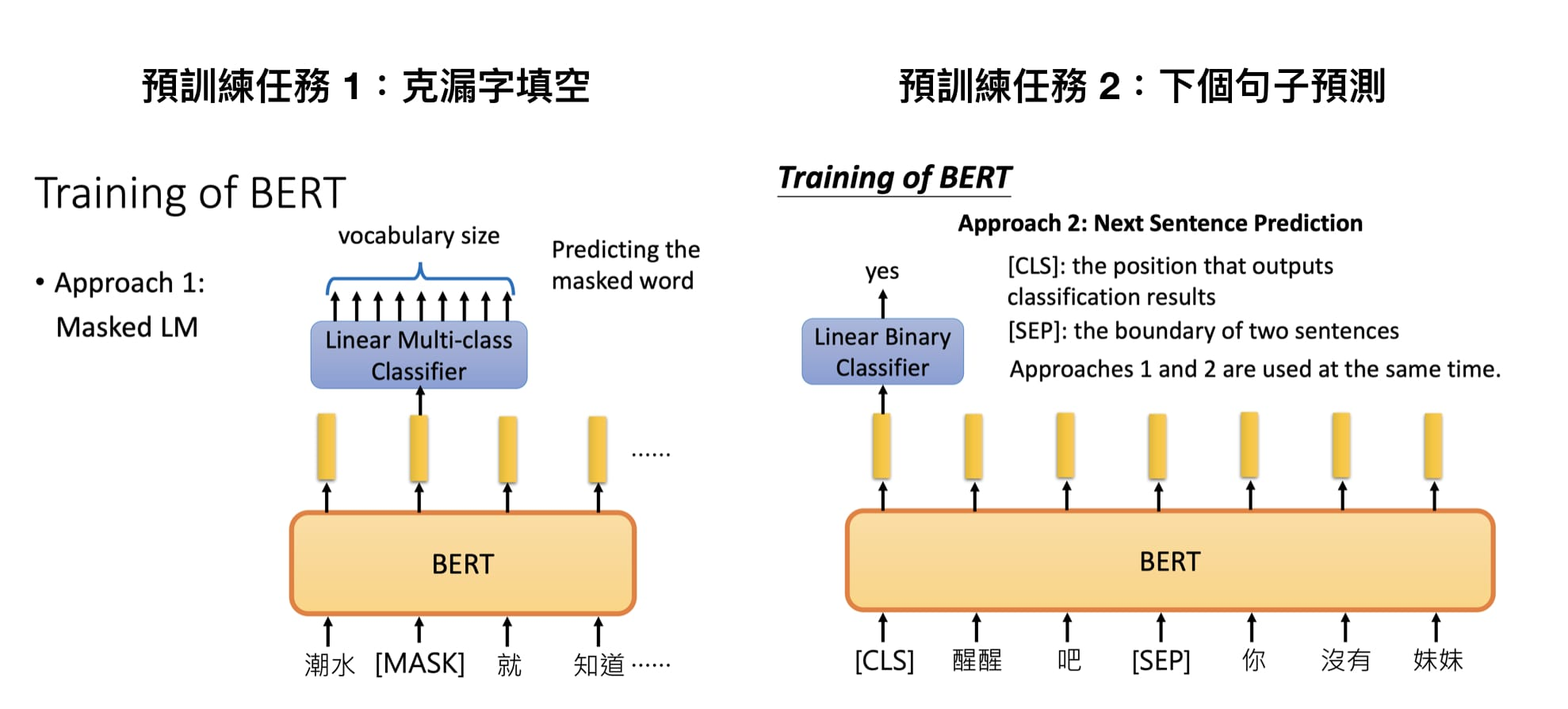

bert做填词或者做Next Sentence Prediction,其实中间训练的过程就是在读懂这个字的意思,通过上下文读懂了这个词的意思,所以得以做填词或者Next Sentence Prediction。

训练好的参数,得出输出的向量就代表这个词的意思

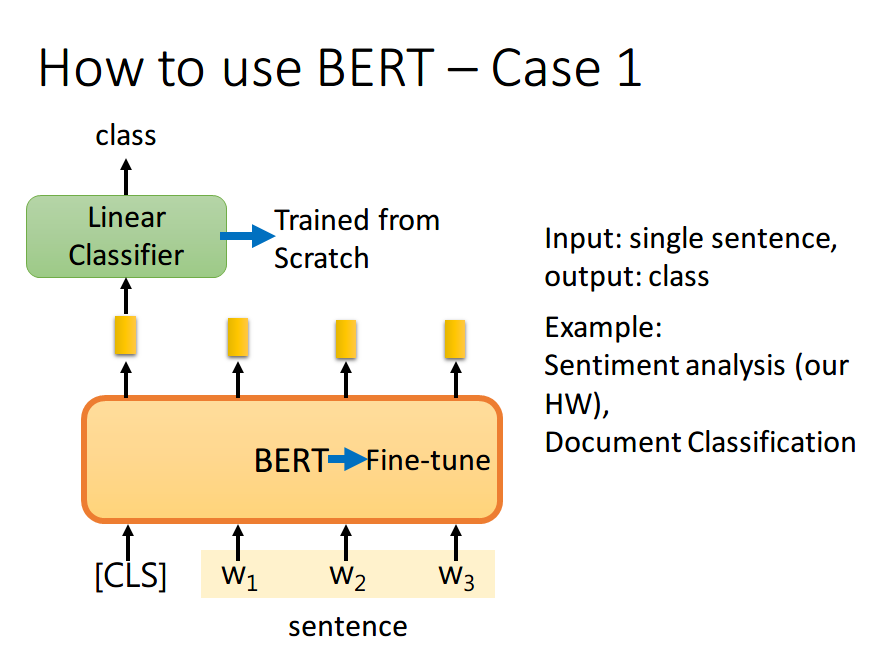

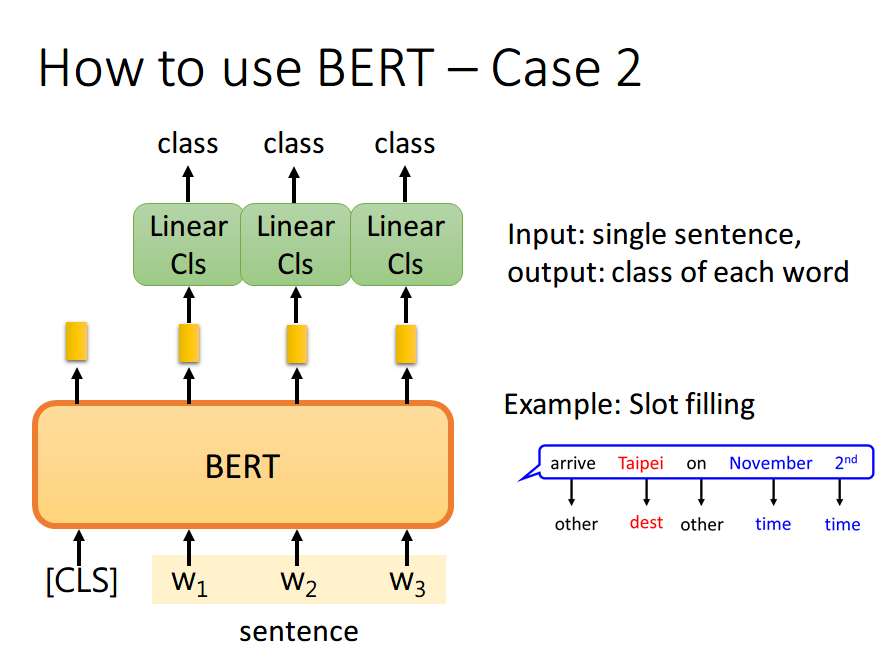

Fine-Tuning微调:过程是对参数进行再训练,然后用作bert的下游任务,bert的类型分为下面四种:

1.句子分类

2.单词分类

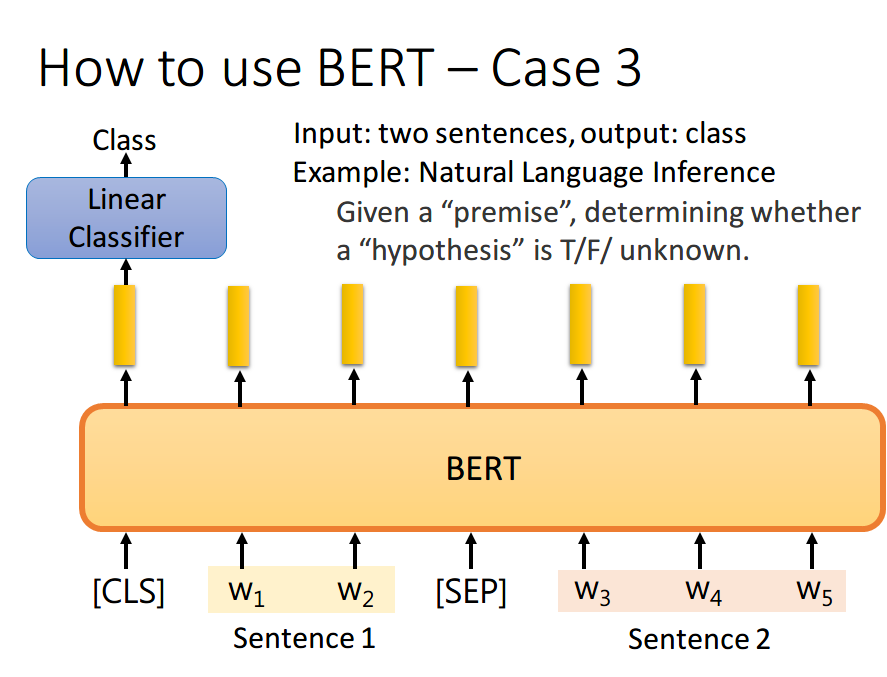

3.如果现在的任务是 NLI(自然语言推理)。即给定一个前提,然后给出一个假设,模型要判断出这个假设是 正确、错误还是不知道。这本质上是一个三分类的问题,和 Case 1 差不多,对 [CLS] 的 output 进行预测即可

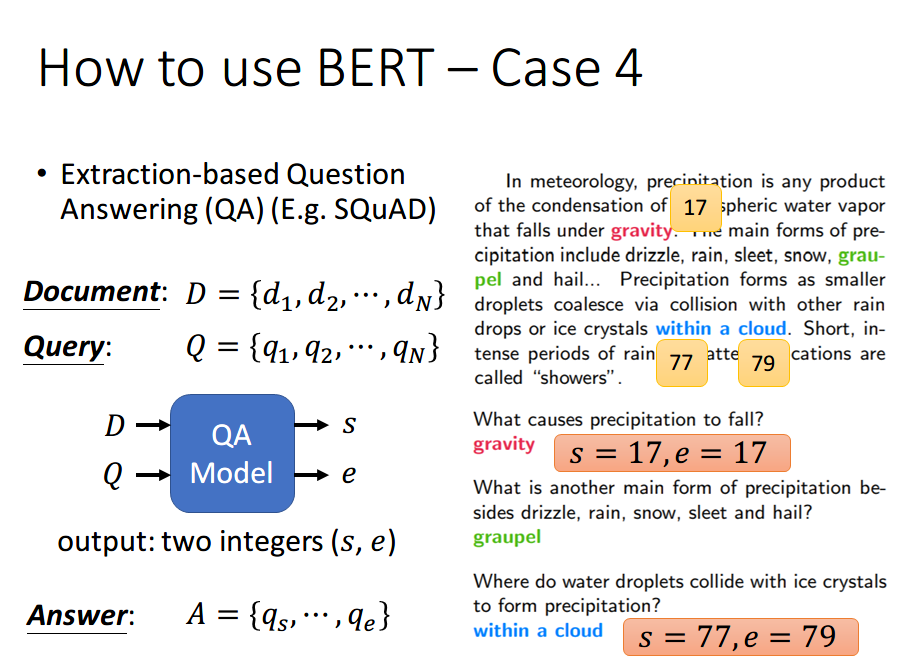

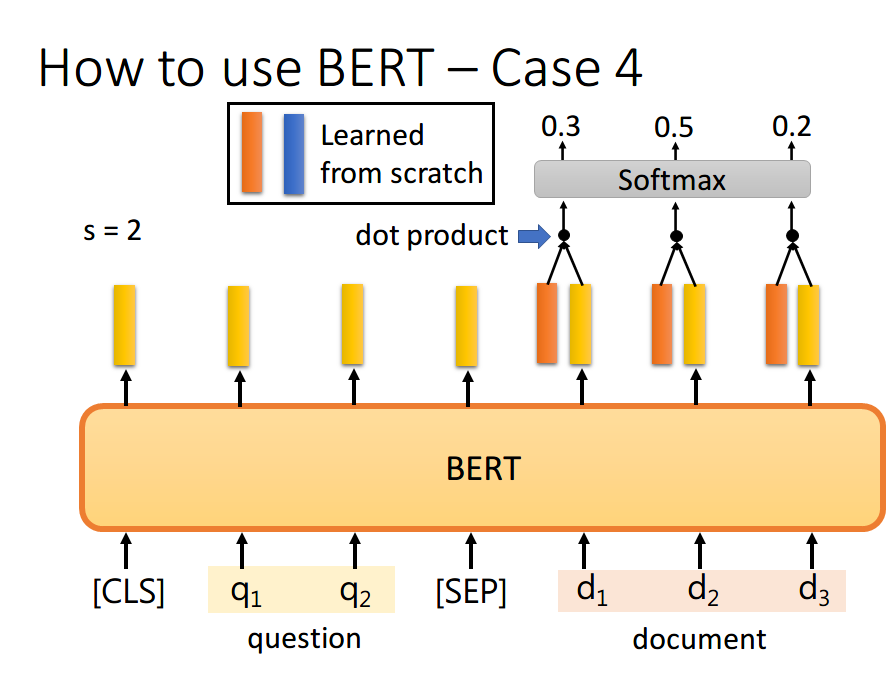

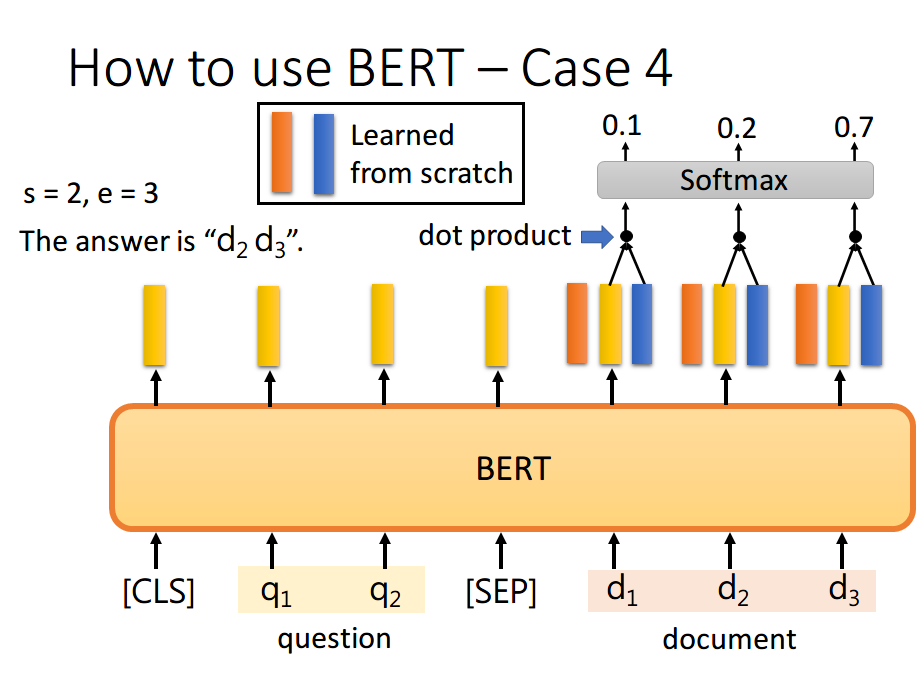

4.问答

BERT模型通过训练理解词汇的上下文含义,常用于填词任务、句子分类、单词分类和自然语言推理(NLI)等。在NLI中,模型判断假设是否符合前提,是一个三分类问题。此外,BERT还可应用于问答系统,经过Fine-Tuning微调适应不同下游任务。

BERT模型通过训练理解词汇的上下文含义,常用于填词任务、句子分类、单词分类和自然语言推理(NLI)等。在NLI中,模型判断假设是否符合前提,是一个三分类问题。此外,BERT还可应用于问答系统,经过Fine-Tuning微调适应不同下游任务。

1838

1838

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?