大家好!让我们开始今天的学习吧!芜湖!起飞!

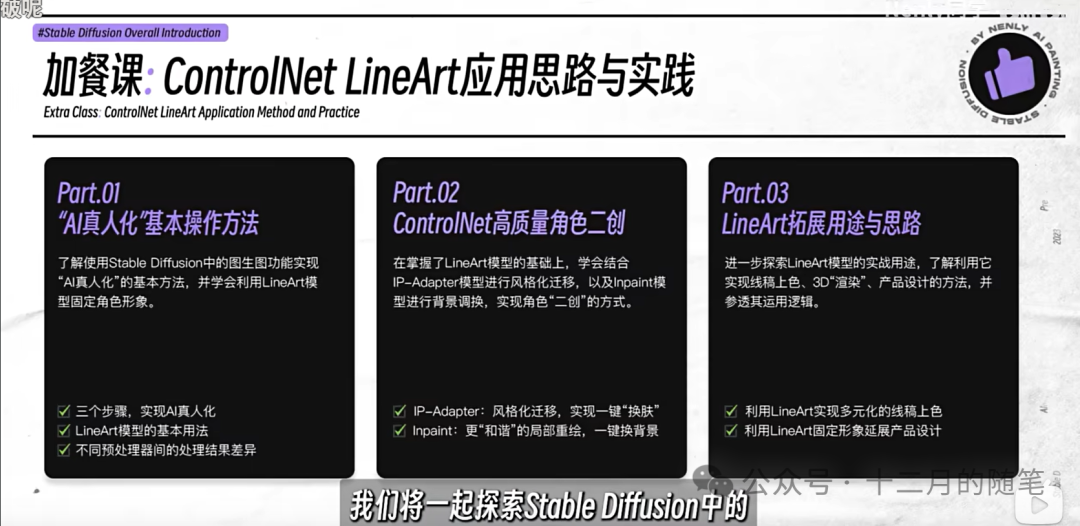

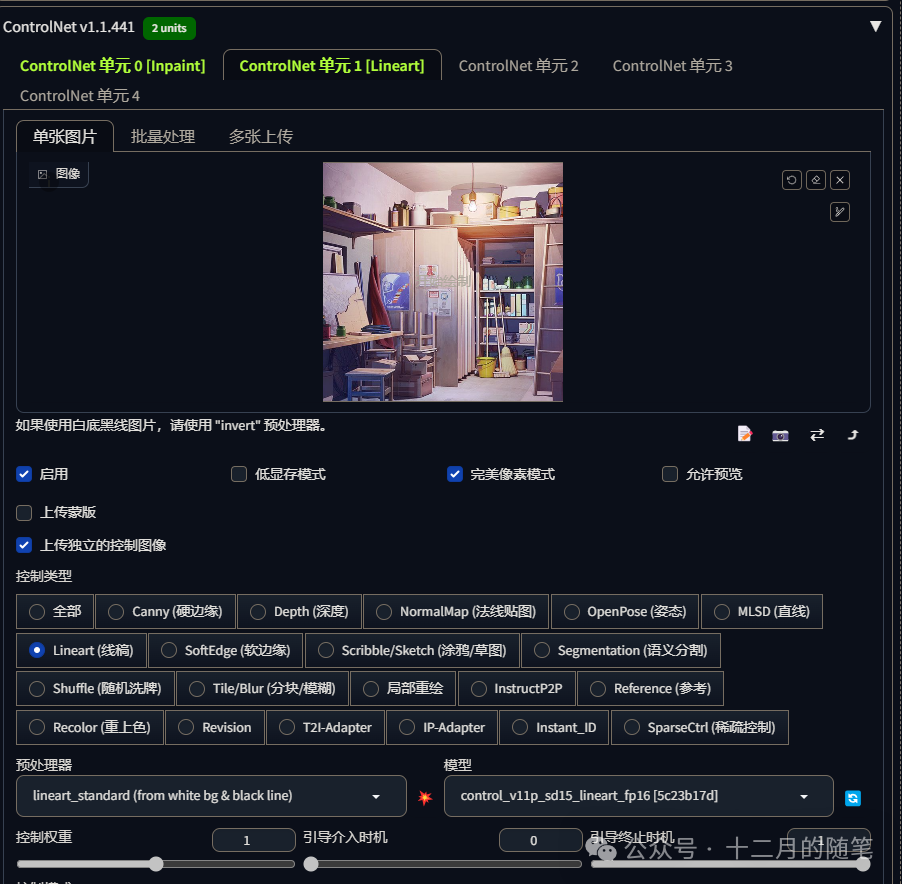

今天我们学习的是用ControlNet LineArt 的扩展使用

一、动漫角色的真人化

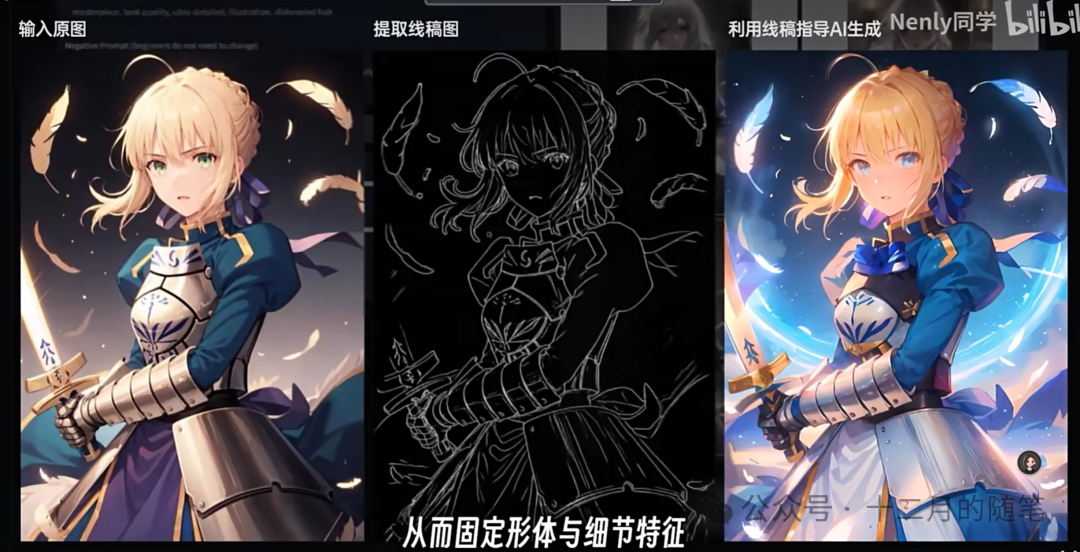

lineart的作用就是提取图片中的线稿,然后基于线稿重新作画

让我们试一下

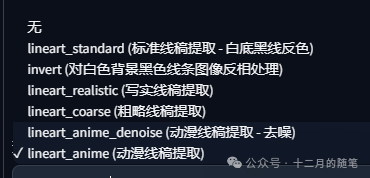

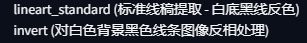

讲一下预处理器的参数效果

二次元提取线稿选这两个

去噪的版本更加清晰

适用于真人图像提取线稿

这两个适用于白底黑线,也就是普通的线稿图

这个比较少用,如果你不想让画面死扣的话就用这个

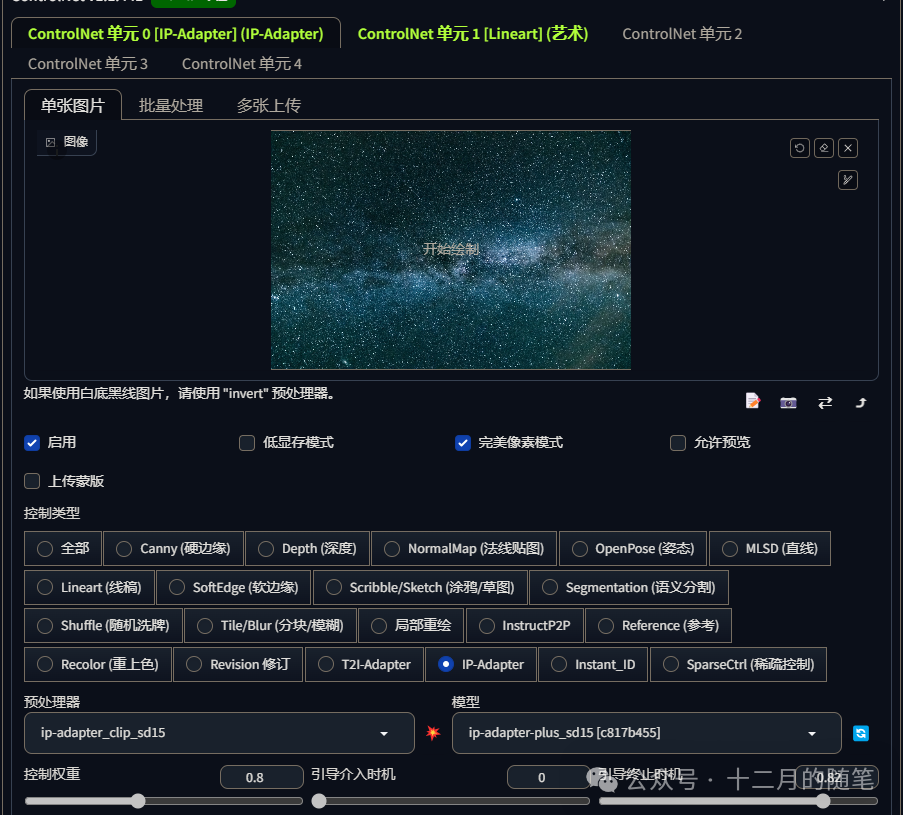

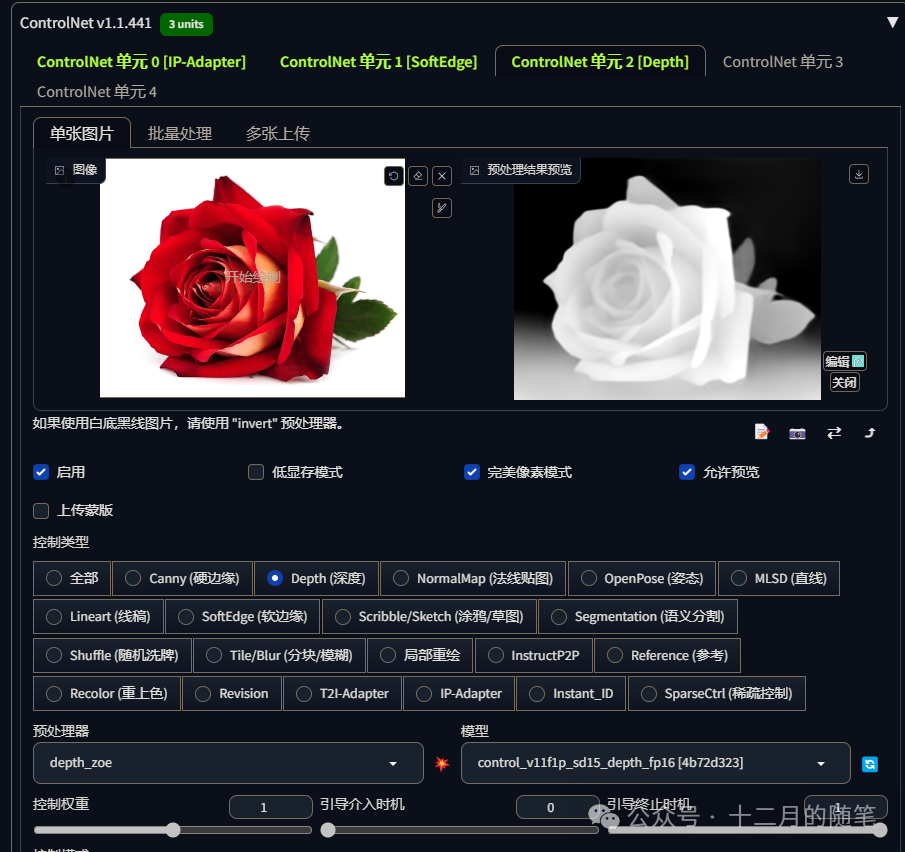

使用lineart开启完美像素模式

选用的角色是可爱的可莉

通过tag器反推提示词

嗯。。。

后面看过来其实这张很不错了。。

否则就是–》

你别说五官还挺完整的就是不知道为什么怪吓人的

有时候一个人憋笑挺无力的。。。

所以二次转三次最好不要选择幼态的()

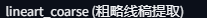

二、 IP Adapter

这一步我卡了两天,今天花了至少一个上午和一半的下午在解决这件事情

由于forge版本的SD安装路径和webUI路径不同

导致我调试了很多遍都没有成功

最后尝试的是使用旧版本webUI安装,没想到终于成了

在这个大量翻阅资料的过程中我也了解了ip-adapter的其他用法

-

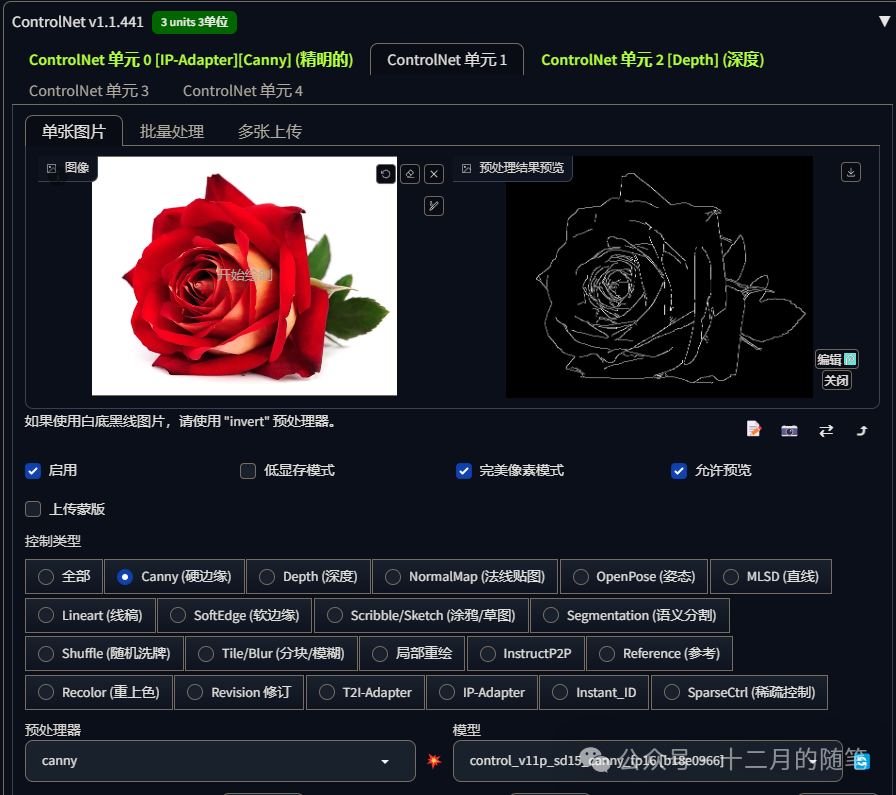

风格迁移

文生图中在controlnet中选用ipadapter

导入风格参考图

权重设置为0.8防止过度学习

通过tag反推器生成角色ip的外形描述,并发送到文生图中

记得删除提示词中的颜色提示词,防止干扰

开启第二个controlnet使用lineart提取线稿

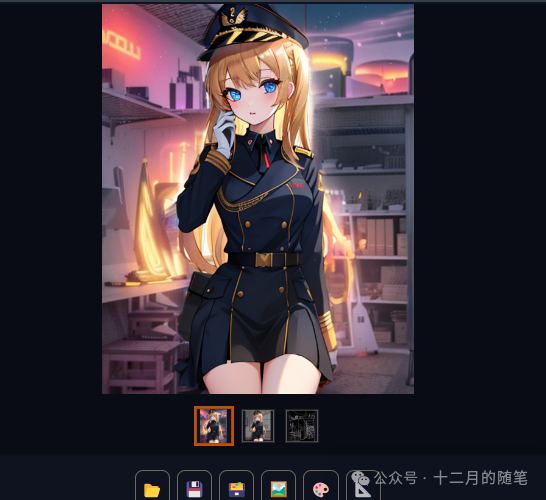

经过调试之后,可爱的星空可莉诞生啦

这个皮肤还挺好看的(就是手有小瑕疵)

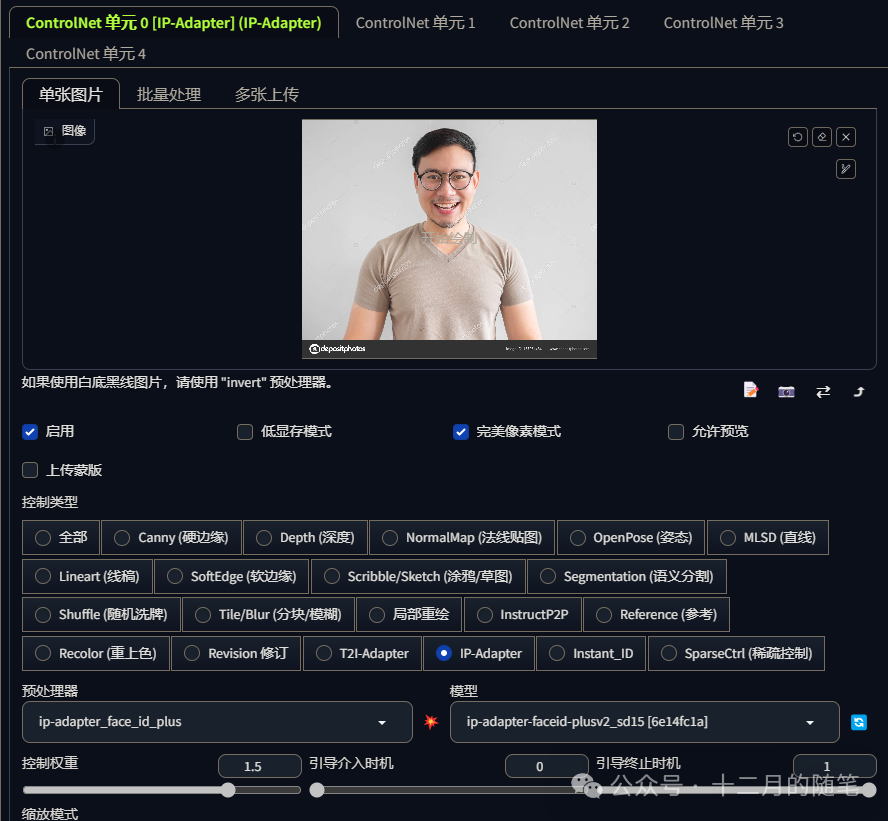

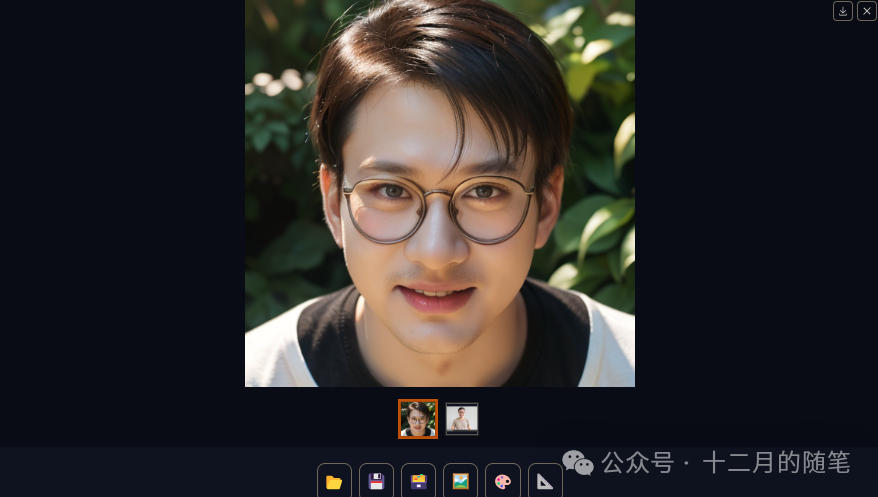

2.人脸替换

如图,选择使用face-ipadapter

输入适当的提示词

出图结果

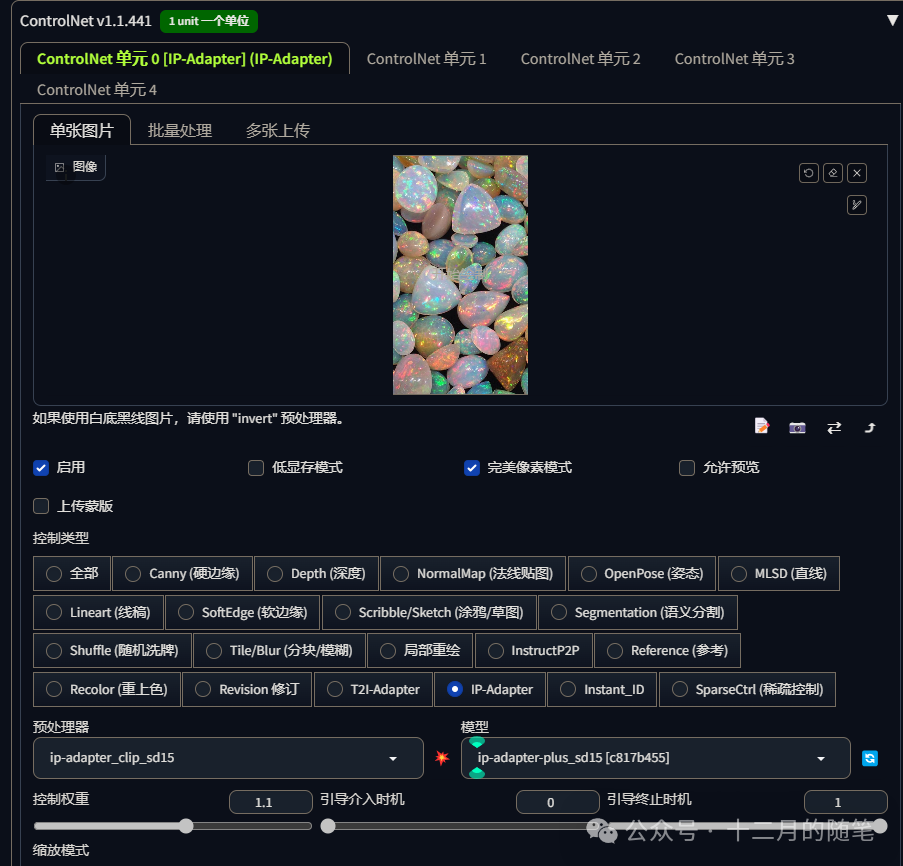

3.材质迁移

如图所示开了三个controlnet

注意ipadapter不要选择face版本的否则会报错

成图

三、RMBG插件的使用(remove back ground)

不得不说每次下载插件就像是渡劫的感觉,已经尝试了半天了

另外我觉的我需要补一下硬件知识了

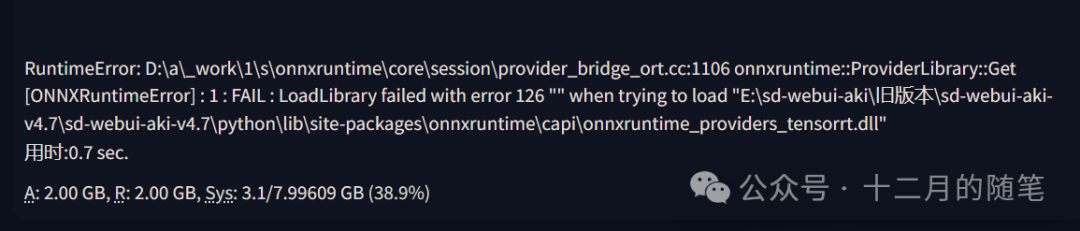

各种报错

这已经远超我的能力范围了

我已经把网上现有的解决方案

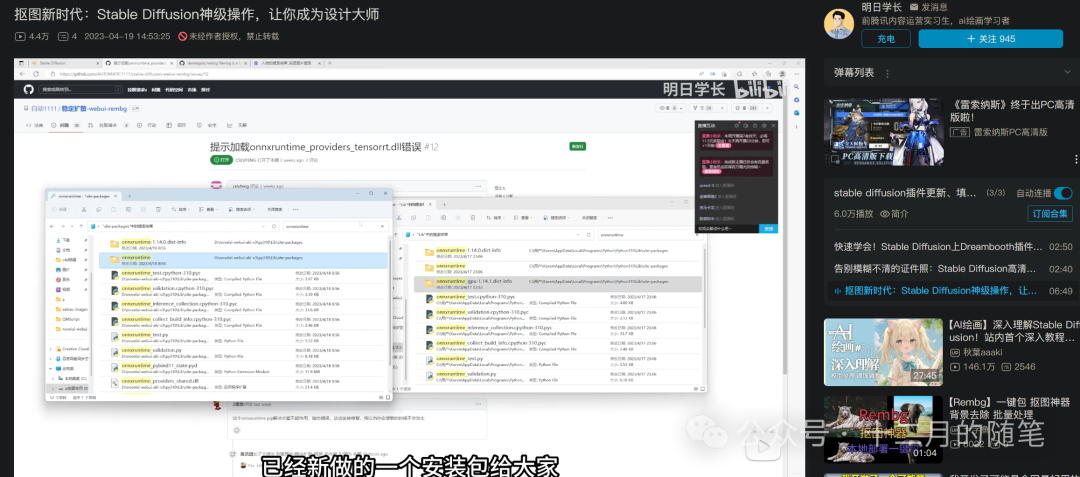

看到很多教程都是专门对于comfiui做适配

我后面学习这个的时候再安装吧

!!!!!

我去我终于弄好了!!!

啊啊啊

感动流涕啊啊啊啊啊

方法是将原有的文件onnxruntime删除,下载一个大佬的py文件

自动下载对应插件

大佬指路

好继续学习

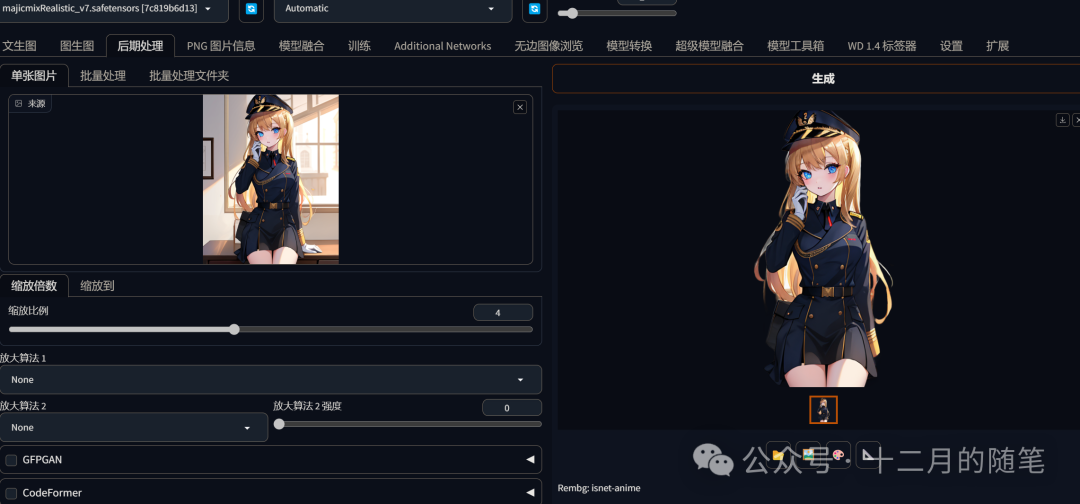

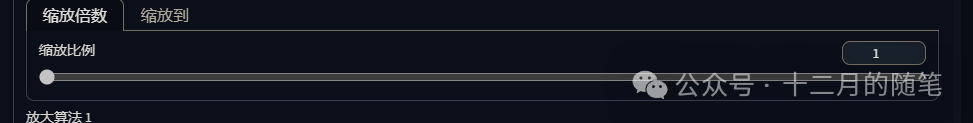

一般我们设置缩放比例为1

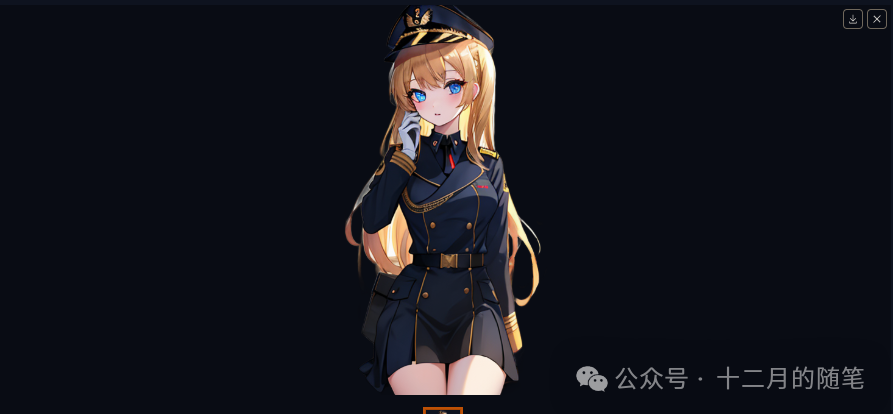

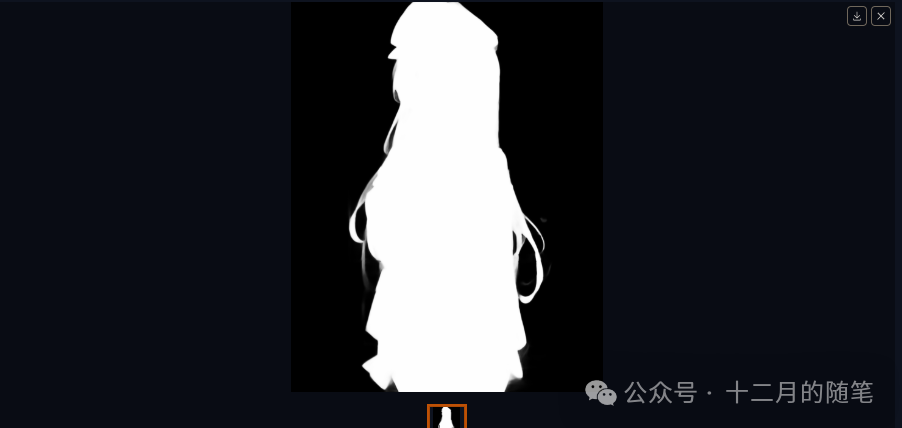

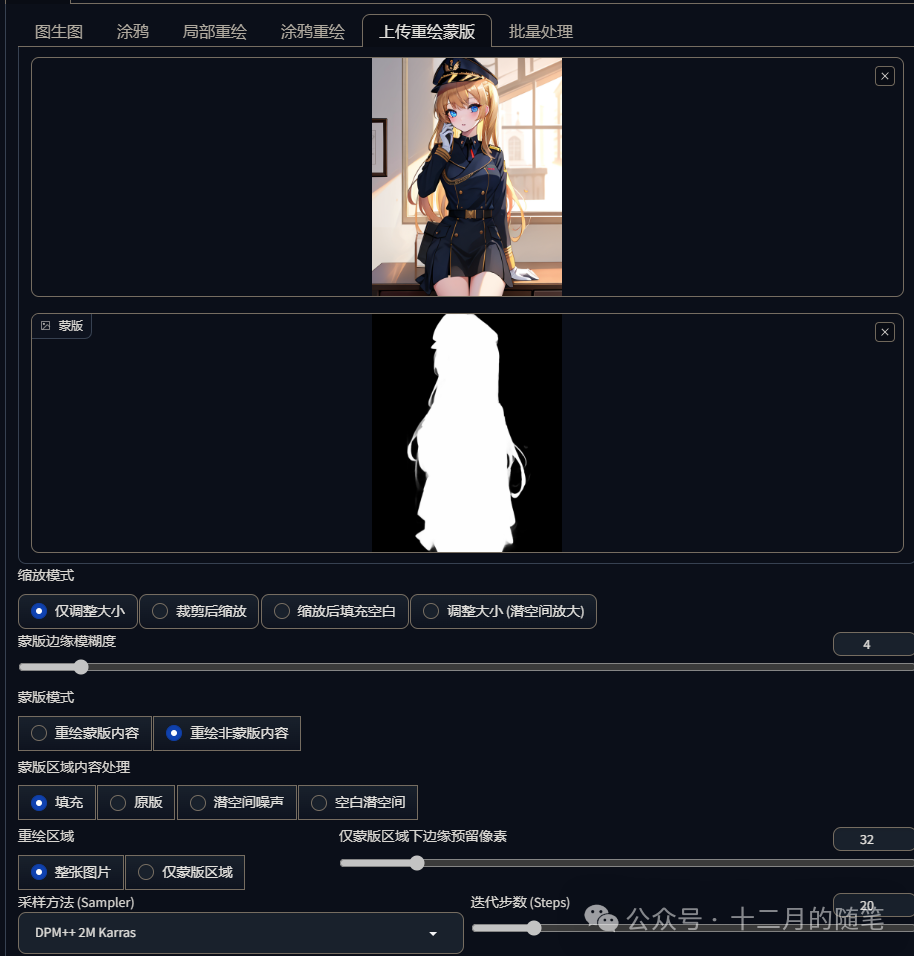

吐出需要抠出的人像之后点击回送蒙版可以生成黑白图片

然后打开图生图

选择蒙版重绘

选择重绘非蒙版区域

填充

调满重绘幅度

为了让人物和背景衔接流畅需要使用controlnet的局部重绘

成图

如果有需要特定的背景,并有相应的图像可以再开一个controlnet的lineart

成图

后面回顾发现这里的模型选择成真实系了

如果使用二次元画风应该会更好

四、线稿生图的运用

如图,使用lineart

用可莉的反推词作为提示词

已经可以生成很不错的效果了

这期教程我真的是花了很大力气

主要是在各种插件debug上

但是也肉眼可见的,学会了耐心,一次次尝试

关于AI绘画技术储备

学好 AI绘画 不论是就业还是做副业赚钱都不错,但要学会 AI绘画 还是要有一个学习规划。最后大家分享一份全套的 AI绘画 学习资料,给那些想学习 AI绘画 的小伙伴们一点帮助!

对于0基础小白入门:

如果你是零基础小白,想快速入门AI绘画是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以找到适合自己的学习方案

包括:stable diffusion安装包、stable diffusion0基础入门全套PDF,视频学习教程。带你从零基础系统性的学好AI绘画!

零基础AI绘画学习资源介绍

👉stable diffusion新手0基础入门PDF👈

(全套教程文末领取哈)

👉AI绘画必备工具👈

温馨提示:篇幅有限,已打包文件夹,获取方式在:文末

👉AI绘画基础+速成+进阶使用教程👈

观看零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

温馨提示:篇幅有限,已打包文件夹,获取方式在:文末

👉12000+AI关键词大合集👈

这份完整版的AI绘画全套学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

2005

2005

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?