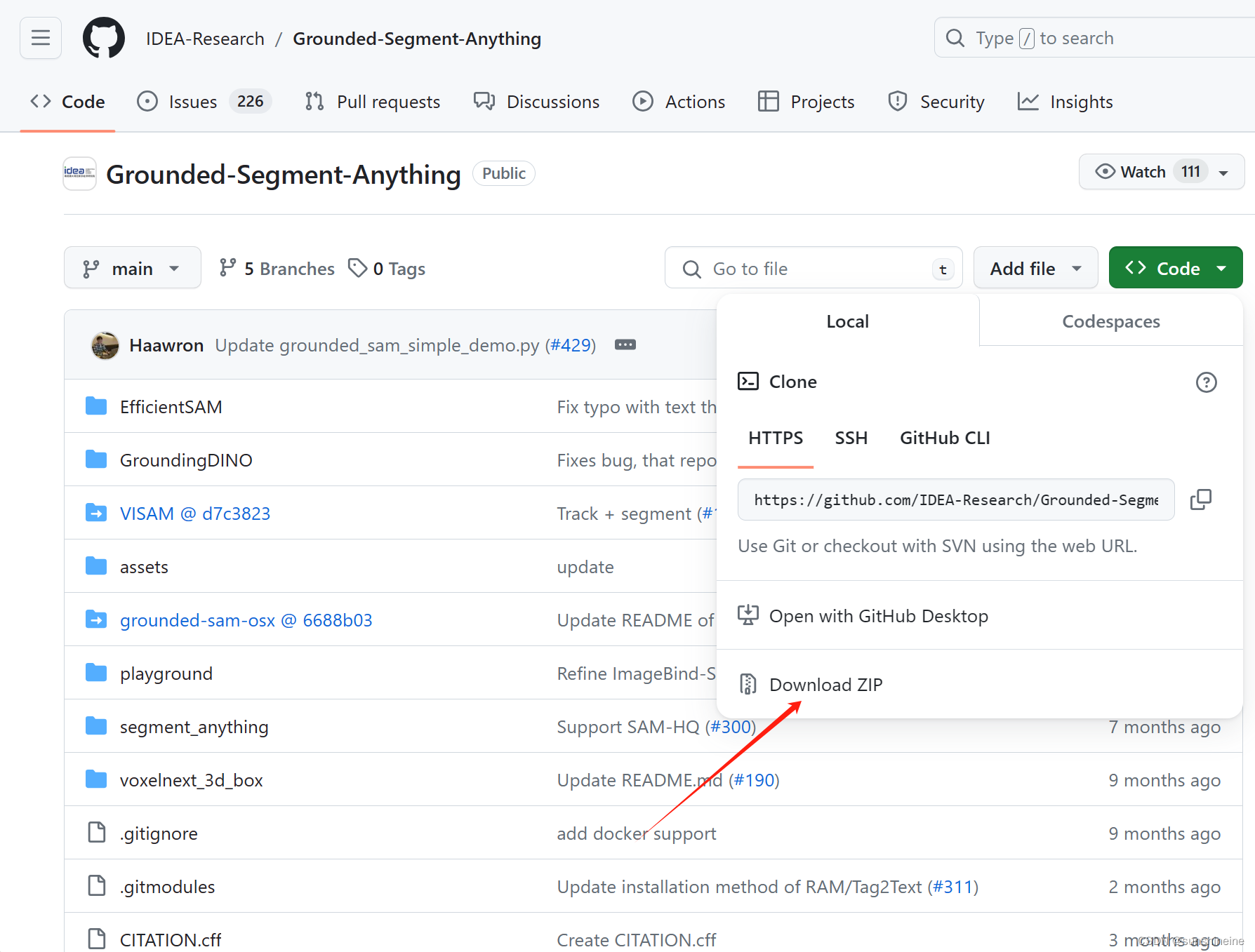

一、文件下载

1. 官网代码下载

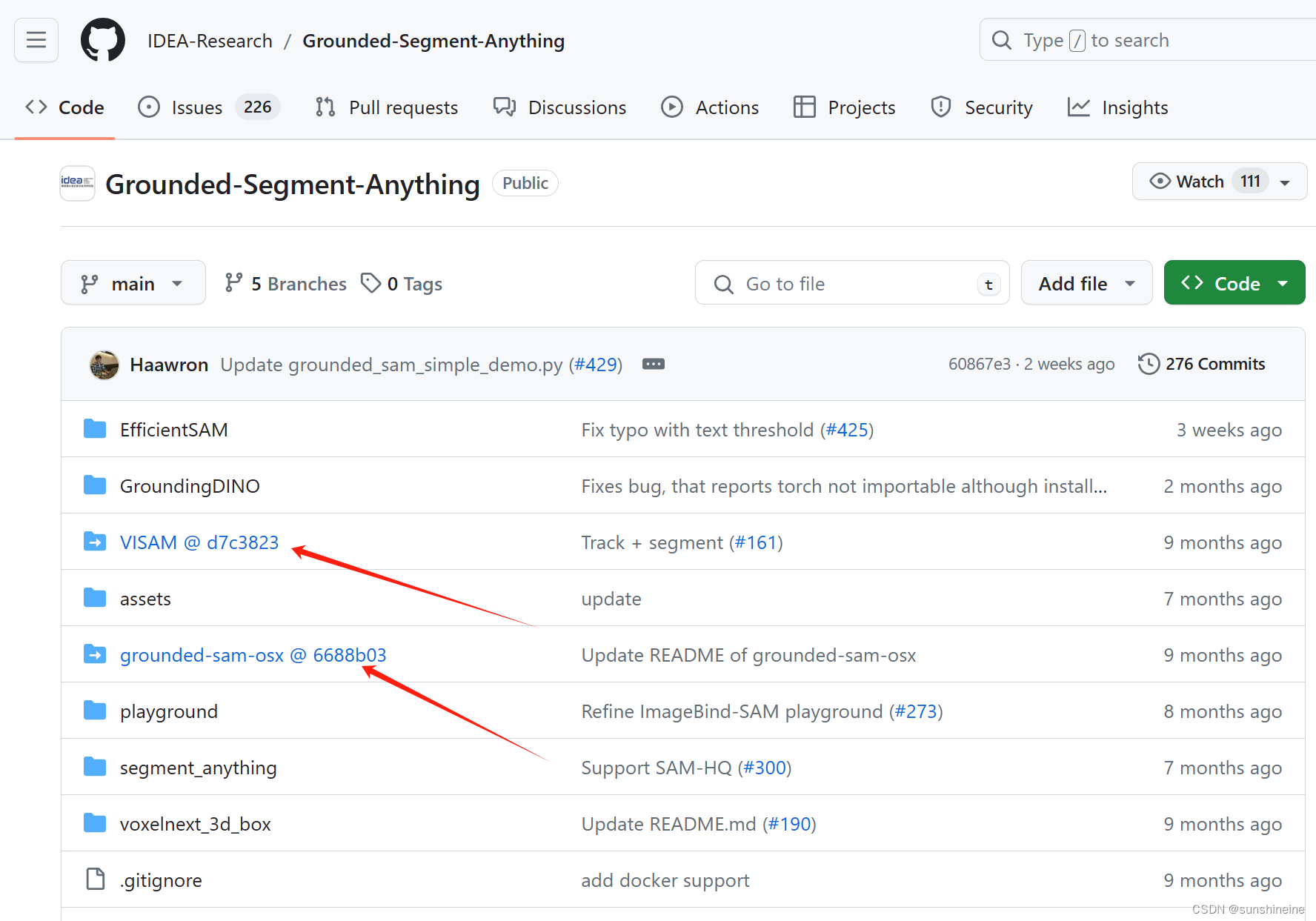

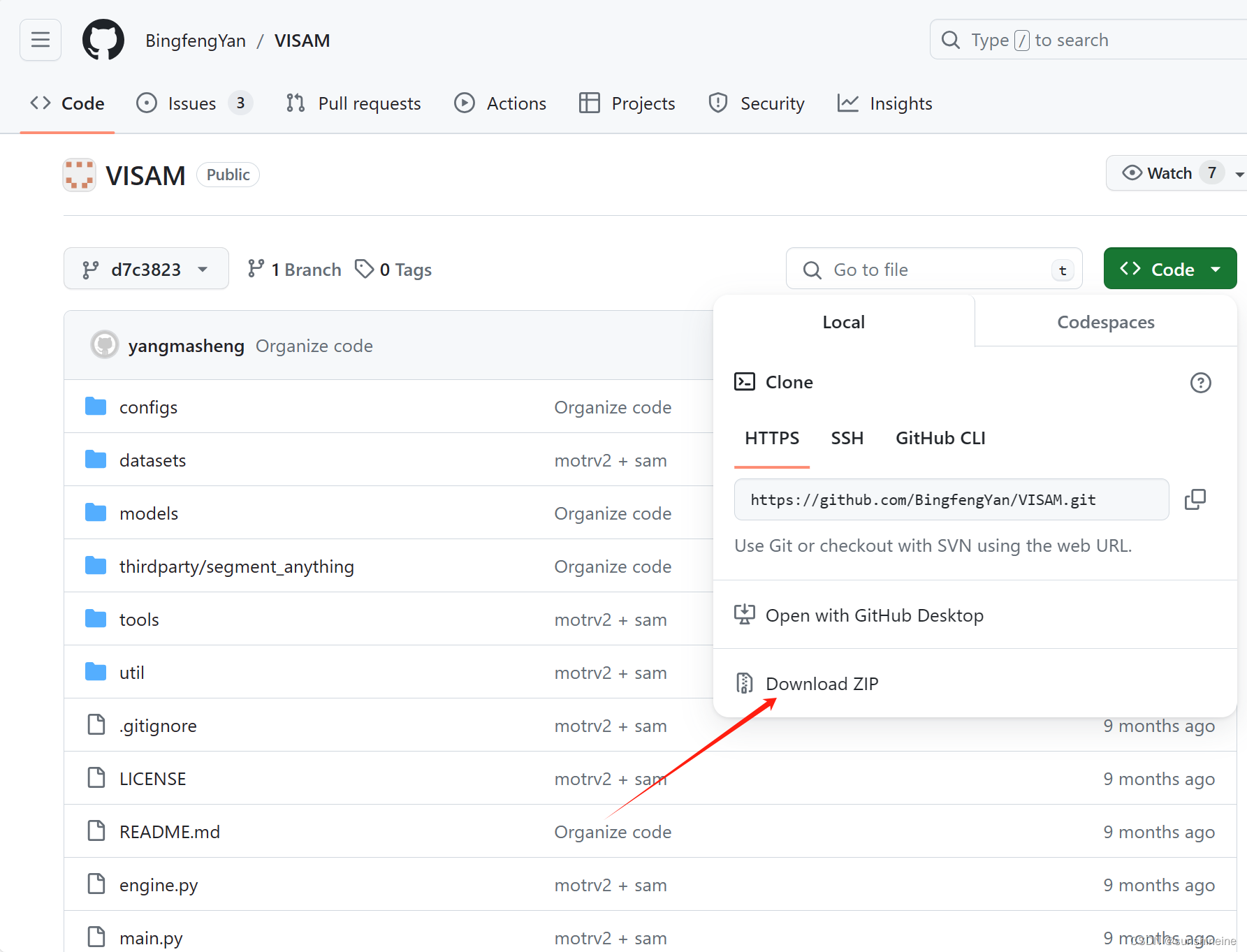

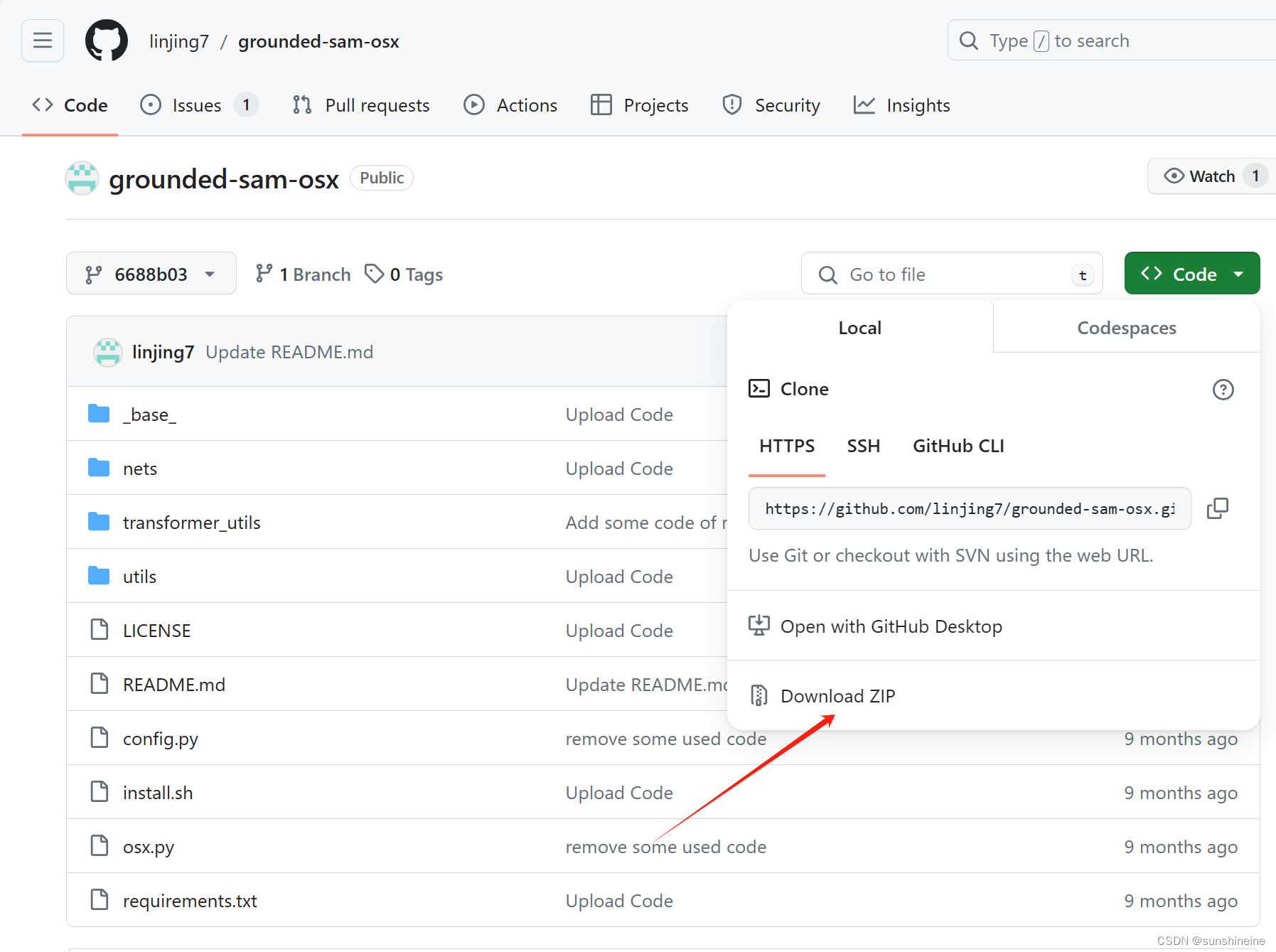

2. 下载引用的库

下载以下两个引用的库,下载好后放在文件夹对应的位置

VISAM:BingfengYan/VISAM at d7c38233882ff9d34d5cbecb8495e175e4dffc8c (github.com) https://github.com/BingfengYan/VISAM/tree/d7c38233882ff9d34d5cbecb8495e175e4dffc8cgrounded-sam-osx:linjing7/grounded-sam-osx at 6688b036c7856a302f9315bb16864d66fb2cdade (github.com)

https://github.com/BingfengYan/VISAM/tree/d7c38233882ff9d34d5cbecb8495e175e4dffc8cgrounded-sam-osx:linjing7/grounded-sam-osx at 6688b036c7856a302f9315bb16864d66fb2cdade (github.com) https://github.com/linjing7/grounded-sam-osx/tree/6688b036c7856a302f9315bb16864d66fb2cdade

https://github.com/linjing7/grounded-sam-osx/tree/6688b036c7856a302f9315bb16864d66fb2cdade

二、环境安装

1. 环境要求

python>=3.8, pytorch>=1.7, torchvision>=0.8

我的环境:python=3.8, pytorch=1.12.0, torchvision=0.13.1,cuda=11.3

2. pip安装

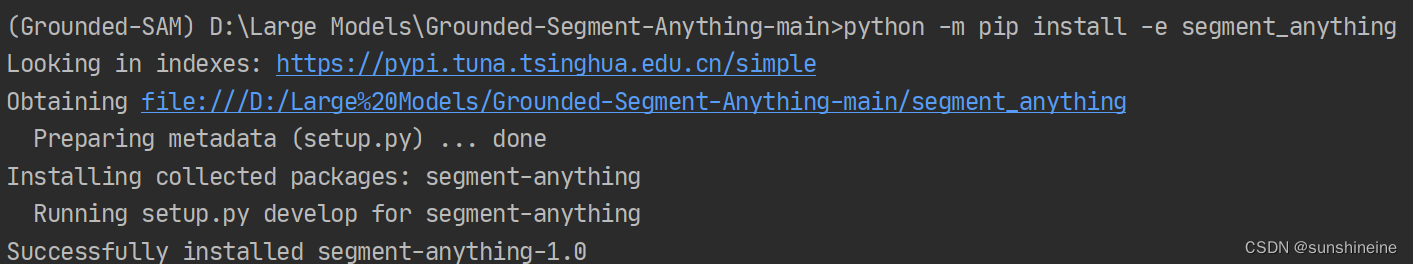

2.1 安装segment_anything

终端输入python -m pip install -e segment_anything

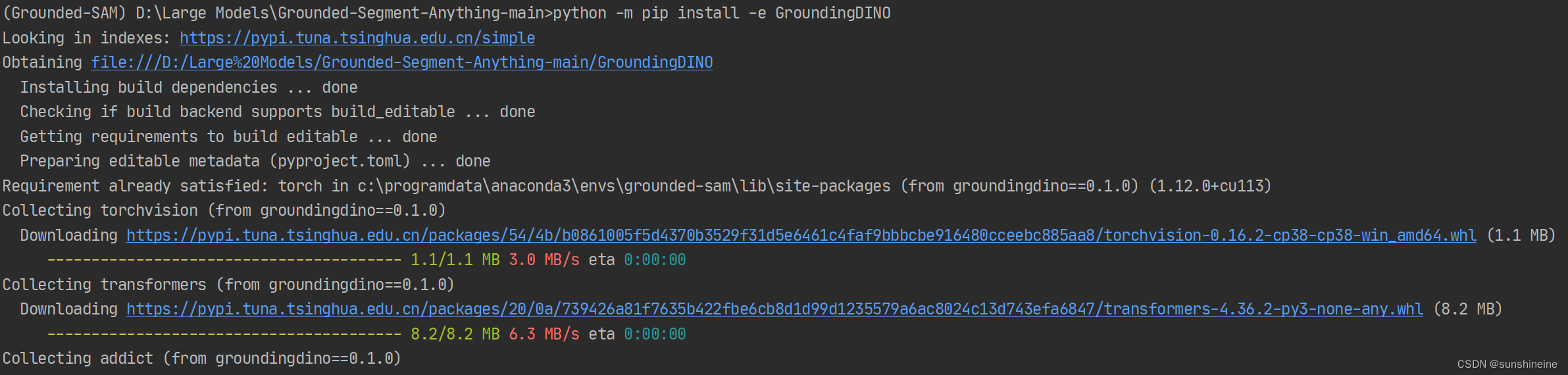

2.2 安装GroundingDINO

终端输入python -m pip install -e GroundingDINO(时间有点长,耐心等待)

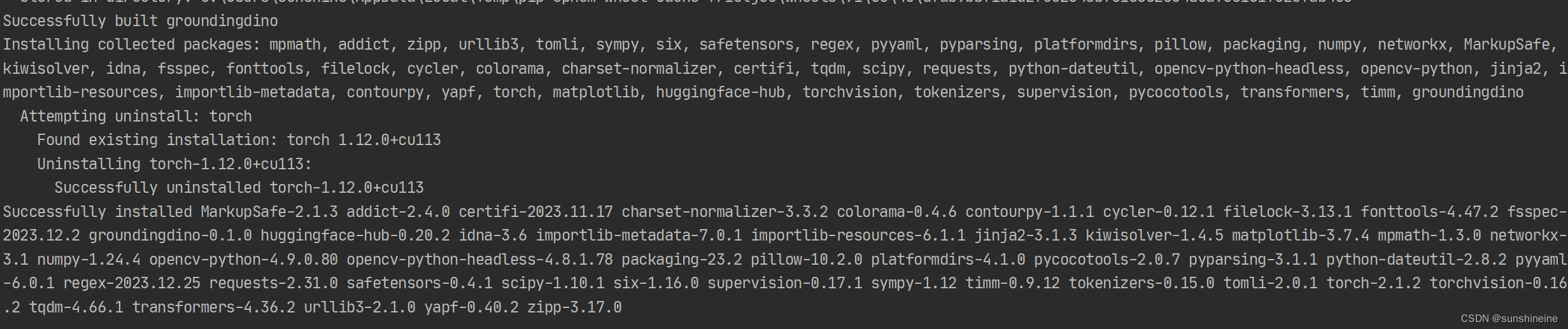

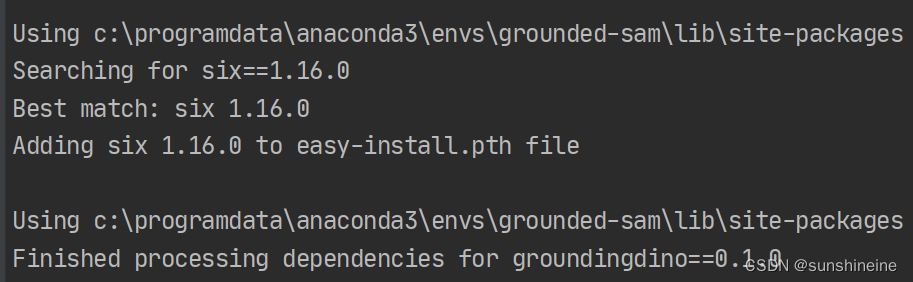

最后出现如下即为下载成功

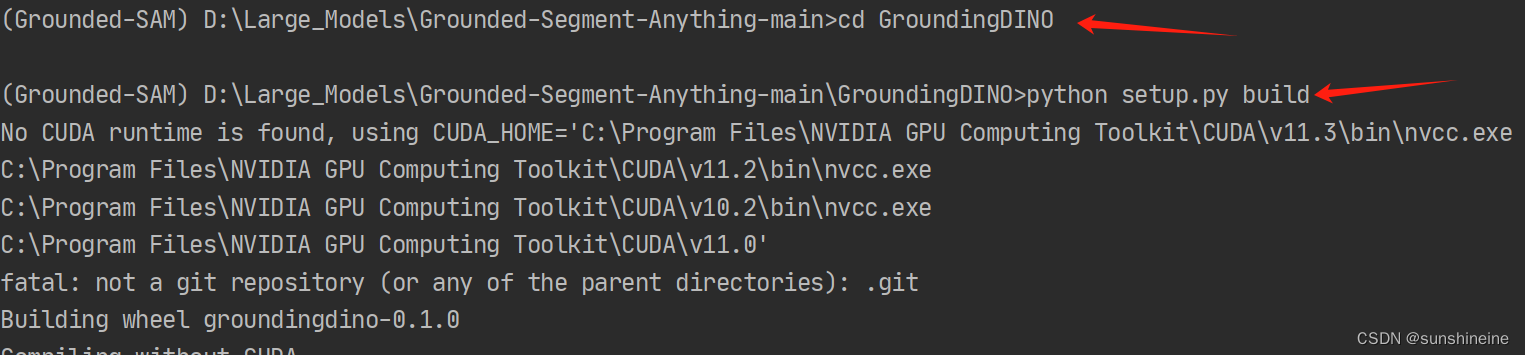

安装依赖项,进入到GroundingDINO,执行如下命令

cd GroundingDINO

python setup.py build

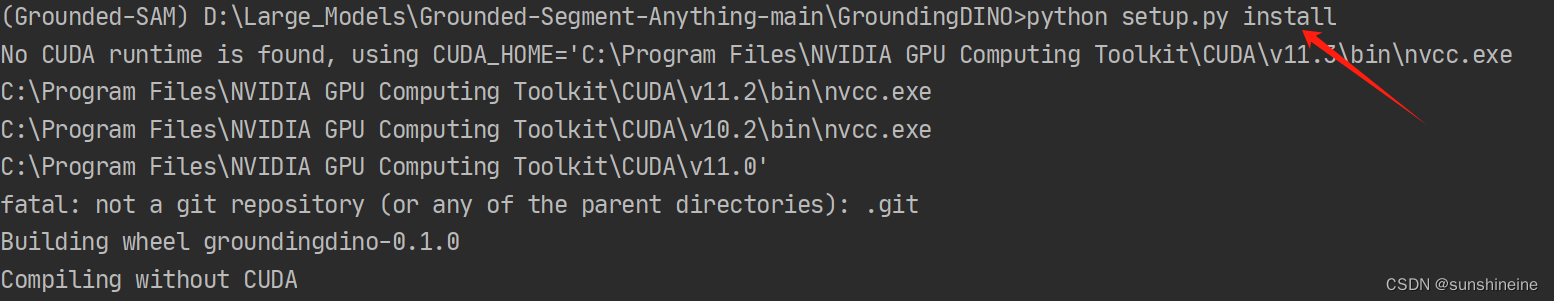

python setup.py install

出现如下结果即为安装成功

2.3 安装diffusers

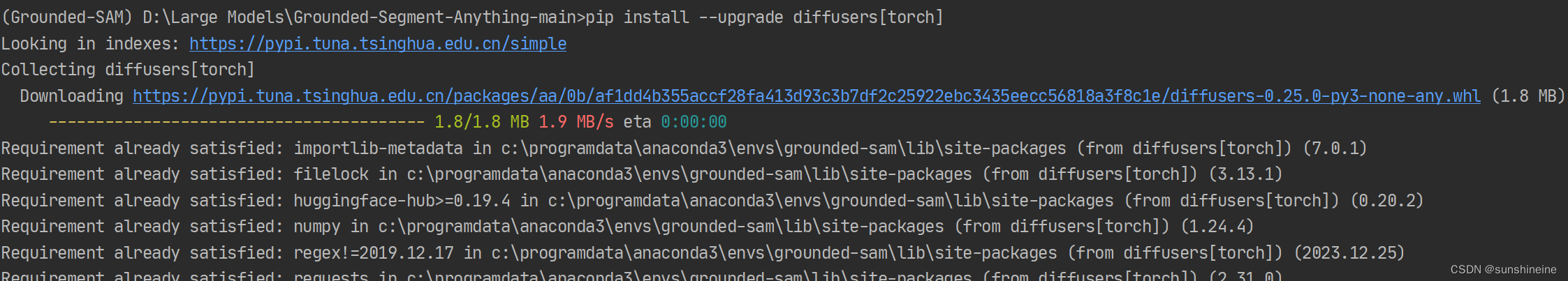

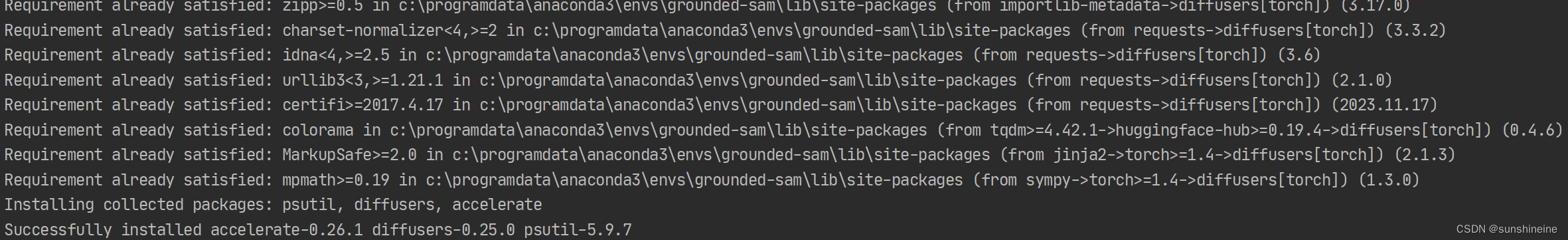

终端输入pip install --upgrade diffusers[torch]

最后出现如下即为下载成功

2.4 安装grounded-sam-osx

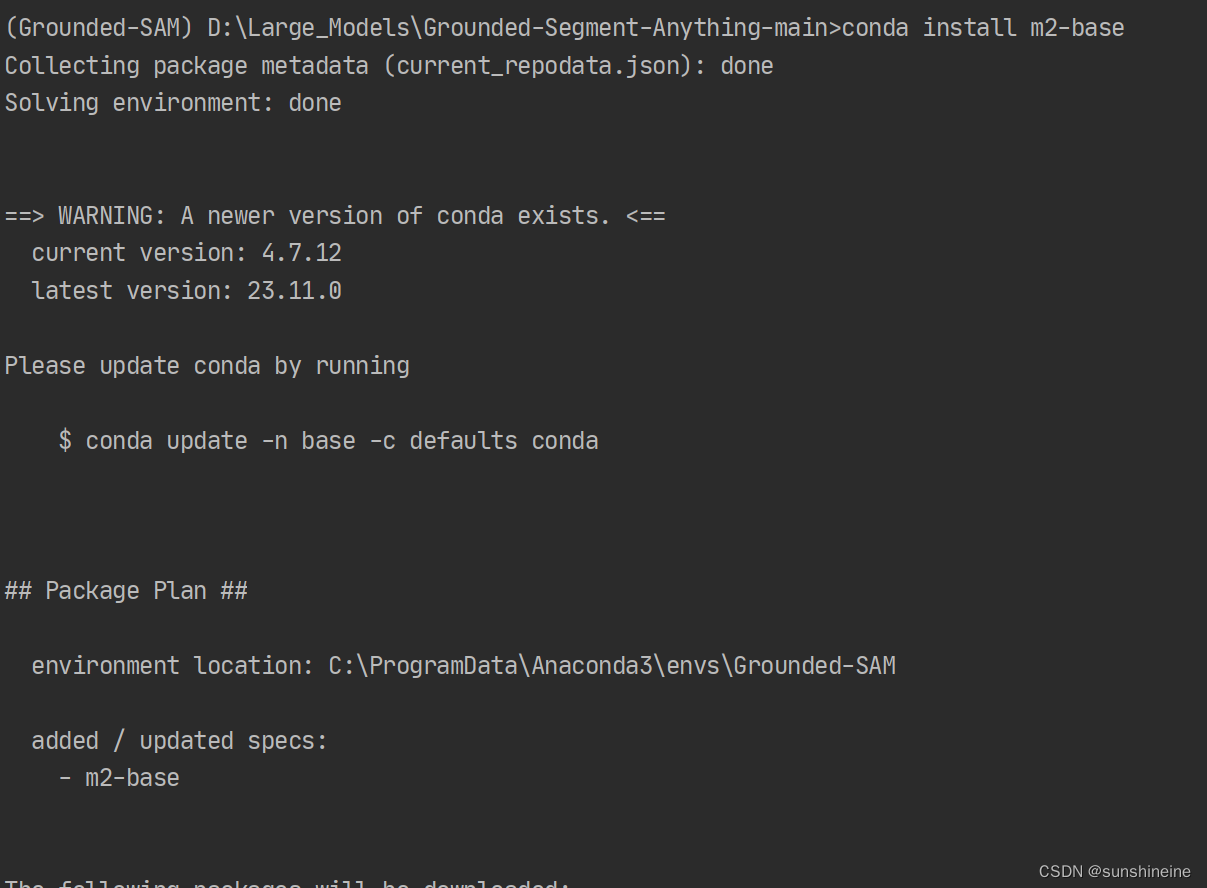

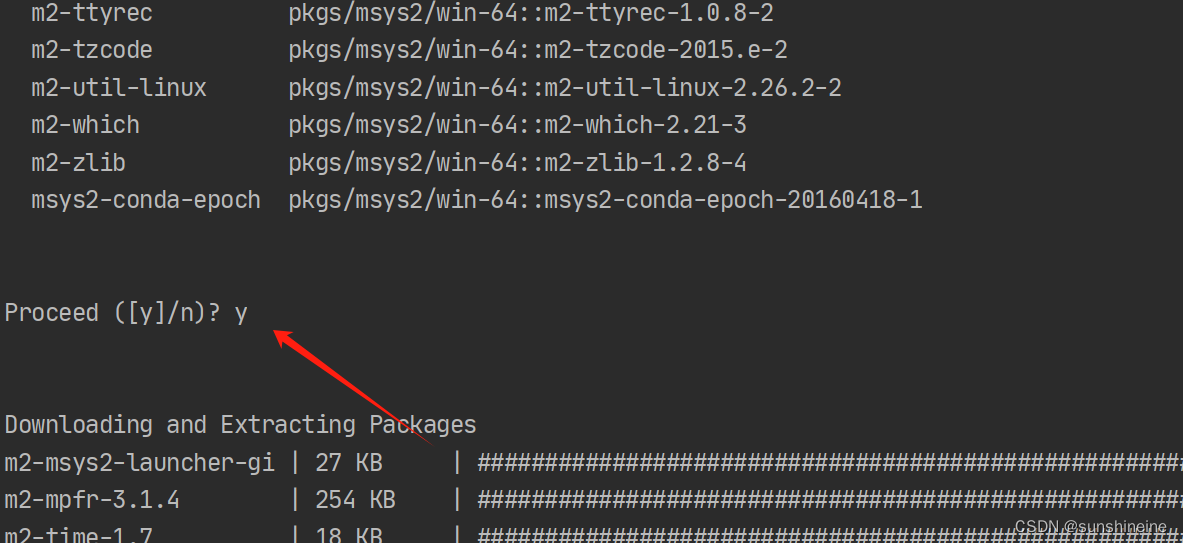

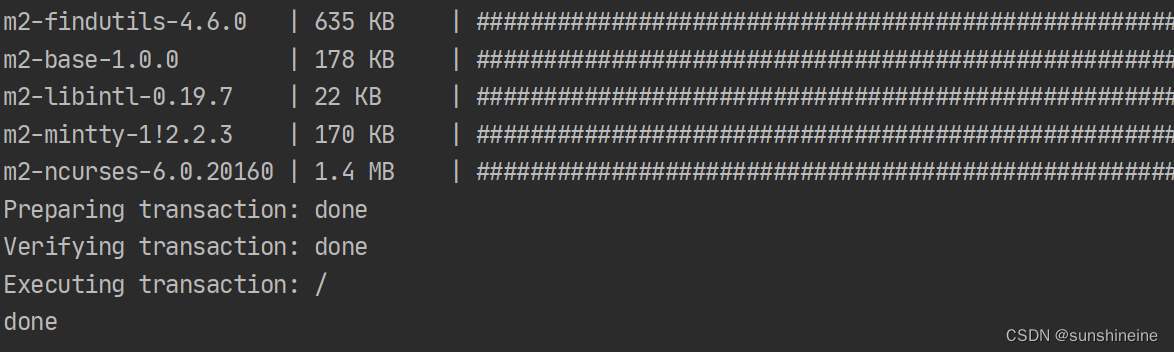

终端输入conda install m2-base,方便后续使用bash命令可在windows环境下使用Linux命令

出现这个时输入y

最终出现这个即为安装成功

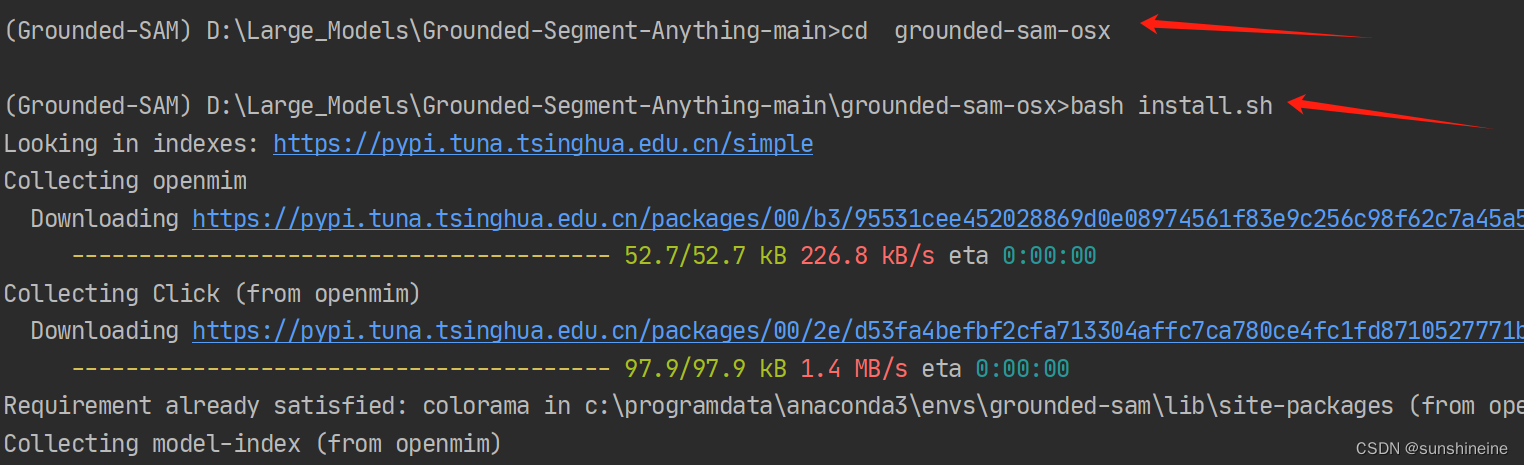

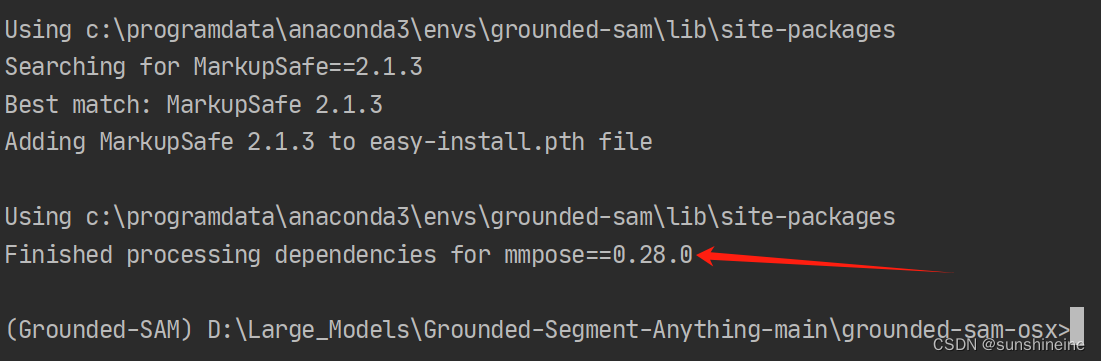

输入以下两个命令安装grounded-sam-osx

cd grounded-sam-osx

bash install.sh

出现如下即为安装成功

2.5 安装其他依赖

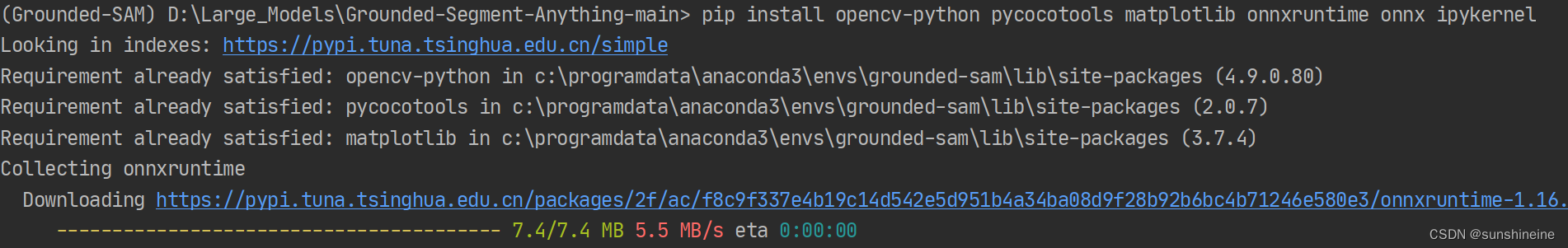

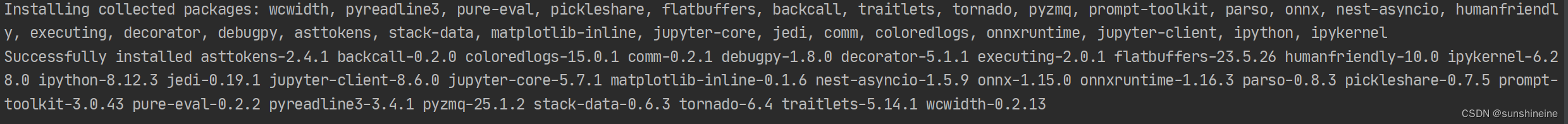

终端输入 pip install opencv-python pycocotools matplotlib onnxruntime onnx ipykernel

出现如下即为安装成功

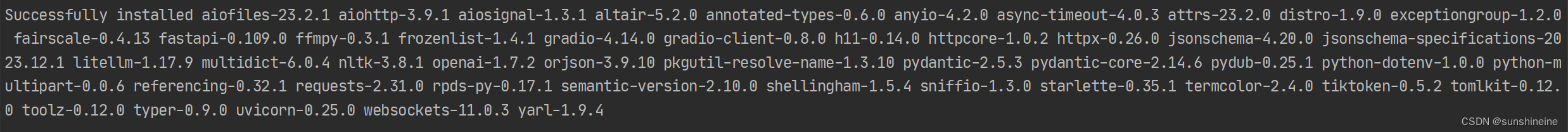

2.6 安装包

终端输入 pip install -r requirements.txt

显示如下即为安装成功

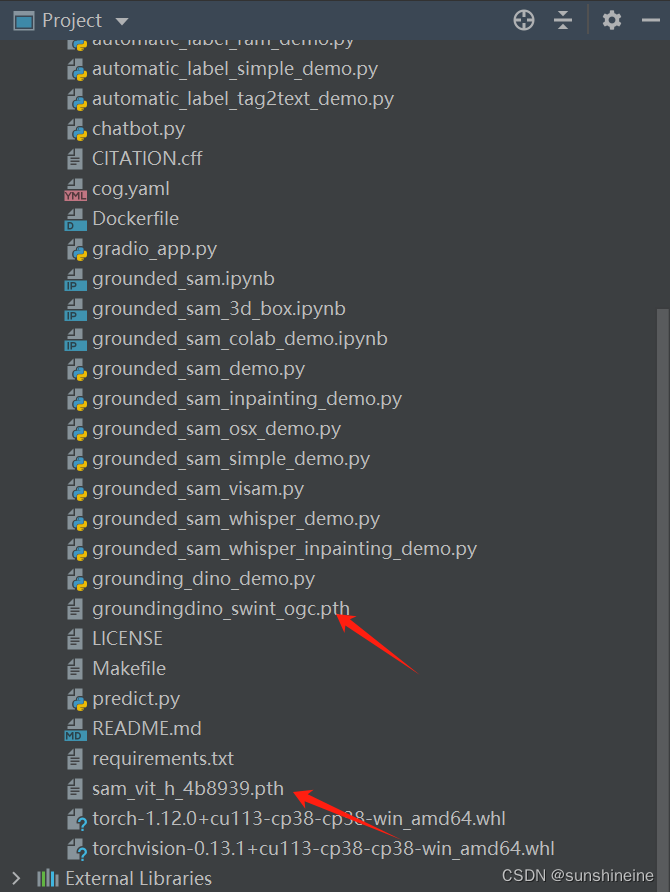

3. 权重文件下载

权重文件1:

https://github.com/IDEA-Research/GroundingDINO/releases/download/v0.1.0-alpha/groundingdino_swint_ogc.pth

权重文件2:

https://dl.fbaipublicfiles.com/segment_anything/sam_vit_h_4b8939.pth

下载好的权重文件放在Grounded-Segment-Anything目录下:

3516

3516

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?