一、深度学习为何离不开 GPU

在当今数字化时代,深度学习已然成为推动人工智能发展的核心力量,广泛应用于图像识别、语音识别、自然语言处理等诸多领域。从手机的人脸识别解锁,到智能语音助手的精准回应,深度学习的身影无处不在,深刻改变着我们的生活方式。

然而,深度学习模型的训练和推理过程涉及到海量的数据处理和极其复杂的运算,对计算能力提出了极高的要求。这就好比建造一座摩天大楼,需要大量的建筑材料和高效的施工设备,而 GPU(图形处理单元)正是深度学习这座 “摩天大楼” 背后的强大 “施工队”,其重要性不言而喻。

(一)深度学习的计算需求

深度学习模型,如卷积神经网络(CNN)、循环神经网络(RNN)及其变体长短期记忆网络(LSTM)、门控循环单元(GRU),还有近年来大放异彩的 Transformer 架构等,通常包含数百万甚至数十亿个参数。这些数据在模型中进行前向传播和反向传播计算,涉及到大量的矩阵乘法、卷积操作等复杂运算,计算量极其庞大。而且,随着模型复杂度的不断提高和数据量的持续增长,深度学习的计算需求呈指数级上升。

(二)CPU 的局限

CPU(中央处理器)作为计算机的传统核心组件,在通用计算领域发挥着重要作用。然而,面对深度学习的巨大计算挑战,CPU 逐渐显得力不从心。CPU 的设计初衷主要是为了处理复杂的逻辑控制和通用计算任务,其核心数量相对较少,虽然每个核心的性能强大,但擅长的是串行计算,即在同一时间只能处理一个或少数几个任务。

在处理深度学习任务时,CPU 的核心数量限制了其并行处理能力,无法同时处理大量的数据和复杂的运算。

(三)GPU 的优势

与 CPU 形成鲜明对比的是,GPU 在深度学习领域展现出了卓越的性能和强大的优势。这主要得益于其独特的架构设计,专为处理大规模并行计算任务而生。

1. 并行计算能力

GPU 拥有大量的核心,例如 NVIDIA 的 A100 GPU,包含多达 6912 个 CUDA 核心。这些核心能够同时处理众多的线程,实现大规模的并行计算。在深度学习中,许多计算任务,如矩阵乘法、卷积运算等,都可以分解为多个独立的子任务,这些子任务可以在 GPU 的多个核心上同时进行处理。例如,在对一幅图像进行卷积操作时,GPU 可以将图像划分为多个小块,每个核心负责处理一个小块的卷积计算,从而大大提高了计算效率。这种并行计算能力使得 GPU 在处理深度学习任务时,能够比 CPU 快上数倍甚至数百倍。

2. 高内存带宽

GPU 具备高内存带宽,能够快速地在内存和处理器之间传输数据。这对于深度学习中频繁的数据读写操作至关重要,可以减少数据等待时间,确保处理器始终有充足的数据进行计算。以 GDDR6 显存为例,其数据传输速率可高达 16Gbps 甚至更高,相比之下,CPU 的内存带宽要低得多。高内存带宽使得 GPU 能够快速地读取大量的训练数据和模型参数,并将计算结果及时写回内存,从而加速了整个深度学习的训练和推理过程。

3. 专为矩阵运算优化

深度学习中的许多操作,如神经网络的前向传播和反向传播,都大量依赖于矩阵运算,特别是矩阵乘法。GPU 的架构针对矩阵运算进行了专门的优化,采用了高效的算法和硬件设计,能够快速且准确地完成矩阵乘法等运算。例如,NVIDIA 的 GPU 引入了 Tensor Cores 技术,专门用于加速矩阵乘法和累加操作,在处理深度学习任务时,能够显著提高计算性能。这种针对矩阵运算的优化设计,使得 GPU 在深度学习领域具有天然的优势,能够更好地满足深度学习对计算速度和效率的严格要求。

二、GPU 加速深度学习的原理

(一)GPU 架构剖析

核心组成

GPU 主要由计算核心、显存、内存控制器、高速缓存等组件构成 。其中,计算核心是 GPU 的运算核心,负责执行各种计算任务,不同型号的 GPU 计算核心数量差异较大,从几百个到数千个不等。以 NVIDIA 的 GeForce RTX 4090 为例,其拥有多达 16384 个 CUDA 核心,强大的核心数量为其提供了卓越的并行计算能力。

显存则用于存储 GPU 在计算过程中需要读取和写入的数据,包括输入数据、中间结果和最终输出。显存的类型和容量对 GPU 的性能有重要影响,常见的显存类型有 GDDR6、GDDR6X 等,如 RTX 4090 配备了 24GB 的 GDDR6X 显存,能够满足大规模数据存储和高速读写的需求。

内存控制器负责管理显存与计算核心之间的数据传输,确保数据能够高效地在两者之间流动。高速缓存则用于临时存储频繁访问的数据,减少对显存的访问次数,提高数据读取速度,从而提升整体计算效率。

并行处理机制

GPU 的并行处理机制是其实现高效计算的关键。GPU 采用了多核心并行工作的方式,每个核心都可以独立处理不同的数据。在执行任务时,GPU 将一个大的任务分解为多个小的子任务,然后将这些子任务分配到各个核心上同时进行处理。

例如,在处理一幅高清图像时,GPU 可以将图像划分为多个小块,每个核心负责处理一个小块的图像数据,通过这种方式,GPU 能够在短时间内完成对整幅图像的处理。这种并行处理机制极大地提高了 GPU 的计算速度,使其能够在深度学习等需要大规模并行计算的任务中发挥出色的性能。

三、适合深度学习的 GPU 推荐

(一)消费级 GPU

- NVIDIA RTX 4090:作为 NVIDIA 消费级显卡的旗舰产品,RTX 4090 基于 Ada Lovelace 架构,拥有 16384 个 CUDA 核心 ,配备 24GB GDDR6X 显存,显存带宽高达 1TB/s。其强大的计算能力使其在深度学习模型训练和推理中表现出色,能够快速处理大规模的数据和复杂的神经网络。对于个人开发者和小型研究项目来说,RTX 4090 是一个非常不错的选择,它可以在相对较短的时间内完成模型训练,提高研究效率。在一些常见的深度学习框架,如 TensorFlow 和 PyTorch 中,RTX 4090 都能展现出卓越的性能,加速模型的训练和优化过程。 不过目前而言,4090的价格比较贵,要1.7W左右,其他常见的推荐有4090D、4080S,现在50系列的显卡出了,40系列的显卡开始降价,性价比就凸显出来了。或者上上代的专业级GPU如V100 32GB版本的只要9000元左右就能买到。

(二)专业级 GPU

- NVIDIA A100:NVIDIA A100 是一款专为数据中心和大规模深度学习任务设计的专业级 GPU。它基于 Ampere 架构,拥有 6912 个 CUDA 核心,配备高达 40GB 或 80GB 的 HBM2 显存,内存带宽高达 1.6TB/s 。A100 在处理大规模数据集和复杂的深度学习模型时表现出了卓越的性能,能够显著加速模型的训练和推理过程。在自然语言处理、图像识别、推荐系统等领域的大规模深度学习项目中,A100 得到了广泛的应用。许多大型科技公司和科研机构都采用 A100 来进行深度学习研究和开发,其强大的计算能力和高效的并行处理能力,为大规模深度学习任务提供了有力的支持。

- NVIDIA H100:作为 NVIDIA 新一代的专业级 GPU,H100 采用了更为先进的 Hopper 架构,在性能和功能上有了进一步的提升。它配备了高达 80GB 的 HBM3 显存,内存带宽高达 3TB/s ,拥有更多的计算核心和更高的计算效率。H100 引入了全新的技术,如 Transformer Engine,专门针对 Transformer 架构进行优化,能够极大地加速自然语言处理等领域的模型训练和推理。对于前沿的深度学习研究,如大规模语言模型的训练和复杂的人工智能算法研究,H100 提供了强大的支持,为科研人员探索深度学习的未知领域提供了更强大的工具。

(三)云 GPU 服务

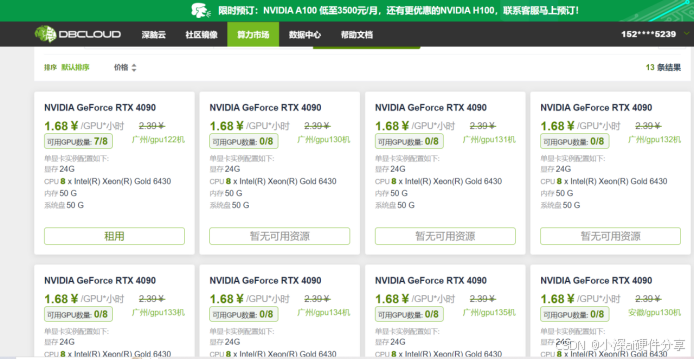

- 主流云平台的 GPU 服务:在当今云计算技术蓬勃发展的时代,主流云平台如阿里云、腾讯云等都提供了丰富且强大的 GPU 服务,性价比高的有auto DL、深脑云等云平台,为深度学习领域的开发者带来了诸多便利。

- 使用云 GPU 的优势与场景:使用云 GPU 服务具有诸多显著的优势,使其在深度学习领域得到了广泛的应用。云 GPU 服务消除了用户购买和维护硬件的繁琐过程,无需投入大量资金购买昂贵的 GPU 设备,也无需担心硬件的更新换代和维护问题。这对于预算有限的个人开发者、小型企业或研究团队来说,是一个极具吸引力的选择。用户可以根据深度学习项目的实际需求,灵活调整 GPU 资源的使用量。在模型训练的高峰期,可以增加 GPU 资源以加快训练速度;在项目空闲期,则可以减少资源使用,降低成本。

1206

1206

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?