ChatGPT 是一个经过预训练的 AI 语言模型,可以通过聊天的方式回答问题,或者与人闲聊。它能处理的是文本类的信息,输出也只能是文字。它从我们输入的信息中获取上下文,结合它被训练的大模型,进行分析总结,给出一个可能会让我们耳目一新的答案。

正因为简单易用,并且似乎具有超常的智慧,它使得我们“普通老百姓”有机会近距离接触到这个超能 AI,并且爱上了它;另一方面,正是由于它“智力过人”,我们在喜欢它的同时也产生了担忧,那就是我们的工作会不会被它取代,导致失业……

我的 ChatGPT 初体验

我使用 ChatGPT 也有一段时间,由于我目前所做工作主要偏向于产生内容,根据一些特定场景设计或制定解决方案之类的文本处理的事情,我会把 ChatGPT 当做一个比搜索引擎更加方便更加强大的工具来使用。比如,我可以给它输入特定场景上下文,让它帮我提供解决方案的思路。

由于大模型的支持,它的产出是经过提炼和总结的,是相对系统的,更接近于我所需要的结果,显然它是比搜索引擎更加强大、更加智能的工具,能够节省我查找资料并从资料中提炼我所需信息的大量时间,而且它可以开拓我的思路,给出一些我可能暂时想不到或者没想到的点子,这一点非常有帮助。

那是不是可以依赖于它来帮我搞定一切呢?并不能。因为它会一本正经地胡说八道,它总是过于自信,会把一个不准确的或者完成错误的结果非常自信的给出来……这个现象有个专业术语叫“人工智能幻觉”,维基百科解释如下:

在人工智能中,幻觉或人工智能幻觉是人工智能的自信反应。当模型有“幻觉”(输出欺骗性数据的倾向)时,其使用的的训练数据并不能证明输出的合理性。

该术语源自幻觉的心理学概念,因为它们具有相似的特征。人工智能幻觉的危险之处之一是模型的输出看起来是正确的,即使它本质上是错误的。

比如我跟 ChatGPT 一起

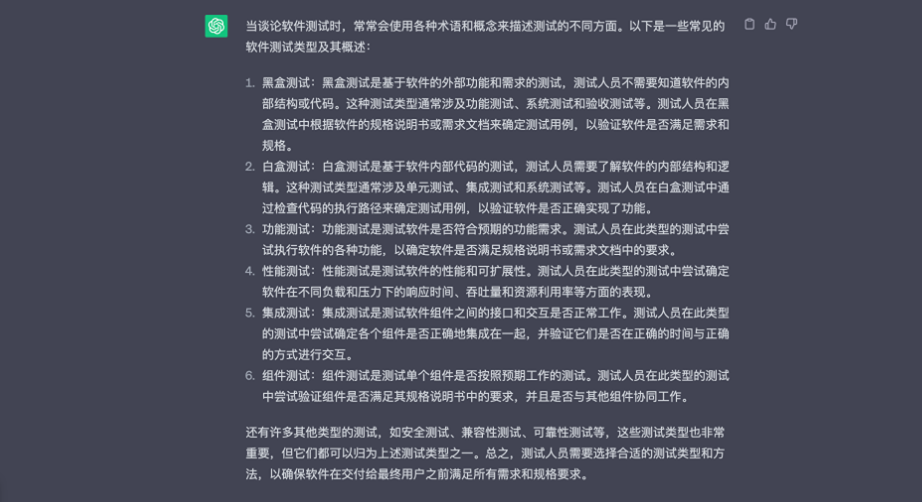

ChatGPT可以辅助进行需求分析、测试用例设计、自动化测试代码编写和测试报告生成,但受限于AI幻觉和安全隐私问题,不能独立完成测试工作。测试人员的创造性思维、异常情况处理和专业技能仍是关键。尽管ChatGPT能提高效率,但使用时需批判性思考,不应过度依赖。

ChatGPT可以辅助进行需求分析、测试用例设计、自动化测试代码编写和测试报告生成,但受限于AI幻觉和安全隐私问题,不能独立完成测试工作。测试人员的创造性思维、异常情况处理和专业技能仍是关键。尽管ChatGPT能提高效率,但使用时需批判性思考,不应过度依赖。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1050

1050

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?