导读

港科大 Aerial Robotics Group(ARCLab / UAV@HKUST) 由沈劭劼教授领衔,长期聚焦自主导航、无人机技术、传感器融合与三维视觉等方向,强调“从算法到系统”的工程闭环与开源生态。沈劭劼现任香港科技大学电子与计算机工程系副教授(2014 年加入、2020 年晋升),港科大–大疆联合创新实验室(HDJI)创始主任,并担任大疆创新首席机器人专家,主导车载智能驾驶技术研发,曾任 T-RO副主编与 IROS 2020–2022 高级编辑。

在学术影响力与工程落地上,团队“双线并进”。近年获得 IEEE T-RO 最佳论文奖荣誉提及(2018、2020)、IROS 2018 最佳学生论文奖、ICRA 2011/2017 最佳论文候选、SSRR 2015/2016 最佳论文奖 等多项重要荣誉,并两度获 AI 2000 Most Influential Scholar Honorable Mention(2020、2021)。沈教授也受邀在首届中国三维视觉大会作主题报告《From Drones to Self-Driving Cars》,在学术与产业之间形成高频互动与共振。

ARCLab 的鲜明特色是产品化思维 + 极强的工程执行力:问题选择直面真实场景痛点,解法偏向优化与系统集成,重视落地实验与全链路复现。从早期广受社区关注的 VINS-Mono 开源,到后续在状态估计、SLAM、规划、空地协同上的持续输出,团队始终坚持“能复现、可部署、可扩展”的标准。

同样亮眼的还有人才培养:实验室走出了一批在学术与产业一线活跃的青年学者与技术负责人,例如高飞(浙大长聘副教授)、秦通(上交副教授、曾任华为“天才少年”)、丁文超(曾任华为 ADS 研究科学家)、周博宇(南方科技大学助理教授)。这条“从科研到应用”的人才与技术链条,正是 ARCLab 持续高产与高影响力的关键底层逻辑。

下面进入 2025 年论文盘点(满满的顶刊顶会):今年他们在“更稳的状态估计与多源融合、更轻量的建图与地图对齐、更可靠的复杂/极端环境导航、更全面的场景理解与拓扑推理,以及更精准的轨迹预测与决策”上都有新进展。

参考:

https://scholar.google.cz/citations?hl=zh-CN&user=u8Q0_xsAAAAJ&view_op=list_works&sortby=pubdate

A General Optimisation-Based Framework for Global Pose Estimation With Multiple Sensors 【IET Cyber-Systems&Robotics】

地址:

https://ietresearch.onlinelibrary.wiley.com/doi/pdf/10.1049/csy2.70023

主要内容:

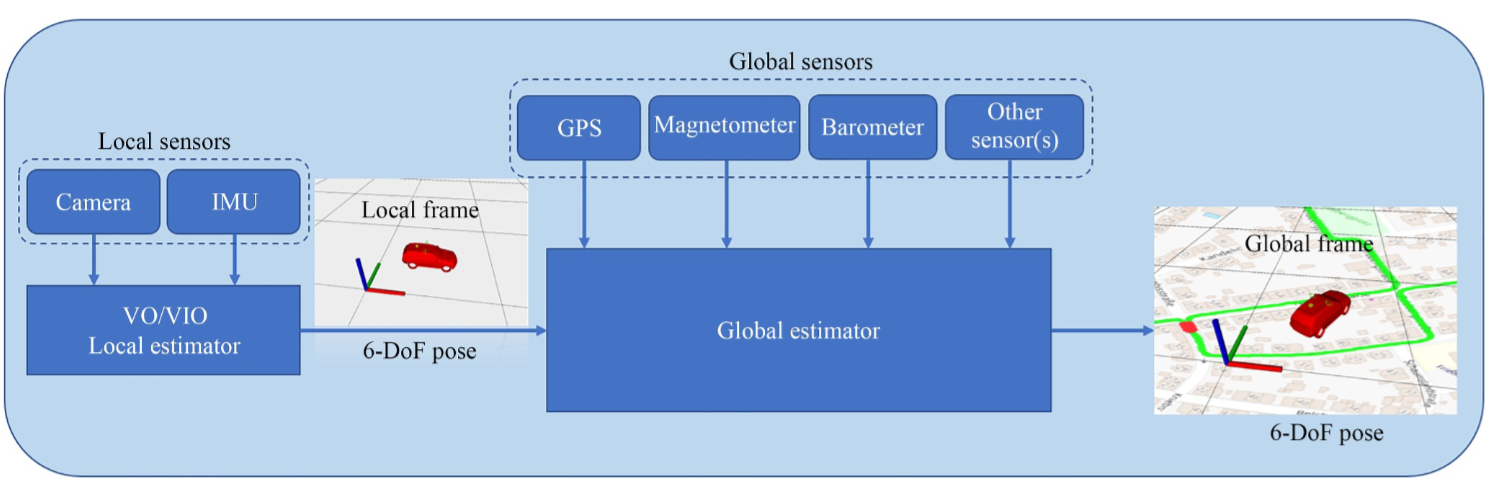

这项研究提出一套统一位姿图优化框架,将局部高精度但会漂移的 VO/VIO(相机、IMU、LiDAR 等)与全局无漂移但噪声较大的传感器(GPS、磁力计、气压计等)融合,通过在图优化中对齐局部轨迹到全局坐标并显式消除累计漂移,实现同时兼顾局部精度与全局一致性;框架通用、可插拔,已在公开数据集与真实环境验证并优于多种 SOTA,为长时程与大范围任务在 GNSS 受限场景落地提供了更低门槛的多源融合方案。

图1|框架示意:先用相机/IMU等得到短时精确轨迹,再引入GPS等全局信息作锚定;通过统一的图优化把两者对齐并消除漂移,最终获得全局一致的位姿

Autonomous Flights inside Narrow Tunnels【IEEE TRO】

地址:https://arxiv.org/pdf/2505.19657

主要内容:

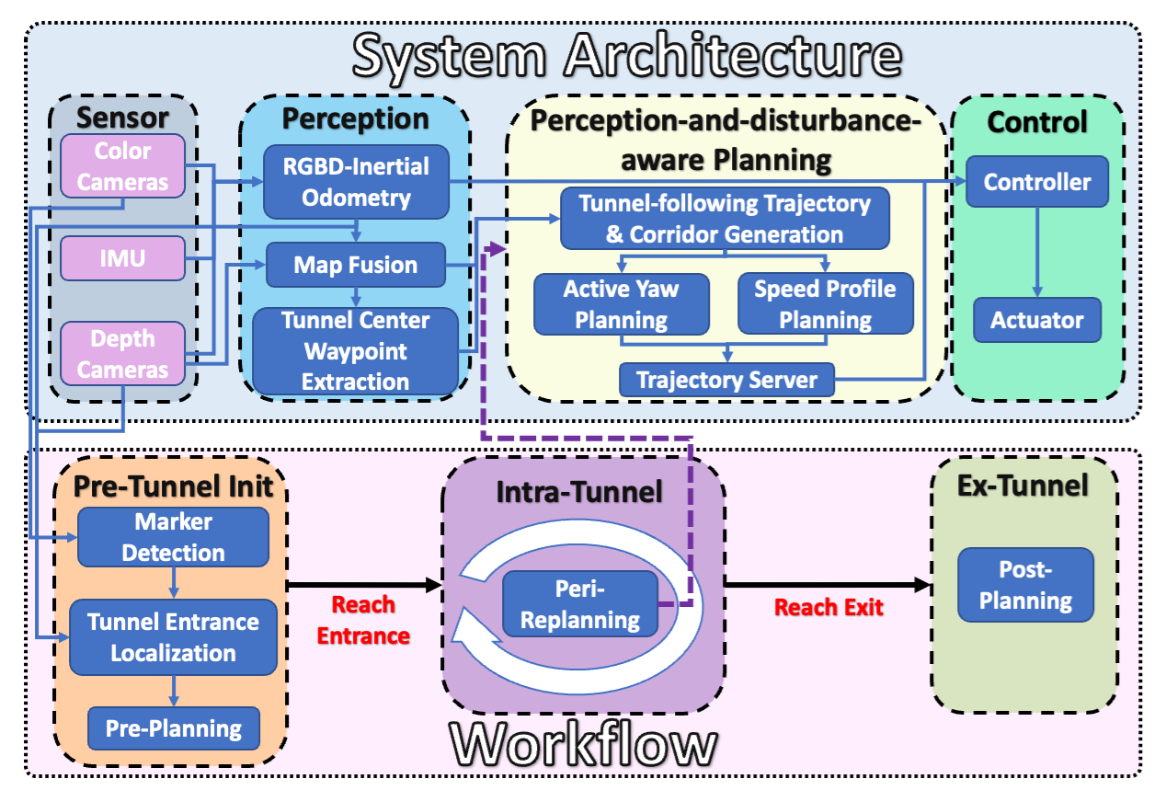

这项研究面向难以进入的狭窄隧道(最小直径 0.5m),提出一套实时在线的多旋翼自主系统:通过“虚拟全向感知”克服弱纹理/弱光与有限视场,在运动规划中显式建模感知可见性与自体气流扰动(分别基于相机投影与 CFD 分析);在多处真实窄隧道中,定制四旋翼完成大量飞行实验并表现优于人类飞手,同时给出跨平台部署流程与开源包,为检修/搜救等受限空间作业提供了可复用的工程方案。

图2|系统设计总览:相机彩色/深度图和 IMU 输出运动估计并融合成地图;从地图抽取“中心线”航点,考虑可见性与自体气流扰动来生成轨迹(位置、偏航、速度),最后转成电机控制。流程:入隧定位与预规划 → 隧内持续重规划 → 出隧后收尾规划

SLIM: Scalable and Lightweight LiDAR Mapping in Urban Environments【IEEE TRO】

地址:https://arxiv.org/pdf/2409.08681

主要内容:

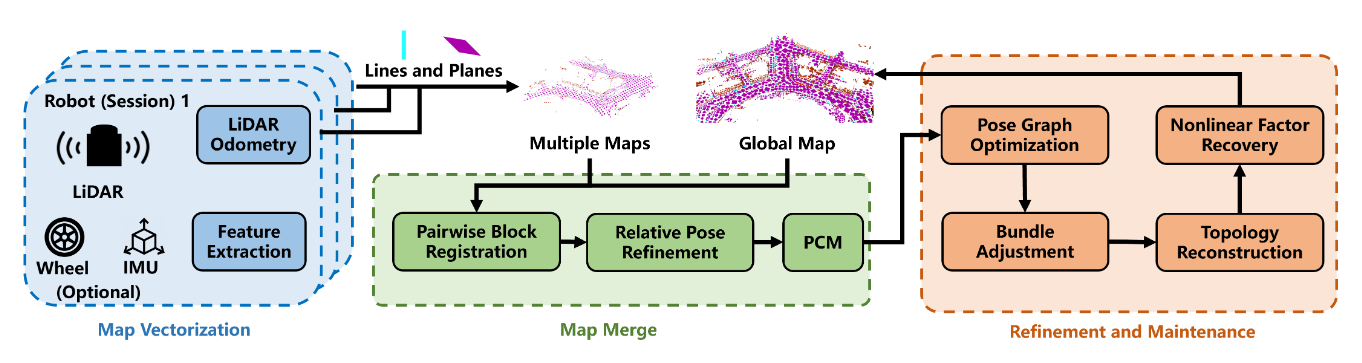

这项研究把原来密密麻麻的 LiDAR 点云,简化成“线”和“面”来表示道路和建筑,让地图更轻、也更好维护;基于这种表示,可以更方便地把不同时间采的地图合在一起,并通过整体优化(把整条轨迹和位置“调顺”)保持局部准确。为了长期使用,系统还能在不明显影响精度的前提下自动压缩不重要的位姿。在 KITTI、NCLT、HeLiPR、M2DGR 等数据上,SLIM 同时做到了精度不降、体量更小、扩展更容易;在 KITTI 上整张城市图大约 130 KB/公里,还能直接拿来做再次定位,这让长期跑车/机器人时的地图存储、更新和复用成本大幅降低。

图3|SLIM框架总览:先把原始点云提炼成更轻的“线”和“面”,再把不同时间采的地图合成一张全局图。随后用 PGO(位姿图优化) 和 BA(束调整) 做平滑与校正;通过以地图为中心的边缘化,即便长期多次采集,计算与存储也不会爆炸,适合城市级长期建图

Active Contact Engagement for Aerial Navigation in Unknown Environments With Glass【RAL】

地址:https://arxiv.org/pdf/2505.00332

主要内容:

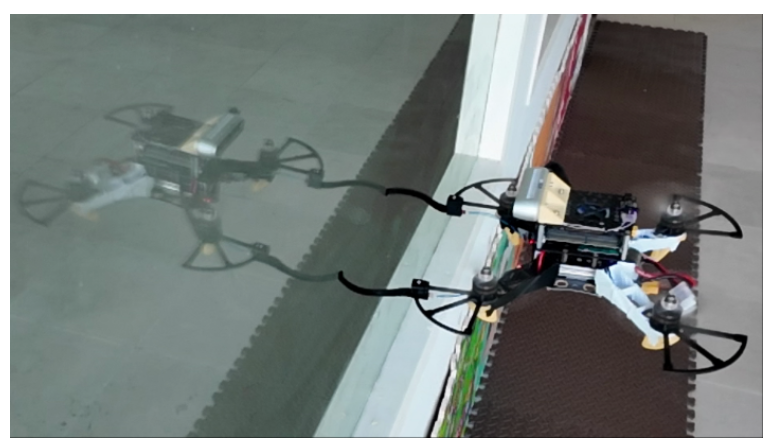

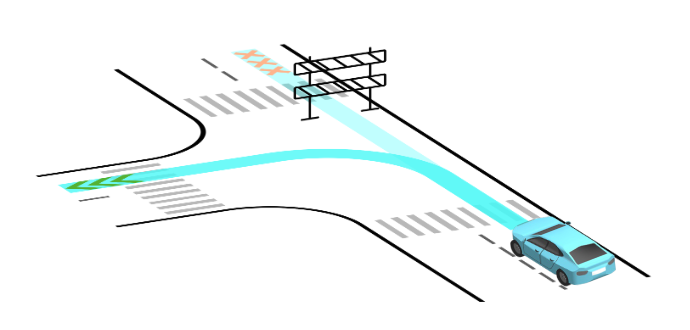

这项研究针对“玻璃看得见摸不着”的导航难题,把视觉识别和主动触碰结合起来:先用相机增量检测可能的玻璃位置,再让无人机用一对轻量触觉模块去“点一下”确认;随后把确认结果写入三维体素地图并即时重规划绕行路径;多种真实场景实验证明系统在复杂玻璃环境中更稳更高效,为商场、写字楼等玻璃密集空间的巡检/搜救提供了更可行的无人机方案。

图4|当视觉判定前方可能是玻璃时,无人机主动前探,用机头两枚触觉传感器轻触表面进行存在性确认;确认无误后再进入后续避障流程

SEPT:Standard-Definition Map Enhanced Scene Perception and Topology Reasoning for Autonomous Driving【RAL】

地址:https://arxiv.org/pdf/2505.12246?

主要内容:

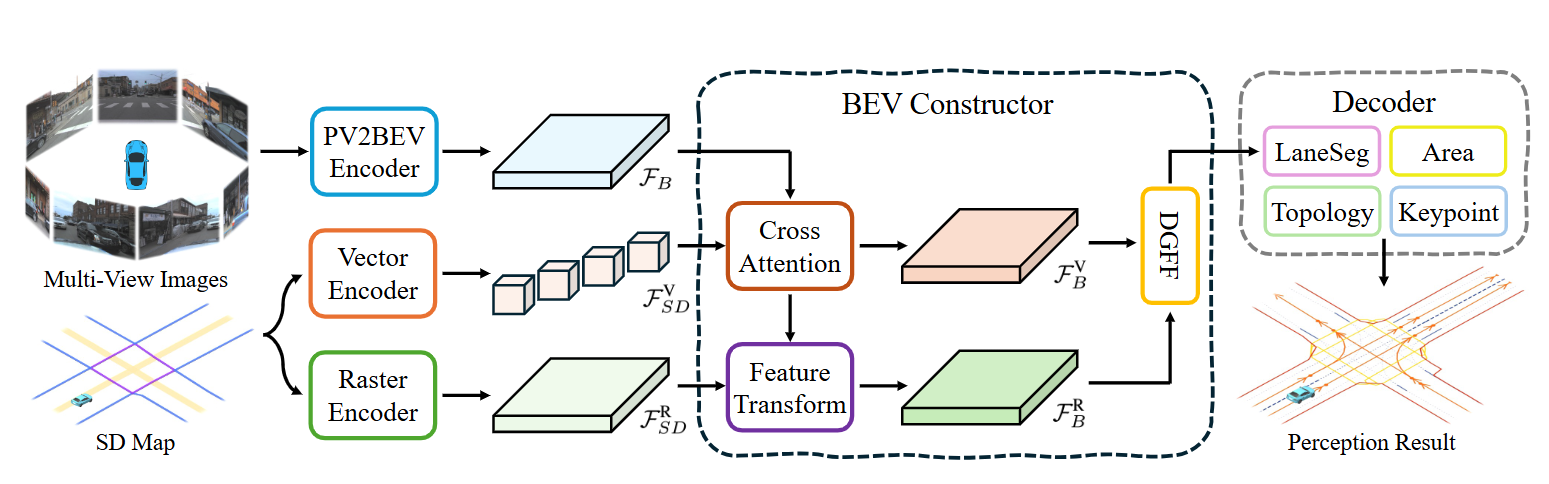

这项研究面向“尽量少依赖昂贵 HD 高精地图”的自动驾驶,提出 SEPT 框架,把标准清晰度(SD)地图当作先验信息接入在线感知与拓扑推理:通过混合特征融合把 SD 地图与鸟瞰视角(BEV)特征结合(同时处理栅格/矢量两种表示并缓解二者错位问题),并利用路口特性设计路口感知的关键点辅助任务来强化整体理解;在 OpenLane-V2 上对远距离/遮挡等难场景有明显提升,整体效果显著优于现有方法,为更低成本且更稳健的“轻地图”自动驾驶提供了可行路径。

图5|SEPT系统总览:把 SD 地图中的道路/路口先验,引入并与鸟瞰特征(BEV)融合,同时做错位校正;在不依赖昂贵高精地图的前提下,提升远距与遮挡场景的识别与拓扑关系推断效果

Generalizable and Efficient Scene Graph Registration【IEEE TRO】

地址:https://arxiv.org/pdf/2504.14440

主要内容:

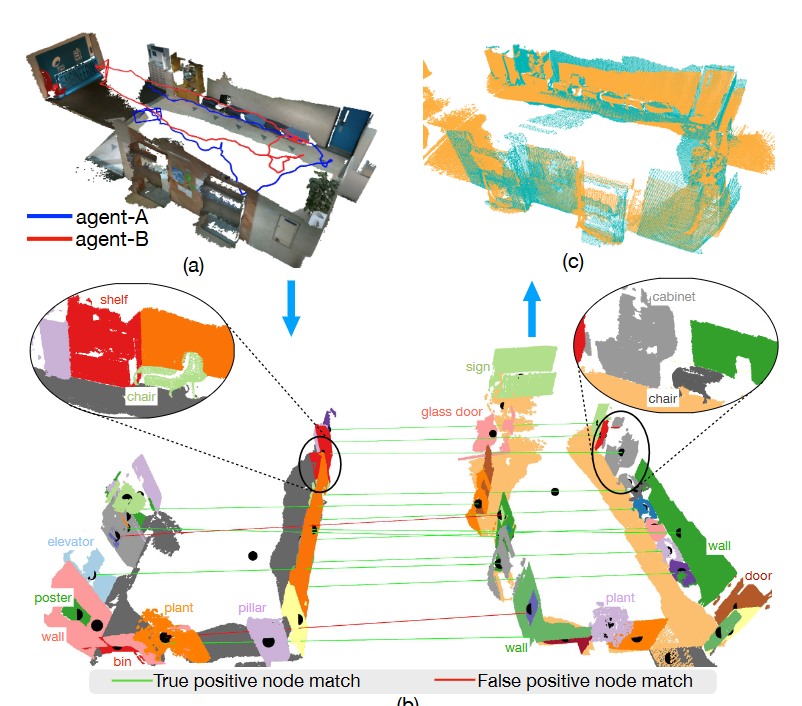

这项研究面向多机器人/先验地图的“对齐”问题,把环境抽象成场景图(节点=物体/语义点,边=关系),并设计网络同时编码三类信息:开放集语义、带空间感知的局部拓扑和形状特征,融合成紧凑的节点描述;前端用由粗到细的匹配找对应,后端用鲁棒位姿估计解出两图的变换,全流程保持稀疏分层表示以减少 GPU 占用与通信带宽;训练数据不依赖人工标注,而由视觉基础模型 + 语义建图自动生成;在两智能体 SLAM 基准上,配准成功率显著优于手工特征方案,相比视觉回环网络召回更高且每帧仅约 52 KB通信,代码开源,为低带宽场景下的多机器人地图对齐与共享定位提供了通用基石。

图6|两机器人 SLAM 的语义场景图对齐:相向采集的 RGB-D 跨视角匹配节点并估计变换,最终把两张图对齐成一张统一地图

GoIRL: Graph-Oriented Inverse Reinforcement Learning for Multimodal Trajectory Prediction【ICML】

地址:https://arxiv.org/pdf/2506.21121

主要内容:

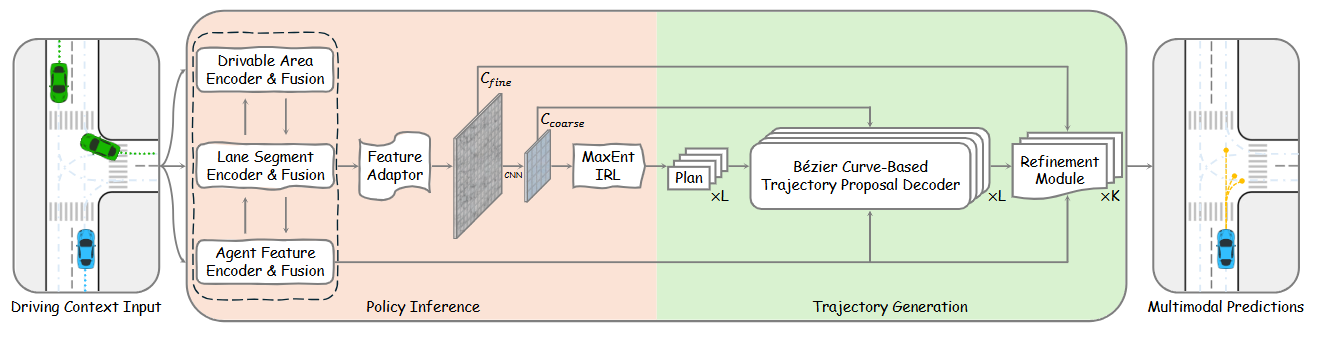

这项研究把轨迹预测从“纯监督学习”转向逆强化学习(IRL):先用向量化车道图把道路与交互关系表示成“图”,再用特征适配器把图信息汇入栅格空间,在最大熵 IRL框架下学到“隐含奖励”与策略,从而采样出多种合理的未来轨迹;在此基础上,提出分层参数化生成器与精修模块提升精度,并用概率融合提高置信度;在 Argoverse 与 nuScenes 上取得 SOTA,对未见场景的泛化也优于纯监督方法,为复杂路口与长尾交互场景的稳健预测提供了一条更可解释、可扩展的 IRL 路线。

图7|上图:GoIRL 总览,基于车道图与 IRL 奖励,先推理意图、再生成多模态轨迹(蓝色为目标车);下图:T 字路口示例:训练数据标注为“直行”,但测试时路口临时路障出现,模型需自适应只给出“左转”这一路线

Event-based Visual-Inertial State Estimation for High-Speed Maneuvers【IEEE TRO】

地址:

主要内容:

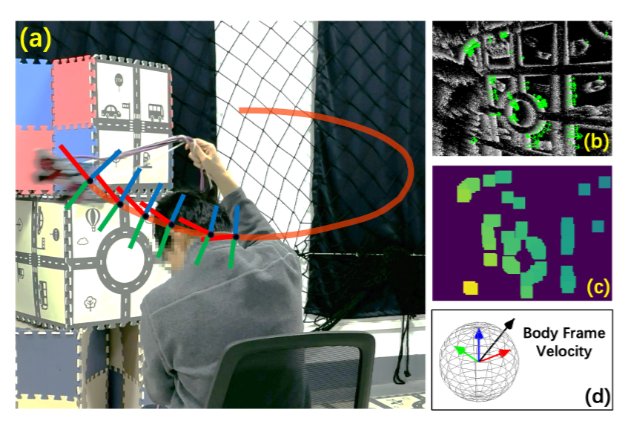

这项研究利用事件相机的超高时间分辨率,提出一套不依赖地图的视觉惯性估计:不再直接求相机位姿,而是先实时恢复线速度(更符合事件相机的“微分式”成像原理)。系统输入为双目事件相机 + IMU,前端从原始事件中计算法向流与深度,后端用连续时间 + 滑窗融合不同步的数据,在线估计速度与 IMU 偏置;在仿真与真实数据上实现低时延、米级标定的速度估计,被作者称为首个面向高速机动的纯事件视觉惯性实时方案,为高速无人机/极端运动场景下的稳健感知提供了更快更稳的路径。

图8|系统用双目事件流 + IMU 推出当下线速度:(a) 通过水平旋转制造高速运动;(b) 事件数据估计法向流(稀疏、异步);(c) 在法向流起点估计稀疏深度;(d) 得到机体系下的瞬时线速度示意

Foresight in Motion: Reinforcing Trajectory Prediction with Reward Heuristics【ICCV】

地址:https://arxiv.org/abs/2507.12083?

主要内容:

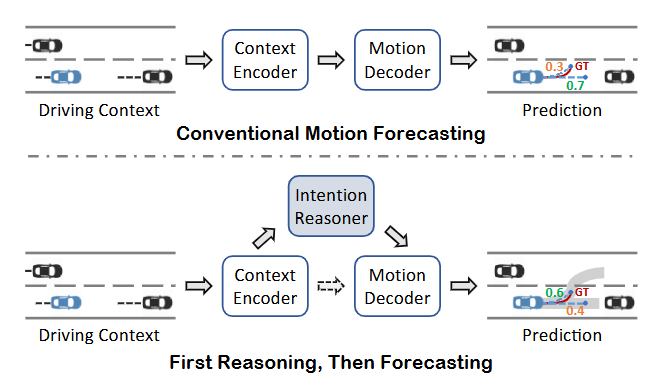

这项研究把轨迹预测从“直接回归未来”改成“先推理、后预测”:先用基于 IRL 的可解释意图推理器(query-centric IRL)把场景里的车辆与道路要素编码到统一向量表示中,聚合上下文后得到奖励分布,以此推断出多种可能意图作为先验;再用分层解码器(DETR 风格)结合双向状态空间模块生成带概率的未来轨迹。在 Argoverse 与 nuScenes 上显著提升置信度与性能,为路口博弈、遮挡等不确定场景提供了更可解释且易与规划对接的预测路径.

图9|上:用感知特征直接回归未来轨迹。下:先基于场景关系推断目标车意图(可选虚线步骤),再生成带概率的多条轨迹,更稳健也更可解释

总结

2025 年,港科大 ARCLab沿着五条主线稳步推进:更稳的状态估计与多源融合、更轻量的建图与地图对齐、更可靠的复杂/极端环境自主导航、更全面的场景理解与拓扑推理,以及更精准的轨迹预测与决策。整体风格依旧是“问题导向 + 从算法到系统”,兼顾可复现与工程落地,面向长期运行、低带宽与弱先验场景,强调通用性与可扩展性。

今年关键词: 稳、轻、实、通、可解释。

1377

1377

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?