PyTorch implements an AlexNet

如果有不懂的直接上https://github.com/Lornatang/AlexNet-PyTorch提问题。

免责说明:如果有引用代码,请注明出处。近段时间优快云上很多恶意抄袭不注明出处的博主,谢谢。

Why AlexNet very good?

- 为什么Alexnet能在图2012 ImageNet LSVRC-2012 像识别(分类) competition取得这么好的成绩

- Alexnet的网络结构以及,参数数量的计算

- 为了避免过拟合使用的技巧:Data Augmentation(数据增强),正则化Relu以及dropout,局部响应归一化LRN。

- 对比了多个小的卷积核和大的卷积核的区别(前面BAT面试题)。

- Alexnet取得成功的原因,主要三条:

大量数据,Deep Learning领域应该感谢李飞飞团队搞出来如此大的标注数据集合ImageNet;

GPU,这种高度并行的计算神器确实助了洪荒之力,没有神器在手,Alex估计不敢搞太复杂的模型;

算法的改进,包括网络变深、数据增强、ReLU、Dropout等。

- Alexnet网络结构以及参数数量的计算

Alexnet网络的大体结构如下(论文以及一般的blog都是如下这个图,但是看起来很不直观):

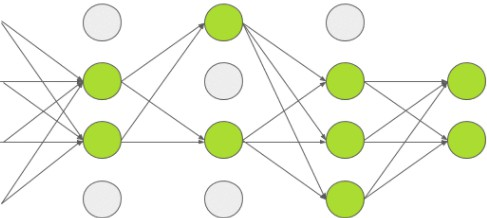

下面给出两个更好理解的结构图,5个卷积层+3个全连接层:

来源:stackoverflow

https://www.learnopencv.com/understanding-alexnet/

各层的参数计算如下,下图为5个卷积层的参数:

全连接层如下:

可以看到:卷积层的参数明显少于全连接层的参数。其中,网络大概有62.3 million parameters,其中卷积层占比约6%,单占比95%的计算。

- 为了避免过拟合使用的技巧:Data Augmentation(数据增强),正则化Relu以及dropout

- 1 Data Augmentation(数据增强)

数据增强简单的办法如,图片翻转Mirroring,随机裁剪Random Crops。

- 2 使用ReLU非线性激活函数

使用ReLU非线性激活函数而不选择sigmoid或tanh函数,ReLU优势在于:

速度快 和sigmoid函数需要计算指数和倒数相比,relu函数其实就是一个max(0,x),计算代价小很多。

减轻梯度消失问题,从而可以训练更深的网络。

稀疏性 通过对大脑的研究发现,大脑在工作的时候只有大约5%的神经元是激活的,而采用sigmoid激活函数的人工神经网络,其激活率大约是50%。有论文声称人工神经网络在15%-30%的激活率时是比较理想的。因为relu函数在输入小于0时是完全不激活的,因此可以获得一个更低的激活率.

- 3 使用Dropout(只在最后几个全连接层做)

本文详细介绍了PyTorch中如何实现AlexNet网络,包括网络结构、参数计算、避免过拟合的策略,如数据增强、ReLU激活、Dropout和局部响应归一化。此外,还讨论了AlexNet取得成功的关键因素和与其它网络结构的对比。

本文详细介绍了PyTorch中如何实现AlexNet网络,包括网络结构、参数计算、避免过拟合的策略,如数据增强、ReLU激活、Dropout和局部响应归一化。此外,还讨论了AlexNet取得成功的关键因素和与其它网络结构的对比。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2937

2937

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?