安装ollama

Ollama是什么

Ollama是一个大语言模型运行平台,可以让我们非常方便的在不同平台运行多个大模型。完全开源免费。

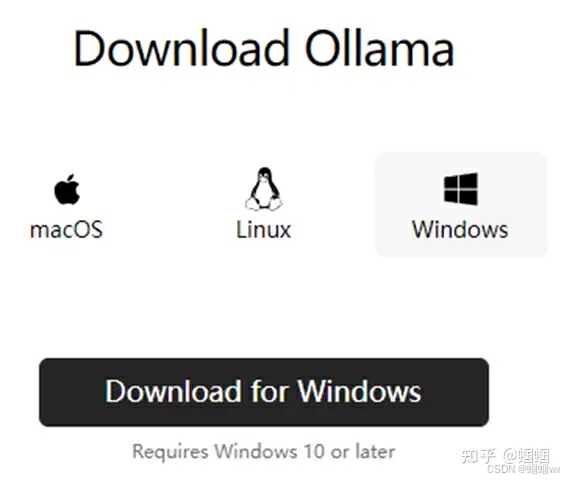

下载安装 Ollama

点击打开网址:Ollama![]() https://link.zhihu.com/?target=https%3A//ollama.com/,下载相应操作系统的安装包(以Windows为例)

https://link.zhihu.com/?target=https%3A//ollama.com/,下载相应操作系统的安装包(以Windows为例)

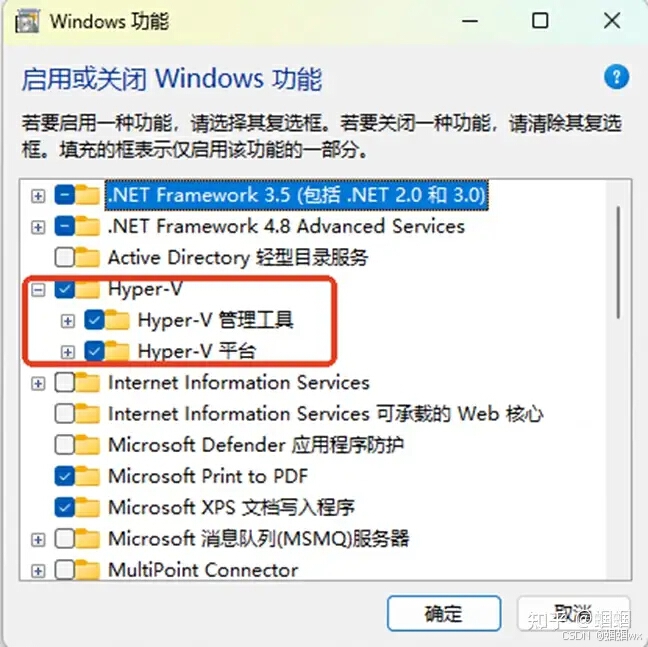

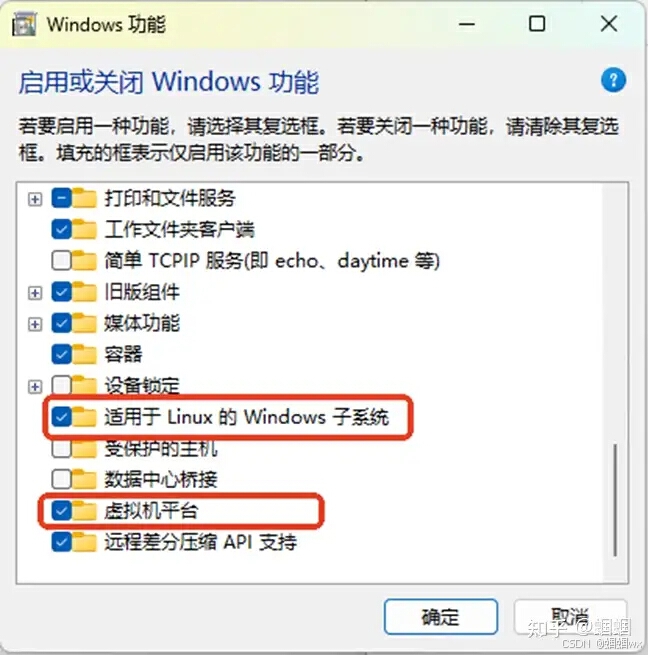

在安装ollama之前,首先检查电脑系统配置,win+s,启用或关闭windows功能,检查Hyper-V

然后管理员运行命令行

并在命令行执行wsl --update

下载后一路默认安装即可

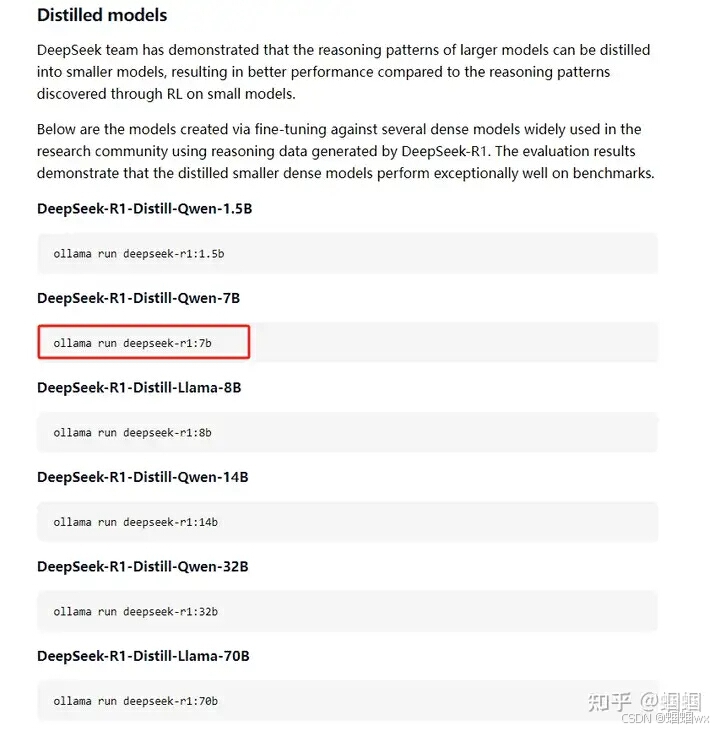

使用ollama部署deepseek

打开地址https://ollama.com/library/deepseek-r1

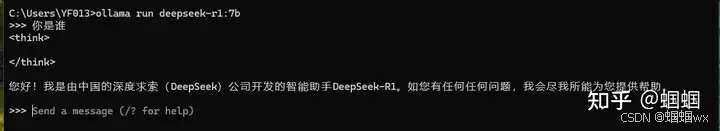

以ollama run deepseek-r1:7b为例

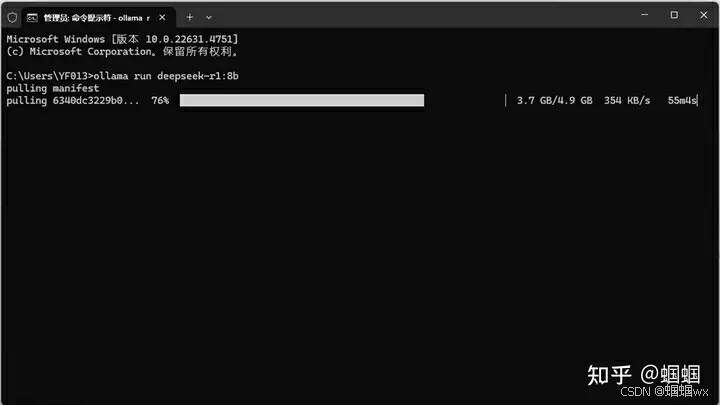

命令行运行ollama run deepseek-r1:7b

可以随意的和ai交流了

19万+

19万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?