一、RRD分区

(一)RDD分区概念

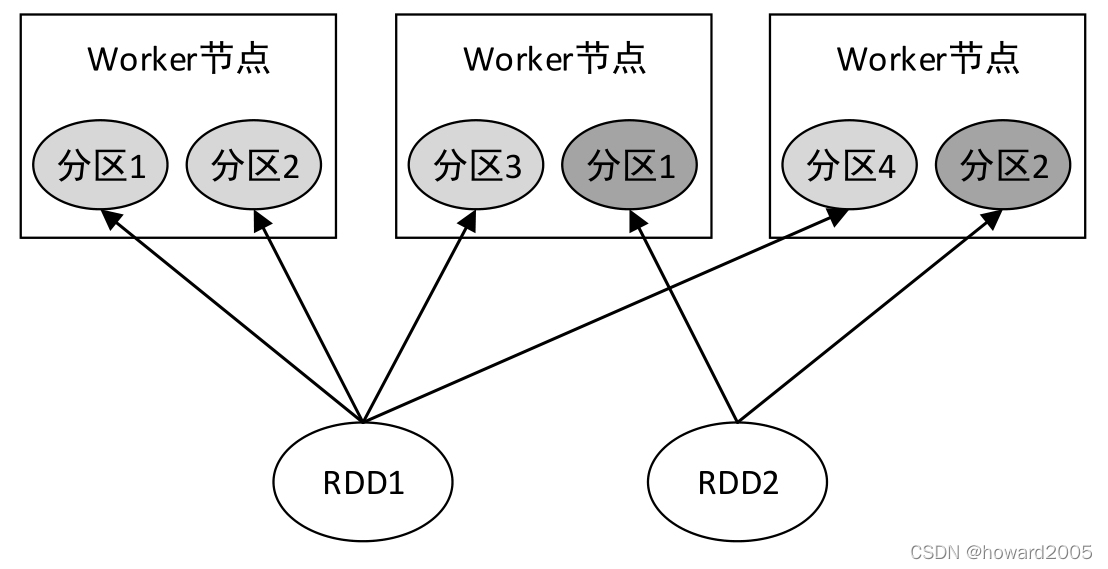

- RDD是一个大的数据集合,该集合被划分成多个子集合分布到了不同的节点上,而每一个子集合就称为分区(Partition)。因此,也可以说,RDD是由若干个分区组成的。

(二)RDD分区作用

- 在分布式程序中,网络通信的开销是很大的,因此控制数据分布以获得最少的网络传输可以极大的提升程序的整体性能,Spark程序可以通过控制RDD分区方式来减少通信开销。Spark中所有的RDD都可以进行分区,系统会根据一个针对键的函数对元素进行分区。虽然Spark不能控制每个键具体划分到哪个节点上,但是可以确保相同的键出现在同一个分区上。

二、RDD分区数量

(一)RDD分区原则

- RDD各个分区中的数据可以并行计算,因此分区的数量决定了并行计算的粒度。Spark会给每一个分区分配一个单独的Task任务对其进行计算,因此并行Task的数量是由分区的数量决定的。RDD分区的一个分区原则是使得分区的数量尽量等于集群中CPU核心数量。

(二)影响分区的因素

- RDD的创建有两种方式:一种是使用parallelize()方法从对象集合创建;另一种是使用textFile()方法从外部存储系统创建。而RDD分区的数量与RDD的创建方式以及Spark集群的运行模式有关。

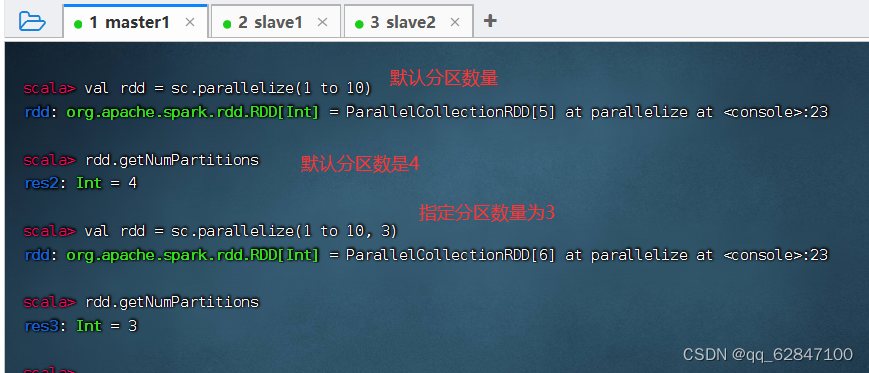

(三)使用parallelize()方法创建RDD时的分区数量

1、指定分区数量

- 使用parallelize()方法创建RDD时,可以传入第二个参数,指定分区数量。

- 分区的数量应尽量等于集群中所有CPU的核心总数,以便可以最大程度发挥CPU的性能。

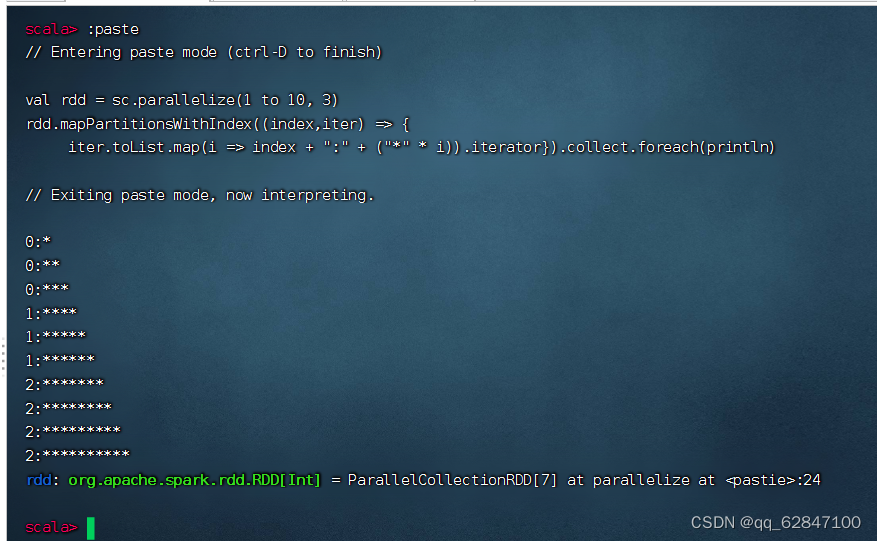

- 利用

mapPartitionsWithIndex()函数实现带分区索引的映射

- 第1个分区完成了3个元素的映射,第2个分区完成了3个元素的映射,第3个分区完成了4个元素的映射

文章详细介绍了Spark中的RDD分区概念,包括RDD分区的作用,如何控制分区数量,以及默认分区策略。讨论了使用`parallelize()`和`textFile()`方法创建RDD时的分区数量设定。此外,重点讲述了Spark的两种主要分区方式:哈希分区和范围分区,并提到了自定义分区器的使用场景和实现方法,以满足特定的数据分布需求。

文章详细介绍了Spark中的RDD分区概念,包括RDD分区的作用,如何控制分区数量,以及默认分区策略。讨论了使用`parallelize()`和`textFile()`方法创建RDD时的分区数量设定。此外,重点讲述了Spark的两种主要分区方式:哈希分区和范围分区,并提到了自定义分区器的使用场景和实现方法,以满足特定的数据分布需求。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1350

1350

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?