一、RAG

给模型注入新知识的方式,可以简单分为两种方式,一种是内部的,即更新模型的权重,另一个就是外部的方式,给模型注入格外的上下文或者说外部信息,不改变它的的权重。 第一种方式,改变了模型的权重即进行模型训练,这是一件代价比较大的事情,大语言模型具体的训练过程。二种方式,并不改变模型的权重,只是给模型引入格外的信息。类比人类编程的过程,第一种方式相当于你记住了某个函数的用法,第二种方式相当于你阅读函数文档然后短暂的记住了某个函数的用法。

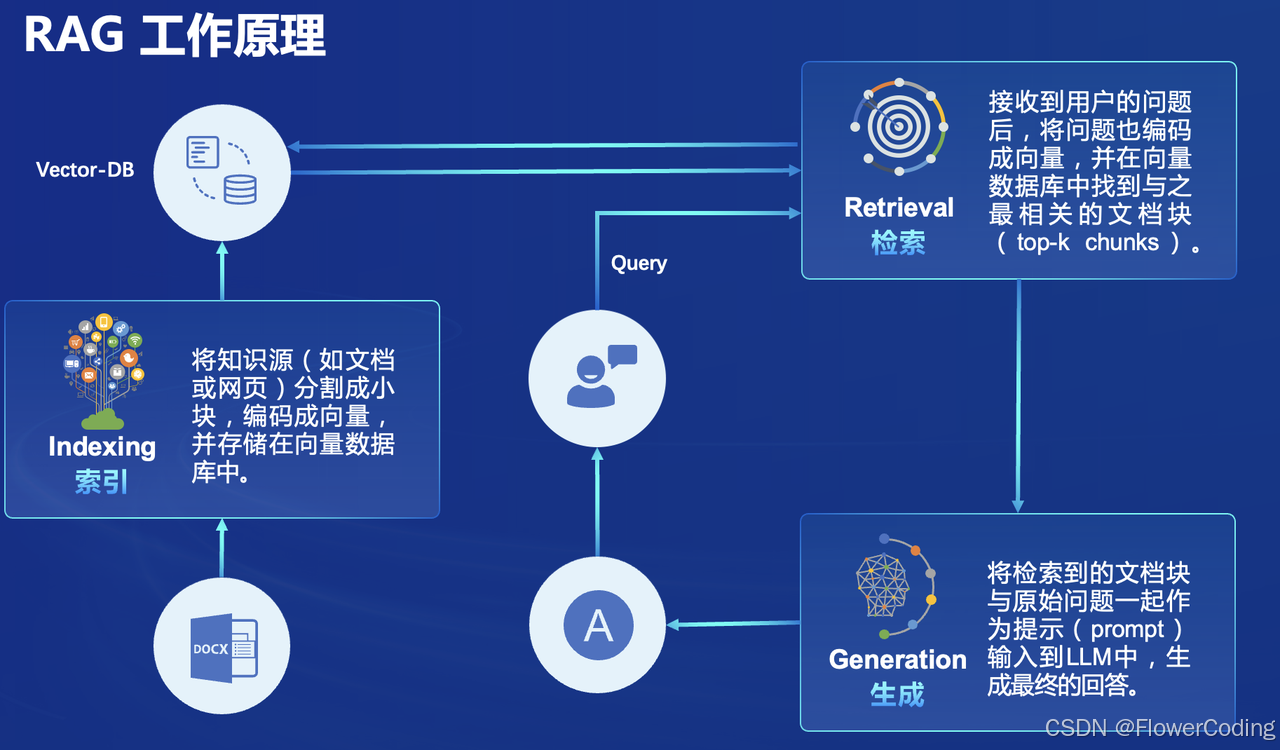

检索增强生成(Retrieval Augmented Generation,RAG)技术就是通过第二种方式来给模型注入新的知识。

二、LlamaIndex

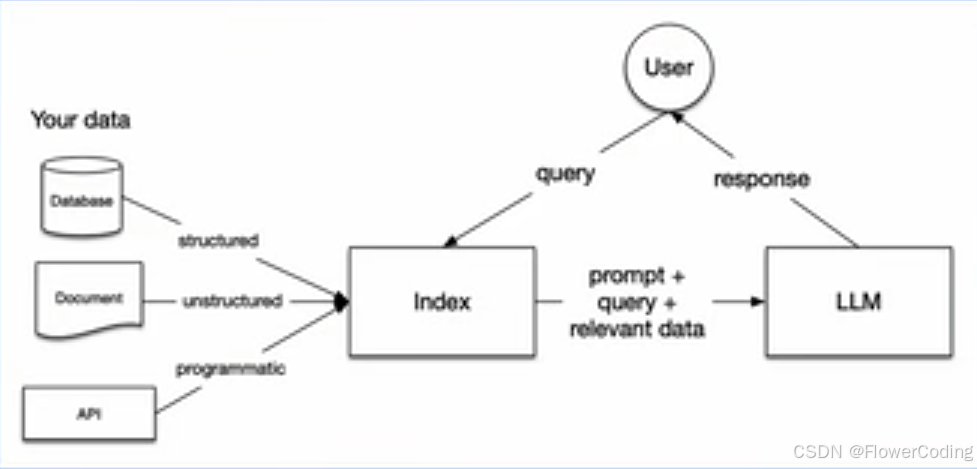

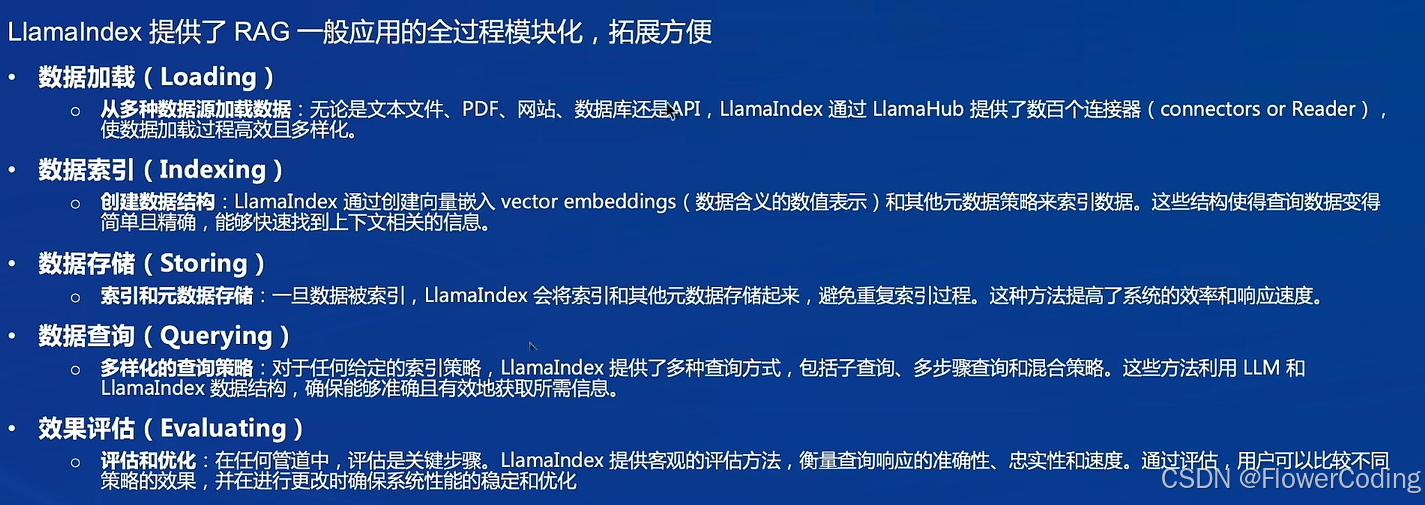

数据据索引和检索:对大规模数据进行索引,支持多种数据源(文件、数缸寒,网络等);提供高效的检索机制,快速找到相关信息

支持多种生成模型:除了Llama系列外,还支持GPT系列、OpenAI API等

三、闯关环节

3.1环境模型、准备

3.1.1环境配置

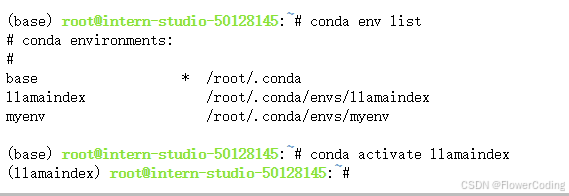

创建新的conda环境,命名为 llamaindex:

conda create -n llamaindex python=3.10复制完查看本地环境:

conda env list

运行 conda 命令,激活 llamaindex 然后安装相关基础依赖 python 虚拟环境:

conda activate llamaindex

pip install einops==0.7.0 protobuf==5.26.1

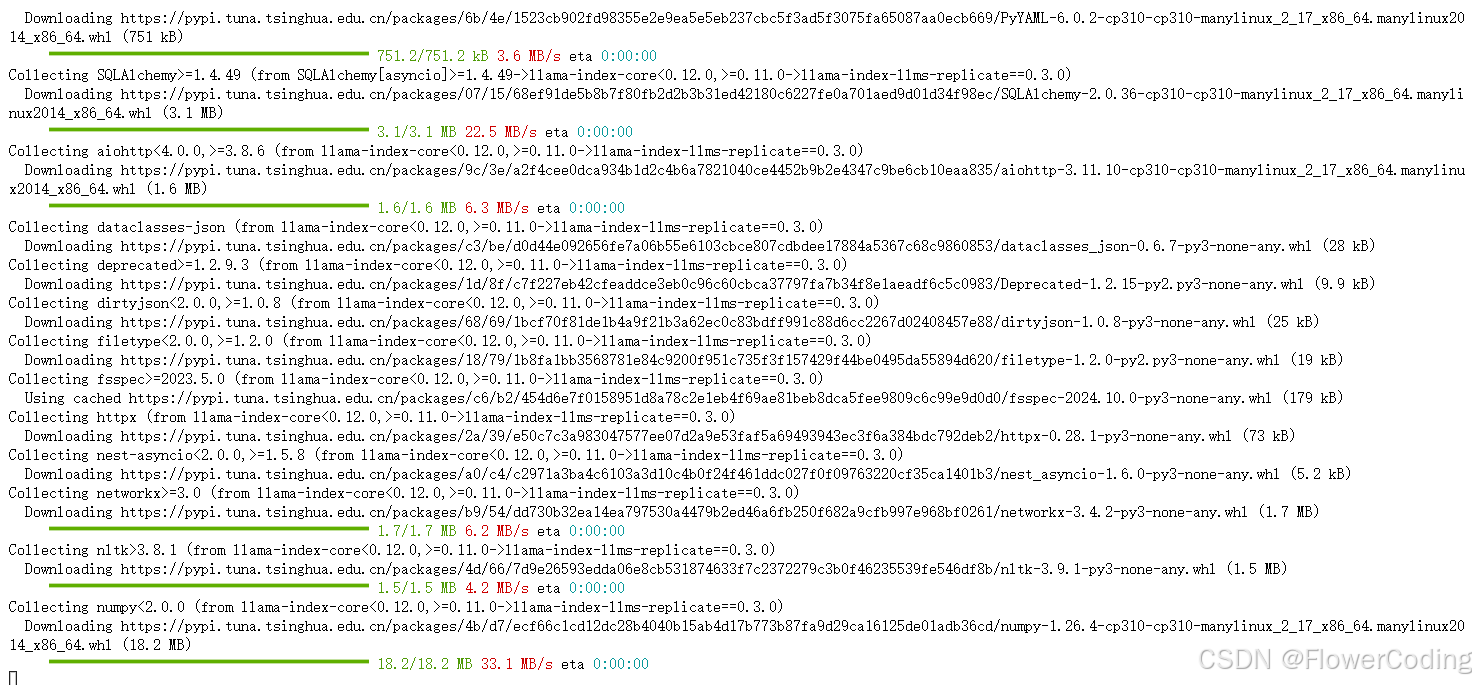

3.1.2安装LlamaIndex

conda activate llamaindex

pip install llama-index==0.11.20

pip install llama-index-llms-replicate==0.3.0

pip install llama-index-llms-openai-like==0.2.0

pip install llama-index-embeddings-huggingface==0.3.1

pip install llama-index-embeddings-instructor==0.2.1

pip install torch==2.5.0 torchvision==0.20.0 torchaudio==2.5.0 --index-url https://download.pytorch.org/whl/cu1213.1.3 下载 Sentence Transformer

cd ~

mkdir llamaindex_demo

mkdir model

cd ~/llamaindex_demo

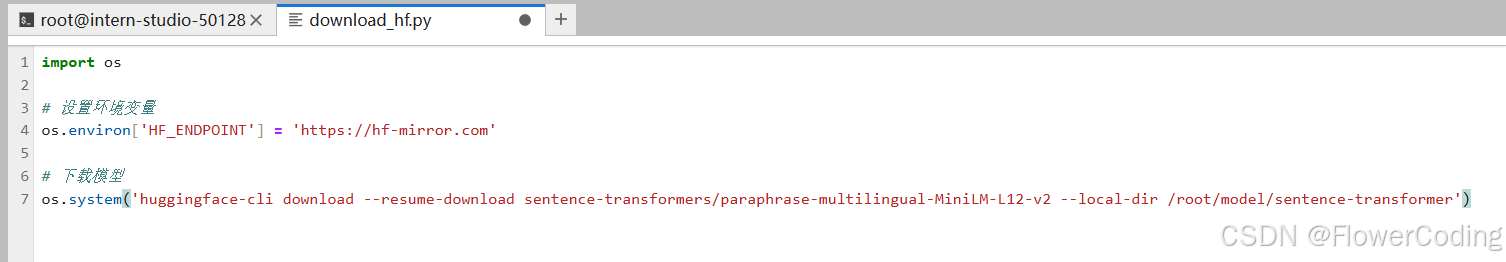

touch download_hf.py打开download_hf.py复制粘贴以下代码:

import os

# 设置环境变量

os.environ['HF_ENDPOINT'] = 'https://hf-mirror.com'

# 下载模型

os.system('huggingface-cli download --resume-download sentence-transformers/paraphrase-multilingual-MiniLM-L12-v2 --local-dir /root/model/sentence-transformer')

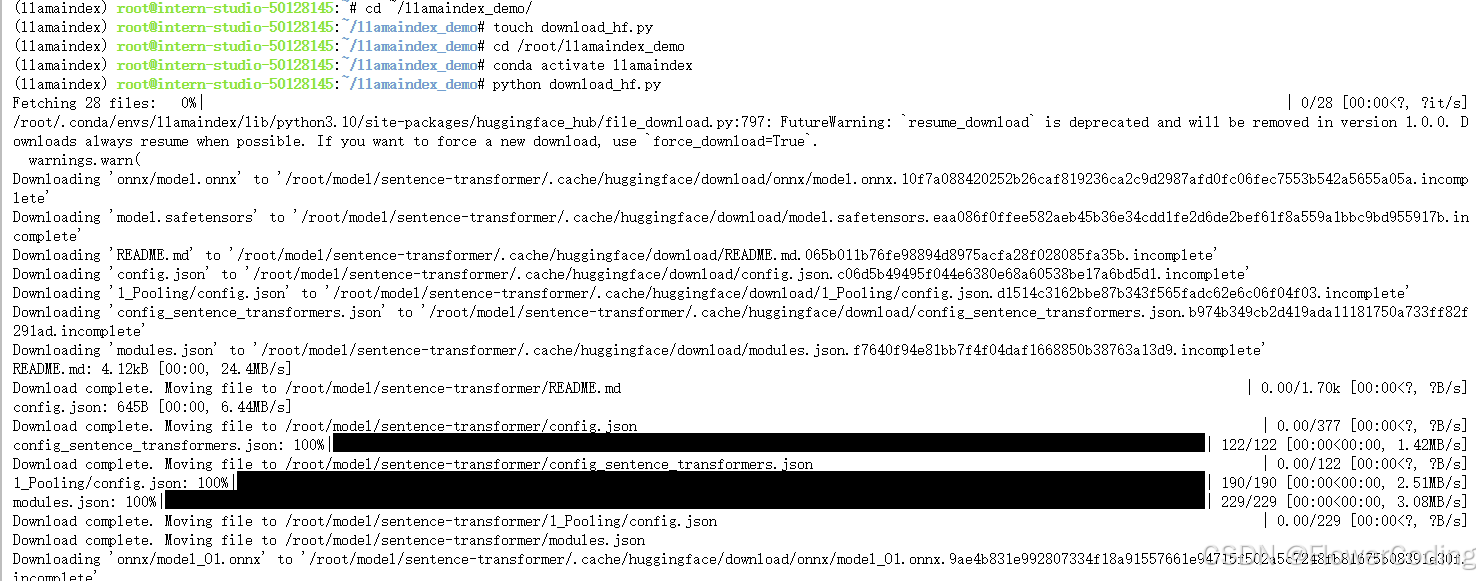

终端启动脚本下载:

cd /root/llamaindex_demo

conda activate llamaindex

python download_hf.py

3.2 LlamaIndex使用前后对比

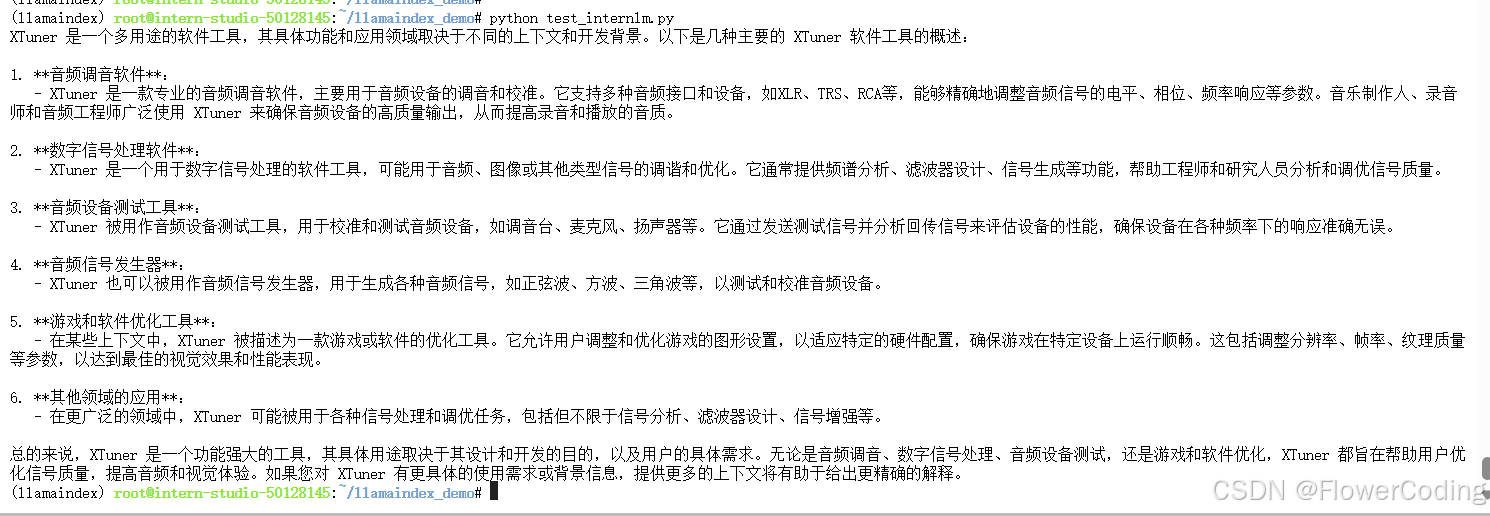

3.2.1不使用LlamaIndex RAG

创建一个新的Python文件:

cd ~/llamaindex_demo

touch test_internlm.py在test_internlm中复制以下代码:

from openai import OpenAI

base_url = "https://internlm-chat.intern-ai.org.cn/puyu/api/v1/"

api_key = "sk-请填写准确的 token!"

model="internlm2.5-latest"

# base_url = "https://api.siliconflow.cn/v1"

# api_key = "sk-请填写准确的 token!"

# model="internlm/internlm2_5-7b-chat"

client = OpenAI(

api_key=api_key ,

base_url=base_url,

)

chat_rsp = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": "xtuner是什么?"}],

)

for choice in chat_rsp.choices:

print(choice.message.content)运行代码:

conda activate llamaindex

cd ~/llamaindex_demo/

python test_internlm.py效果:

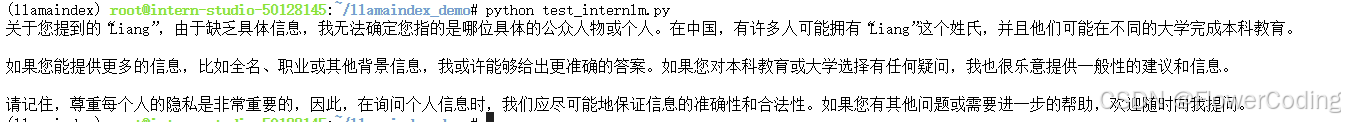

自己设定的问题:“Liang本科毕业于哪所院校”:

3.2.2使用LlamaIndex RAG

获取知识库:

conda activate llamaindex

cd ~/llamaindex_demo

mkdir data

cd data

git clone https://github.com/InternLM/xtuner.git

mv xtuner/README_zh-CN.md ./新建一个Python文件:

cd ~/llamaindex_demo

touch llamaindex_RAG.py在llamaindex_RAG中粘贴:

import os

os.environ['NLTK_DATA'] = '/root/nltk_data'

from llama_index.core import VectorStoreIndex, SimpleDirectoryReader

from llama_index.core.settings import Settings

from llama_index.embeddings.huggingface import HuggingFaceEmbedding

from llama_index.legacy.callbacks import CallbackManager

from llama_index.llms.openai_like import OpenAILike

# Create an instance of CallbackManager

callback_manager = CallbackManager()

api_base_url = "https://internlm-chat.intern-ai.org.cn/puyu/api/v1/"

model = "internlm2.5-latest"

api_key = "请填写 API Key"

# api_base_url = "https://api.siliconflow.cn/v1"

# model = "internlm/internlm2_5-7b-chat"

# api_key = "请填写 API Key"

llm =OpenAILike(model=model, api_base=api_base_url, api_key=api_key, is_chat_model=True,callback_manager=callback_manager)

#初始化一个HuggingFaceEmbedding对象,用于将文本转换为向量表示

embed_model = HuggingFaceEmbedding(

#指定了一个预训练的sentence-transformer模型的路径

model_name="/root/model/sentence-transformer"

)

#将创建的嵌入模型赋值给全局设置的embed_model属性,

#这样在后续的索引构建过程中就会使用这个模型。

Settings.embed_model = embed_model

#初始化llm

Settings.llm = llm

#从指定目录读取所有文档,并加载数据到内存中

documents = SimpleDirectoryReader("/root/llamaindex_demo/data").load_data()

#创建一个VectorStoreIndex,并使用之前加载的文档来构建索引。

# 此索引将文档转换为向量,并存储这些向量以便于快速检索。

index = VectorStoreIndex.from_documents(documents)

# 创建一个查询引擎,这个引擎可以接收查询并返回相关文档的响应。

query_engine = index.as_query_engine()

response = query_engine.query("xtuner是什么?")

print(response)运行:

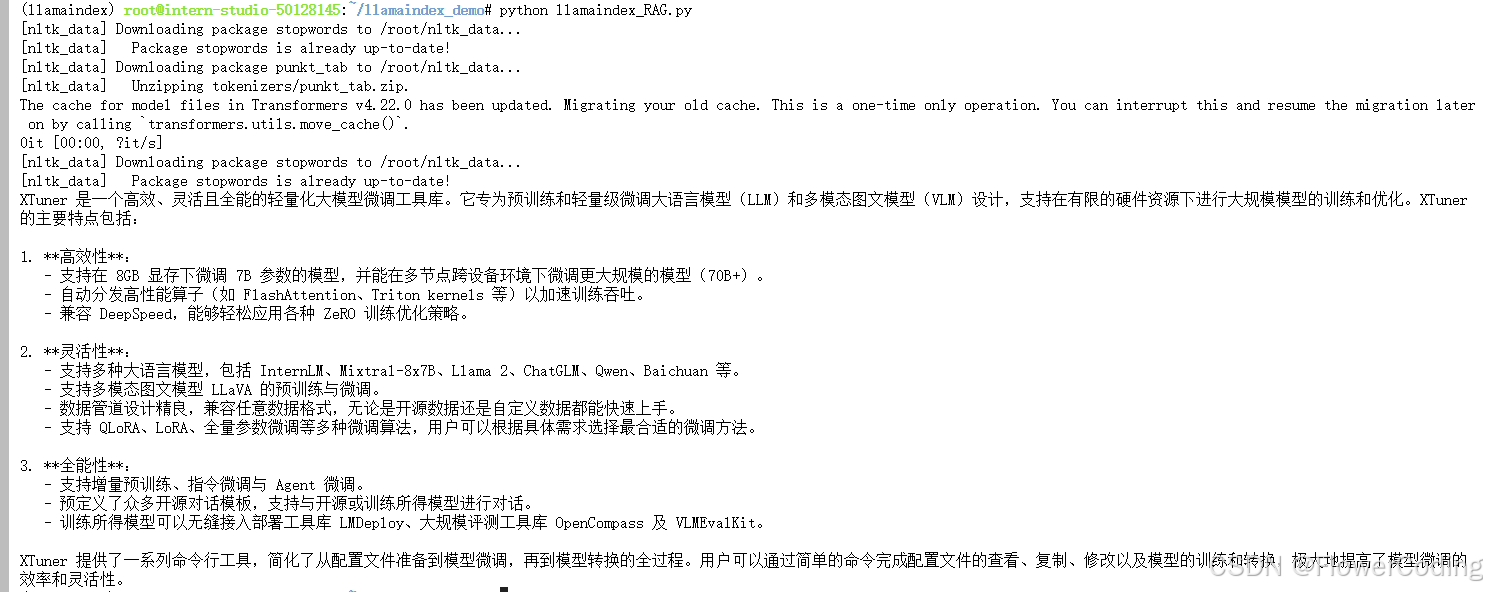

conda activate llamaindex

cd ~/llamaindex_demo/

python llamaindex_RAG.py默认问题效果:

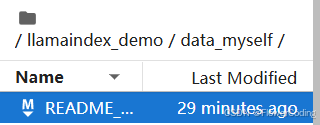

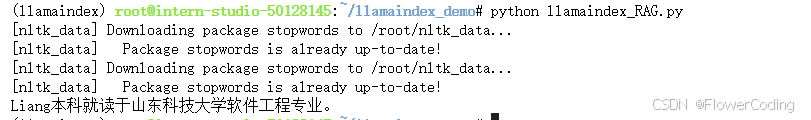

关于设定的问题“Liang本科毕业于哪所院校”,我构建了我个人信息的数据库,然后提问看一下效果:

802

802

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?