目录

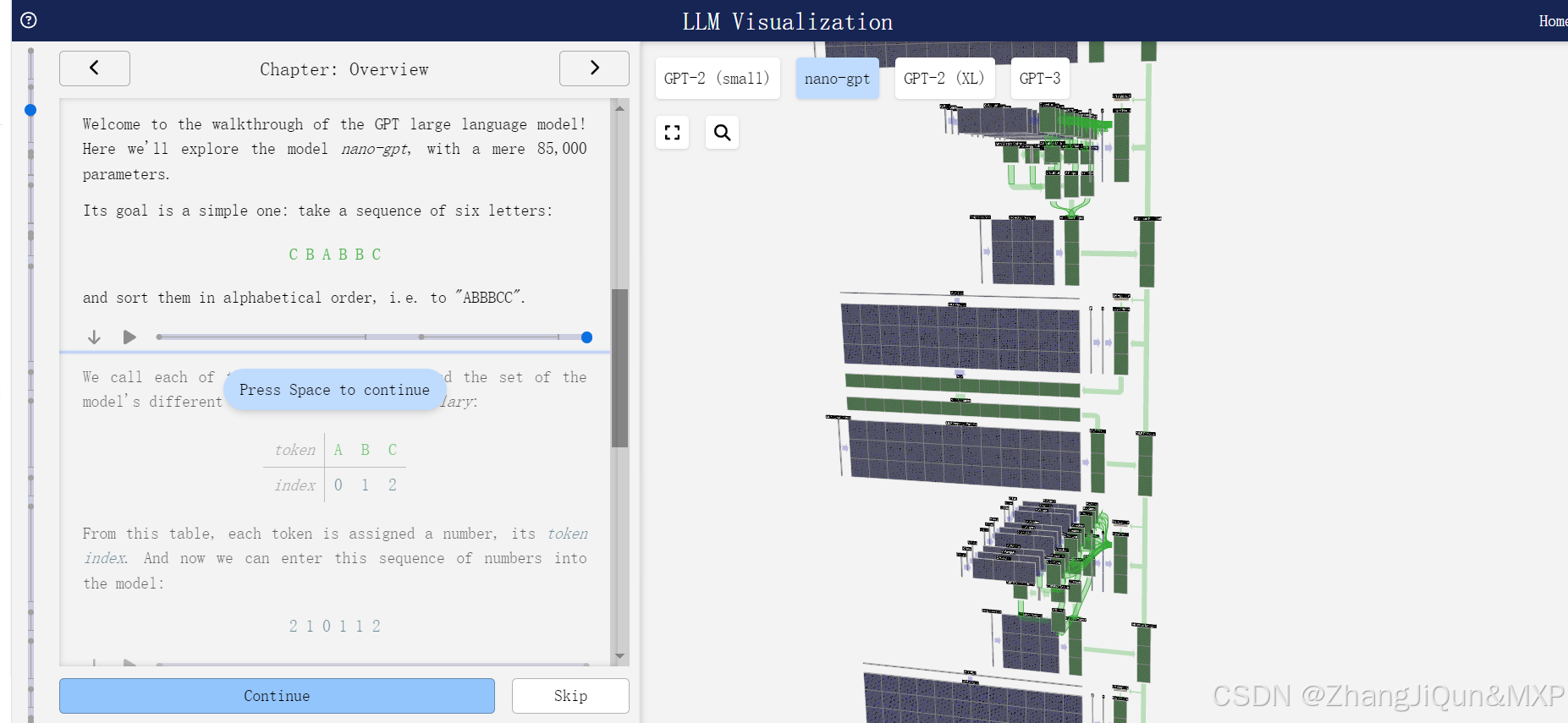

TOKEN标记器和独热编码(One-Hot Encoding)

Transformer模型中,QKV(Query、Key、Value)

判断一个Transformer模型中有多少头(即注意力头数)

残差连接(Add)和层标准化(Norm)

残差连接(Add)和层标准化(Norm)是深度学习中,特别是在Transformer模型中非常重要的两个组成部分。它们共同作用于模型的各个层中,以提高模型的训练效率和性能。

残差连接(Add)

定义与原理:

- 残差连接(Residual Connection),也称为跳跃连接(Skip Connection),是一种在深度神经网络中使用的连接技术。它允许模型的某一层的输出直接跳过一层或多层,

订阅专栏 解锁全文

订阅专栏 解锁全文

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?