1.x*y是按元素乘,也叫哈达玛积 x**y也是

2.cat dim=0在行叠一起 行多了很多 dim=1 列堆起来 列多了很多

3.print(z.sum())#所有数值的总和 最后变成一个值, print(z.numel())#所有数值的个数

z.mean()全均值等于z.sum()/z.numl()

4.矩阵范式 矩阵拉成一个向量 算长度 f long

5.矩阵转置 A=A.T

6.求和sum会丢一个维度, 为了求完不丢sum()加参数keepdims=True

7.A.cumsum 累计总和有点意思

8.内积torch.dot按元素乘最后相加,变成返回标量

9.torch.mv

10.torch中一维一定是行向量,列向量一定是一个矩阵

11.亚导数 不可导的情况 该点导数在左右两个范围之间

12.<x,w> x和w的内积

13.

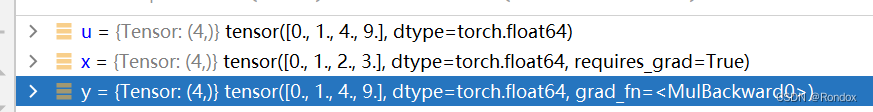

x=torch.arange(4)

y1 = 2 * torch.dot(x, x)#y1是x与自身乘加起来再乘2的一个标量 28

y2=x * x #y2是自身乘起来,矢量 [0,1,4,9]

因为向量中每个元素。非线性所以sum之后非线性 偏导相当于无视其他元素? 所以作为标量后backward也可以

14.print 参数end = '\r'导致不打印 要按一次enter才可以 这是由于linux的特性'\r'换行与win10不一样导致的

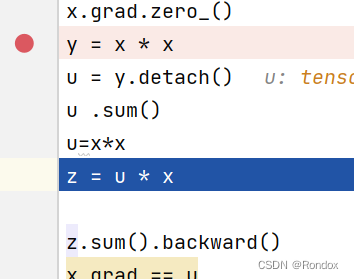

15.detach脱离计算图,这里可以分离y来返回一个新变量u,该变量与y具有相同的值, 但丢弃计算图中如何计算y的任何信息。 换句话说,梯度不会向后流经u到x。

u = y.detach() 梯度没了

这样就有了

16.Python控制流的梯度计算看不懂

本文介绍了PyTorch中的一些基本数学运算,包括向量的乘法(哈达玛积和内积)、矩阵的转置、求和与平均、累积总和、以及导数的概念。还提到了cumsum函数的应用和detach操作在计算图中的作用,用于阻止梯度传播。

本文介绍了PyTorch中的一些基本数学运算,包括向量的乘法(哈达玛积和内积)、矩阵的转置、求和与平均、累积总和、以及导数的概念。还提到了cumsum函数的应用和detach操作在计算图中的作用,用于阻止梯度传播。

1567

1567

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?