本文一共介绍6种机器学习中的优化算法:

1.梯度下降算法(SGD)

2.牛顿法

3.SGD-M

4.AdaGrad

5.AdaDelta

6.Adam

1.梯度下降算法(SGD)

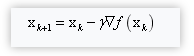

用梯度下降算法最小化目标函数f(x),梯度下降算法沿着梯度向量的反方向进行迭代以得到函数的极值点。参数迭代公式:

其中,γ为学习率,参数初始值为x0,即起始位置。

设置迭代停止条件:

1.达到最大迭代次数

2.梯度小于设定值

2.牛顿法

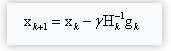

用牛顿法最小化目标函数f(x)

牛顿发直接使用驻点处导数为0得出参数迭公式:

其中,γ为学习率,参数初始值为x0,即起始位置。

用到了梯度的一阶导数gk,和二阶导数Hk。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1592

1592

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?