0. Introduction:

LangChain提供了丰富的生态,可以非常方便的封装自己的工具,并接入到LangcChain的生态中,从而实现语言模型的交互,将多个组件链接在一起,并集成额外的资源,例如 API 和数据库。

本文将介绍下如何将本地的大模型服务集成进LangChain工具链中。

1. 在本地部署LLM,并搭建API服务

利用FastAPI和uvicorn构建本地化部署大语言模型的接口服务,实现大模型的API接口调用。

参考我的另一篇文章:【FastAPI】利用FastAPI构建大模型接口服务

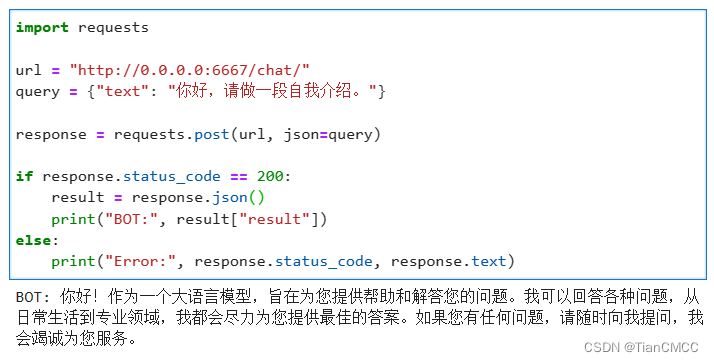

2. 测试API服务

测试完成,API成功返回LLM的回答,接下来进入下一步,将API以自定义LLM的方式封装进LangChain。

3. 封装LLM到LangChain工具

参考官方文档 How to write a custom LLM wrapper,只需要继承LangChain的LLM方法,并且实现_call方法即可。

官方提供的一个简单的示例:

from langchain.llms.base import LLM

from typing import Optional, List, Mapping, Any

class CustomLLM(LLM):

n:int

@property

def _llm_type(self) -> str:

return "custom"

def _call(self,prompt:str,stop:Optional[List[str]]=None) -> str:

if stop is not None:

raise ValueError("stop kwargs are not permitted")

return prompt[:self.n]

@property

本文介绍了如何将本地大模型服务通过FastAPI构建API,并用LangChain进行封装。然后,利用LangChain实现本地知识库问答功能,包括文档加载、文本分片、向量化、FAISS向量数据库和基于LLM的检索问答。

本文介绍了如何将本地大模型服务通过FastAPI构建API,并用LangChain进行封装。然后,利用LangChain实现本地知识库问答功能,包括文档加载、文本分片、向量化、FAISS向量数据库和基于LLM的检索问答。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

128

128

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?