nn.TransformerEncoder

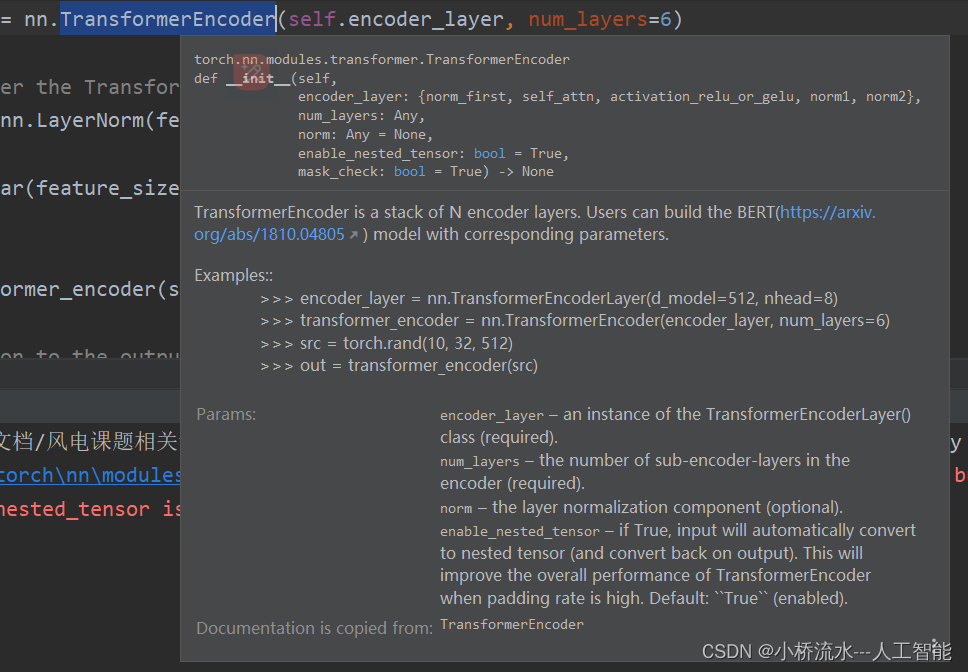

nn.TransformerEncoder 是 PyTorch 的 torch.nn 模块中提供的一个类,用于实现 Transformer 编码器的堆叠。Transformer 编码器通常由多个 nn.TransformerEncoderLayer 堆叠而成,每个层都包含一个自注意力机制和前馈神经网络。

构造函数参数

nn.TransformerEncoder 的构造函数主要接受以下参数:

encoder_layer:一个nn.TransformerEncoderLayer对象的实例或一个继承自nn.Module的自定义编码器层。num_layers:编码器层的数量,即堆叠的层数。norm:层归一化(Layer Normalization)的模块或None。如果为None,则不使用层归一化。

主要特性

- 堆叠的编码器层:通过堆叠多个

nn.TransformerEncoderLayer,模型能够捕获输入序列中更复杂的依赖关系。 - 残差连接:每个编码器层都使用了残差连接,这有助于模型在训练过程中保持梯度的稳定性,从而可以训练更深的网络。

文章介绍了PyTorch中nn.TransformerEncoder类及其构造,包括参数解释、主要特性和一个使用示例。它展示了如何堆叠TransformerEncoderLayer以处理复杂依赖关系,并利用残差连接提高训练稳定性。

文章介绍了PyTorch中nn.TransformerEncoder类及其构造,包括参数解释、主要特性和一个使用示例。它展示了如何堆叠TransformerEncoderLayer以处理复杂依赖关系,并利用残差连接提高训练稳定性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9万+

9万+