在大模型应用快速发展的背景下,如何高效地进行本地化部署,让企业和研究机构能够在自有算力环境中稳定运行和微调大模型,成为当前的技术挑战。

DeepSeek-V3/R1 671B 满血版 的全参数微调方案,正是针对这一痛点,由中国科学院自动化研究所与中科闻歌联合推出的一份 完整的开源指南(DeepSeek-671B-SFT-Guide),为有本地化部署需求的团队提供了从训练到推理的全流程方案,并总结了关键的优化策略和实践经验。

当前本地化部署的痛点

🔸 超大规模参数模型的训练与优化:DeepSeek-V3/R1 采用 671B(6710 亿)参数量,这一规模远超一般企业可直接应用的开源大模型。如何在有限的本地算力环境下高效部署和微调?如何优化计算资源使用? 这些都是当前面临的关键问题。

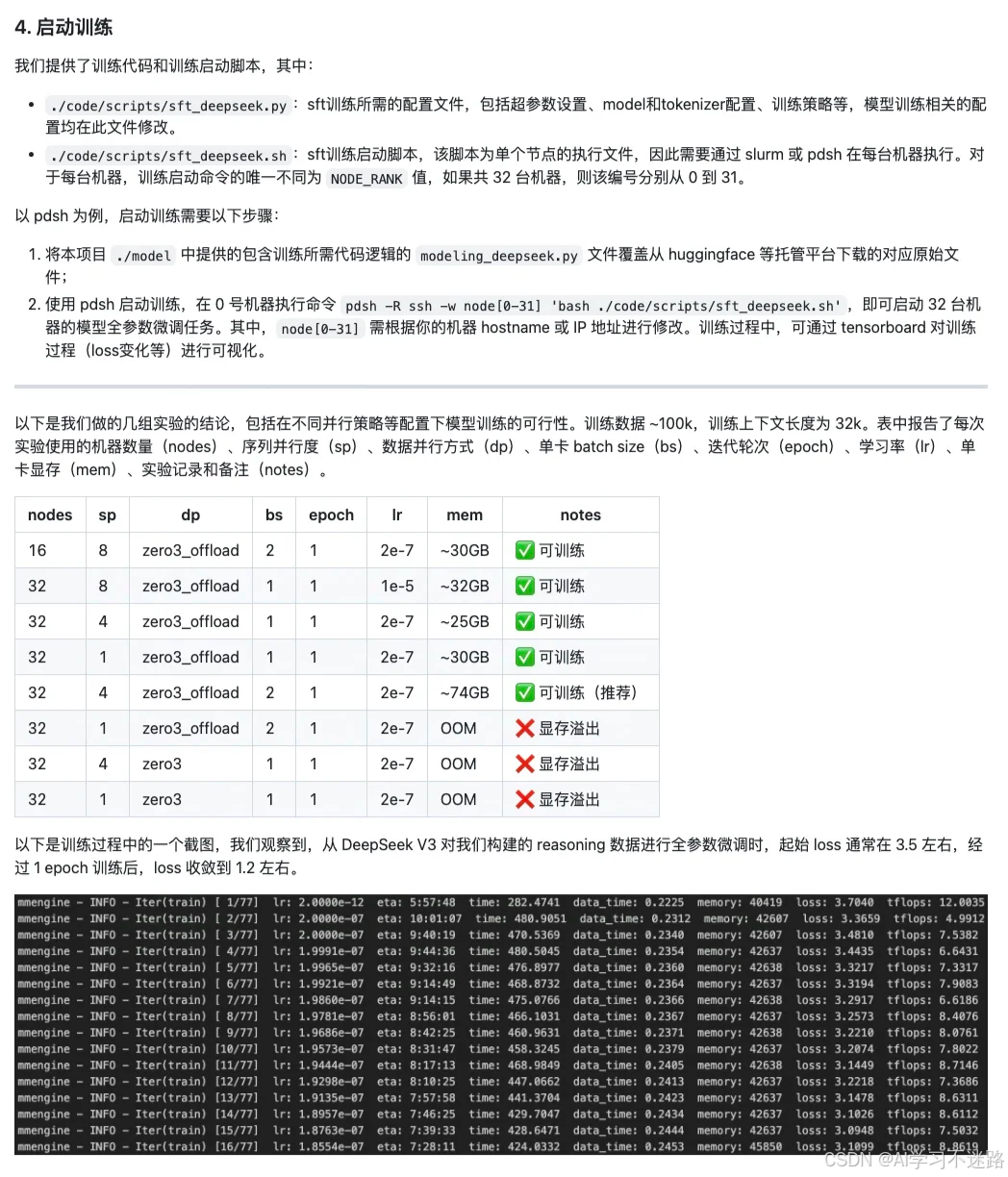

🔸 并行计算的复杂度:超大规模模型的训练涉及 数据并行(DeepSpeed ZeRO)、序列并行(SP)等技术栈,如何在自有服务器或集群上快速搭建、优化并行计算策略,以达到高效推理和训练的效果,是许多技术团队的痛点。

🔸 模型稳定性与适配性:本地化部署时,不同的硬件架构(GPU/TPU)、存储IO、带宽都会对大模型的性能产生影响。如何确保 DeepSeek-V3/R1 在不同环境下高效运行,减少部署过程中的问题,是许多工程师需要解决的现实挑战。

DeepSeek-V3/R1 671B 微调指南的价值

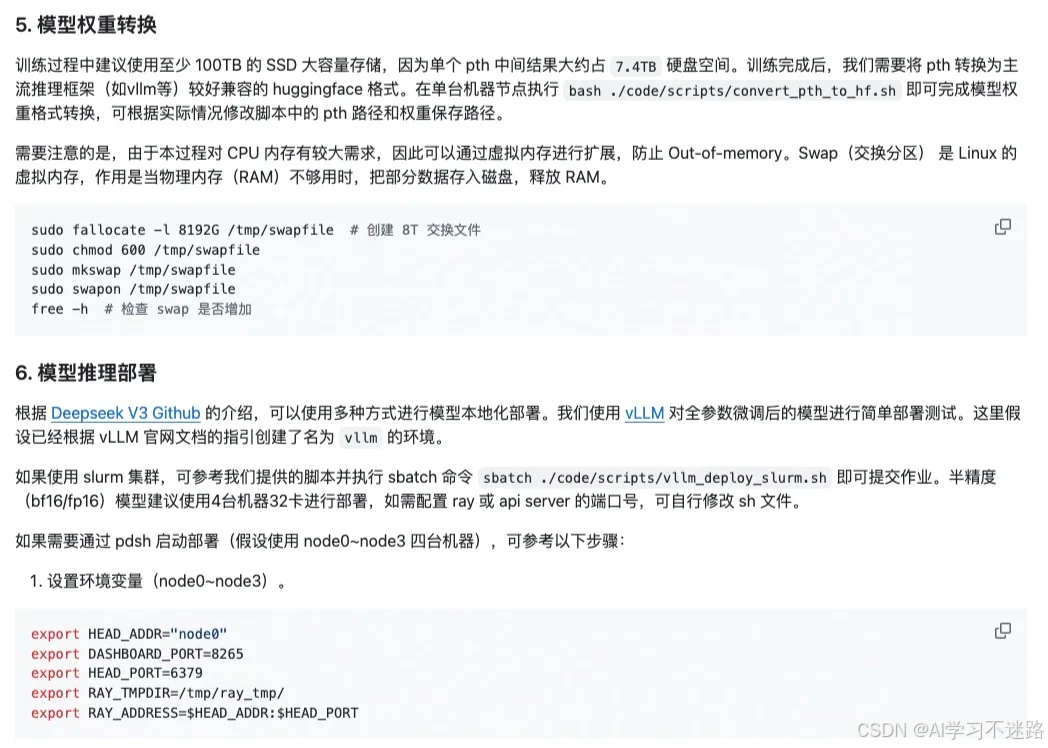

✅ 完整代码与脚本:指南提供了 从模型训练到推理的完整代码,并涵盖 DeepSeek-V3/R1 训练逻辑的 modeling 文件(详见 ./model),基于 DeepSeek-V3 论文并结合 DeepSeek-V2 进行优化补全,让本地化部署团队能够快速复现官方训练方案。

✅ 高效分布式训练方案:支持 DeepSpeed ZeRO + 序列并行(SP) 的混合并行方案,优化本地算力使用,降低部署门槛,帮助团队在有限资源下最大化训练效率,无需昂贵的大规模超算集群。

✅ 实战经验总结:指南详细总结了在本地训练与部署过程中遇到的核心难题,并给出了优化策略,包括资源调度、显存管理、训练稳定性提升等关键点,为本地化部署团队提供直接可用的参考方案。

对于希望在企业自有服务器、本地 GPU 服务器、或私有云环境中部署 DeepSeek-V3/R1 的团队来说,这份指南无疑是当前最具实用价值的开源参考之一。

如果你正在探索 DeepSeek-V3/R1 的本地化部署路径,或希望优化现有的大模型训练流程,这份指南值得深入研究!

2655

2655

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?