目录

一、前言

P-Tuning和Prompt Tuning是两个相似但有细微区别的概念,它们都属于在预训练语言模型上使用提示(prompt)来提升模型在特定任务上的表现的技术。下面是它们的主要区别:

-

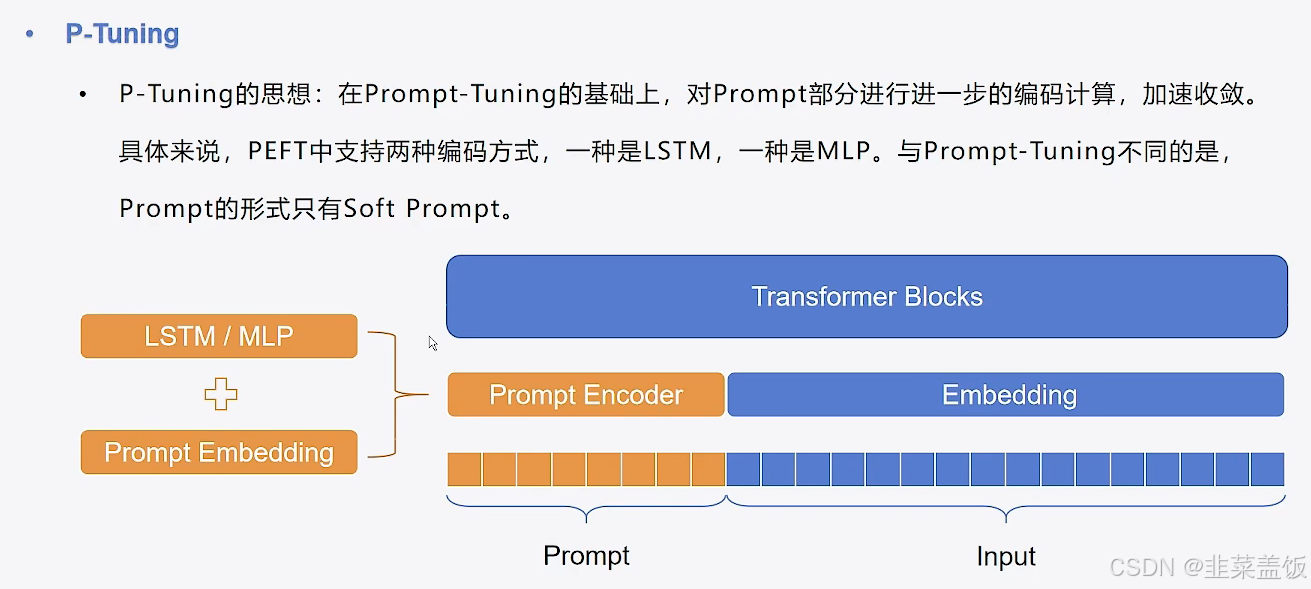

P-Tuning:

P-Tuning是一种特定的提示微调方法,最早由Microsoft Research提出的。它特别强调通过优化可学习的提示向量,来引导预训练模型在特定任务上的表现。P-Tuning

的关键思想是在输入中插入一些新的、可训练的提示嵌入(embedding),并通过这些嵌入调整模型的输出,而不需要微调模型的全部权重。 -

Prompt Tuning:

Prompt Tuning是一个更广泛的术语,指的是任何通过调整输入提示来优化预训练模型的方法。Prompt Tuning不一定局限于P-Tuning,它可以包括多种方法,比如直接使用自然语言的提示,或者构造可训练的提示嵌入(即P-Tuning的一种特例)。

Prompt Tuning 微调的具体方法可以参考如下:

[Prompt-Tuning微调方法]

(https://blog.youkuaiyun.com/niulinbiao/article/details/144512732)

跟P-Tuning的微调方式差不多,区别就在于P-Tuning在Prompt-Tuning的Soft-Prompt基础上多加了一些编码计算,例如:MLP或者LSTM

二、P-tuning实战

预训练模型与分词模型——Qwen/Qwen2.5-0.5B-Instruct

数据集——lyuricky/alpaca_data_zh_51k

2.1、下载模型到本地

# 下载数据集

dataset_file = load_dataset("lyuricky/alpaca_data_zh_51k", split="train", cache_dir="./data/alpaca_data")

ds = load_dataset("./data/alpaca_data", split="train")

# 下载分词模型

tokenizer = AutoTokenizer.from_pretrained("Qwen/Qwen2.5-0.5B-Instruct")

# Save the tokenizer to a local directory

tokenizer.save_pretrained("./local_tokenizer_model")

#下载与训练模型

model = AutoModelForCausalLM.from_pretrained(

pretrained_model_name_or_path="Qwen/Qwen2.5-0.5B-Instruct", # 下载模型的路径

torch_dtype="auto",

low_cpu_mem_usage=True,

cache_dir="./local_model_cache" # 指定本地缓存目录

)

2.2、加载模型与数据集

#加载分词模型

tokenizer_model = AutoTokenizer.from_pretrained("../local_tokenizer_model")

# 加载数据集

ds = load_dataset("../data/alpaca_data", split="train[:10%]")

# 记载模型

model = AutoModelForCausalLM.from_pretrained(

pretrained_model_name_or_path="../local_llm_model/models--Qwen--Qwen2.5-0.5B-Instruct/snapshots/7ae557604adf67be50417f59c2c2f167def9a775",

torch_dtype="auto",

device_map="cuda:0")

2.3、处理数据

"""

并将其转换成适合用于模型训练的输入格式。具体来说,

它将原始的输入数据(如用户指令、用户输入、助手输出等)转换为模型所需的格式,

包括 input_ids、attention_mask 和 labels。

"""

def process_func(example, tokenizer=tokenizer_model):

MAX_LENGTH = 256

input_ids, attention_mask, labels = [], [], []

instruction = tokenizer("\n".join(["Human: " + example["instruction"], example[

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

538

538

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?