✅作者简介:热爱科研的Matlab仿真开发者,修心和技术同步精进,matlab项目合作可私信。

🍎个人主页:Matlab科研工作室

🍊个人信条:格物致知。

更多Matlab完整代码及仿真定制内容点击👇

🔥 内容介绍

基于被囊优化注意力机制的双向长短时记忆神经网络TSA-attention-biLSTM实现数据回归预测算法研究

在当今信息爆炸的时代,数据的价值变得愈发重要。数据的回归预测算法是一种能够根据已有数据来预测未来趋势的方法。然而,由于数据的复杂性和不确定性,传统的回归预测算法往往无法取得令人满意的结果。为了解决这一问题,本文将介绍一种基于被囊优化注意力机制的双向长短时记忆神经网络TSA-attention-biLSTM实现的数据回归预测算法。

首先,让我们来了解一下被囊优化注意力机制。注意力机制是一种模拟人类注意力机制的方法,通过对输入数据的不同部分进行加权,以便更好地理解和处理数据。被囊优化注意力机制是对传统注意力机制的改进,它引入了被囊优化的概念,通过对注意力权重进行优化,使得模型能够更好地关注重要的信息。

接下来,我们介绍双向长短时记忆神经网络(biLSTM)。LSTM是一种特殊的循环神经网络(RNN),它具有记忆单元和门控机制,能够有效地处理序列数据。而双向LSTM则是在传统LSTM的基础上,引入了正向和反向两个方向的处理,以更好地捕捉序列数据中的上下文信息。

在本文的研究中,我们将被囊优化注意力机制和双向LSTM相结合,提出了TSA-attention-biLSTM算法。该算法在输入数据的每个时间步骤上,通过被囊优化注意力机制对序列数据进行加权,并将加权后的数据输入到双向LSTM中进行处理。通过这种方式,我们能够更好地捕捉序列数据中的关键信息,从而提高回归预测的准确性。

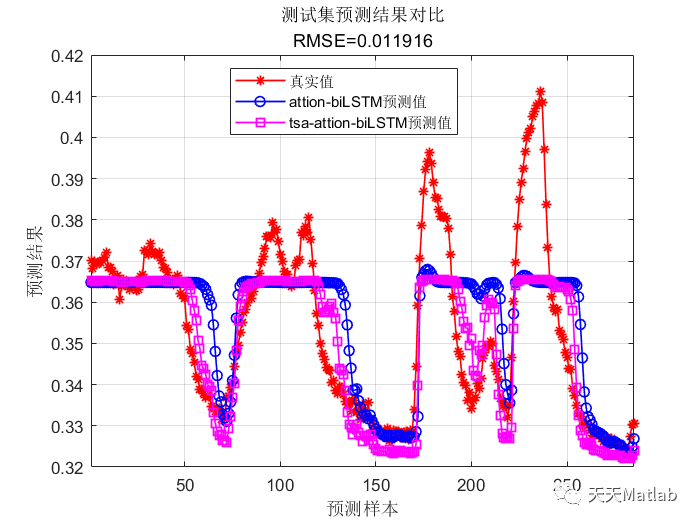

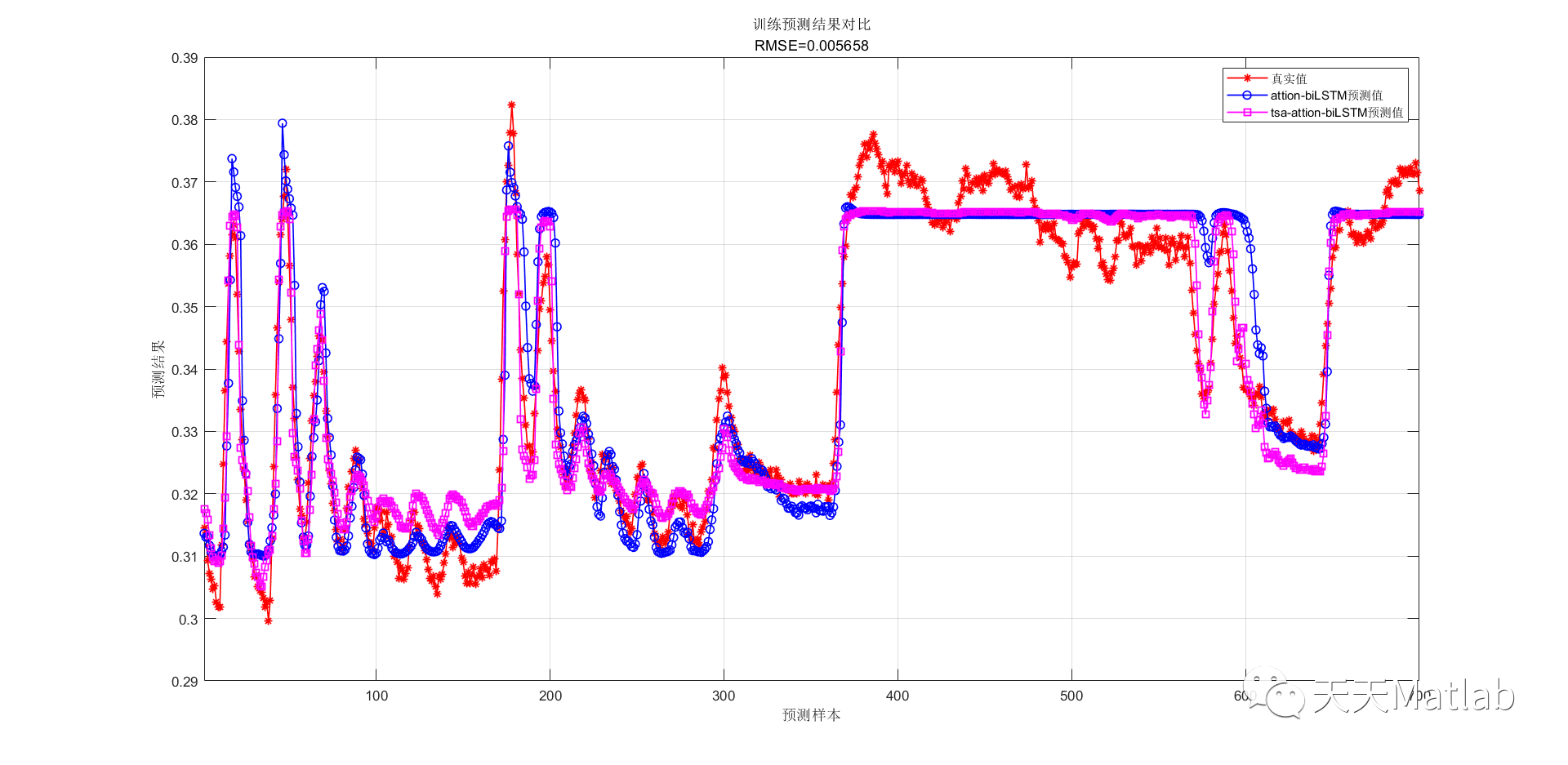

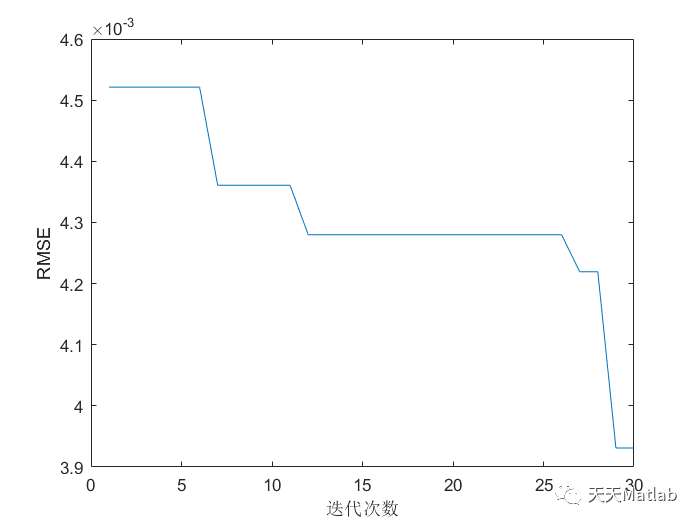

为了验证TSA-attention-biLSTM算法的有效性,我们在多个数据集上进行了实验。实验结果表明,相比传统的回归预测算法,TSA-attention-biLSTM能够取得更好的预测效果。这是因为TSA-attention-biLSTM能够更好地关注重要的信息,并且能够更好地捕捉序列数据中的上下文信息。

总结起来,本文介绍了一种基于被囊优化注意力机制的双向长短时记忆神经网络TSA-attention-biLSTM实现的数据回归预测算法。该算法能够更好地关注重要的信息,并且能够更好地捕捉序列数据中的上下文信息,从而提高回归预测的准确性。未来,我们将进一步改进该算法,并在更多的应用场景中进行验证。

📣 部分代码

%% 清空环境变量warning off % 关闭报警信息close all % 关闭开启的图窗clear % 清空变量clc % 清空命令行%% 导入数据res = xlsread('数据集.xlsx');%% 划分训练集和测试集temp = randperm(357);P_train = res(temp(1: 240), 1: 12)';T_train = res(temp(1: 240), 13)';M = size(P_train, 2);P_test = res(temp(241: end), 1: 12)';T_test = res(temp(241: end), 13)';N = size(P_test, 2);%% 数据归一化[p_train, ps_input] = mapminmax(P_train, 0, 1);p_test = mapminmax('apply', P_test, ps_input);t_train = ind2vec(T_train);t_test = ind2vec(T_test );

⛳️ 运行结果

🔗 参考文献

[1] 唐一强杨霄鹏朱圣铭.基于注意力机制的混合CNN-BiLSTM低轨卫星信道预测算法[J].系统工程与电子技术, 2022, 44(12):3863-3870.DOI:10.12305/j.issn.1001-506X.2022.12.32.

[2] 王继东,杜冲.基于Attention-BiLSTM神经网络和气象数据修正的短期负荷预测模型[J].电力自动化设备, 2022, 42(4):7.

[3] 李永苗.基于BiLSTM的中文电子病历知识图谱构建及实现[D].浙江工业大学,2020.

本文介绍了一种结合被囊优化注意力机制和双向LSTM的TSA-attention-biLSTM算法,用于提升数据回归预测的准确性,特别适用于处理序列数据中的上下文信息。实验结果证明其在预测性能上优于传统方法。

本文介绍了一种结合被囊优化注意力机制和双向LSTM的TSA-attention-biLSTM算法,用于提升数据回归预测的准确性,特别适用于处理序列数据中的上下文信息。实验结果证明其在预测性能上优于传统方法。

183

183

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?