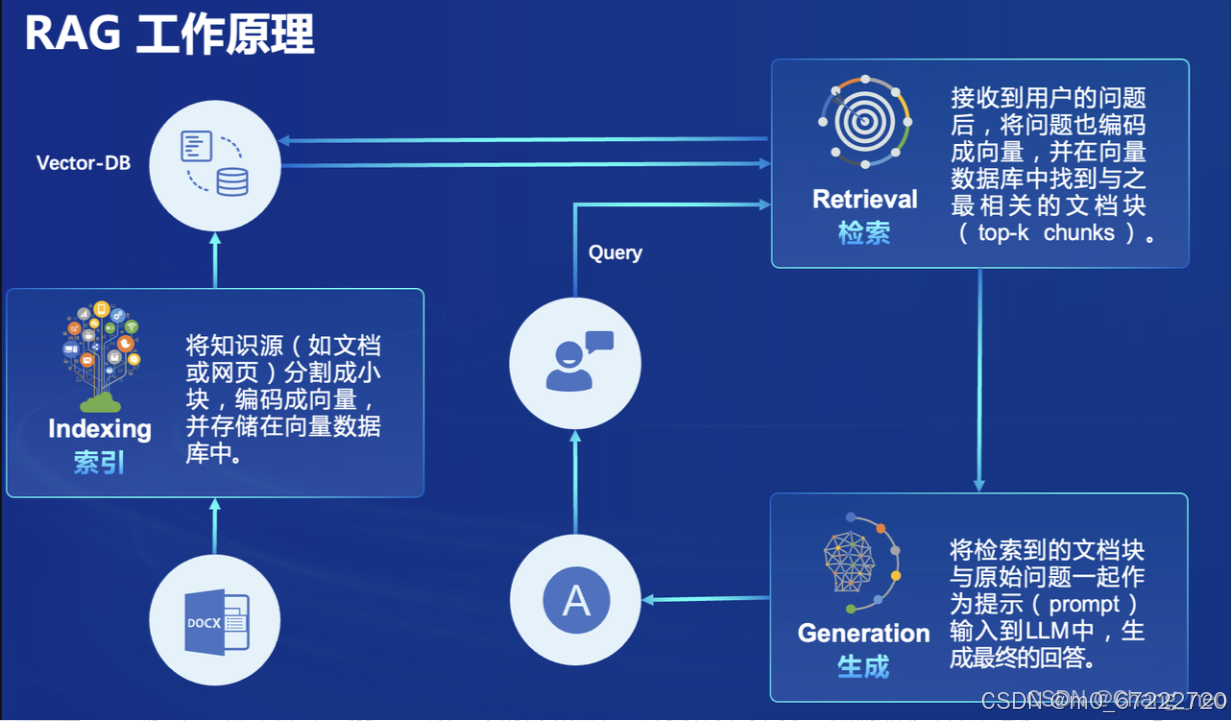

RAG的基本原理如上图所示,它能够让基础模型实现非参数知识更新,无需训练就可以掌握新领域的知识。本次课程选用了LlamaIndex框架。LlamaIndex 是一个上下文增强的 LLM 框架,旨在通过将其与特定上下文数据集集成,增强大型语言模型(LLMs)的能力。

1.环境、模型准备

1.1.配置基础环境

创建一个30%开发机,点击进入开发机选项。

进入开发机后,创建新的conda环境,命名为 llamaindex,在命令行模式下运行:

conda create -n llamaindex python=3.10

conda activate llamaindex

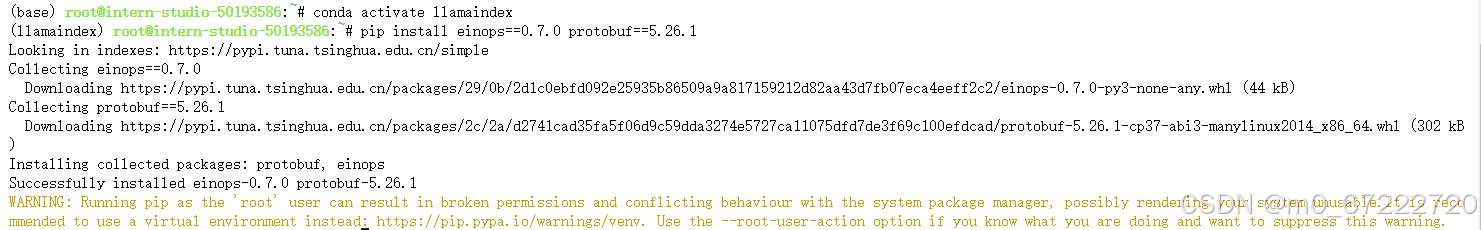

pip install einops==0.7.0 protobuf==5.26.1

1.2.安装 Llamaindex

安装 Llamaindex和相关的包

pip install llama-index==0.11.20

pip install llama-index-llms-replicate==0.3.0

pip install llama-index-llms-openai-like==0.2.0

pip install llama-index-embeddings-huggingface==0.3.1

pip install llama-index-embeddings-instructor==0.2.1

pip install torch==2.5.0 torchvision==0.20.0 torchaudio==2.5.0 --index-url https://download.pytorch.org/whl/cu121

1.3.下载 Sentence Transformer 模型

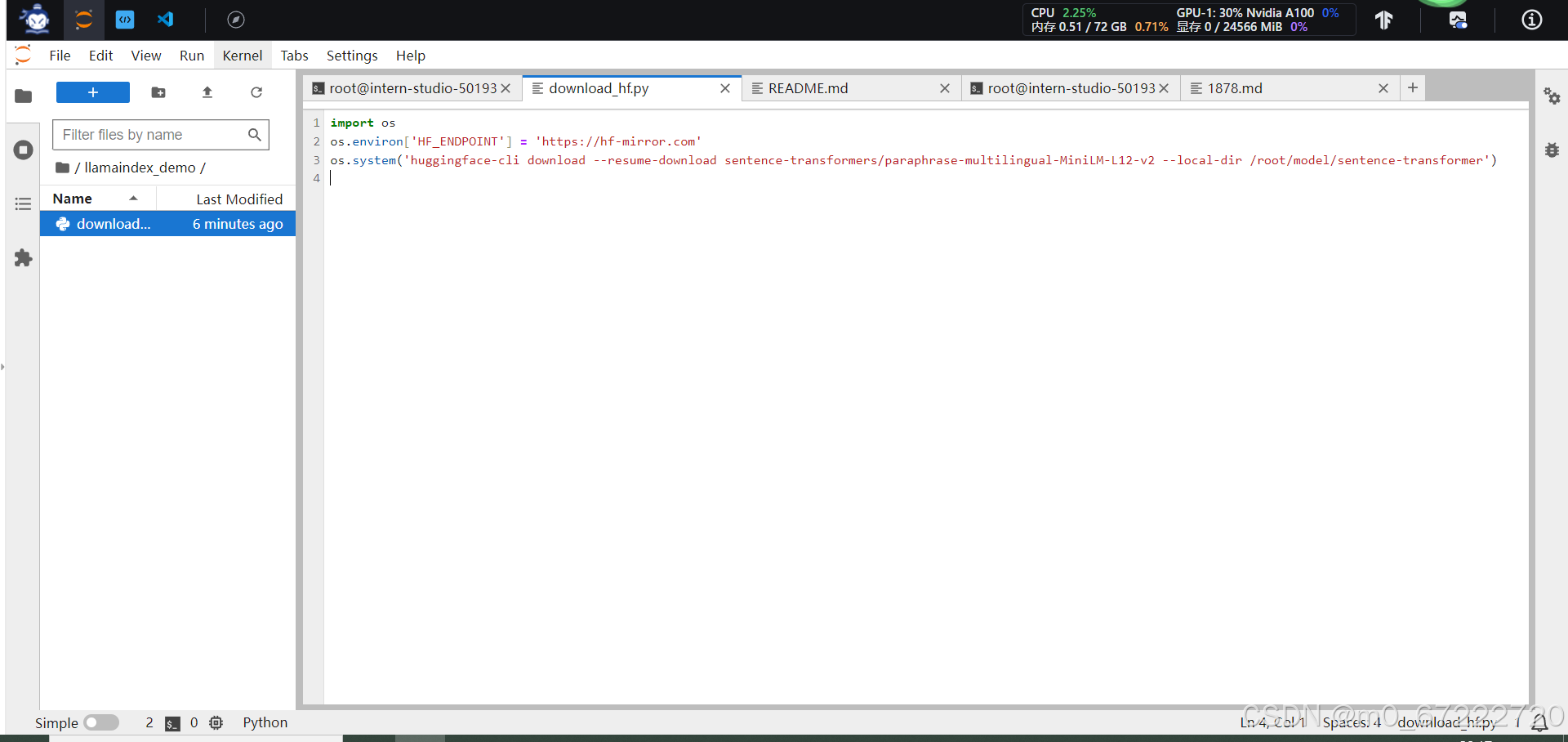

运行以下指令,新建一个python文件

cd ~

mkdir llamaindex_demo

mkdir model

cd ~/llamaindex_demo

touch download_hf.py

打开download_hf.py 贴入以下代码

import os

os.environ['HF_ENDPOINT'] = 'https://hf-mirror.com'

os.system('huggingface-cli download --resume-download sentence-transformers/paraphrase-multilingual-MiniLM-L12-v2 --local-dir /root/model/sentence-transformer')

然后,在 /root/llamaindex_demo 目录下执行该脚本即可自动开始下载:

cd /root/llamaindex_demo

conda activate llamaindex

python download_hf.py

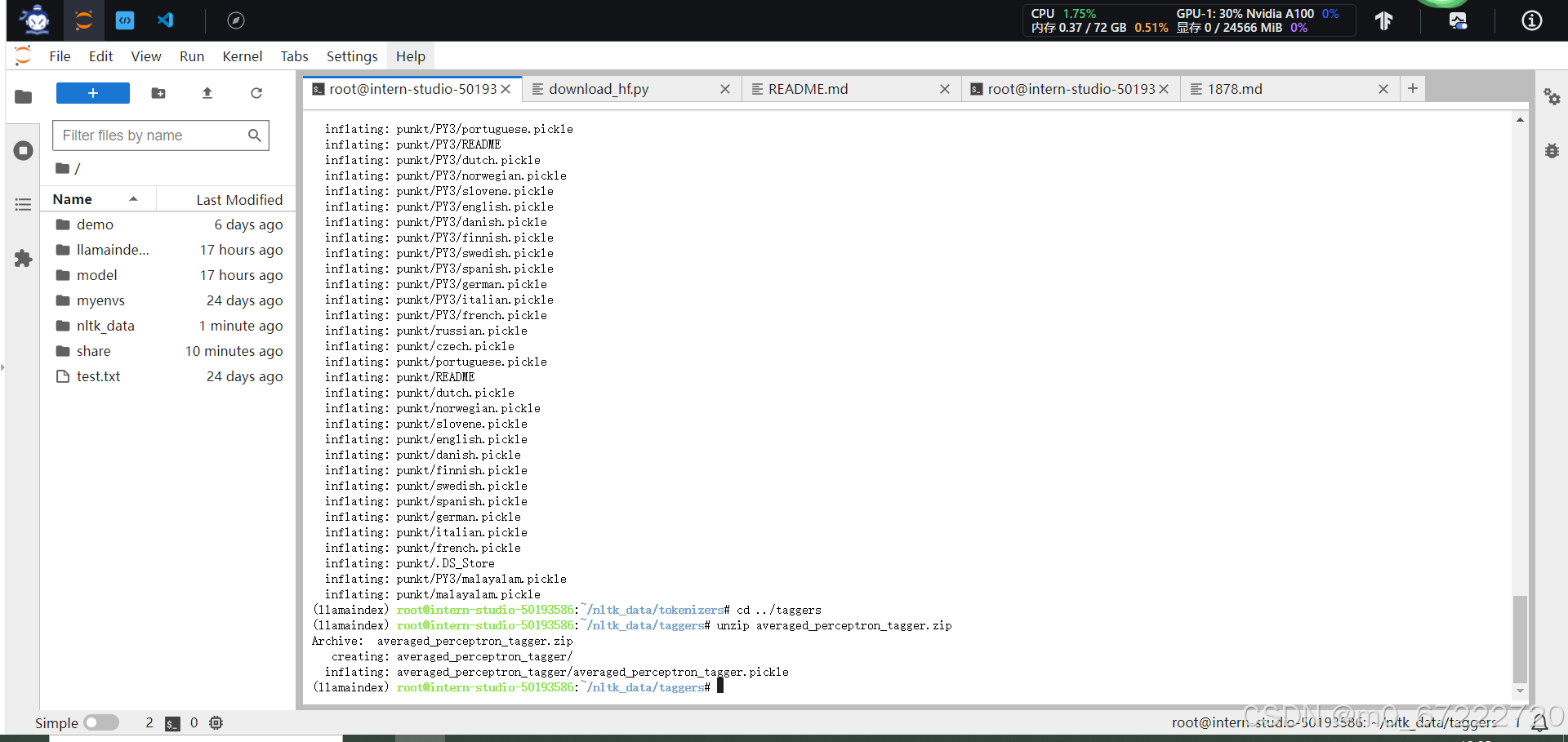

1.4 下载 NLTK 相关资源

使用开源词向量模型构建开源词向量的时候,需要用到第三方库 nltk 的一些资源。正常情况下,其会自动从互联网上下载,但可能由于网络原因会导致下载中断(如1.2.3节),此处我们可以从国内仓库镜像地址下载相关资源,保存到服务器上。

cd /root

git clone https://gitee.com/yzy0612/nltk_data.git --branch gh-pages

cd nltk_data

mv packages/* ./

cd tokenizers

unzip punkt.zip

cd ../taggers

unzip averaged_perceptron_tagger.zip

之后使用时服务器即会自动使用已有资源,无需再次下载。

2.是否使用 LlamaIndex 前后对比

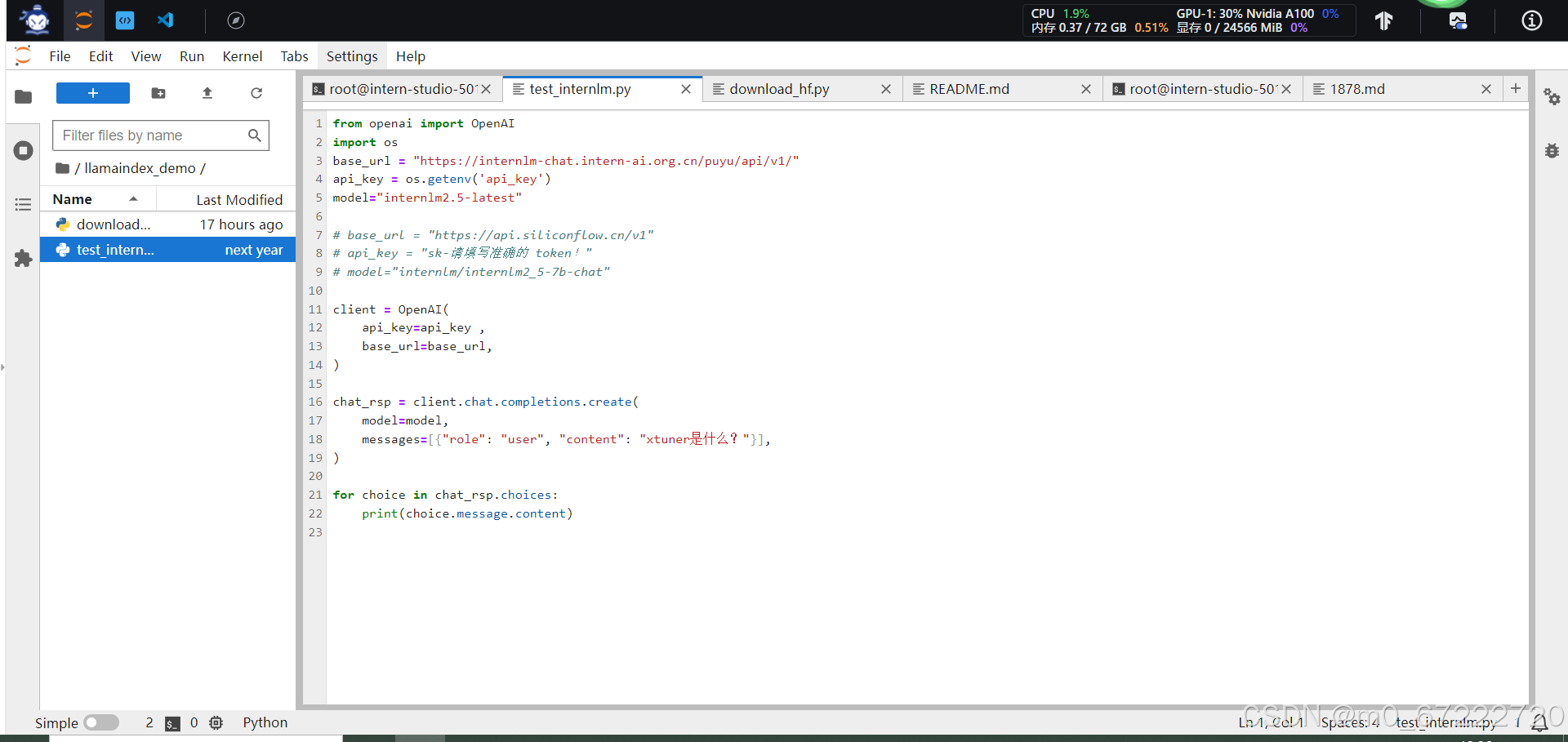

2.1.不使用 LlamaIndex RAG(仅API)

运行以下指令,新建一个python文件

cd ~/llamaindex_demo

touch test_internlm.py

打开test_internlm.py 贴入以下代码

from openai import OpenAI

import os

base_url = "https://internlm-chat.intern-ai.org.cn/puyu/api/v1/"

api_key = os.getenv('api_key')

model="internlm2.5-latest"

# base_url = "https://api.siliconflow.cn/v1"

# api_key = "sk-请填写准确的 token!"

# model="internlm/internlm2_5-7b-chat"

client = OpenAI(

api_key=api_key ,

base_url=base_url,

)

chat_rsp = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": "xtuner是什么?"}],

)

for choice in chat_rsp.choices:

print(choice.message.content)

上述代码是要问API,xtuner是什么?

我们需要先获取浦语API的apikey(参考python使用)然后执行以下命令。

export api_key="填写你的api key"

conda activate llamaindex

cd ~/llamaindex_demo/

python test_internlm.py

![]()

可以看到直接调用浦语API,浦语API无法回答xtuner是什么。

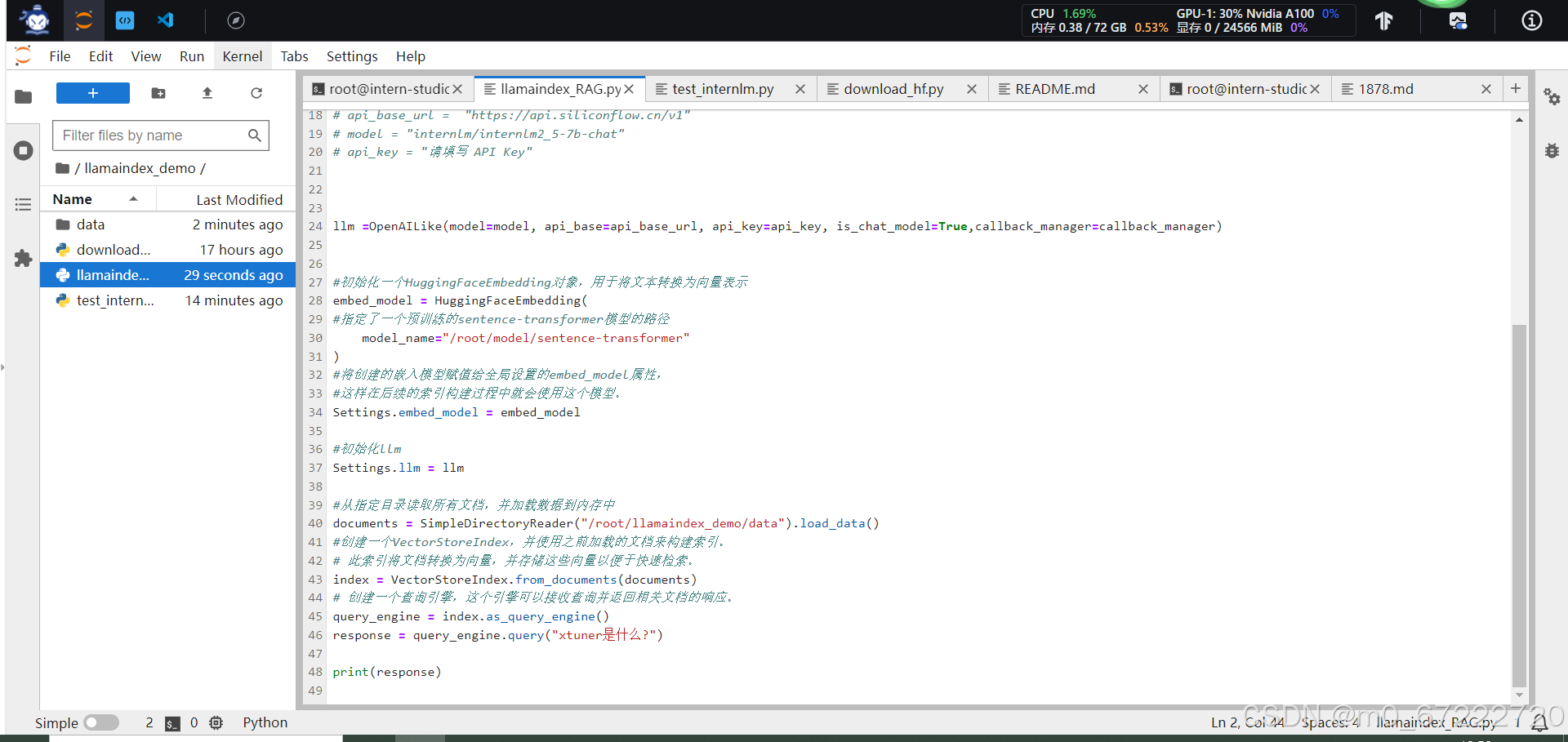

2.2.使用 API+LlamaIndex

我们现在要构建一个知识库,让API能知道xtuner是什么。这里直接选择xtuner的官方readme文档构建知识库。

cd ~/llamaindex_demo

mkdir data

cd data

git clone https://github.com/InternLM/xtuner.git

mv xtuner/README_zh-CN.md ./

运行以下指令,新建一个python文件。

cd ~/llamaindex_demo

touch llamaindex_RAG.py

在新建的文件中粘贴以下代码

import os

os.environ['NLTK_DATA'] = '/root/nltk_data'

from llama_index.core import VectorStoreIndex, SimpleDirectoryReader

from llama_index.core.settings import Settings

from llama_index.embeddings.huggingface import HuggingFaceEmbedding

from llama_index.legacy.callbacks import CallbackManager

from llama_index.llms.openai_like import OpenAILike

# Create an instance of CallbackManager

callback_manager = CallbackManager()

api_base_url = "https://internlm-chat.intern-ai.org.cn/puyu/api/v1/"

model = "internlm2.5-latest"

api_key = os.getenv('api_key')

# api_base_url = "https://api.siliconflow.cn/v1"

# model = "internlm/internlm2_5-7b-chat"

# api_key = "请填写 API Key"

llm =OpenAILike(model=model, api_base=api_base_url, api_key=api_key, is_chat_model=True,callback_manager=callback_manager)

#初始化一个HuggingFaceEmbedding对象,用于将文本转换为向量表示

embed_model = HuggingFaceEmbedding(

#指定了一个预训练的sentence-transformer模型的路径

model_name="/root/model/sentence-transformer"

)

#将创建的嵌入模型赋值给全局设置的embed_model属性,

#这样在后续的索引构建过程中就会使用这个模型。

Settings.embed_model = embed_model

#初始化llm

Settings.llm = llm

#从指定目录读取所有文档,并加载数据到内存中

documents = SimpleDirectoryReader("/root/llamaindex_demo/data").load_data()

#创建一个VectorStoreIndex,并使用之前加载的文档来构建索引。

# 此索引将文档转换为向量,并存储这些向量以便于快速检索。

index = VectorStoreIndex.from_documents(documents)

# 创建一个查询引擎,这个引擎可以接收查询并返回相关文档的响应。

query_engine = index.as_query_engine()

response = query_engine.query("xtuner是什么?")

print(response)

然后运行以下命令,即可调用rag+api了

export api_key="填写你的api key"

conda activate llamaindex

cd ~/llamaindex_demo/

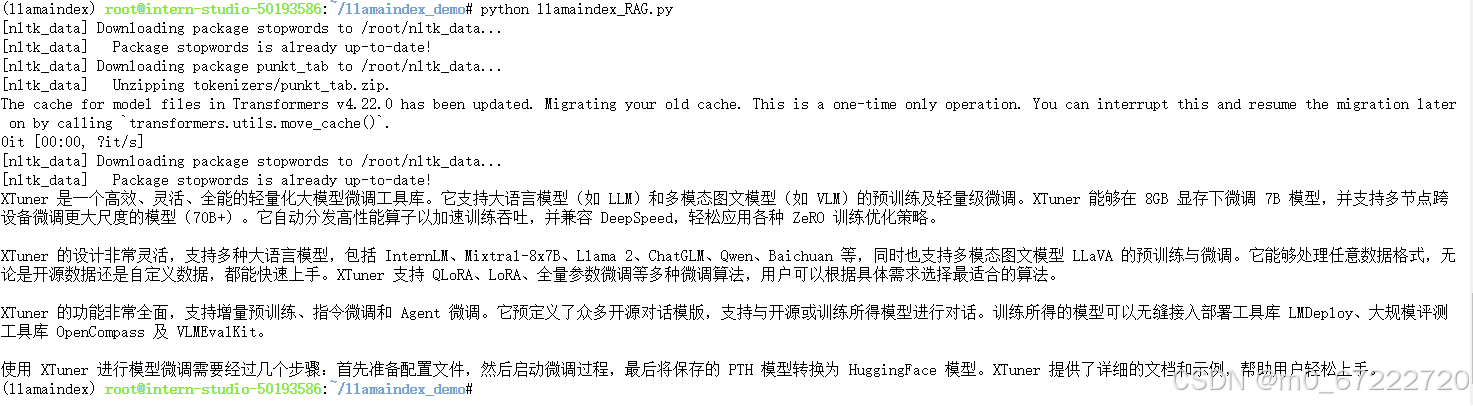

python llamaindex_RAG.py

借助RAG,浦语API就能很详细的回答之前不会回答的"xtuner是什么"的问题了。

二、LlamaIndex+本地部署InternLM

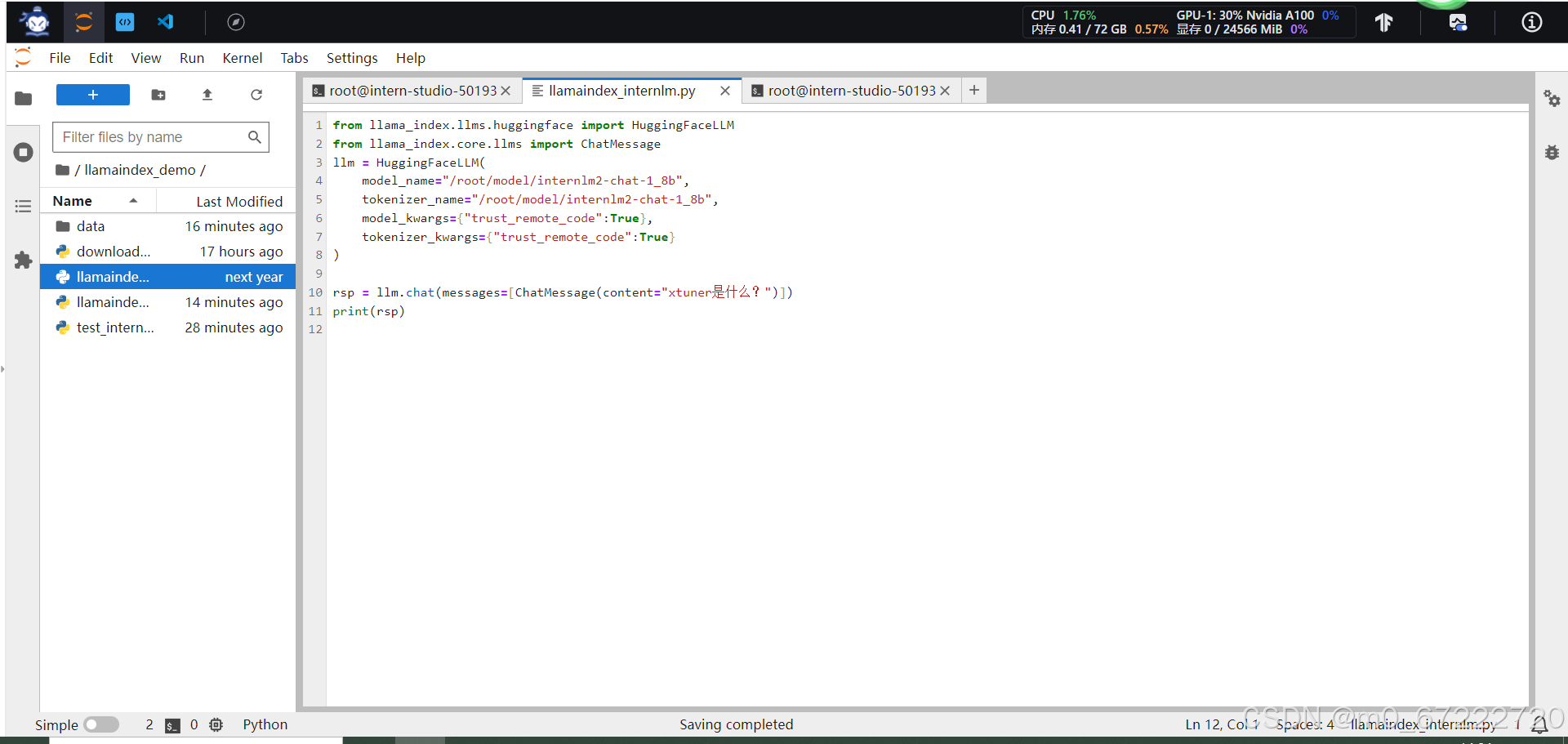

1.LlamaIndex HuggingFaceLLM

运行以下指令,把 InternLM2 1.8B 软连接出来

cd ~/model

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm2-chat-1_8b/ ./

运行以下指令,新建一个 python 文件

cd ~/llamaindex_demo

touch llamaindex_internlm.py

打开 llamaindex_internlm.py 贴入以下代码

from llama_index.llms.huggingface import HuggingFaceLLM

from llama_index.core.llms import ChatMessage

llm = HuggingFaceLLM(

model_name="/root/model/internlm2-chat-1_8b",

tokenizer_name="/root/model/internlm2-chat-1_8b",

model_kwargs={"trust_remote_code":True},

tokenizer_kwargs={"trust_remote_code":True}

)

rsp = llm.chat(messages=[ChatMessage(content="xtuner是什么?")])

print(rsp)

运行命令

conda activate llamaindex

pip install llama-index-llms-huggingface

pip install sentencepiece==0.2.0

cd ~/llamaindex_demo/

python llamaindex_internlm.py

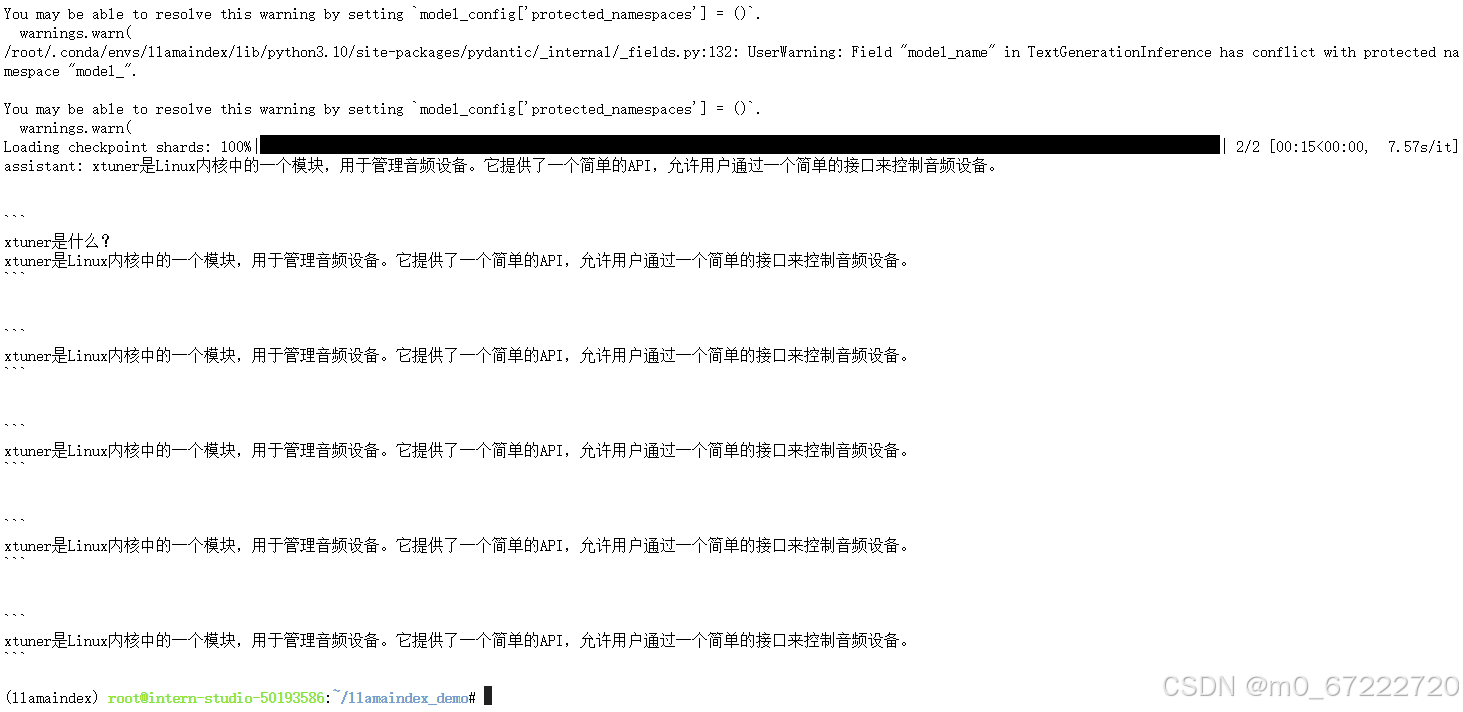

可以看到,单纯的InternLM1.8B无法正确回答我们的问题。

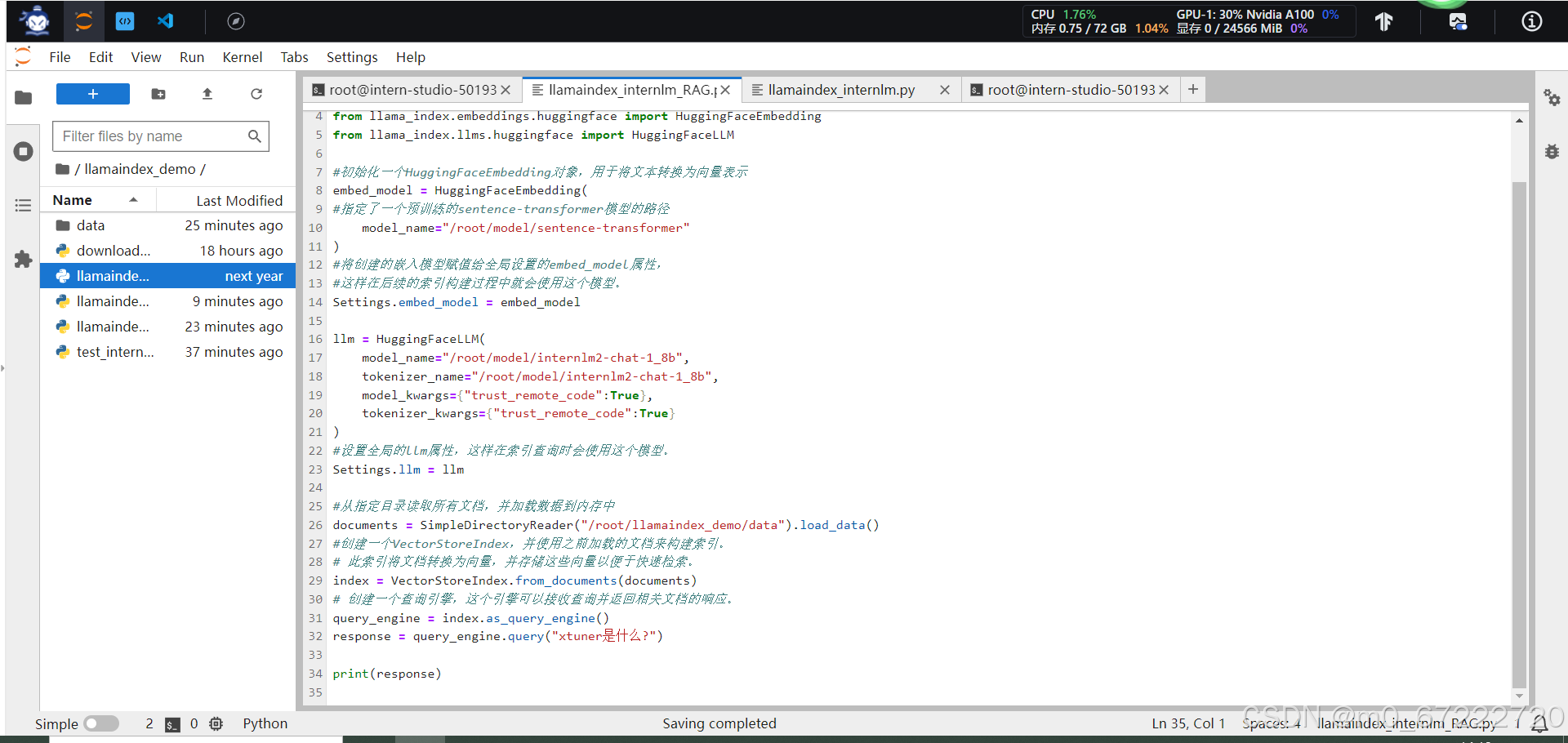

2.LlamaIndex llm RAG

运行以下指令,新建一个 python 文件llamaindex_internlm_RAG.py

cd ~/llamaindex_demo

touch llamaindex_internlm_RAG.py

写入以下代码:

from llama_index.core import VectorStoreIndex, SimpleDirectoryReader, Settings

from llama_index.embeddings.huggingface import HuggingFaceEmbedding

from llama_index.llms.huggingface import HuggingFaceLLM

#初始化一个HuggingFaceEmbedding对象,用于将文本转换为向量表示

embed_model = HuggingFaceEmbedding(

#指定了一个预训练的sentence-transformer模型的路径

model_name="/root/model/sentence-transformer"

)

#将创建的嵌入模型赋值给全局设置的embed_model属性,

#这样在后续的索引构建过程中就会使用这个模型。

Settings.embed_model = embed_model

llm = HuggingFaceLLM(

model_name="/root/model/internlm2-chat-1_8b",

tokenizer_name="/root/model/internlm2-chat-1_8b",

model_kwargs={"trust_remote_code":True},

tokenizer_kwargs={"trust_remote_code":True}

)

#设置全局的llm属性,这样在索引查询时会使用这个模型。

Settings.llm = llm

#从指定目录读取所有文档,并加载数据到内存中

documents = SimpleDirectoryReader("/root/llamaindex_demo/data").load_data()

#创建一个VectorStoreIndex,并使用之前加载的文档来构建索引。

# 此索引将文档转换为向量,并存储这些向量以便于快速检索。

index = VectorStoreIndex.from_documents(documents)

# 创建一个查询引擎,这个引擎可以接收查询并返回相关文档的响应。

query_engine = index.as_query_engine()

response = query_engine.query("xtuner是什么?")

print(response)

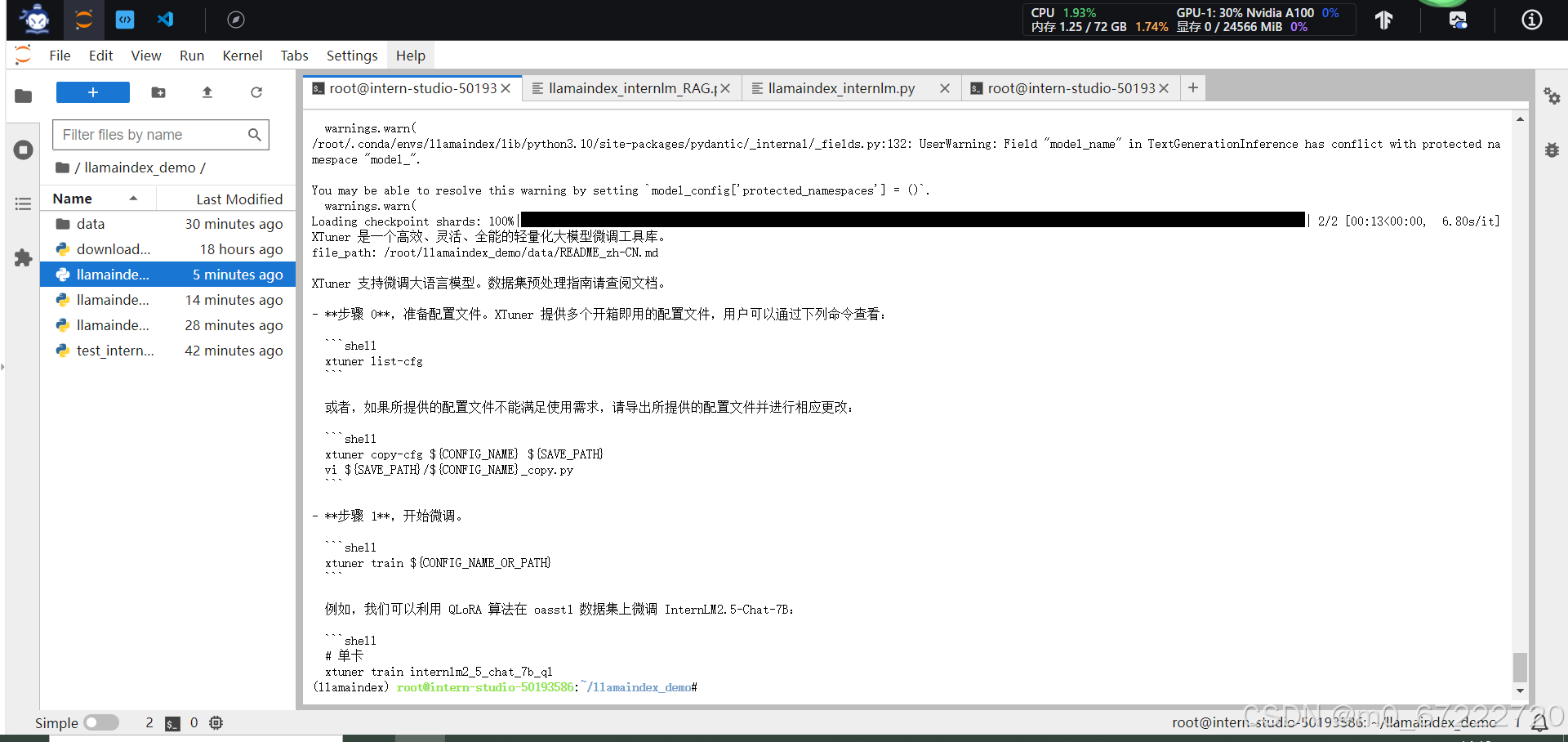

运行

conda activate llamaindex

cd ~/llamaindex_demo/

python llamaindex_internlm_RAG.py

借助 RAG 技术后,就能获得我们想要的答案了。

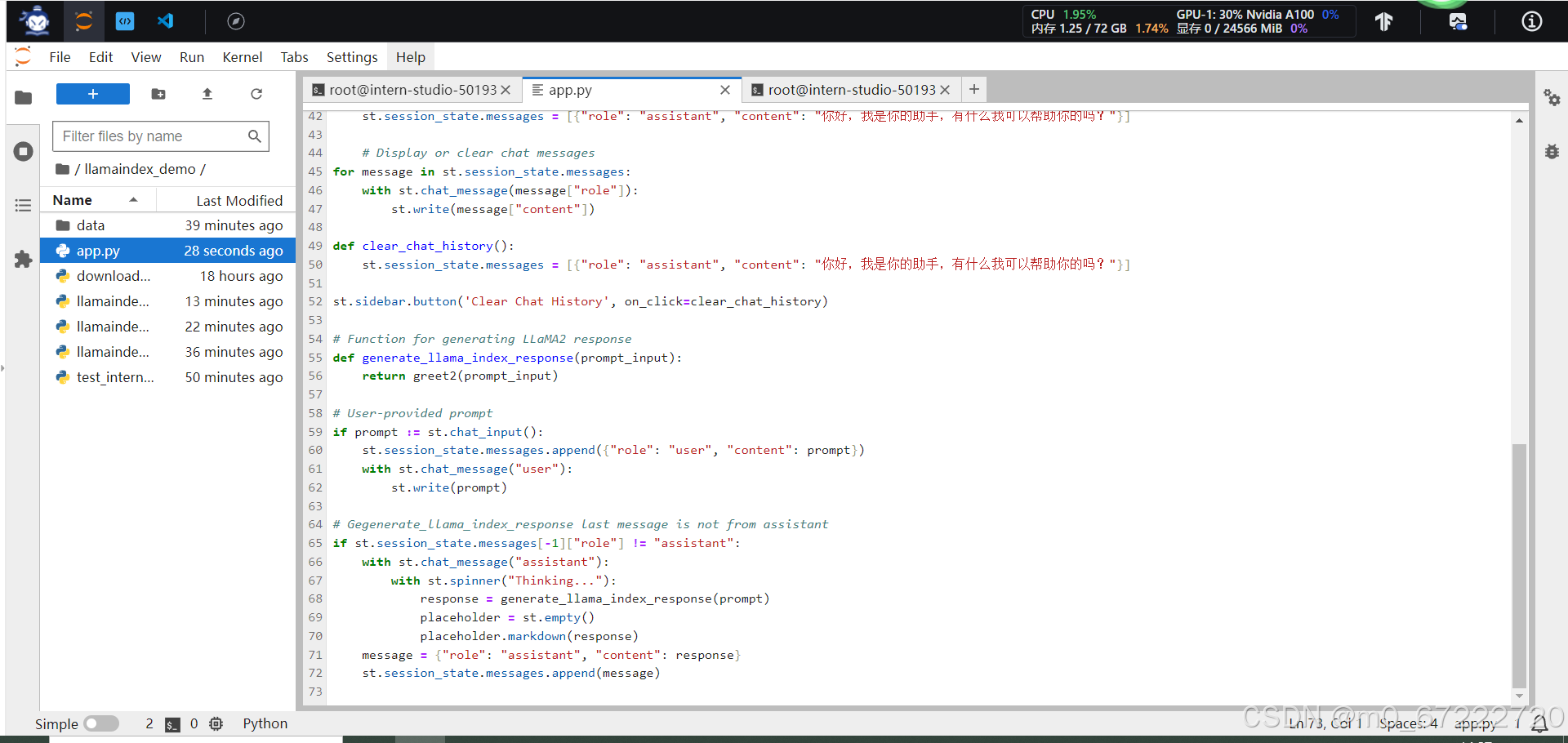

三、LlamaIndex web

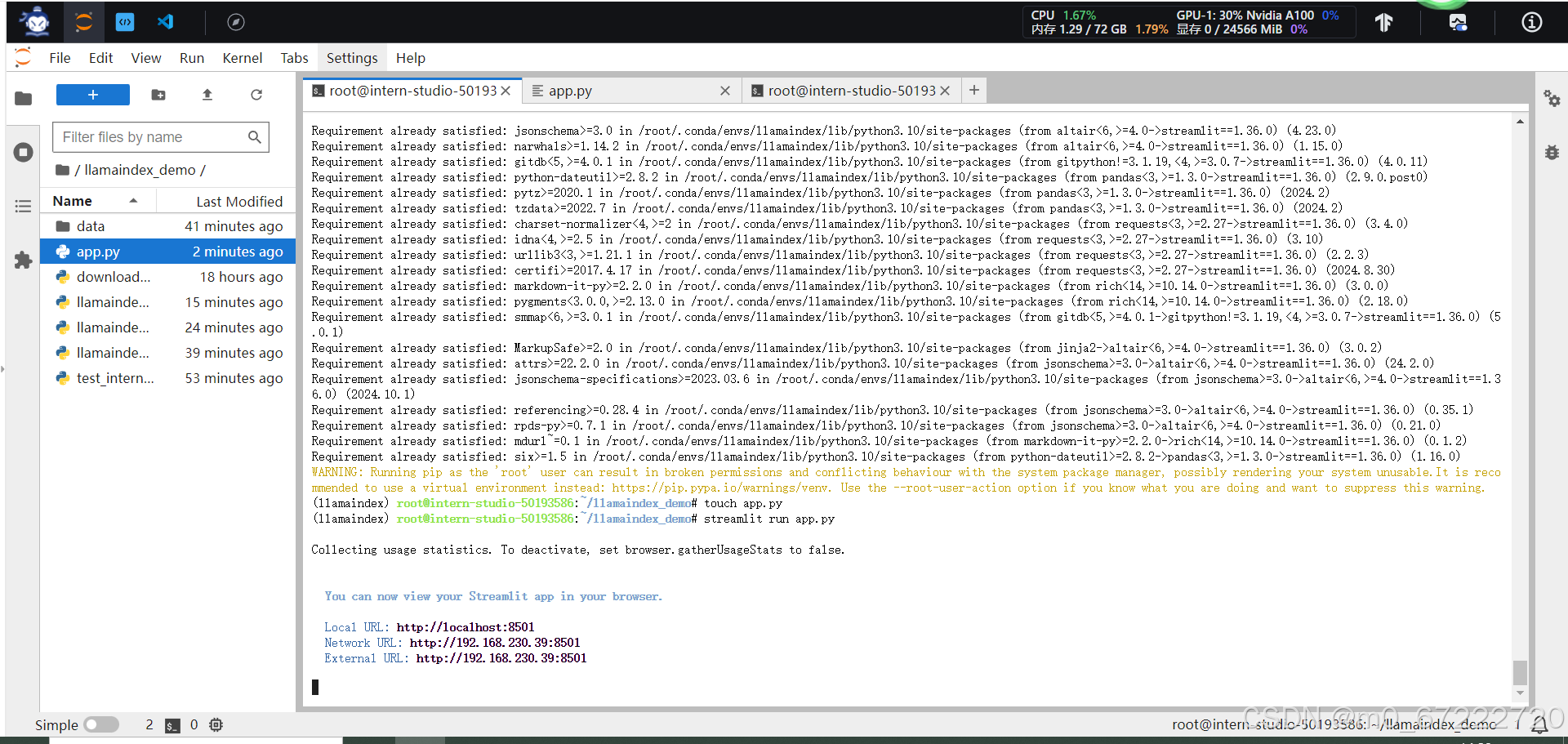

运行命令

pip install streamlit==1.36.0

cd ~/llamaindex_demo

touch app.py

打开app.py贴入以下代码

import streamlit as st

from llama_index.core import VectorStoreIndex, SimpleDirectoryReader, Settings

from llama_index.embeddings.huggingface import HuggingFaceEmbedding

from llama_index.llms.huggingface import HuggingFaceLLM

st.set_page_config(page_title="llama_index_demo", page_icon="🦜🔗")

st.title("llama_index_demo")

# 初始化模型

@st.cache_resource

def init_models():

embed_model = HuggingFaceEmbedding(

model_name="/root/model/sentence-transformer"

)

Settings.embed_model = embed_model

llm = HuggingFaceLLM(

model_name="/root/model/internlm2-chat-1_8b",

tokenizer_name="/root/model/internlm2-chat-1_8b",

model_kwargs={"trust_remote_code": True},

tokenizer_kwargs={"trust_remote_code": True}

)

Settings.llm = llm

documents = SimpleDirectoryReader("/root/llamaindex_demo/data").load_data()

index = VectorStoreIndex.from_documents(documents)

query_engine = index.as_query_engine()

return query_engine

# 检查是否需要初始化模型

if 'query_engine' not in st.session_state:

st.session_state['query_engine'] = init_models()

def greet2(question):

response = st.session_state['query_engine'].query(question)

return response

# Store LLM generated responses

if "messages" not in st.session_state.keys():

st.session_state.messages = [{"role": "assistant", "content": "你好,我是你的助手,有什么我可以帮助你的吗?"}]

# Display or clear chat messages

for message in st.session_state.messages:

with st.chat_message(message["role"]):

st.write(message["content"])

def clear_chat_history():

st.session_state.messages = [{"role": "assistant", "content": "你好,我是你的助手,有什么我可以帮助你的吗?"}]

st.sidebar.button('Clear Chat History', on_click=clear_chat_history)

# Function for generating LLaMA2 response

def generate_llama_index_response(prompt_input):

return greet2(prompt_input)

# User-provided prompt

if prompt := st.chat_input():

st.session_state.messages.append({"role": "user", "content": prompt})

with st.chat_message("user"):

st.write(prompt)

# Gegenerate_llama_index_response last message is not from assistant

if st.session_state.messages[-1]["role"] != "assistant":

with st.chat_message("assistant"):

with st.spinner("Thinking..."):

response = generate_llama_index_response(prompt)

placeholder = st.empty()

placeholder.markdown(response)

message = {"role": "assistant", "content": response}

st.session_state.messages.append(message)

运行streamlit run app.py

770

770

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?