在深度学习中,Softmax函数是一种激活函数,用于多分类问题。它能够将任意实数的向量转换成一个概率分布,即向量中的每个元素都会被映射到0和1之间,并且所有元素的和为1。通过与交叉熵损失函数结合使用,可以训练出在多分类任务中表现良好的模型。

在实际应用中,为了计算上的方便和数值稳定性,有时会使用Log-Softmax函数。Log-Softmax函数是Softmax函数的对数版本,它首先对向量的每个元素应用Softmax函数,然后对结果取对数。

一、Softmax函数

1、Softmax函数是什么?

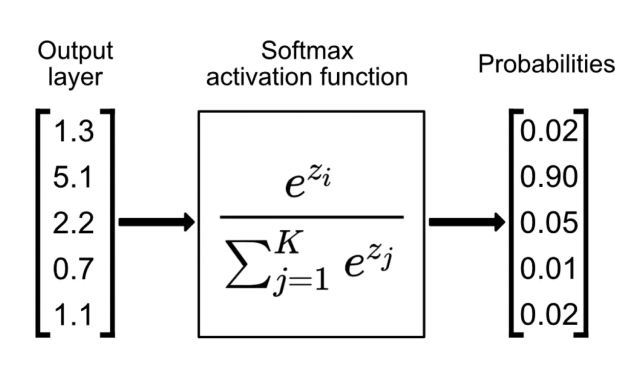

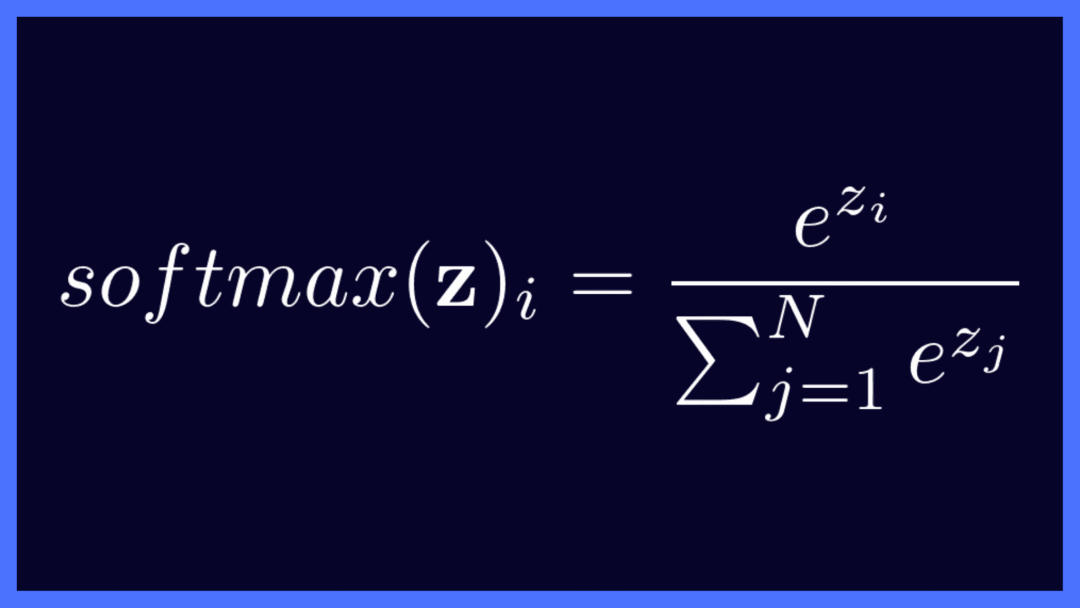

Softmax函数是一种数学函数,通常用于将一组任意实数转换为表示概率分布的实数,是深度学习中一种常用的激活函数。

Softmax函数的作用是什么?

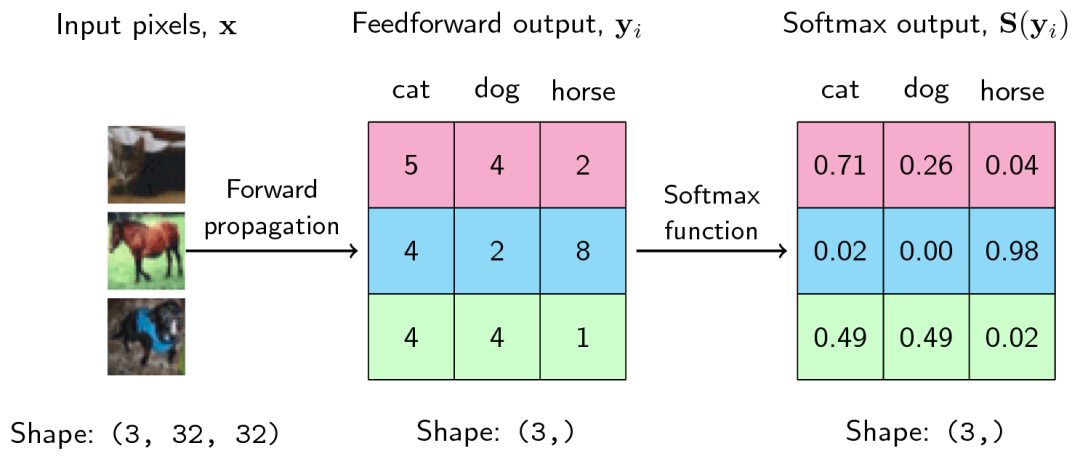

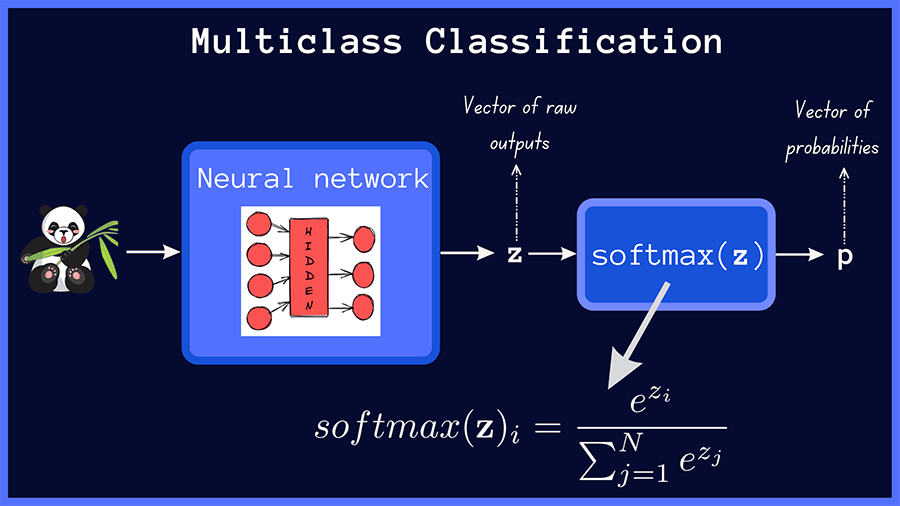

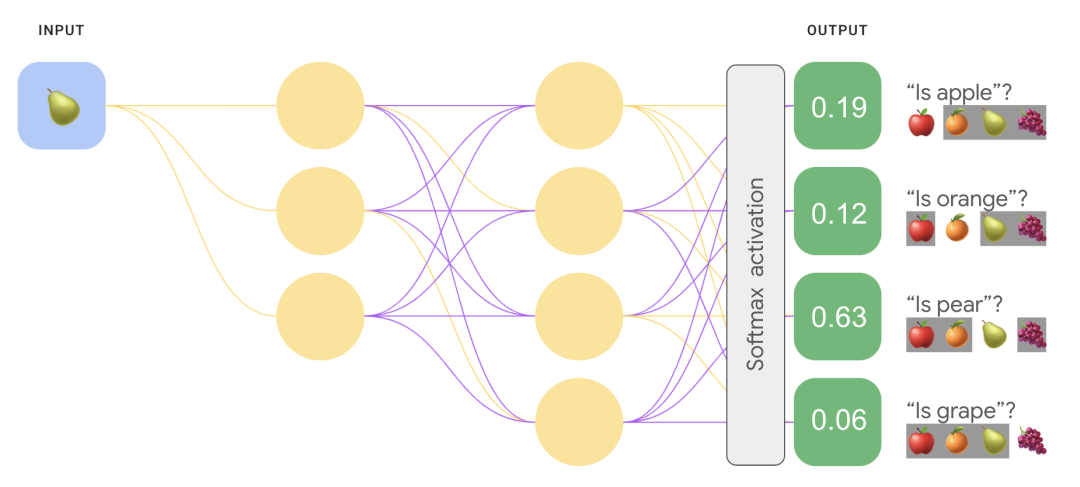

Softmax函数主要用于多分类问题的输出层。在多分类问题中,我们希望模型能够输出一个概率分布,表示每个类别的概率。

例如,在图像分类任务中,如果模型需要识别10个不同的类别,那么模型的输出层应该有10个神经元,每个神经元对应一个类别的分数。Softmax函数将这些分数转换成概率,使得每个类别的概率和为1。

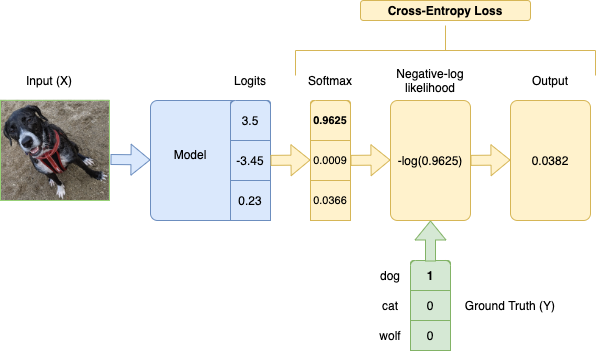

Softmax + Cross-Entropy Loss如何配合?

在多分类问题中,交叉熵损失函数(Cross-Entropy Loss)通常与Softmax函数一起使用。交叉熵损失函数衡量的是模型预测的概率分布和真实标签的概率分布之间的差异。

二、Log-Softmax函数

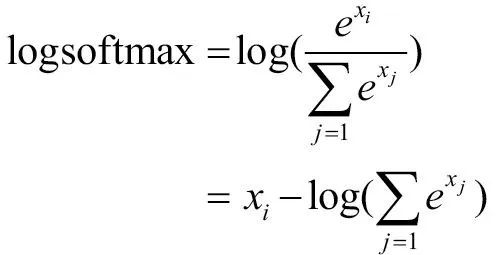

Log-Softmax函数是什么?

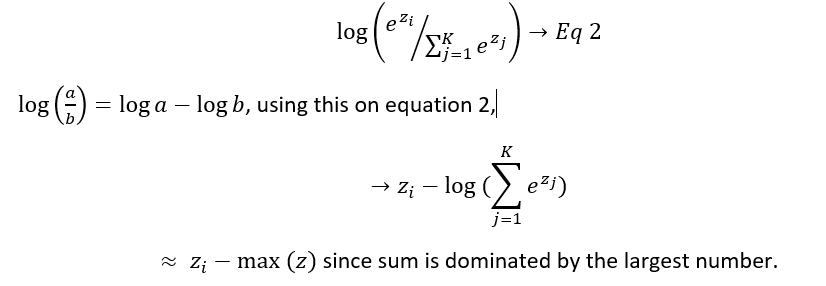

Log-Softmax函数是深度学习中处理多分类问题时一个非常有用的工具。它通过将Softmax函数的输出值转换为对数形式,提高了数值稳定性、简化了损失函数的计算过程,并简化了梯度的计算。

Log-Softmax函数改进了哪些?

Log-Softmax函数通过取对数的方式提高了数值稳定性,简化了损失函数的计算过程,并在反向传播中简化了梯度的计算,从而提升了深度学习模型在多分类问题中的训练效率和稳定性。

-

提高数值稳定性:Log-Softmax函数通过避免直接计算Softmax函数中的指数和的方式,提高了数值稳定性。在深度学习中,指数运算可能导致数值溢出或下溢,而Log-Softmax函数通过取对数的方式减小了这种风险。

-

简化损失函数计算:当使用交叉熵损失函数时,Log-Softmax函数可以直接与损失函数结合使用,无需先计算Softmax函数的输出值再取对数。这简化了损失函数的计算过程,提高了计算效率。

-

简化梯度计算:Log-Softmax函数在反向传播过程中可以简化梯度的计算。由于它避免了直接计算Softmax函数的导数,因此减少了计算复杂度。

三、最后分享

AI大模型作为人工智能领域的重要技术突破,正成为推动各行各业创新和转型的关键力量。抓住AI大模型的风口,掌握AI大模型的知识和技能将变得越来越重要。

学习AI大模型是一个系统的过程,需要从基础开始,逐步深入到更高级的技术。

这里给大家精心整理了一份

全面的AI大模型学习资源,包括:AI大模型全套学习路线图(从入门到实战)、精品AI大模型学习书籍手册、视频教程、实战学习、面试题等,资料免费分享!

1. 成长路线图&学习规划

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

这里,我们为新手和想要进一步提升的专业人士准备了一份详细的学习成长路线图和规划。可以说是最科学最系统的学习成长路线。

2. 大模型经典PDF书籍

书籍和学习文档资料是学习大模型过程中必不可少的,我们精选了一系列深入探讨大模型技术的书籍和学习文档,它们由领域内的顶尖专家撰写,内容全面、深入、详尽,为你学习大模型提供坚实的理论基础。(书籍含电子版PDF)

3. 大模型视频教程

对于很多自学或者没有基础的同学来说,书籍这些纯文字类的学习教材会觉得比较晦涩难以理解,因此,我们提供了丰富的大模型视频教程,以动态、形象的方式展示技术概念,帮助你更快、更轻松地掌握核心知识。

4. 2024行业报告

行业分析主要包括对不同行业的现状、趋势、问题、机会等进行系统地调研和评估,以了解哪些行业更适合引入大模型的技术和应用,以及在哪些方面可以发挥大模型的优势。

5. 大模型项目实战

学以致用 ,当你的理论知识积累到一定程度,就需要通过项目实战,在实际操作中检验和巩固你所学到的知识,同时为你找工作和职业发展打下坚实的基础。

6. 大模型面试题

面试不仅是技术的较量,更需要充分的准备。

在你已经掌握了大模型技术之后,就需要开始准备面试,我们将提供精心整理的大模型面试题库,涵盖当前面试中可能遇到的各种技术问题,让你在面试中游刃有余。

全套的AI大模型学习资源已经整理打包,有需要的小伙伴可以

微信扫描下方优快云官方认证二维码,免费领取【保证100%免费】

7121

7121

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?