提示:文章写完后,目录可以自动生成,如何生成可参考右边的帮助文档

摘要

本周主要对正则化解决拟合问题的具体过程和公式推导进行了详细复习,以及重新温习了SNN有关的概念和优势。

一、拟合问题

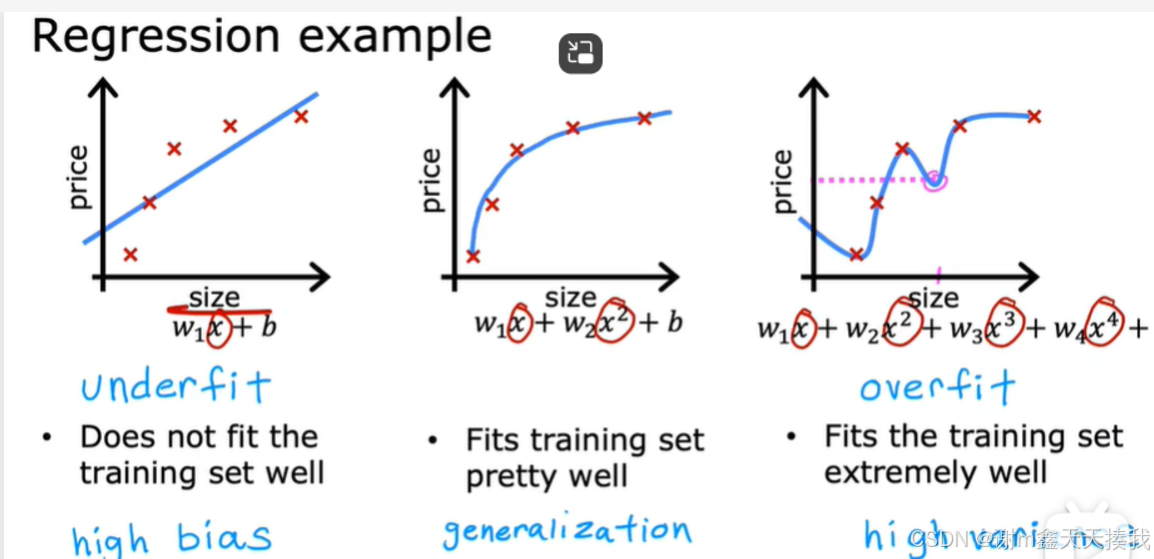

拟合通俗来讲就是我们设置的模型的预测结果与实际结果的合适程度,我们来看之前预测房价的例子:

在第一个模型中该线性模型我们所预测的结果与实际结果的偏差较大,这种现象叫做欠拟合,说明该模型不能很好地适应我们的训练集。第二个模型基本上很好地预测了我们的实际结果,虽然存在一定地偏差,但是该模型已经很好地适应了我们的训练集。第三个模型的实际结果和预测结果完全相同,但这不见得是一件好事,这就是过拟合现象。

过拟合虽然可以让我们的模型很好地去适应我们的训练集,但是"为了拟合而拟合”脱离了我们算法的本质,并且当出现新的结果要预测时该模型的结果会变得很差。

总得来说过拟合有如下几个缺点:

泛化能力差:过度拟合的模型在训练数据上表现良好,但在测试数据或新数据上表现较差,无法有效预测未见数据。

模型复杂性增加:为了达到过度拟合,模型通常会变得非常复杂,导致计算成本和训练时间增加。

不必要的复杂性:过度拟合可能使模型学习到数据中的噪声,而不是潜在的、有用的模式,从而降低模型的实际应用价值。

误导性评估:在训练数据上获得的高准确率可能会误导决策者,使他们相信模型具有良好的性能,而实际情况却并非如此。

维护困难:复杂的模型更难以理解、调试和维护,这可能在后续的模型更新或改进中带来困难。

对新数据的脆弱性:过度拟合的模型对新数据的变化非常敏感,可能导致性能急剧下降。

1.解决过拟合

第一种方法:丢弃一些不能帮助我们正确预测的特征。可以是手工选择保留哪些特征,或者使用一些模型选择的算法来帮忙。但是该方法可能会让我们失去一些真正影响实际结果的特征导致我们预测的结果可能会不准确。

第二种方法:正则化。

2.正则化

● 结构风险最小化 (Cstructural risk minimization, SRM) 是为了防止过拟合而提出来的策略。结构风险最小化等价于正则化 (regularization) 。结构风险是在经验风险上加上表示模型复杂度的正则化项(regularizer )或罚项 (Cpenalty term) 。

● 正则化是结构风险最小化策略的实现。正则化项一般是模型复杂度的单调递增函数,模型越复杂,正则化值就越大。

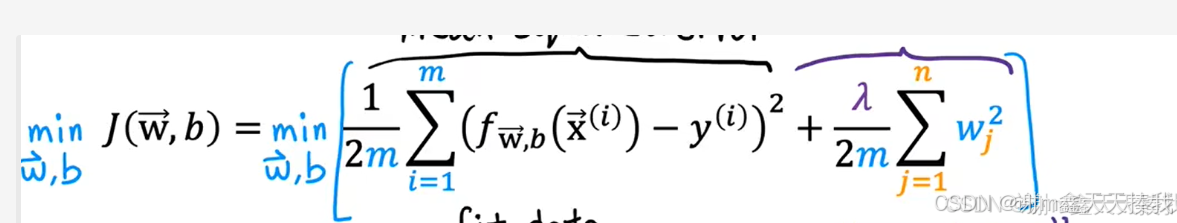

我们知道过拟合是由于有太多的高次项x,虽然这些高次项能够让数据更好地拟合,但是同时也导致了预测新结果的困难。根据上面第三个模型我们可以设置一个非常小的w3和w4让他俩接近0以达到降低过度拟合的效果,可是实际问题中,我们并不知道哪些特征w对模型的影响大哪些对模型预测的结果小,因此在常规的代价函数中我们可以引入一个带参数λ的正则项,λ称为正则化参数。

正则化一般具有如下形式:

引入该正则项以后,我们不需要去特定的缩小某个特征,而是雨露均沾地把所有特征w给减小,这样就很好地保证了我们的模型不会出现过度拟合化。但是此时要面对一个新问题,就是对正则化参数λ的选择。

正则化参数λ的作用就是负责调节我们的特征项w的大小。假设λ=0,我们的模型可能就会出现过度拟合的现象因为此时我们没有正则项。若λ特别特别大,就会导致正则项的权重过高,根据梯度下降公式会让我们的特征w减小为0,此时我们的代价函数就是直线会出现欠拟合的现象。所以对于正则化,我们要取一个合理的

λ

λ 的值,这样才能更好的应用正则化。

3.用于线性回归的正则化

线性回归正则化就是在原来将梯度下降法用于线性回归模型时,将以前的线性回归模型加了一个正则项:在这里插入图片描述

可以看出,正则化线性回归的梯度下降算法的变化在于,每次都在原有算法更新规则的基础上令w值减少了一个额外的值。

4.用于逻辑回归的正则化

在这里插入图片描述

二、SNN

一.什么是SNN?

脉冲神经网络(Spiking Neural Networks,简称SNNs)是一种模拟生物大脑神经元行为的计算模型,它通过模拟神经元发放脉冲(或称为尖峰)的方式来传递信息。与传统的人工神经网络不同,SNNs在信息处理上更加接近生物神经系统的工作方式。

1.SNN的优势

生物可塑性:SNNs能够模拟生物大脑的可塑性,即通过学习改变神经元间连接的强度。

事件驱动:SNNs仅在输入发生变化时才发放脉冲,这种事件驱动的特性使得它们在处理动态视觉和听觉信息时非常高效。

高能效:SNNs在理论上能够实现更高的能效,因为它们只在必要时发放脉冲,而不是持续地处理信息。

时间编码:SNNs能够利用脉冲的精确时间信息,这为处理时间序列数据提供了一种强大的工具。

2.SNN的局限

训练难度:SNNs的训练算法相比传统神经网络更为复杂,需要特定的学习规则(如STDP)。

计算资源:虽然理论上SNNs具有高能效,但目前的硬件平台尚未能完全发挥其潜力。

理论发展:SNNs的理论基础尚在发展中,对于如何最有效地设计和训练SNNs仍有许多未知。

SNN的结构和工作原理

SNN的基本单元是脉冲神经元,它们通过发放脉冲(或称为尖峰)来传递信息。每个神经元的输出不是连续的信号,而是一个离散的脉冲序列。这些脉冲的发放时间和频率携带了编码的信息。

SNN中的神经元通常通过突触连接,突触的权重决定了神经元间信息传递的强度和效率。

3.ANN神经元概要

•计算方法:ANN中的神经元通过非线性激活函数处理输入和权重的乘积累加

•通信方式:ANN神经元使用高精度和连续值编码的激活值进行相互通信。

•信息传播:ANN仅在空间域(layer by layer)传播信息。

SNN神经元概要

•结构与行为:SNN神经元在结构上与ANN神经元相似,但通过脉冲(Spike)而非连续激活值进行交流。

•通信方式:SNN神经元之间的交流通过二进制事件(脉冲)进行。

•膜电位更新:SNN神经元的膜电位更新遵循微分方程,涉及时间步长、常数、膜电位、输出峰值、静息电位、重置电位和输入突触的权重。

•脉冲发放条件:

a.当膜电位超过阈值时,神经元发放脉冲,输出电位置为1,膜电位回归到重置电位。

b.当膜电位低于阈值时,神经元不发放脉冲,输出电位保持为0。

•信息传播:SNN不仅在空间域中传播信息,时间域中的历史也对当前状态产生影响。

•信号稀疏性:由于只有膜电位超过阈值时才激发尖峰信号,SNN的信号通常是稀疏的。

总结

。本周对之前学习的拟合问题和SNN进行了复习,计划在下周对GAN进行相应的学习。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?