目录

🎬 攻城狮7号:个人主页

🔥 个人专栏:《AI前沿技术要闻》

⛺️ 君子慎独!

🌈 大家好,欢迎来访我的博客!

⛳️ 此篇文章主要介绍 人工智能未来关键技术的十个问题

📚 本期文章收录在《AI前沿技术要闻》,大家有兴趣可以自行查看!

⛺️ 欢迎各位 ✔️ 点赞 👍 收藏 ⭐留言 📝!

引言

2025年,人工智能的浪潮以前所未有的势头席卷全球。从能够进行深度推理的o1模型,到渗透进我们工作流的各类AI智能体,我们似乎每天都在见证新的奇迹。然而,当最初的兴奋与惊叹逐渐沉淀,一个更深层次的共识正在浮现:仅仅追求更大规模的模型、更高的跑分,或许正在让我们偏离航向。

我们正站在一个关键的十字路口。前方的道路不再是一片坦途,而是充满了需要审慎抉择的岔路口和亟待解答的根本性难题。正如上海人工智能实验室在其"明珠湖会议"上所探讨的,决定AI下一阶段发展的,可能不再是单纯的技术迭代,而是我们提出问题、定义问题,并为之构建创新协作生态的能力。

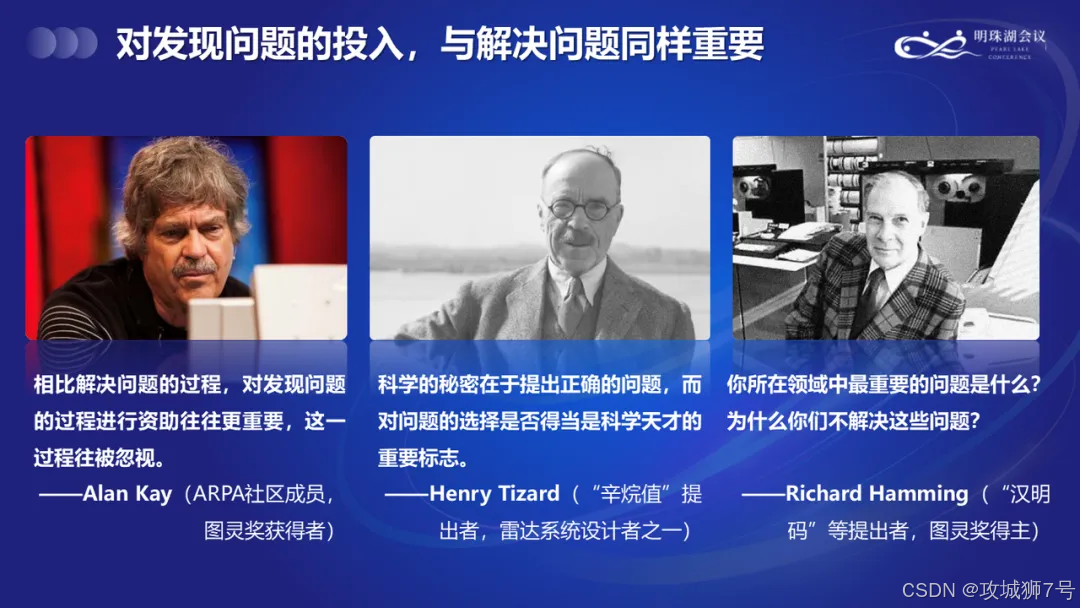

一、为何"科学社区"与"好问题"至关重要?

在深入探讨具体的技术难题之前,我们必须先理解创新的源头活水来自哪里。历史反复证明,伟大的科学突破往往不是孤胆英雄的灵光一现,而是思想碰撞的必然结果。

从1660年成立至今、从未中断的英国皇家学会,到工业革命时期瓦特等人组成的"月光社",再到催生了个人电脑和互联网雏形的"阿帕社区",这些跨越时空的"科学社区"都揭示了同一个秘密:真正的创新源于开放、持续、高强度的交流。 当最聪明的大脑聚集在一起,自由地辩论、分享甚至争吵,思想的火花才能被点燃,进而形成燎原之势。

而一个高质量科学社区的核心,在于其成员敢于并善于提出"好问题"。图灵奖得主艾伦·凯曾一针见血地指出,相比解决问题,为"发现问题"的过程提供支持往往更重要,却也最容易被忽视。这正是"汉明问题"的精髓所在——"你所在领域最重要的问题是什么?你为什么不研究它们?"这两个看似简单的问题,却能有效地将人们的精力从日常的修补工作中,引导向真正具有颠覆性潜力的方向。

因此,在我们一头扎进AI的技术细节之前,建立这样的认知至关重要:未来AI的突破,不仅需要算法和算力,更需要一个能让顶尖人才激荡思想的开放社区,以及一种敢于挑战根本、直面未知的好奇心。这十大前沿问题,正是这种求索精神的集中体现。

二、AI的十大前沿拷问

这十个问题,涵盖了从AI的效率本质、能力边界,到其物理基础、安全伦理的方方面面,共同构成了我们理解和塑造AI未来的核心框架。

2.1 我们追求的是"庞大"的AI,还是"聪明"的AI?

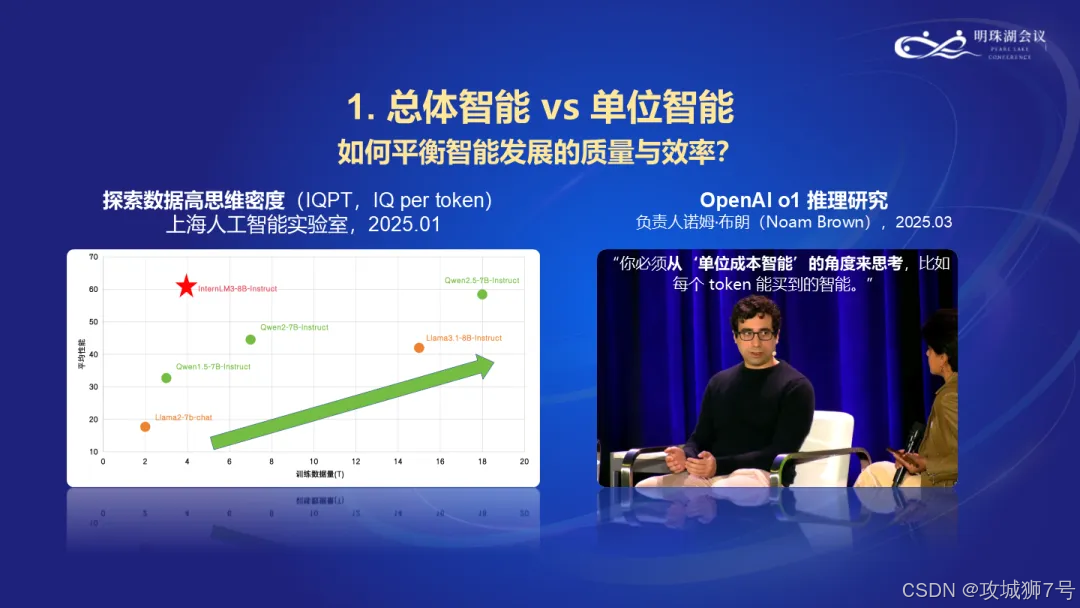

当前,评价一个模型似乎陷入了一种"唯体量论"——参数规模越大、训练数据越多、排行榜排名越高,模型就越好。但这带来了一个问题:我们可能在用巨大的能耗和成本,堆砌出一个"虚胖"的智能。

因此,"单位智能(IQ per token)"的概念被提上议程。它类似于经济学中的"人均GDP",关注的是在消耗每一个单位的计算、数据或存储资源后,能产出多少有效的智能。DeepSeek等模型的工程创新已经证明,更简洁、高效的模型本身就是一种更高级的智能。这个问题迫使我们反思:在算力有限的未来,是继续追求"总体智能"的野蛮生长,还是转向最大化"单位智能"的精耕细作?这决定了AI发展的成本效益和可持续性。

2.2 AI能否实现低成本的"自我训练"?

深度强化学习(Deep RL)被寄予厚望,因为它不仅仅是一种学习算法,更是一台高效的"高价值数据生成器"。在与环境的交互中,AI可以创造出大量人类难以标注的复杂推理数据,这些数据反过来又能极大地提升模型的能力。

这就带来了一个诱人的前景——"效率飞轮"。理论上,当AI通过强化学习生成高质量数据所节省的训练成本,能够抵消其自身运行消耗的算力时,一个临界点就将到来。届时,AI或许能以极低的边际成本实现"自我进化"。然而,这背后隐藏着一个资源悖论:我们应该如何分配宝贵的算力,来平衡"合成新数据"和"训练旧模型"这两大任务?找到这个黄金分割点,是实现AI自主进化的关键。

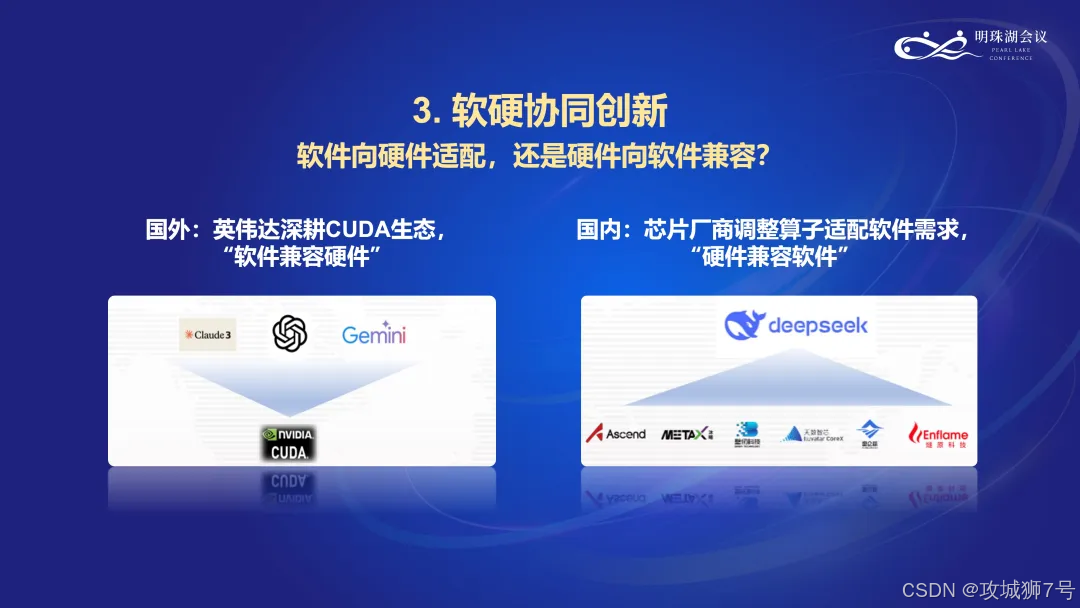

2.3 软件适配硬件,还是硬件兼容软件?

软硬件协同的路径,目前国内外存在显著差异。以英伟达为首的国际厂商,通过构建强大的CUDA生态,实现了"软件高度适配自家硬件"的模式,护城河极深。而国内的现状,则更多是芯片厂商努力去"兼容主流软件生态"(如PyTorch、TensorFlow)。

然而,硬件的研发周期远长于软件。让长周期的硬件去追赶日新月异的软件,在逻辑上充满挑战。未来的出路在哪里?是继续追赶,还是探索一条全新的、更高效的软硬协同创新路径,让软件和硬件能真正"双向奔赴",共同演进?这直接关系到AI产业的底层基础是否牢固。

2.4 有限的算力,应投向何方?

算力的使用,可以被大致分为三类:

(1)应用算力:用于已明确场景的产业落地,将技术转化为生产力。

(2)迭代算力:用于主流模型的持续迭代和优化,沿着现有技术路线(如Scaling Law)前进。

(3)创新算力:用于验证非主流、甚至是天马行空的想法,探索全新的技术路径。

当前,前两者的投入相对充足,而用于探索和颠覆的"创新算力"却严重不足。这可能导致研究走向同质化,大家都在同一个框架内"卷",从而扼杀了颠覆性创新的火种。如何设计机制,为那些看似"不靠谱"的奇思妙想提供算力支持,鼓励差异化探索,是避免整个领域陷入创新停滞的关键。

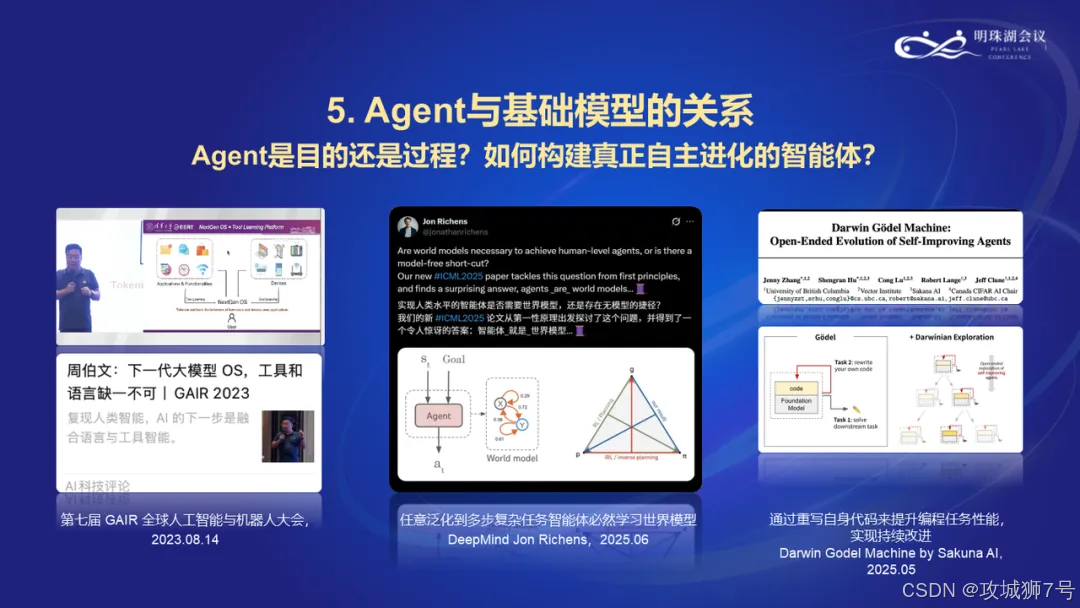

2.5 智能体是终极目标,还是过渡阶段?

AI智能体(Agent)无疑是当下的热点。它被视为大模型走出"聊天框",与数字和物理世界交互的载体。但这引出了一个根本问题:Agent本身是目的,还是一个过程?

目前的Agent在很大程度上仍是基础模型的"提线木偶",其自主学习和进化能力有限。真正的自主智能体,或许需要具备强大的"世界模型"(World Model)——即对环境的运行规律形成内部预测模型。这使得它不仅能执行任务,更能理解环境、预测未来,并在此基础上实现真正意义上的持续学习和"自主进化"。我们今天看到的Agent,究竟是通往通用人工智能(AGI)的康庄大道,还是一个必经的、但终将被超越的过渡形态?

2.6 如何打造"手脑协调"的机器人?

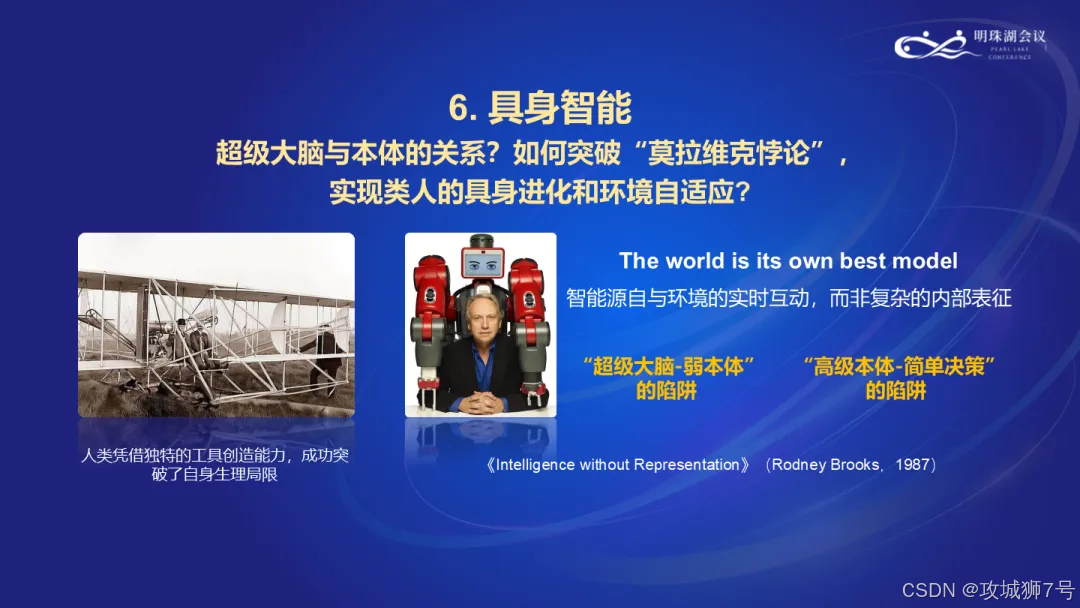

"莫拉维克悖论"困扰了AI领域数十年:对计算机而言,实现成人水平的推理(如下棋)相对容易,但掌握一岁孩童的感知和运动能力(如抓取物体)却异常困难。这在具身智能领域体现得尤为突出。

我们应该如何分配资源来构建机器人的"大脑"与"本体"?是打造一个四肢简单但头脑超凡的"思考者",还是一个本体强大但决策简单的"行动者"?人类的进化史表明,我们并非各项物理指标最强的物种,但我们凭借大脑与身体的精妙协同,以及创造和使用工具的能力,成为了地球的主宰。具身智能研究需要突破"超级大脑+弱鸡本体"或"强大本体+简单决策"的陷阱,找到大脑与本体协同进化的最优路径。

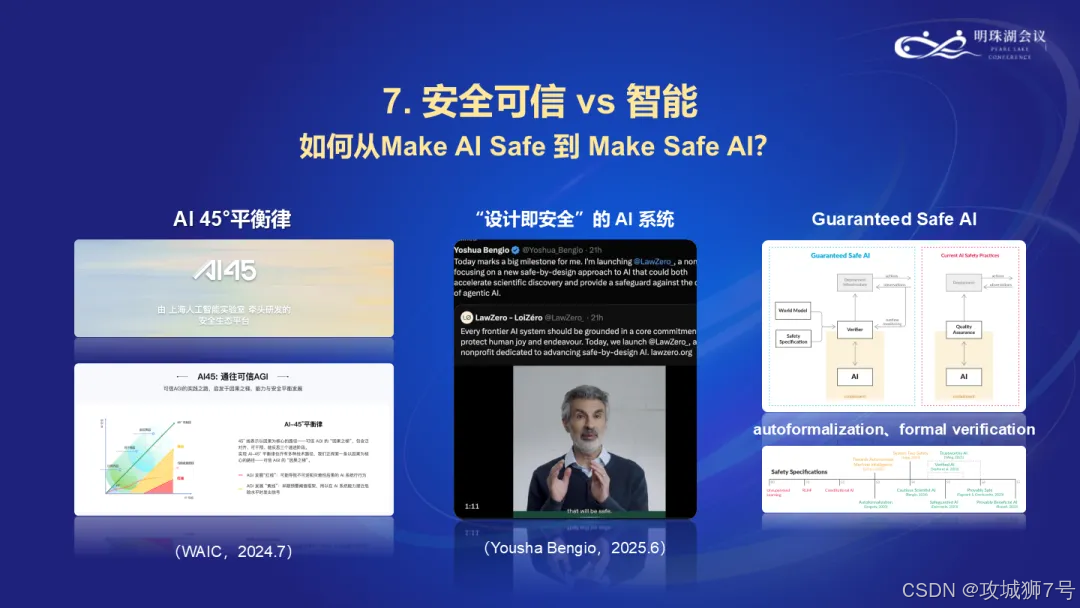

2.7 如何从"亡羊补牢"到"防患未然"?

AI安全正从一个边缘话题,变为所有从业者都无法回避的核心挑战。过去,我们的模式是"Make AI Safe"(让AI变得安全),即在AI系统开发出来后,不断地为其打补丁、修复漏洞。但这是一种被动的、滞后的安全观。

未来的方向,必须是"Make Safe AI"(打造内生安全的AI)。安全不应是后期附加的功能,而必须是贯穿于设计、开发、部署全流程的核心原则。无论是通过数学方法确保系统行为可验证的"形式化AI",还是通过因果推理、可解释性AI来理解其决策过程,我们追求的都不应是一个僵化的、被规则束缚死的"安全AI",而是一个具备动态自我修正能力的、真正可信的AI系统。

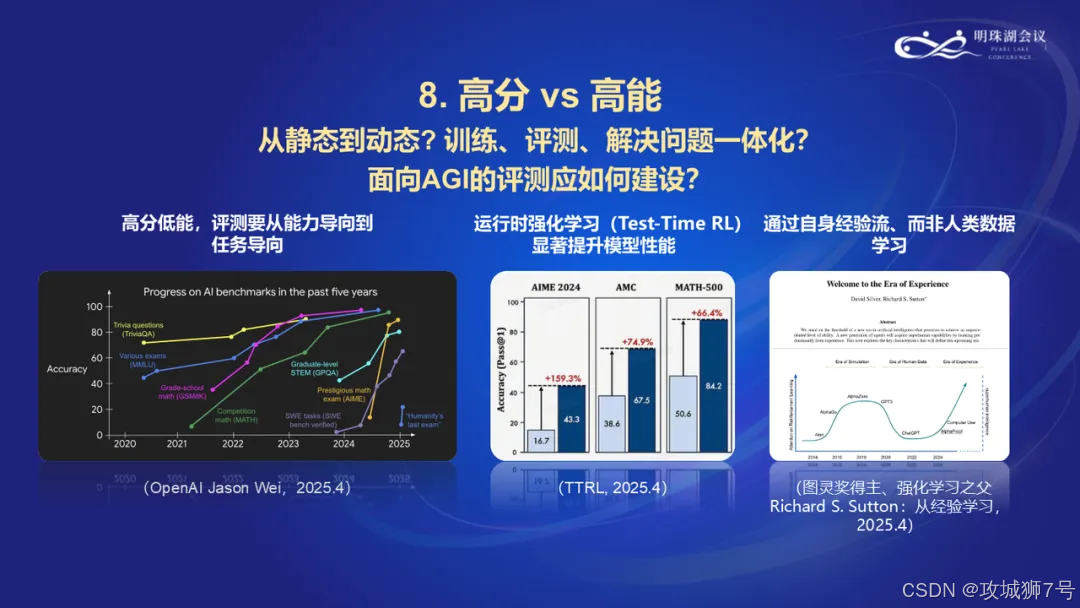

2.8 如何让AI走出"考场",解决真问题?

当前的AI评测体系,正在陷入"高分低能"的困境。模型在各种基准测试(Benchmark)中取得了惊人的分数,但在解决现实世界的复杂、开放性问题时,却常常表现得像一个"书呆子"。

AI的"下半场",必须重构评测体系。我们需要从"能力导向"转向"任务导向",评估AI在真实场景中,独立或辅助人类解决高价值问题的实际效用。未来的评测,甚至可能与训练、解决问题融为一体,AI在"干中学",在"学中干"。Google DeepMind提出的"测试时强化学习"(TTRL)等新框架,正是在探索如何让模型在面对未知任务时,能根据反馈自主调整,朝着正确的方向学习,而不是仅仅背诵"标准答案"。

2.9 AI如何成为科学家的"革命性伙伴"?

AI在科学发现(AI for Science)领域潜力巨大,但目前大多停留在"工具的革命"层面——即加速了科学研究中某个环节的效率,如蛋白质结构预测。但这还不够。

真正的突破,是让AI成为"革命的工具",即能够带来科学研究范式变革的催化剂。这意味着AI需要从一个高效的模拟器或数据分析器,进化为一个能够理解多模态信息(如实验图像、分子模型、数学公式)、提出假说、设计实验,并与科学家进行深度思想碰撞的"科研伙伴"。要实现这一点,当前基于"预测下一个词"的语言模型可能远远不够,我们需要在多模态统一表征和科学推理能力上取得根本性突破。

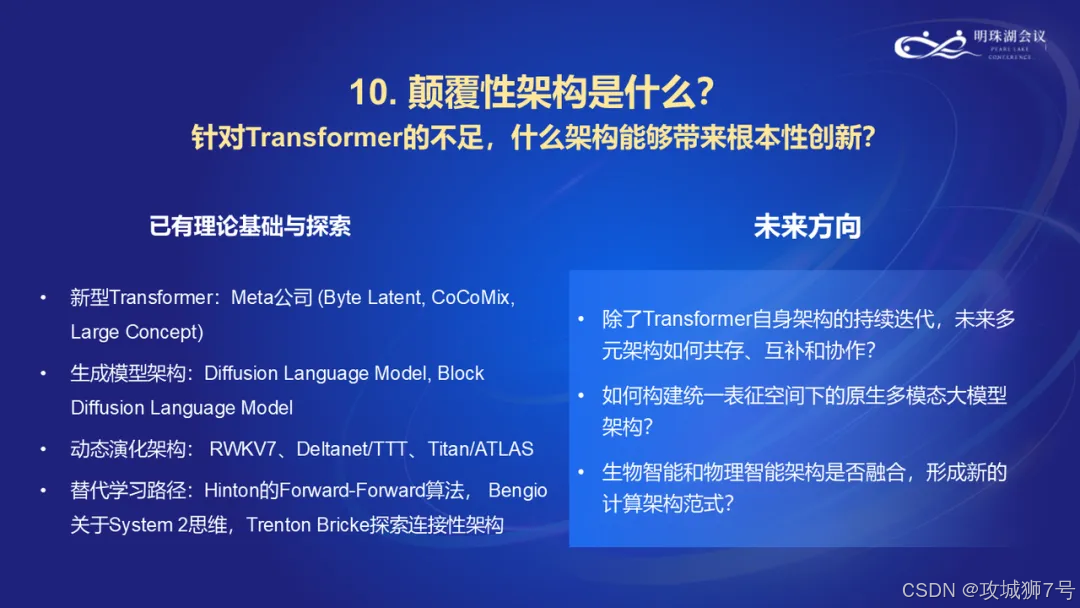

2.10 Transformer之后,谁主沉浮?

自2017年问世以来,Transformer架构统治了AI领域。它是一场伟大的革命,但我们不能躺在功劳簿上。随着任务复杂度的提升,Transformer在计算效率、长上下文理解、复杂推理等方面的内在局限性正日益凸起。

正如爱因斯坦所言,"我们不能用制造问题时的思维方式来解决问题"。突破Transformer的瓶颈,可能需要全新的、颠覆性的架构。无论是受脑科学启发的神经形态计算,还是能够模拟动态系统的状态空间模型,或是其他我们尚未想到的架构,整个领域都迫切需要探索下一代AI的核心引擎。未来,很可能不是单一架构的胜利,而是多元架构共存、互补与协作的新时代。

结论:培育"提出问题的人"

这十大问题,如同一座座等待被征服的山峰,雄伟而艰巨。要回答它们,需要的不仅仅是聪明的算法和庞大的算力。

历史告诉我们,战略性的科技突破,往往伴随着战略科学家的"群体涌现"。无论是20世纪初的匈牙利"黄金一代",还是70年代的PC革命先驱,人才的聚集效应是推动时代变革的核心动力。

因此,解答这十大问题的终极答案,或许在于"人"。我们需要构建一个创新的生态,一个"高强度要素投入+高集中任务攻关+高密度人才历练场"三位一体的培育模式。通过让最有潜力的青年科学家,在直面这些重大挑战的过程中,不断锤炼其前瞻判断力、跨学科理解力和组织领导力,我们才能真正培养出能够引领下一个时代的战略科学家。

最终,AI的未来,将由那些不仅能解决问题,更能定义问题、提出问题,并能团结众人共同求索的人来塑造。

看到这里了还不给博主点一个:

⛳️ 点赞☀️收藏 ⭐️ 关注!

💛 💙 💜 ❤️ 💚💓 💗 💕 💞 💘 💖

再次感谢大家的支持!

你们的点赞就是博主更新最大的动力!

8640

8640

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?