本文章仅自学使用,结合的其他人安装教程总结的!!!!

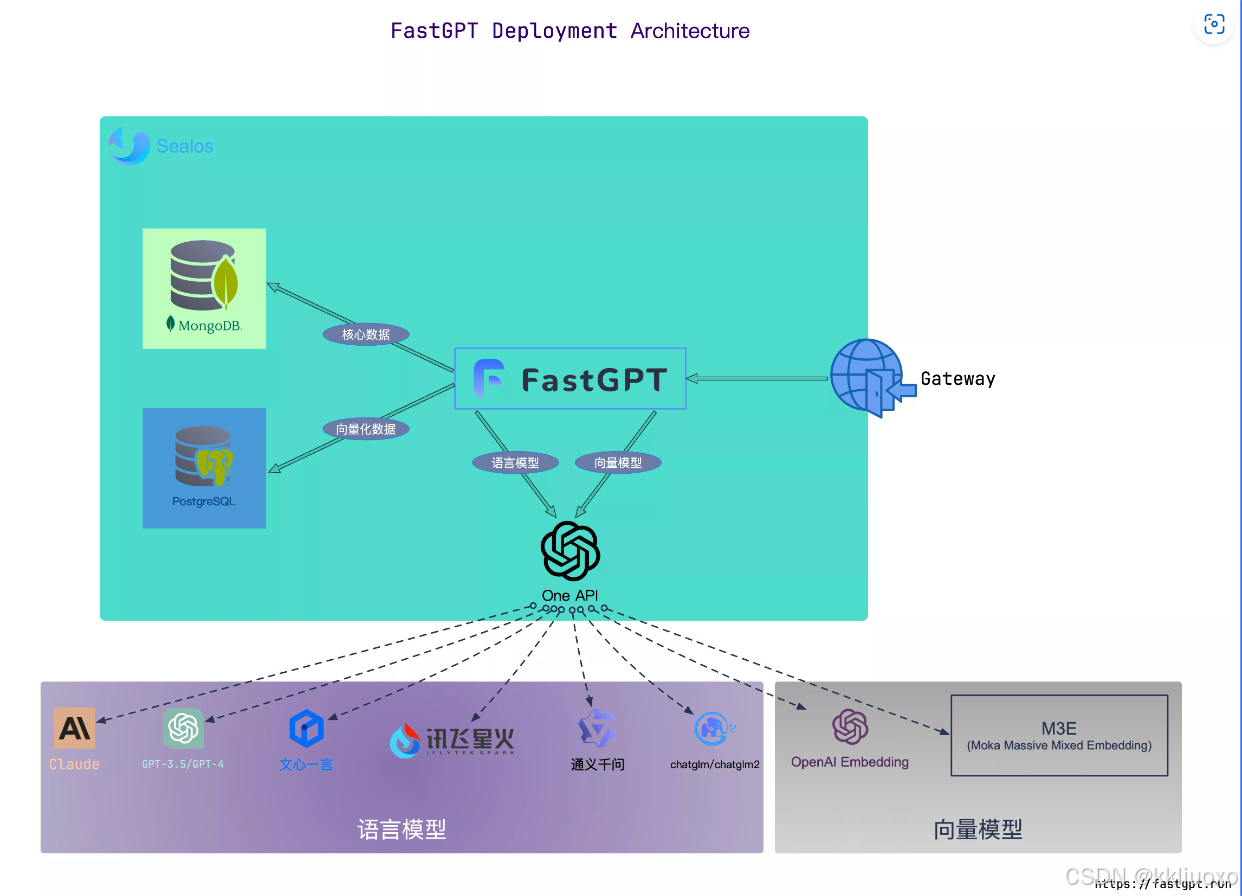

官方教程:Docker Compose 快速部署 | FastGPT

官方教程:Docker Compose 快速部署 | FastGPT

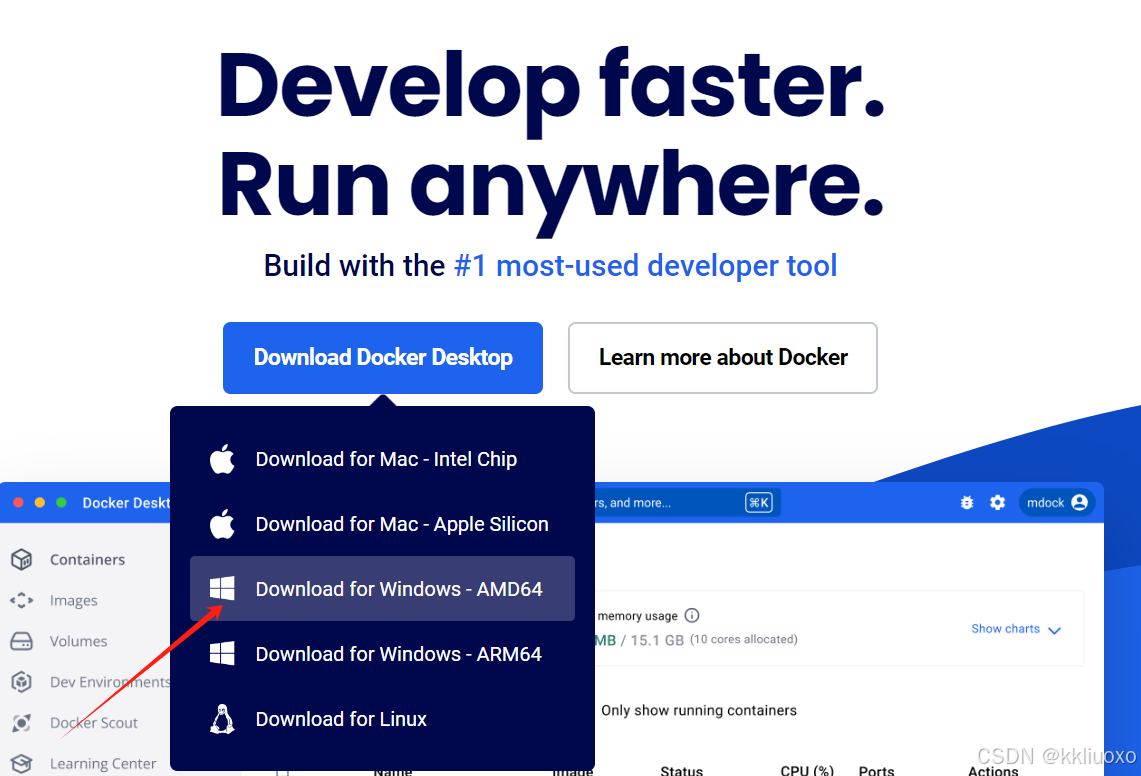

1、下载Docker

官网地址:Docker: Accelerated Container Application Development

我安装的是

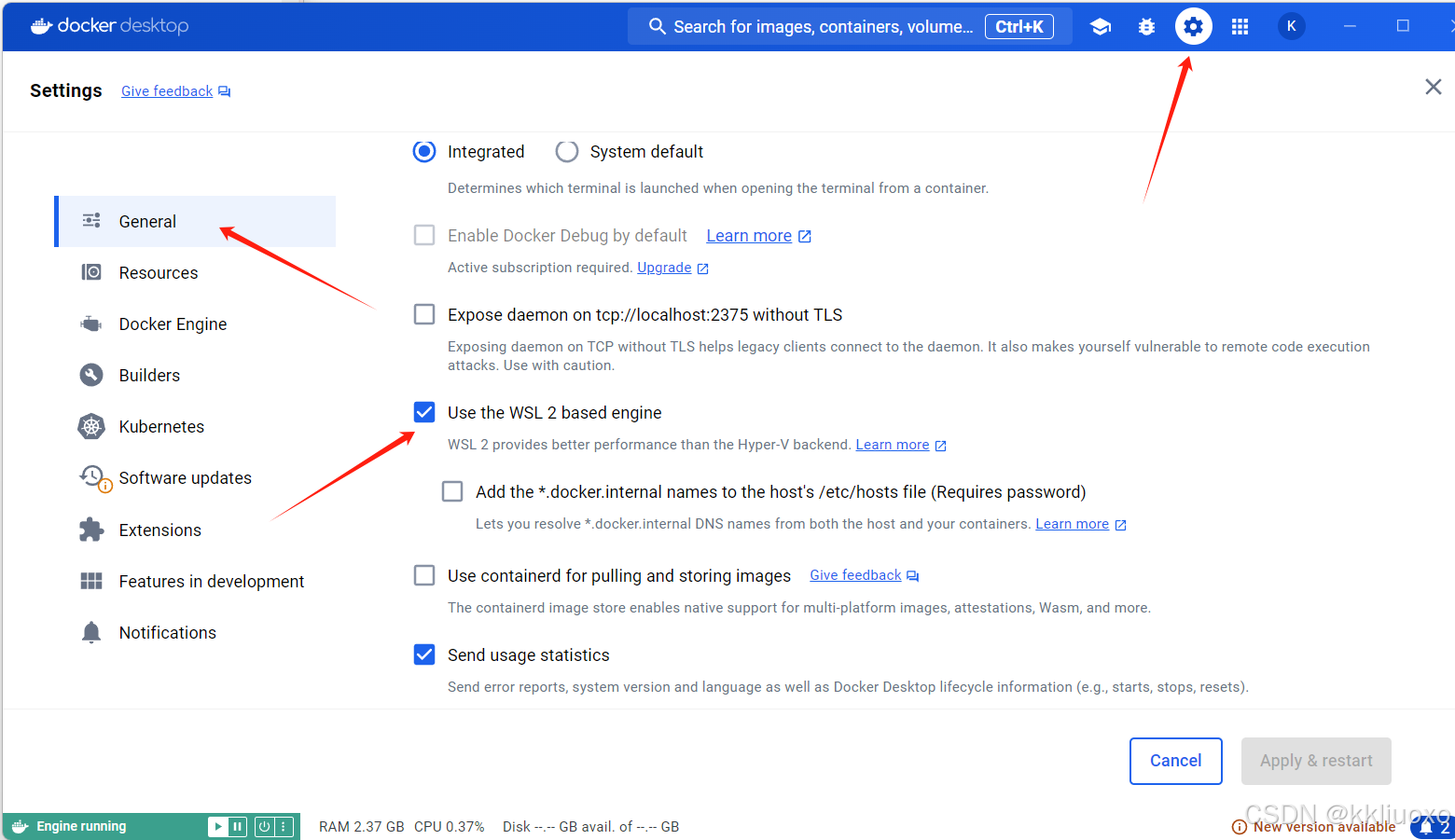

2、打开 Docker Desktop WSL 2

-

按照通常的安装说明安装 Docker Desktop。根据您使用的 Windows 版本,Docker Desktop 可能会提示您在安装过程中打开 WSL 2。阅读屏幕上显示的信息并打开 WSL 2 功能以继续。

-

启动 Docker Desktop

-

导航到 设置。

-

在 General 选项卡中,选择 Use WSL 2 based engine 如果您在支持 WSL 2 的系统上安装了 Docker Desktop,则默认情况下此选项处于打开状态。

选择应用并重新启动。

现在,命令可以使用新的 WSL 2 引擎在 Windows 中使用。

3、开始部署

首先启动Docker

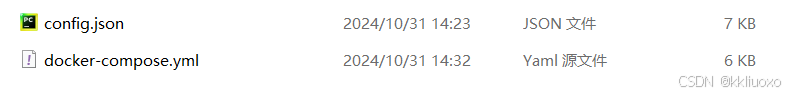

新建一个空的文件夹FastGPT,存放下面两种配置文件

①config.jsonraw.githubusercontent.com/labring/FastGPT/refs/heads/main/projects/app/data/config.json

在上面网址中下载到FastGPT文件夹

// 已使用 json5 进行解析,会自动去掉注释,无需手动去除

{

"feConfigs": {

"lafEnv": "https://laf.dev" // laf环境。 https://laf.run (杭州阿里云) ,或者私有化的laf环境。如果使用 Laf openapi 功能,需要最新版的 laf 。

},

"systemEnv": {

"vectorMaxProcess": 15, // 向量处理线程数量

"qaMaxProcess": 15, // 问答拆分线程数量

"tokenWorkers": 50, // Token 计算线程保持数,会持续占用内存,不能设置太大。

"pgHNSWEfSearch": 100 // 向量搜索参数。越大,搜索越精确,但是速度越慢。设置为100,有99%+精度。

},

"llmModels": [

{

"model": "gpt-4o-mini", // 模型名(对应OneAPI中渠道的模型名)

"name": "gpt-4o-mini", // 模型别名

"avatar": "/imgs/model/openai.svg", // 模型的logo

"maxContext": 125000, // 最大上下文

"maxResponse": 16000, // 最大回复

"quoteMaxToken": 120000, // 最大引用内容

"maxTemperature": 1.2, // 最大温度

"charsPointsPrice": 0, // n积分/1k token(商业版)

"censor": false, // 是否开启敏感校验(商业版)

"vision": true, // 是否支持图片输入

"datasetProcess": true, // 是否设置为文本理解模型(QA),务必保证至少有一个为true,否则知识库会报错

"usedInClassify": true, // 是否用于问题分类(务必保证至少有一个为true)

"usedInExtractFields": true, // 是否用于内容提取(务必保证至少有一个为true)

"usedInToolCall": true, // 是否用于工具调用(务必保证至少有一个为true)

"usedInQueryExtension": true, // 是否用于问题优化(务必保证至少有一个为true)

"toolChoice": true, // 是否支持工具选择(分类,内容提取,工具调用会用到。)

"functionCall": false, // 是否支持函数调用(分类,内容提取,工具调用会用到。会优先使用 toolChoice,如果为false,则使用 functionCall,如果仍为 false,则使用提示词模式)

"customCQPrompt": "", // 自定义文本分类提示词(不支持工具和函数调用的模型

"customExtractPrompt": "", // 自定义内容提取提示词

"defaultSystemChatPrompt": "", // 对话默认携带的系统提示词

"defaultConfig": {}, // 请求API时,挟带一些默认配置(比如 GLM4 的 top_p)

"fieldMap": {} // 字段映射(o1 模型需要把 max_tokens 映射为 max_completion_tokens)

},

{

"model": "gpt-4o",

"name": "gpt-4o",

"avatar": "/imgs/model/openai.svg",

"maxContext": 125000,

"maxResponse": 4000,

"quoteMaxToken": 120000,

"maxTemperature": 1.2,

"charsPointsPrice": 0,

"censor": false,

"vision": true,

"datasetProcess": true,

"usedInClassify": true,

"usedInExtractFields": true,

"usedInToolCall": true,

"usedInQueryExtension": true,

"toolChoice": true,

"functionCall": false,

"customCQPrompt": "",

"customExtractPrompt": "",

"defaultSystemChatPrompt": "",

"defaultConfig": {},

"fieldMap": {}

},

{

"model": "o1-mini",

"name": "o1-mini",

"avatar": "/imgs/model/openai.svg",

"maxContext": 125000,

"maxResponse": 65000,

"quoteMaxToken": 120000,

"maxTemperature": 1.2,

"charsPointsPrice": 0,

"censor": false,

"vision": false,

"datasetProcess": true,

"usedInClassify": true,

"usedInExtractFields": true,

"usedInToolCall": true,

"usedInQueryExtension": true,

"toolChoice": false,

"functionCall": false,

"customCQPrompt": "",

"customExtractPrompt": "",

"defaultSystemChatPrompt": "",

"defaultConfig": {

"temperature": 1,

"stream": false

},

"fieldMap": {

"max_tokens": "max_completion_tokens"

}

},

{

"model": "o1-preview",

"name": "o1-preview",

"avatar": "/imgs/model/openai.svg",

"maxContext": 125000,

"maxResponse": 32000,

"quoteMaxToken": 120000,

"maxTemperature": 1.2,

"charsPointsPrice": 0,

"censor": false,

"vision": false,

"datasetProcess": true,

"usedInClassify": true,

"usedInExtractFields": true,

"usedInToolCall": true,

"usedInQueryExtension": true,

"toolChoice": false,

"functionCall": false,

"customCQPrompt": "",

"customExtractPrompt": "",

"defaultSystemChatPrompt": "",

"defaultConfig": {

"temperature": 1,

"stream": false

},

"fieldMap": {

"max_tokens": "max_completion_tokens"

}

}

],

"vectorModels": [

{

"model": "text-embedding-ada-002", // 模型名(与OneAPI对应)

"name": "Embedding-2", // 模型展示名

"avatar": "/imgs/model/openai.svg", // logo

"charsPointsPrice": 0, // n积分/1k token

"defaultToken": 700, // 默认文本分割时候的 token

"maxToken": 3000, // 最大 token

"weight": 100, // 优先训练权重

"defaultConfig": {}, // 自定义额外参数。例如,如果希望使用 embedding3-large 的话,可以传入 dimensions:1024,来返回1024维度的向量。(目前必须小于1536维度)

"dbConfig": {}, // 存储时的额外参数(非对称向量模型时候需要用到)

"queryConfig": {} // 参训时的额外参数

},

{

"model": "text-embedding-3-large",

"name": "text-embedding-3-large",

"avatar": "/imgs/model/openai.svg",

"charsPointsPrice": 0,

"defaultToken": 512,

"maxToken": 3000,

"weight": 100,

"defaultConfig": {

"dimensions": 1024

}

},

{

"model": "text-embedding-3-small",

"name": "text-embedding-3-small",

"avatar": "/imgs/model/openai.svg",

"charsPointsPrice": 0,

"defaultToken": 512,

"maxToken": 3000,

"weight": 100

}

],

"reRankModels": [],

"audioSpeechModels": [

{

"model": "tts-1",

"name": "OpenAI TTS1",

"charsPointsPrice": 0,

"voices": [

{ "label": "Alloy", "value": "alloy", "bufferId": "openai-Alloy" },

{ "label": "Echo", "value": "echo", "bufferId": "openai-Echo" },

{ "label": "Fable", "value": "fable", "bufferId": "openai-Fable" },

{ "label": "Onyx", "value": "onyx", "bufferId": "openai-Onyx" },

{ "label": "Nova", "value": "nova", "bufferId": "openai-Nova" },

{ "label": "Shimmer", "value": "shimmer", "bufferId": "openai-Shimmer" }

]

}

],

"whisperModel": {

"model": "whisper-1",

"name": "Whisper1",

"charsPointsPrice": 0

}

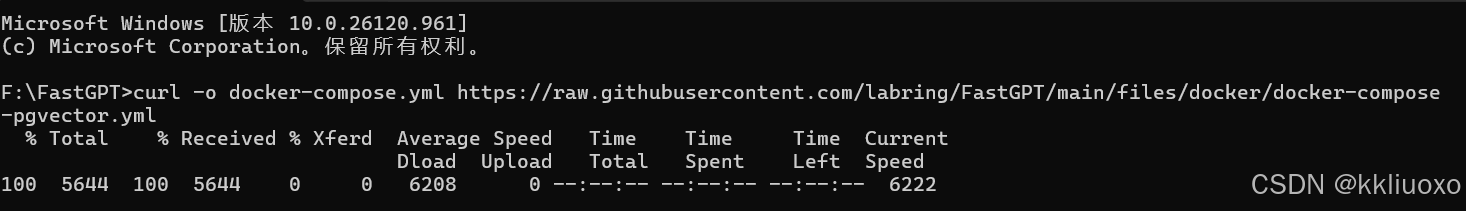

}- ②docker-compose.yml

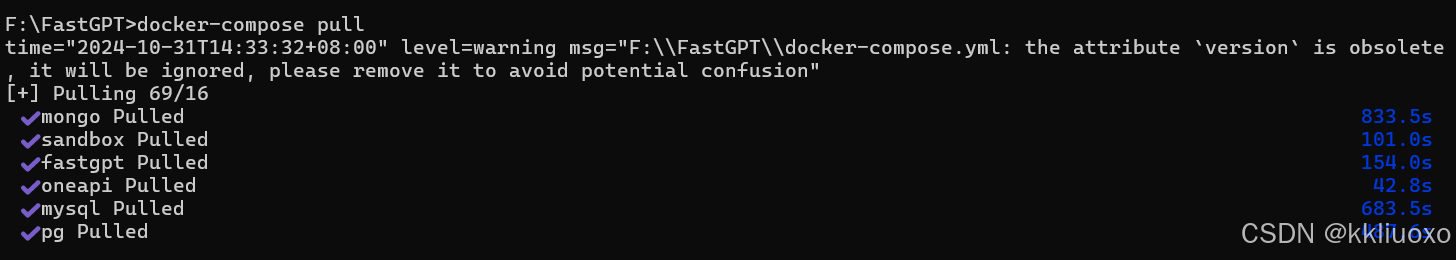

- 在FastGPT文件夹中打卡cmd

- 输入该命令

-

curl -o docker-compose.yml https://raw.githubusercontent.com/labring/FastGPT/main/files/docker/docker-compose-pgvector.yml下载:docker-compose.yml

- 下载完成后:

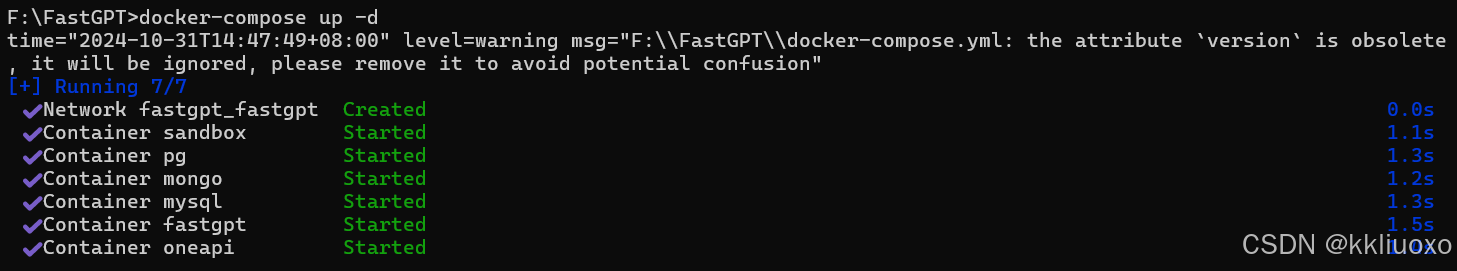

- 还是在该文件夹中打开cmd依次输入以下命令:

- # 在 docker-compose.yml 同级目录下执行 docker-compose pull docker-compose up -d

# 在 docker-compose.yml 同级目录下执行 docker-compose pull docker-compose up -d

-

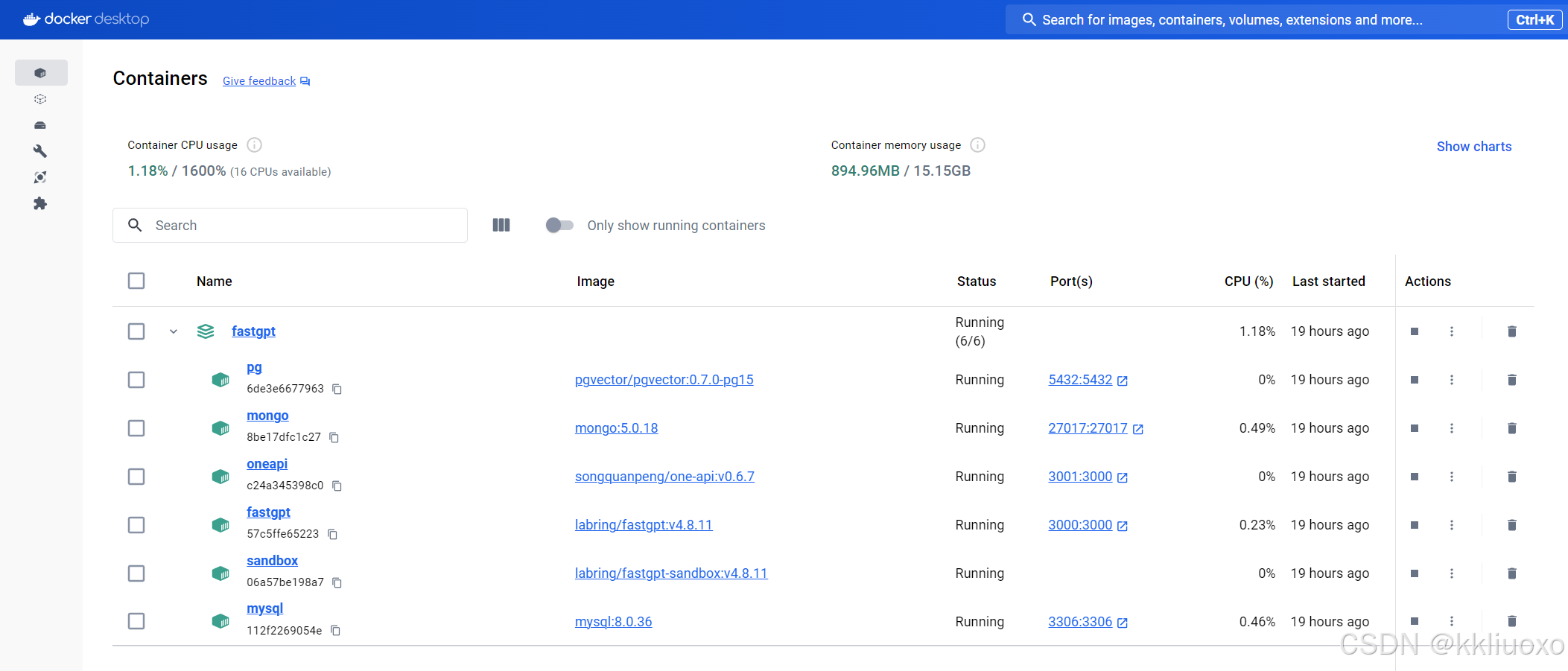

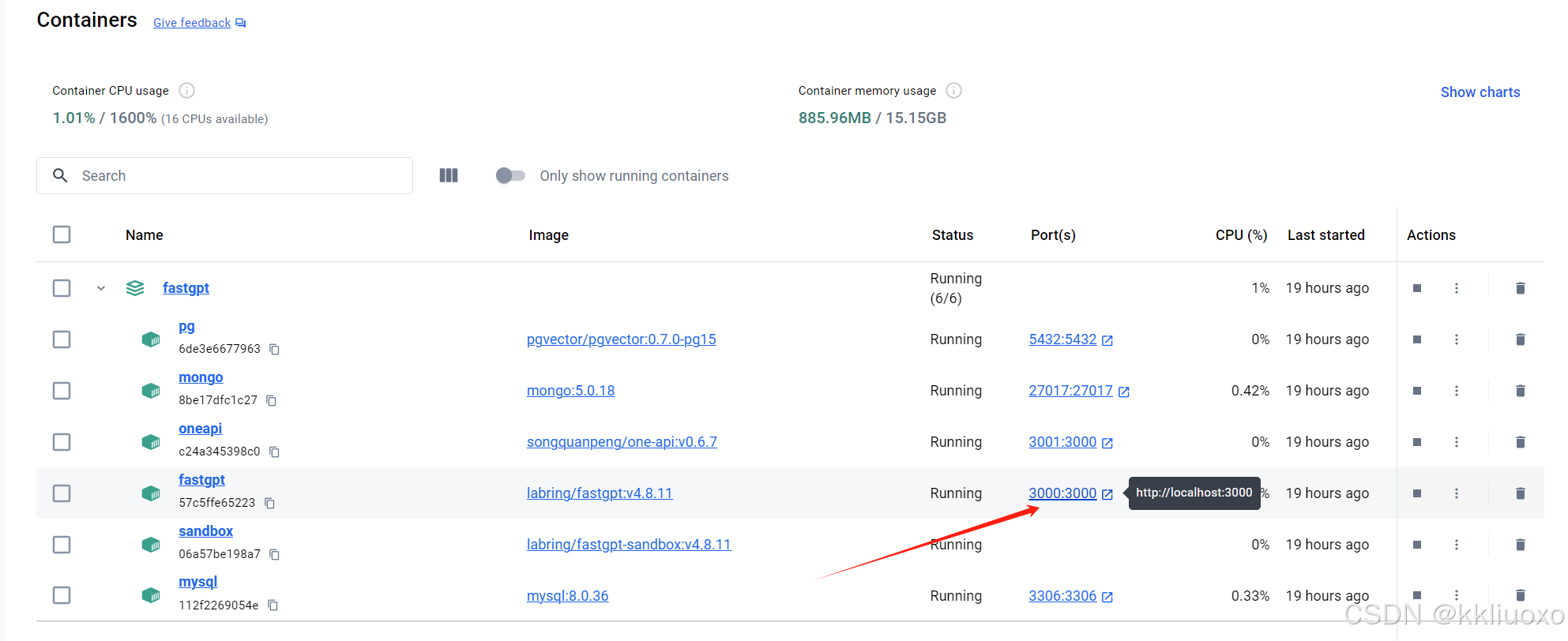

- 完成后可以在 docker 软件看到如下界面(绿色表示启动成功、黄色表示启动失败)

-

4、浏览器访问

- docker 里点击 fastgpt 的 Port 直接跳转或者浏览器输入 http://localhost:3000

-

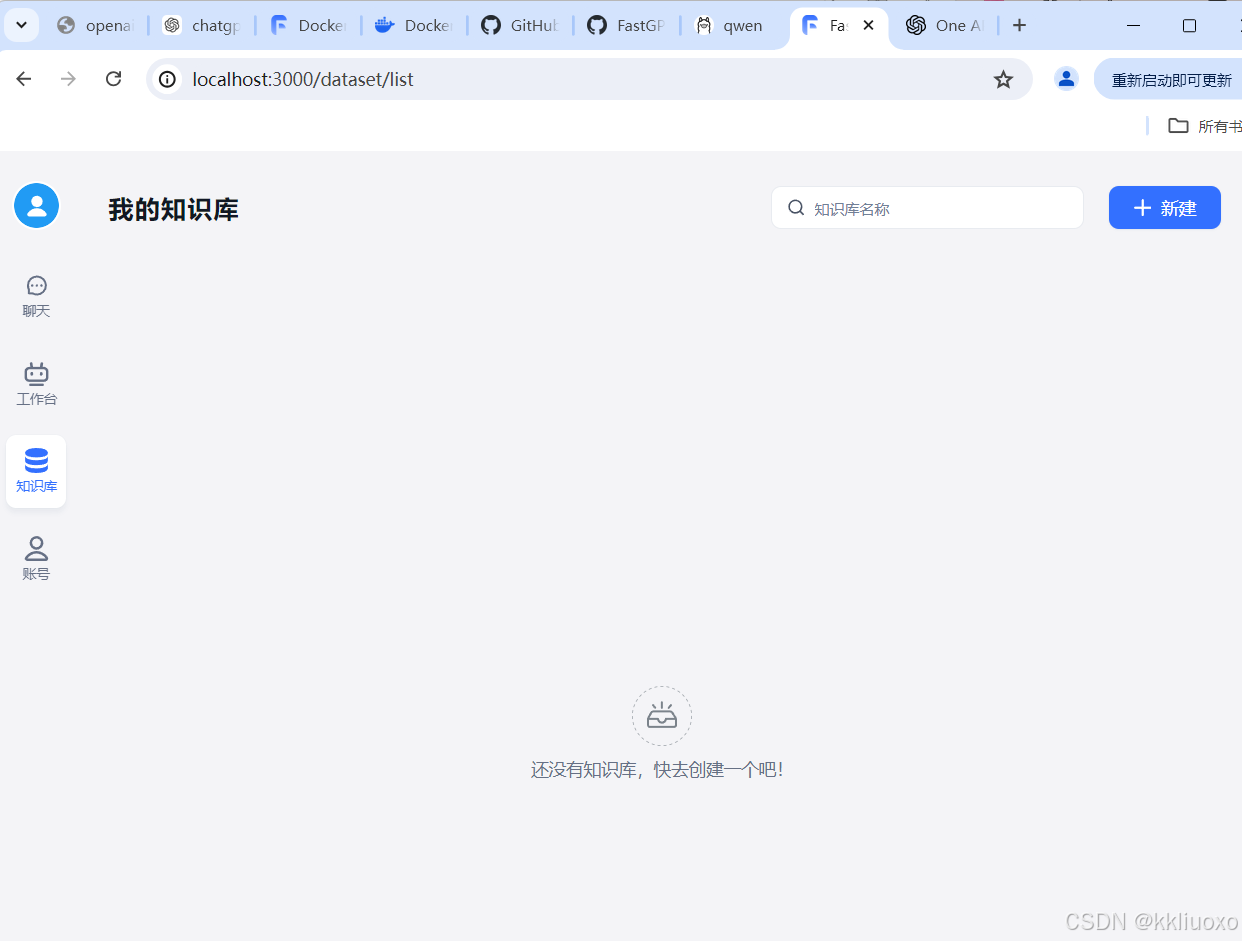

登录用户名为 root,密码为 1234(密码是 docker-compose.yml 环境变量里设置的 DEFAULT_ROOT_PSW。如果需要修改 root 密码,直接修改这个环境变量,并重启即可。)

看到如下界面即为 FastGPT 启动成功

-

2631

2631

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?