张吕敏魔改forge,6G也能跑Flux

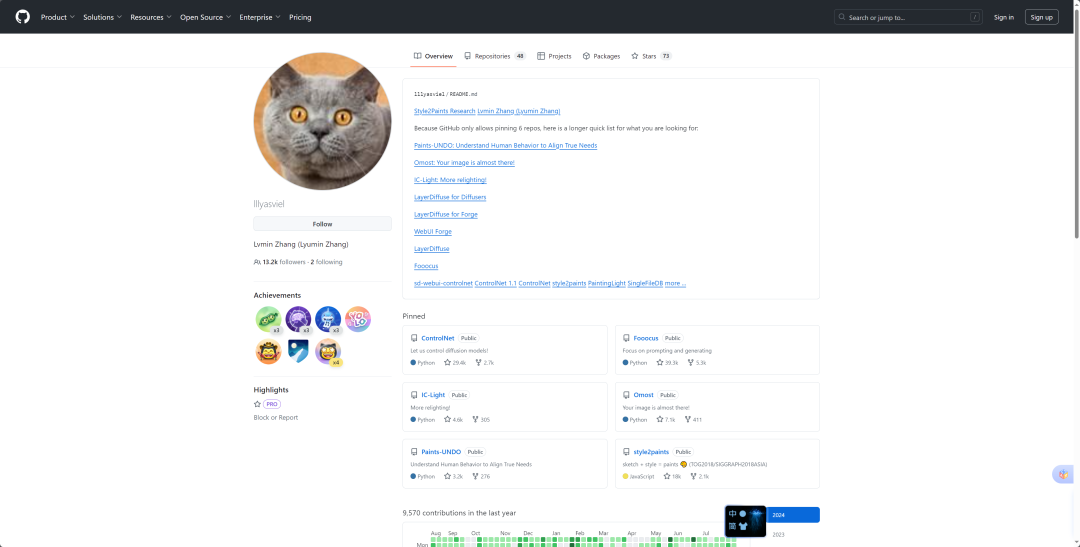

FLUX对硬件配置的要求相对较高,量化版本至少需要8G显存,但实测6G显存也能运行,尽管速度较慢。为了解决这一问题,AI领域的**“赛博佛祖”张吕敏开发了更加精简的FLUX量化版本,并在其改造的Forge工具上实现了仅需6G显存**即可运行的能力。

Forge工具是张吕敏魔改的WebUI,以其精简和优化而闻名,特别适用于低显存环境,能够在6G显存上提高60-75%的生成速度,8G显存上提高大约30~45%的速度。这使得AI绘图的门槛进一步降低,让更多用户能够体验到AI绘图的魅力。

此外,张吕敏还开发了其他多个与AI绘图相关的项目,如ControlNET、LayerDiffusion、IC-Light和Fooocus等,均为开源项目,对AI绘图领域的发展做出了重要贡献。他的工作不仅限于技术层面的创新,还致力于降低技术使用门槛,使更多人能够便捷地使用AI绘图工具。

这份完整版的comfyui整合包已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

Forge本地跑Flux

Flux模型资料包

夸克网盘:https://pan.quark.cn/s/1a584011b9d6

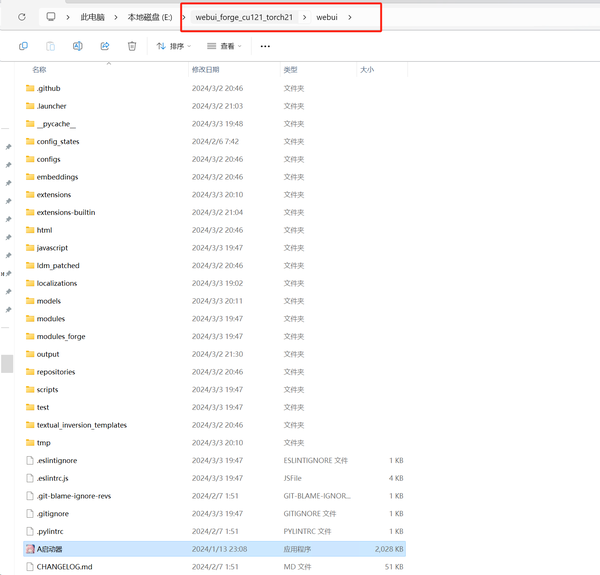

第一步:准备环境

-

将 Forge 一键包解压缩到指定目录。

-

将秋叶启动器拷贝到

WebUI_forge\webui目录下。

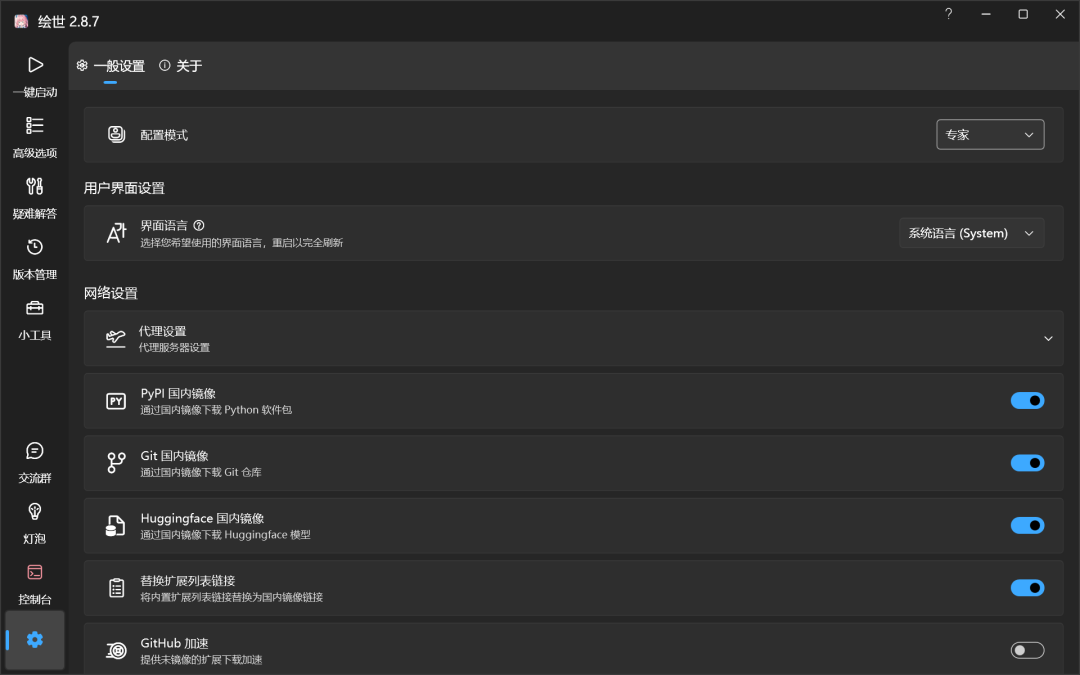

第二步:启动和设置

-

打开秋叶启动器。

-

在启动器中选择“WebUI开发版”。

-

启动器将自动下载所需的依赖文件。下载完成后,不要立即启动。

第三步:配置专家模式

-

在启动器中点击“设置”按钮。

-

切换到“专家模式”。

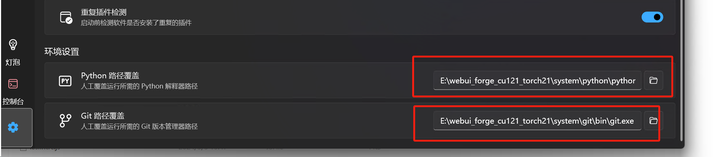

Python路径覆盖为:

E:\webui_forge\system\python\python.exe

Git路径覆盖为:

E:\webui_forge\system\git\bin\git.exe

system按照你的解压缩包目录设置,墙裂建议不要变更默认的解压缩包后的文件夹名称。

第四步:启动 WebUI

-

完成设置后,使用一键启动功能启动 WebUI。

-

启动后,您可以像使用普通版 WebUI 一样进行操作。

第五步:安装改造的量化模型

-

下载张吕敏改造的量化模型。

-

将下载的模型文件拷贝到以下路径:

`\webui_forge\webui\models\Stable-diffusion`如果您已设置与 WebUI 共用模型,则拷贝到 WebUI 的模型目录。

跑图效果:

提示词:A cute white cat with blue eyes is meditating in an underwater coral reef, in the style of Disney Pixar, in the style of Disney movie posters, title “Thunder monique”, high resolution, hyper realistic, cinematic, natural light

提示词:Vision, human background, backlight,A layout for a mixing plugin, crafted by the masterful Amano Yoshitaka in the realm of digital art and painting. This piece has been trending on ArtStation and is compatible with Unreal Engine. The scene features traditional Chinese architecture amidst a cityscape that resembles a lush forest, all set against a majestic mountain backdrop with flowing water and meticulously detailed elements

提示词:An attractive young woman is frozen in the speech, showing confidence and charming style. Her bright, expressive face was all the more animated by a faint smile, and her piercing green eyes shone with intelligence. She carried a stylish black microphone and wore a tailored navy uniform with a plunging neckline and a shimmering pattern. Around her neck she wore a green lanyard with a badge bearing the “Google” logo. The background is blurred, setting off a white banner with various logos and text printed on it, creating a professional or conference atmosphere. Her easy posture and charming smile convey intelligence, confidence and an ineffable attraction.

这份完整版的comfyui整合包已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

132

132

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?