第十章 辅助机器人对人类的心理建模

引言

医疗保健是一个广阔的问题领域,可以应用新颖的机器人解决方案。一个关键且不断发展的问题是,以医疗保健为中心的机器人将如何与它们服务的对象进行交互并提供协助。在许多方面,协助患者与和健康成年人互动有着根本性的不同。成为患者意味着存在某种可能削弱或损害个人判断力的疾病。因此,人机交互(患者与机器人)可能需要从独特的角度来考虑机器人应如何以及为什么与人互动。作为护理者,机器人可能会面临各种情境,例如提供陪伴、保护患者的尊严、为防止自残而对人员进行约束,或隐蔽地观察其行为。作为该领域的研究人员,我们必须认识到,为了有效发挥作用,机器人必须具备适应性和灵活性,能够与各种个性类型、残疾情况以及智力水平的人进行交互。

患者与机器人交互的动态特性为新颖的研究带来了挑战和机遇。在某些情况下,实现“一刀切”式的机器人辅助治疗是不现实的。当我们从将机器人作为辅助工具,转变为将其作为维护和提升人类身心健康的主动合作者时,必须开发出能够根据患者需求在治疗过程中自主个性化其行为的系统。构建能够感知和建模个体心理状态的系统,是当前人机交互(HRI)和社会机器人学领域正在积极研究的重要课题。本章节介绍了相关进展,并探讨了下一代机器人的发展前景,这类机器人将能够与患者进行社会性互动,建模他们的心情、个性、喜好与厌恶,并利用这些信息用于指导机器人辅助相关决策的信息。这些机器人需要能够识别一个人何时信任它们,或一个人是否正在表现出欺骗性行为;同时还需要决定是否为了有益的患者结果而采取欺骗性的行动。我们回顾了辅助机器人对患者进行认知、行为和心理建模的相关主要研究领域。

本章节首先探讨了人们通常被描述的维度或属性,特别是与需要帮助的人相关的特征,重点关注在人与人之间的互动中所使用的特质,如年龄和情绪状态。个体的状况是辅助机器人可能需要考虑的另一个重要区分因素。例如,该个体是否存在可能影响机器人与其交互方式的神经功能缺损?听力障碍可能导致某些患者难以或无法理解口头指令。在为老年人开发送药和送水机器人的过程中得到的经验表明,潜在用户的行动能力对其对该系统的看法以及使用意愿具有关键影响[1]埃梅利等人采访了老年人,了解他们对承担递送任务的机器人的兴趣。尽管一些个体表现出兴趣,但其当前的行动能力在其对系统的评估中起到了重要作用(图1)。

接下来,我们将介绍来自更传统机器人领域的行为建模方法,例如人机交互和社交机器人领域。正如将要展示的那样,人机交互研究人员使用心理建模仍处于初级阶段。

然后,我们介绍了对人进行心理建模的主要方法。不同类别的模型与其起源领域相关。例如,经济模型关注人们所做的决策以及这些决策如何影响其内部状态或效用。通常,不同的人类行为经济模型会根据其在严格控制的实验室实验中预测人们决策的能力来评估。这些方法虽然与辅助场景没有直接关联,但非常重要,因为它们为建模人类提供了形式化、有依据且可计算的方法,可以实现在控制机器人的软件中。

认知模型是用于建模人类的另一类重要方法。认知模型试图逼近支撑认知的各种过程。人们提出了多种架构,作为对动物和人类思维模式的不同设想。这些架构通常根据其对人类行为及其时间特性预测的准确性来评估。接下来,我们将讨论如何基于显式信号测量人类特征,以便将其应用于基于个体的模型中。本章最后总结了辅助机器人在人类建模领域的研究成果,并提出了未来工作的新的方向。

2. 人类特征刻画的维度

人类特征刻画具有关键作用,无论这种刻画是由其他人还是由机器完成。若干社会科学(如认知心理学和社会心理学)有着相似的目标,即确定能够解释人类共性与个体差异的人类特征刻画方式。研究者常常希望理解人们为何存在差异以及这些差异如何测量,通过使用共同的维度来定义个体,从而更好地解释、理解和预测个人行为。开发用于表征这些维度的计算方法,也为人工推理者(例如机器人)模仿并利用已知的人类分类技术提供了途径。

无论明确还是隐含,人们都在不断对他们所互动的个体进行分类。由于认知过程通过最大化资源来弥补有限的处理能力,人类通常会根据自己对其他个体的即时分类形成印象并推断其特质,而不是等待体验每一个具体特质。

第一手[78]。关于人们如何对他人进行分类的研究各不相同,例如涵盖社会性和个体化概念[2,3];关注一个人的显著特征(如身高)或行为特征(如个性);或涉及自上而下(以类别为导向)或数据驱动(以属性为导向)的推断[4]。同样可以预期的是,当人们相互评价时,会经历若干阶段,其中初始分类、确认性分类、重新分类以及零散处理(如费斯克等人所述)受到注意力和解释的调节,并受信息和动机的影响。

尽管并不详尽,但以下段落描述了通过社会科学研究所确定的许多用于描述人类的维度,这些维度对于促进人机交互尤其重要。

2.1 个性

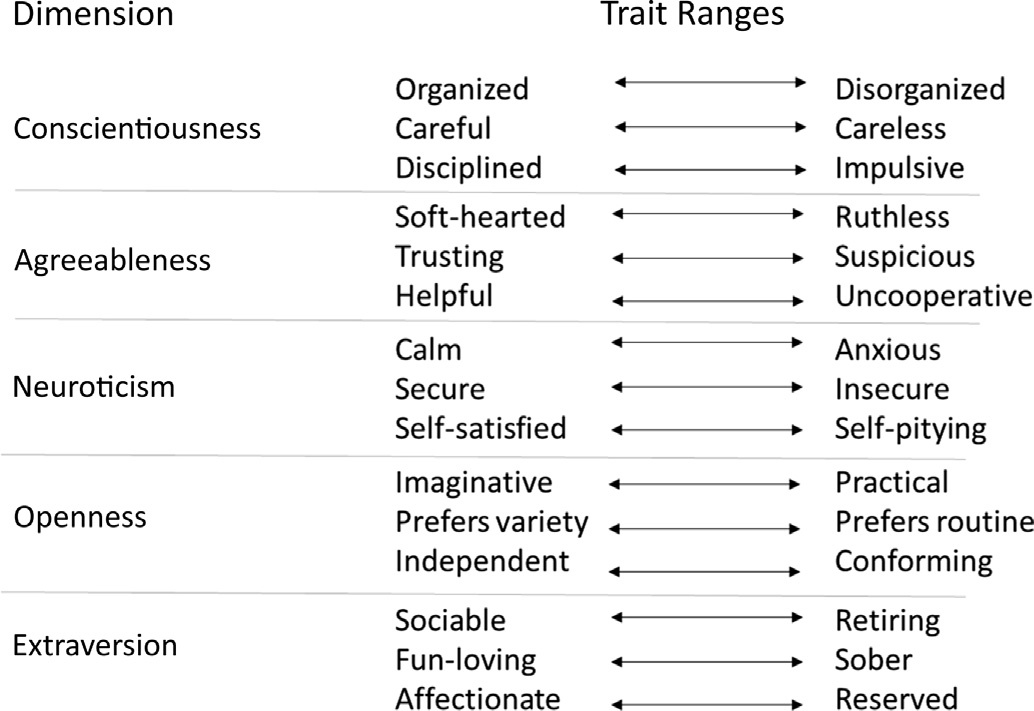

描述一个人时,最常见的方式(无论是明确还是隐含的)是为其赋予一系列人格特质。有几种主要理论用于描述个性[6],包括“大五人格”[7],艾森克PEN模型[8],以及迈尔斯‐布里格斯性格类型指标[9]。这些理论将人“分解”为多个维度。例如,使用大五人格模型时,人们会根据五个因素进行刻画:开放性、尽责性、外向性、宜人性和神经质(参见表1以获得关于这些维度及其相关特质范围的更全面描述)。

表1 “大五人格”个性维度[7]及其相关特质范围

尽管个性可能具有动态性(关于人们是否具有稳定的个性仍存在争议),但个性分析已被证明在预测多种行为方面具有价值,例如在职业环境中的工作表现[10]),个性分析已被证明在预测多种行为方面具有价值,例如在职业环境中的工作表现[11]。

2.2 情绪和心情

理解一个人的情绪或情绪状态至关重要,尤其是在涉及潜在的人机交互(HRI)时。研究情绪的一种主要方法是将情绪视为由一系列“基本情绪”构成的调色板。这些观点通常将基本情绪视为“低层次”的感受,例如愤怒、厌恶、恐惧、喜悦、悲伤、惊讶[79]。基于奥顿尼、克洛尔和柯林斯理论的情感“类型”识别,[12],也称为“OCC”模型,该模型认为情绪是某些认知和解释的结果,而这些认知和解释基于个体对主体、客体和事件的世界理解(参见表2中描述的该模型的22种情绪)。情绪如何产生在很大程度上取决于个体如何感知和解释事件。个体可能对某一事件的结果感到满意或不满意(满意/不满意);可以认可或不认可某一主体的行为(赞成/不赞成);或喜欢或不喜欢某一客体的某些方面(喜欢/不喜欢)。

进一步的区别在于,事件可能对他人或自己产生后果,而行为者可以具有不同的角色。事件对他人的后果可分为期望的和不期望的;对自己而言的后果则可分为相关或无关的预期。对于自己的相关预期最终可进一步区分为是否实际发生(已确认/未确认)。

相比之下,心情通常并不以针对某个人或事件的方向性为特征。虽然某人可能会对特定对象(例如,一位同事)表现出某种情绪(愤怒),但当这种特定情绪消退后,他们可能会感到一种普遍的坏心情。在某些情绪模型中(例如,[13]),个体对其产生的情绪的感知被视为代理人的感受,这些感受受到情绪、个体对当前情境的评估以及心情(即近期情绪的记忆[14])的共同调节。

2.3 智力

智力是一个被广泛研究的个体特征,其测量已被用于预测各种人类行为,例如工作表现性能[80]。目前大多数智力因素模型通常将认知能力表示为三级层次结构,其中最高层是一个被称为一般智力因素(g)的单一因素,它代表所有认知任务共有的方差[81]。智力还与人格特质相关,尤其是开放性和智力,其中在开放性维度上得分较高的个体通常在认知能力测量中得分更高[15]并且更有创造力[16]。

表2 OCC模型指定的22种情绪的类型和说明[12]

| 情绪类型 | 说明 |

|---|---|

| Joy (对⋯⋯感到高兴) | 一个期望事件 |

| 苦恼 (对⋯⋯感到不悦) | 一个不期望事件 |

| 为他人高兴 (对⋯⋯感到高兴) | 被认为对某人有利的事件 else |

| Pity (对⋯⋯感到不悦) | 被认为对⋯⋯不利的事件 别人 |

| 幸灾乐祸 (对⋯⋯感到高兴) | 被认为对某人不利的事件 else |

| 怨恨 (对⋯⋯感到不悦) | 一个被认为对他人有益的事件 别人 |

| Hope (对⋯⋯感到高兴) | 一个理想事件的前景 |

| Fear (对⋯⋯感到不悦) | 一个不理想事件的前景 |

| 满足 (对⋯⋯感到高兴) | 理想前景的确认 事件 |

| 恐惧确认(对⋯⋯感到不悦) | 一个不期望事件前景的确认 不期望事件 |

| 宽慰 (对⋯⋯感到高兴) | 一个不期望事件前景的否定 不期望事件 |

| 失望(对⋯⋯感到不悦) | 期望事件前景落空 期望事件 |

| 自豪 (赞成) | 自己值得称赞的行为 |

| 羞耻 (不赞成) | 自己应受谴责的行为 |

| 钦佩 (赞成) | 他人值得称赞的行为 |

| 责备 (不赞成) | 他人应受谴责的行为 |

| 满足 (对自己值得称赞的行为的赞许)以及(感到满意) | 关于相关理想事件 |

| 懊悔 (不赞成) | 自己应受谴责的行为和(处于) 对相关的不良事件感到不快 |

| 感激 (赞同) | 他人值得称赞的行为并且(对相关期望事件感到高兴) |

| 愤怒 (不赞成) | 他人应受谴责的行为并且 |

| Love (喜欢) | 一个有吸引力的物体 |

| Hate (不喜欢) | 一个没有吸引力的物体 |

2.4 社交智能

除了传统的智力衡量标准外,社交智能[82]是一种代表个人表达、识别和管理社会信号及社会行为能力的品质[17],例如礼貌和同理心。作为社交智能的一个子集,情绪智能涉及个人监控自身及他人感受和情绪的能力,并基于这种评估做出明智决策[18]。情绪智能的五个关键因素是:自我意识、自我调节、动机(对工作的热情和韧性)、同理心以及社交技能。为了对机器人有用,这些维度必须在计算框架内表示。以下部分介绍了一些最常见且广为人知的用于建模人类的计算框架。

3. 为HRI构建行为模型

由于机器人在现实世界中具有物理存在性,人们与这些机器交互的方式在某些方面可能是独特的。例如,贝塞尔等人将机器人访谈与人类访谈就错误信息效应[19]进行了比较。错误信息效应是指一个人的记忆受到事件后信息的影响,从而导致回忆准确性降低的现象。例如,在刑事调查中,审讯员的提问会影响目击者对事件的记忆。贝塞尔等人发现,使用机器人作为访谈者时,尽管存在错误信息,受访者的记忆回忆量和准确性更高。在辅助环境中,使用机器人可能使患者更准确地陈述其患病原因。

人机交互研究还表明,人们倾向于听从机器人的指令。麦考尔和内贾特发现,他们测试的老年人中有87%会遵从机器人进食的提示[20]。萨勒姆等人发现,即使机器人的指示有误,人们通常也会服从[21]。他们发现,三分之二的受试者甚至会在机器人要求下将橙汁倒在植物上。大多数人以某种方式为这一请求进行了合理化解释。

值得注意的是,拟人化会强烈影响人类与机器人交互的方式。拟人化是指将人类特征归因于非人类物体的倾向。当被拟人化的客体是机器人时,这种倾向可能导致对机器人的行为、意图或沟通倾向产生不准确的预期[22]。人机交互研究人员有时不得不开发为了减少拟人化,使用机器人“生物”[23]。其他人则通过尽可能使他们的机器人显得类人来拥抱拟人化[24]。格拉奇等人率先使用类人虚拟角色用于培训以及提高心理治疗有效性[25]。机器人与患者互动的性质可能会决定是否采用或避免拟人化。

人机交互领域已开始探索机器人对人类进行建模,并利用这些信息来指导自身行为的可能性。这项工作通常属于心智建模以及共享心智模型构建的范畴。与经济模型或认知模型不同,心智模型仅仅是个人对他人的思维过程的理解[26]。因此,心智模型的概念相当模糊且缺乏明确定义。此外,与经济模型和认知模型不同,心智模型没有天然的计算基础。因此,机器人专家往往需要自行构建。

命题是表示个体信念的常用形式[27];概率性陈述也经常被使用[28]。信念‐欲望‐意图模型(BDI)也已被用于建模人类的心理状态。信念表示个体当前所意识到或以某种方式知晓的信息。欲望表示个体的目标或动机,而意图则表示个体经过深思熟虑后采取的行动方案[29]。尽管BDI方法在模拟和虚拟环境中具有一定的用途,但其在捕捉与人类决策相关的丰富性和变异性方面存在局限性。

部分可观测马尔可夫决策过程(POMDPs)也已被建议作为表示机器人交互对象模型的一种方法。POMDPs将决策过程建模为相互连接的状态链[30]。在每个时间步长,机器人观察有关环境当前状态的信息,这些信息最终用于在下一个时间步长选择一个动作。尽管由此产生的行为可证明为最优,但对于大多数非平凡问题,精确的POMDP解决方案在计算上难以处理;近似解是常态[31]。

除了对人的心理状态进行建模外,辅助机器人对与治疗相关的患者风险进行建模也可能很有用。例如,外骨骼有望成为一种重要的治疗工具,甚至可能成为某些类型瘫痪的长期解决方案。对于这些系统而言,对特定类型运动(如爬楼梯)相关的风险进行建模,并警告用户相关风险,可能是有益的。

最后,机器人在与人交互时创建和使用心理模型会带来重要的伦理影响。这类机器可能具备回忆与个人或某类人相关的大量数据的能力。根据具体情况,这些信息可能会被轻易用于操纵或不公正地胁迫患者。机器人系统的开发者必须考虑心理建模在何种程度上是恰当且合理的。

鉴于当前方法的局限性,我们可以通过融入人类心理的元素以及这些元素产生的信号来增强真实感。

4. 经济决策模型

最早且最完善的关于人类决策的正式模型决策源于经济理论。杰里米·边沁提出了这样的观点:经济交换及其背后的决策是由人们试图最大化快乐并最小化痛苦所驱动的,并且可以据此进行衡量[32]。边沁认为,一个人的动机和相应行为直接反映了其行为的效用。效用理论的核心主张是,人们通过主观评估行动选择的价值来进行决策。如果个体认为某一特定行动或行动方案比其他方案具有更高的主观价值,则该行动将优于其他方案。

与许多传统的心理学理论不同,效用理论在数学上得到了形式化。这种数学基础提供了一个计算框架,可被用于试图建模和预测人类行为的辅助机器人。效用理论假设,人在做出决策时会获得可量化的愉悦感 u2 。效用函数 U :X ! 用于描述个体在一组固定选择中的偏好。偏好被定义为集合 X 上的一种关系 ≼,对于任意 x, y ∈ X,若 U xð Þ U yð Þ,则意味着 x≼y。当个体选择能够使其效用函数最大化的行动时,便产生了理性行为。理论上,理解一个人的效用函数即可预测此人的行为。

期望效用理论在行动选择所导致的效用不确定时,考虑个体的偏好[33]。不确定性通常被建模为一种赌博,即根据已知的概率分布(p)获得结果(x)。期望效用 EU 随之通过结果效用与概率的乘积得出。因此,多个赌博的结果 x ¼ x 1, N f g 2, x …, x 的期望效用计算为 EU x½ ¼XN i pixi。

约翰·冯·诺依曼和奥斯卡·摩根斯特恩指出,若个体的偏好满足某些公理,则该个体总是倾向于选择能够最大化其期望效用的行为[34]。相反,若个体的偏好违背了冯·诺依曼和摩根斯特恩公理,则其所做的决策必然导致损失。故意选择会导致损失的行为被视为非理性行为。因此,理性个体被认为是指选择能够最大化自身效用的行为的个体。

期望效用理论的主要批评之一是,它错误地假设人们以理性且效用最大化的方式行事。实际上,众所周知的偏差会持续影响人类决策。例如,人们往往厌恶损失。一个人的决策受避免损失的愿望(损失厌恶偏差)的影响,大于追求收益的愿望。情境的描述或表述方式也会影响决策(框架效应)。将选择表述为收益或损失已被证明会影响决策。人类也有偏好现状的偏差。现状被用作评估某个选择是否会导致损失或收益的参考点。人们倾向于对距离参考点越远的额外收益或损失赋予更低的价值。例如,获得10万美元和10万零100美元之间的感知效用差异被认为很小,而获得0美元和100美元之间的感知效用差异则被认为很大,尽管两者差额的价值相同。

最后,人们 tends to over‐ estimate the likelihood of low‐probability events and underestimate the probability of high‐probability events。

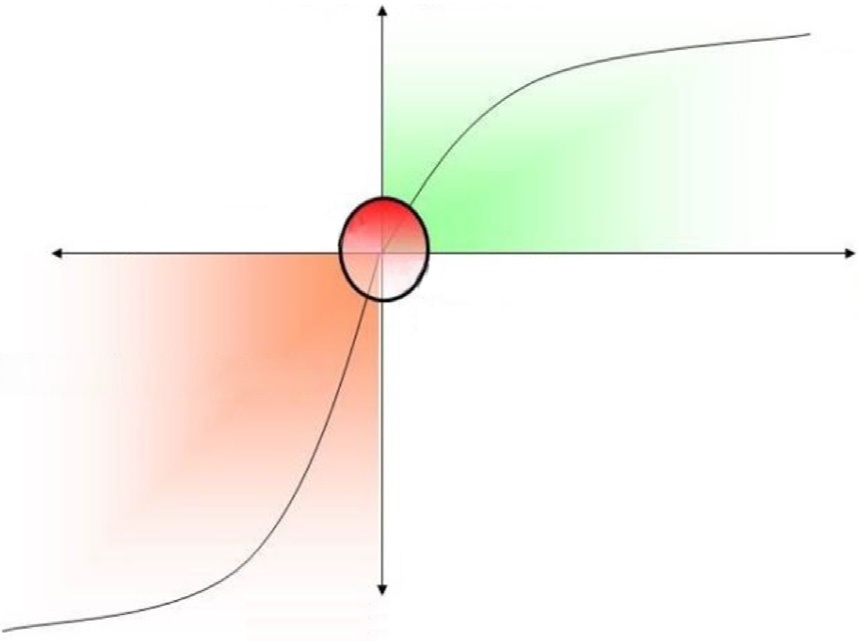

前景理论旨在更好地解释人们在风险与不确定性下做出选择时的实际行为[35]。前景理论认为,期望效用应被评估为 EU x½ ¼ XN i w p ð iÞv x ð iÞ,其中 EU 是与决策 x1, x2,…, xN 相关的期望效用,p1, p2,…, pN 是它们各自的概率。函数 v 将结果值映射为效用,函数 w 对概率进行加权,以反映个体的风险偏好。图2 描绘了前景理论价值函数的典型形状。y 轴表示个体当前的参考点。损失和收益是相对于参考点来评估的。图形中损失部分更陡的斜率模拟了损失厌恶。曲线尾部表明额外收益或损失的影响逐渐减弱,反映了收益/损失饱和效应。

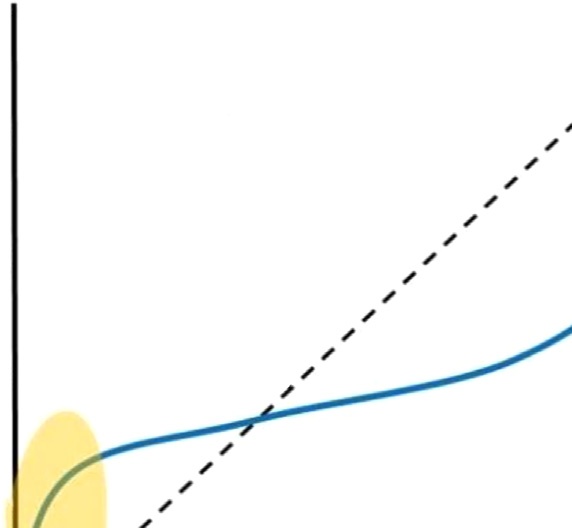

图3 描绘了前景理论中的概率权重函数。用于权重函数的曲线通过高估低概率事件的可能性以及高估高概率事件的可能性来模拟确定性效应。总体而言,概率权重和效用估值函数的引入,以及这些函数所呈现的形状,使得前景理论能够更好地模拟一个人的经济决策及其偏差。

尽管前景理论是一个重大进展,但一个问题仍然存在[36]。设 x和 y 为赌博产生的结果

拐点

参考点

损失与收益的尾部 显示影响减弱

损失的斜率增加

–90 –50 50 90

效用(幸福)

大小 结果

Pain

前景理论价值函数

–10 10

A1和A2。如果P x > 1 ð jÞ t A 表示赌博A1的结果超过t的概率,那么当且仅当对于所有t都有P x 1> 1 Þ j t A ≥ P x 2> 2 ð jÞ t A 时(假设A16¼ A2),称决策(A1)“随机占优”于决策(A2)。遗憾的是,由于加权概率函数的形状,前景理论预测了一些情境,在这些情境中尽管A2被A1随机占优,但仍选择A1。累积前景理论是前景理论在理论和实践上的改进,不会违反随机优势[37]。图4描绘了一个保持随机优势的加权概率函数。

人们已经提出了这些行为决策理论的许多扩展和改进。与效用理论不同,后悔理论关注个体动机,旨在最小化与后悔相关的负面情绪[38–40]。后悔理论认为,对选择的偏好 A1可以形式化地表示为:

A1 A2, X N i p i v A1 ð xiÞ Þ v A2 ð xiÞ Þ Þ

其中v是效用函数。后悔理论比前景理论更能解释某些决策。有关后悔理论的更正式和详细的论述,请参见参考文献[40]。

上述理论基于人类行为的理性模型。而决策场理论则是一种动态理论,不假设存在固定且理性的偏好集[41]。决策场理论包含一个偏好演化模型,使其能够更好地解释决策规律性,并在特定条件下对决策时间做出预测。有关决策场理论的更多详细信息,布泽迈耶和迪德里希对该领域进行了综述[42]。

对于试图对人进行建模的机器人而言,决策理论提供了一个计算上的起点。它们易于在机器人上实现,并且与强化学习等更传统 的机器人框架具有一些共同的概念特质。然而,决策理论往往假设理性或半理性行为,低估了人类行为的独特性、情绪性和自动性。此外,一些人认为,单一的标量效用值不足以充分表示一个人的状态。尽管如此,这种方法已被经济学家和其他领域成功应用了60多年。在机器人学方面,瓦格纳表明,机器人可以学习与不同类型的人相关的模型类别[43]。这些刻板模型随后可用于对与新遇到的人的互动做出预测。辅助机器人或许可将这些技术作为与其新患者早期互动的一种引导策略。之后,随着时间推移和经验积累,该系统可将其互动方式调整以适应特定患者的需求。

4.1 神经经济学

鉴于基于效用的人类决策经济模型的局限性,研究人员开始探索将传统经济模型与神经科学的研究成果和数据相结合的方法。他们将这一新方向称为神经经济学。神经经济学是一门跨学科领域,旨在在效用理论的基础上,纳入来自神经科学的证据。作为一个学科,神经经济学致力于在其人类行为模型中包含自动化的和情绪加工过程[44]。大量证据表明,人类决策受到自动的无意识过程[45,46]以及情绪[47]的强烈影响。特别是情绪,往往容易劫持个体的决策能力,引发通常被视为非理性的行为。情绪还会影响学习,进而影响决策[13]。有重要证据表明,记忆被赋予了情绪信息,当回忆时,会产生与记忆形成时相似的情绪。

神经经济学采用脑成像技术,以更好地理解决策过程中的心智处理机制。通常,通过脑图像来比较人们在执行实验或控制任务时的脑活动。这些任务通常包括经济博弈,例如囚徒困境或投资游戏。例如,金‐卡萨斯等人使用超扫描功能磁共振成像仪(fMRI)来监测参与者在进行双人投资游戏时的神经反应[48]。在这个游戏中,一个人担任投资者角色,另一个人担任受托人角色。投资者被给予 $20,并可以将其中任意部分投资给受托人。投资给受托人的资金随后增值(乘以3)。然后受托人必须决定返还多少金额给投资者。金‐卡萨斯等人对参与者进行了10轮游戏的监测。他们发现了能够表明一个人信任其合作伙伴意图的神经相关性。

这些类型的研究揭示了在特定决策情境中被激活的大脑区域以及决策背后的时序过程。例如,研究表明,涉及不信任的情境会激活大脑中与恐惧情绪相关的区域[49],而涉及信任的情境则不会激活大脑的任何特定区域[50]。

该领域的大量研究还表明,当大脑整合来自多个系统的输入以生成效用类价值时,决策便产生了。多系统模型认为,这些不同系统的信息以定性上个性化的方式进行处理,并相应地加权[51]。例如,情绪或情感系统会快速且无意识地处理信息,从而产生反射性反应。而分析系统则是一种较慢的、有意识的努力,会影响行为决策。最终产生的行为是来自这些不同来源信号的综合结果(图5)。

这些信号的整合不仅限于行为。例如,感知过程与运动活动密切相关。杰西卡·维特发现,通过练习获得的运动经验实际上会增加个体对目标客体的感知大小[53]。例如,更优秀的棒球击球手会将投来的棒球感知得更大。这一现象在射门踢球手和高尔夫球手中也得到了证实。维特甚至发现,与非威胁性客体相比,人们认为蜘蛛移动得更快[54]。

不同且相互竞争的系统之间的相互作用会影响人们在与机器人互动时的决策。罗比内特等人研究了一种情境,其中机器人引导受试者前往一个会议室[55]。随后,发生紧急疏散,同一机器人提出引导他们离开大楼。在虚拟环境中,那些最初被导航能力较差的机器人引导的受试者通常选择不再使用该机器人。而在实验的真实实例中,无论机器人之前的导航表现多么糟糕,受试者都普遍选择跟随该机器人。多系统假说为这种行为提供了可能的解释。在虚拟环境中,人们较高的执行功能在做决策时会考虑机器人的声誉。而在真实环境中,当警报响起时,他们较低级、更自动的认知功能占主导地位,机器人的声誉不再被考虑。

4.2 认知架构

通过将特征表示为人类认知架构中的计算组件,可以应对评估潜在交互结果的挑战,例如安德森和莱比尔[83]、雷维尔等人[15]、或纽厄尔[84]提出的架构,这些架构均由计算组件构成。这些架构协同工作,被认为能够产生人类水平的智力。这些架构使机器人能够在某种程度上“理解”并预测人类行为[56]。其中一些架构,例如 H‐CogAff、ACT‐R 和 Soar,在较高程度上具有全面性,包含了个性等关键的心理调节因素。

通过利用人类提供的线索以及上下文信息,认知架构可以极大地增强机器人与个体互动的能力。特拉夫顿等人[56] 特别讨论了 ACT‐R的扩展版本ACT‐R/E,旨在为机器人提供心理理论(即对他 人认知的了解),以提升其功能。通过理解人们在不同情境下可能的行为方式,机器人能够更好地实现自身目标。例如,推理人们在紧急情况(如火灾)中为保护自己可能作出的反应,可使机器人获得有助于定位受害者的知识。同样,检测和推理情绪的能力可能是机器人护理者[57]的关键组成部分。这类模型可作为机器人进行决策的信息来源。

关于辅助机器人,应当预期人的心理状态会强烈影响其相对于机器人的决策。例如,情绪化患者、年轻和年长的患者以及患有创伤性脑损伤的患者可能不会考虑机器人的长期益处。辅助机器人对它试图帮助的人做出响应非常重要。如果未能监测并回应人的情绪或行为变化,很可能导致此人缺乏使用机器人的意愿,甚至可能导致患者为了阻止援助而伤害自己。

总体而言,关于人类决策的经济模型在辅助机器人技术方面可能发挥重要作用。这些模型为系统提供了一种形式化的计算方法,用于预测并可能理解人的行为。尽管这些模型存在局限性,但目前几乎没有其他成熟的选择。或许最成熟的替代方案是下一节中介绍的认知模型。

5. 推断心理模型

实施社会科学研究可使人工智能机器更好地表征、理解并最终与人类互动。机器对人类行为的更好理解可能会带来更自然和有益的人机交互(例如,[58])。为了利用这一点,社会科学研宄所提供的知识中,机器必须能够感知和解释与其互动的人类的信息。社会信号处理[59,60]的研究已经确定,心理学家和社会学家通常识别的社会信号可以通过麦克风和摄像头等设备被机器识别和捕捉,并通过机器学习等算法技术处理成智力。利用这些信号的能力使得机器(机器人)能够以类似于人类的方式创建关于人类的“心理”模型。这些模型进而允许对人类行为进行推理,从而优化机器交互的成功性。

非言语行为是持续传递有关个体特质(如情绪和个性[85])信息的信号来源。埃克曼和弗里森[61]尤其将源于非言语线索的沟通类型进行了分类,这些类型包括:情感/态度/认知状态(例如,恐惧、喜悦、压力、不同意、矛盾心理和注意力不集中),象征性动作(如眨眼或竖起大拇指等文化特定互动信号),调节动作(例如,触摸环境中物体),说明性动作(例如,手指指向和扬眉),以及调节信号(例如,点头和微笑)。

使用非言语行为并不一定足够,因为它们带有很大的歧义[85]。例如,笨拙姿势可能表示攻击性或受伤。文化也是导致个体差异[86]的一个影响因素,在解读非言语线索时必须加以考虑。为了克服这些复杂性,建议结合跨模态特征,但同时关注行为发生的上下文也至关重要。

为了建立人的行为模型,有必要找出与特定信号[17]相关的特征子集。通常,最佳方法是从所有可用数据中选择最相关的特征;然而,这可能导致仅选择那些对任何特定个体都不相关、而只适用于平均模型的特征。

5.1 检测和建模心理特征

5.1.1 个性

人类表现出许多可用于推断个性的线索(例如,[62,63])。这些线索可能表现为多种形式,例如一个人使用的语言[64]、其环境[65]、或其说话的语调[66]。个性线索可能被用来创建画像,以理解和在某些情况下预测个人行为。例如,沃尔特斯等人[87]研究了人格特质是否可用于预测人类受试者在机器人交互实验中偏好的接近距离。他们发现,变量“主动性”(主要由创造力和冲动性构成)与人类对机器人的偏好接近距离呈正相关。个体的人格也可用于优化机器人交互,其中外向个体可能更喜欢强调友好和温暖的语言,而内向个体可能更偏好缓慢的动作和更多的沉默。

5.1.2 情绪与心境

先前描述的OCC模型定义了22种情绪(见表1),该模型在建模情感代理方面极为有用,因为作者明确构建该模型以支持“关于情绪的推理”,其假设个体通过主观评估自身与环境的关系来产生情绪。对象、事件和行为在评价过程中基于特定标准进行评估,从而引发多种不同强度的情绪。当个体与对象或主体交互时,会根据目标、标准或偏好等关切点,评估其可能带来的利益或潜在伤害。如果这些关切点得到满足(例如通过面部识别等线索的识别来判断),个体便会体验到积极情绪(如钦佩、喜悦);否则则会引发消极情绪(如沮丧)。以往的研究发现了许多用于情绪检测的线索,其中大部分源于情感计算[68]领域的研究。过去的研究还确定了其他自动情绪检测方法,例如使用人工机器视觉进行面部表情分析[69]、通过语音分析检测对话者的情绪[88]、或多模态分析[70]。不同模态的情绪检测效果因情绪而异,某些情绪通过语音更容易识别,如悲伤和恐惧,而另一些情绪则通过面部表情分析更易检测,如快乐和愤怒[89]。通过表征情绪的产生以及在更长时间尺度上的心情变化,人工代理可以利用细微的线索(如面部表情的变化)为沟通提供额外含义,并察觉个体的细微变化。

5.1.3 一般智力测量

尽管智力传统上通过标准化测试(例如,[71])来衡量,但其他方法则通过智力与其他可观察的特征之间的关系来推断智力特质,例如个性和表达的兴趣(例如,[72,73, 90])以及身体特征(例如,[74])。了解一个人的智力也可能有助于人机交互。例如,在与高智力的人互动时,通过更深入的技术性阐述、使用更复杂的词汇以及提出具有挑战性的问题,可能会使交互受益。

5.1.4 社交智能的测量

推断社交智能比推断一般智力更为直接,因为相关行为可能通过互动中的各种线索表现出来,例如手势和面部表情。对人类社会信号的使用与整合通常被称为社会感知计算[59]。Vinciarelli 等人[17]将主要的社会线索划分为以下几类:外貌、手势与姿势、面部和眼神行为、声音行为以及空间与环境。在社交智能方面,Salovey 和 Mayer[18] 提出了一个模型,该模型确定了情绪智能的四个不同因素:情绪感知、利用情绪进行推理的能力、理解情绪的能力以及管理情绪的能力。个体在这些维度上的表现可用于确定最佳的交互方法[75]。

5.2 利用情境

行为建模极度依赖于行为所处的情境和上下文。人类行为具有高度可变性,会根据情境变化和适应。在一种情境下可能被理解为某种含义的行为(例如,见面时微笑表示高兴),在另一种情境下可能代表完全不同的意义(例如,看到他人受伤后微笑表示恶意)。为了在特定上下文中利用行为线索,必须理解该上下文——可能需要通过确定五个 W+问题(谁、什么、何时、何地、为什么以及如何)[17]来实现。

与对个体分类类似,对情境分类可能为优化机器人响应提供有意义的信息。例如,在必须立即做出决策的紧急情况下,个体可能被迫依赖基于本能或经验的过程,这些过程可能被视为非理性[76]。此类情境下的决策不同于非紧急情况下的推理,后者具有更高的风险、更高的不确定性以及更大的时间压力[77]。这些因素表明,有必要采用综合手段来理解和表示人类行为,尤其是在不同上下文和情境下人类行为可能发生改变的情况下。

6. 结论

机器人正成为物理和康复治疗中的一个重要层面。外骨骼和自主社交机器人可能很快将协助人们完成日常任务。我们认为,随着机器人变得普遍,重要的是它们应以包含诸多不同心理层面的方式来建模其交互的人类与患者,这些心理层面构成了人类之所以为人类的本质。我们探讨了实现和发展这些模型的主要研究方向。将行为与心理建模方法纳入机器人的决策系统中,是一个新兴且令人振奋的研究领域。随着这一研究方向的发展,人们可以预期机器人将不再符合我们传统意义上的机器人形象,这些系统将显得更加人性化且更具互动性。尽管这些模型可能对许多任务具有积极意义,研究人员以及整个社会都必须认真考虑创建能够心理建模人类的机器人所带来的伦理影响。

2069

2069

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?