1. padding_side 是什么

当我们需要进行 batch 推理时,我们会涉及 padding 操作,这是因为 batch 中的句子长度不一,我们需要将句子 padding 到同样的长度以保证 LLM 可以并行处理。padding 操作涉及两个问题,一个是 padding 的策略,另一个是 padding 的位置(也就是 padding_side)。

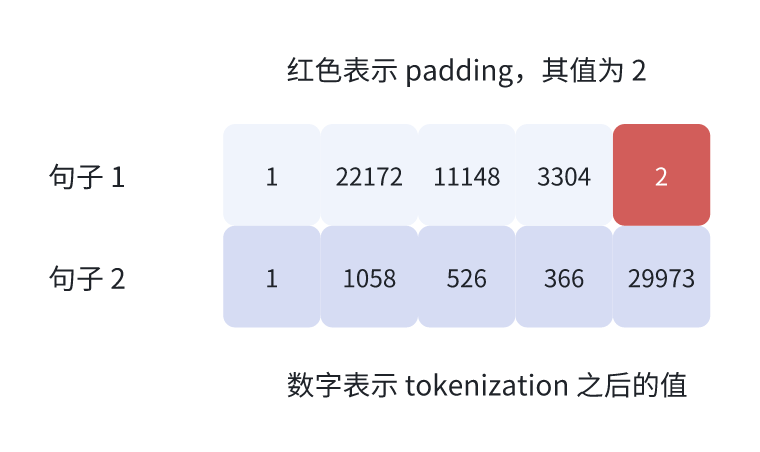

假设有两个句子,“hello llama” 和 “who are you”。

padding 通常有两个策略:

- padding 到和句子中最长的句子一样长

句子 1 原本有 3 个 token,句子 2 有 5 个 token,经 padding 后,句子 1 也有 5 个 token,其中最后两个是 pad token,它的值在这里是 2。

- padding 到指定的长度

假设 padding 到长度 6,则 padding 后的结果如图 2

订阅专栏 解锁全文

订阅专栏 解锁全文

1643

1643

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?