训练后量化(Post-Training Quantization, PTQ) 是一种将预训练浮点模型(如FP32)转换为低精度格式(如INT8)的技术,无需重新训练即可大幅压缩模型体积并提升推理速度。以下是其核心原理、流程与实践指南:

一、PTQ 的核心原理

-

量化目标

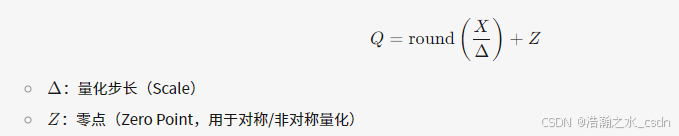

- 将权重(Weights)和激活值(Activations)从连续浮点空间映射到离散整数空间,公式:

- 将权重(Weights)和激活值(Activations)从连续浮点空间映射到离散整数空间,公式:

-

量化类型

- 对称量化:数据分布以零点为中心,适合激活值分布对称(如ReLU后)。

- 非对称量化:允许零点偏移,适配偏态分布(如Sigmoid输出)。

-

精度补偿机制

- 校准(Calibration):通过少量无标签数据统计激活值范围,动态调整Δ和Z,减少量化误差。

订阅专栏 解锁全文

订阅专栏 解锁全文

1098

1098

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?