项目简介

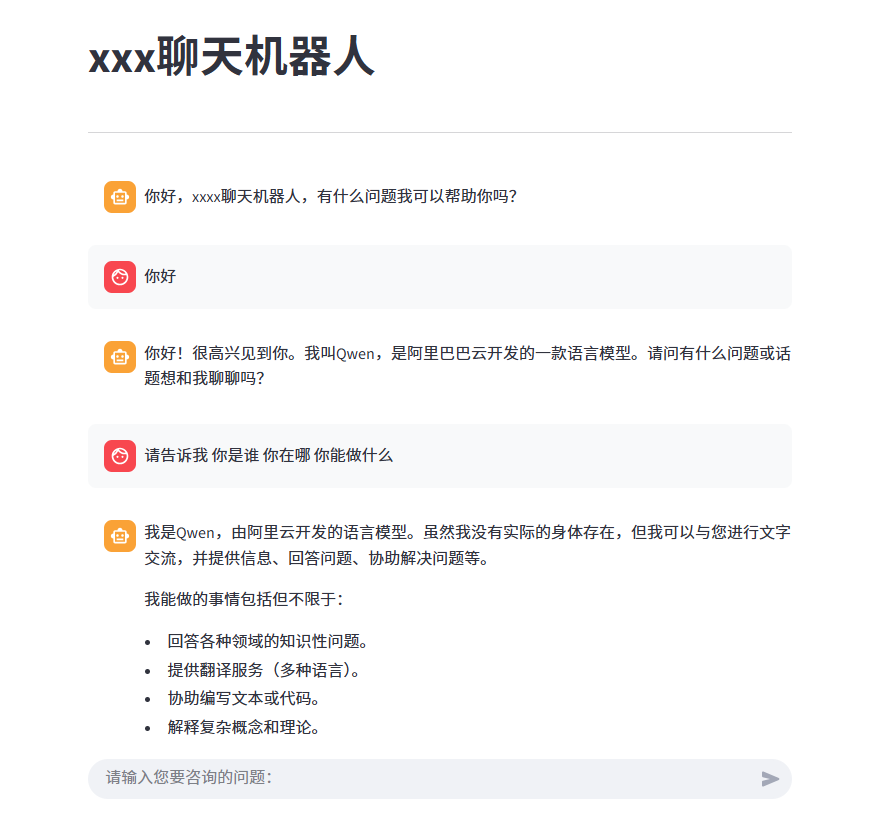

本文将介绍如何结合 Streamlit、Ollama 和本地私有大模型(如 qwen 系列),快速搭建一个带有上下文对话功能的聊天机器人。通过该方案,你可以实现完全本地化部署,无需依赖外部 API,保护数据隐私。

核心工具说明

-

Streamlit:快速构建 Python Web 应用的神器,无需前端知识即可实现交互界面。详细教程:Python 神器 Streamlit:5 分钟打造 Web 应用

-

Ollama:轻量级本地大模型部署工具,支持一键运行 qwen、llama 等主流模型。详细教程:私有化部署大模型后端 Ollama

完整代码实现与详解

以下是带有上下文对话功能的聊天机器人完整代码,按功能模块拆解说明:

"""

带有上下文对话历史的文本聊天机器人

技术栈:Streamlit(界面) + Ollama(本地模型接口) + qwen2.5:7b(大模型)

"""

# 1. 导入依赖库

import streamlit as st # 用于

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

641

641

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?