2020-3-7补充

import numpy as np, matplotlib.pyplot as mp

from sklearn.model_selection import train_test_split # 数据切分

from sklearn.preprocessing import StandardScaler # 数据标准化

from sklearn.datasets import make_moons, make_circles, make_classification # 数据集

from sklearn.linear_model import LogisticRegression # 逻辑回归

from sklearn.neural_network import MLPClassifier # 多层感知机

from sklearn.neighbors import KNeighborsClassifier # K最近邻

from sklearn.svm import SVC # 支持向量机

from sklearn.gaussian_process import GaussianProcessClassifier # 高斯过程

from sklearn.gaussian_process.kernels import RBF # 高斯核函数

from sklearn.tree import DecisionTreeClassifier # 决策树

from sklearn.ensemble import RandomForestClassifier, AdaBoostClassifier, GradientBoostingClassifier,\

ExtraTreesClassifier, BaggingClassifier # 集成方法

from sklearn.naive_bayes import GaussianNB # 高斯朴素贝叶斯

from sklearn.discriminant_analysis import QuadraticDiscriminantAnalysis, LinearDiscriminantAnalysis # 判别分析

from xgboost import XGBClassifier # 极端梯度提升(eXtreme Gradient Boosting)

from warnings import filterwarnings

filterwarnings('ignore') # 忽略警告

# 建模、设定参数

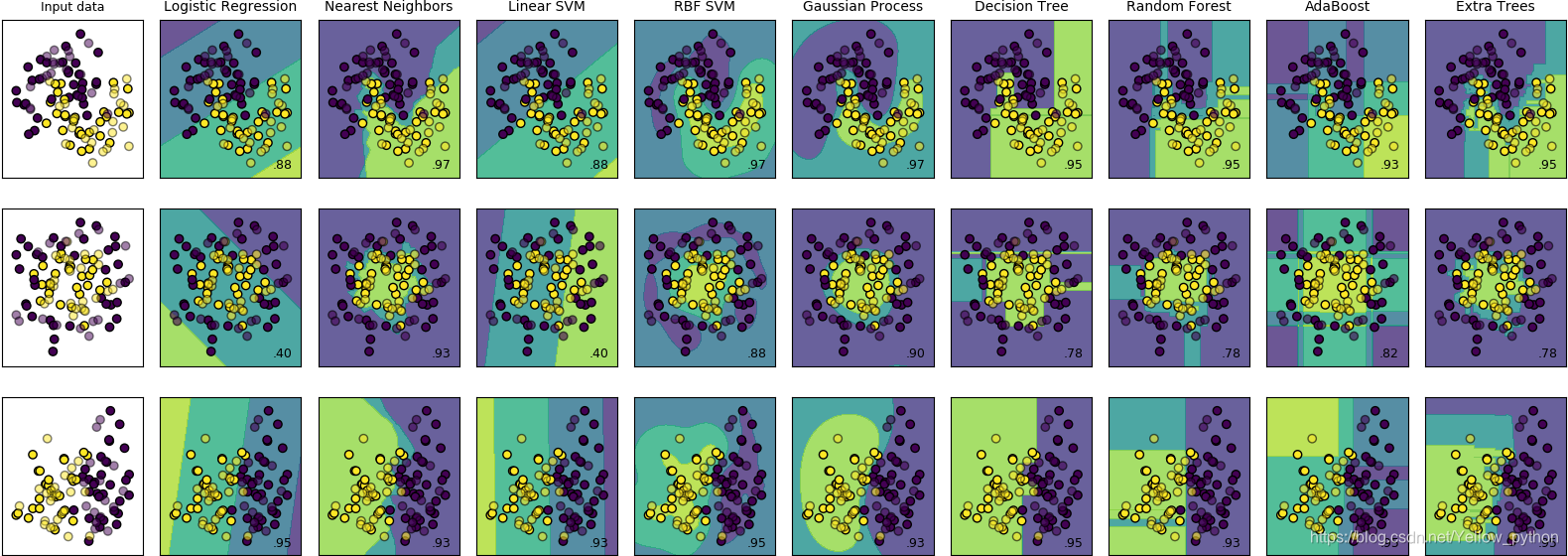

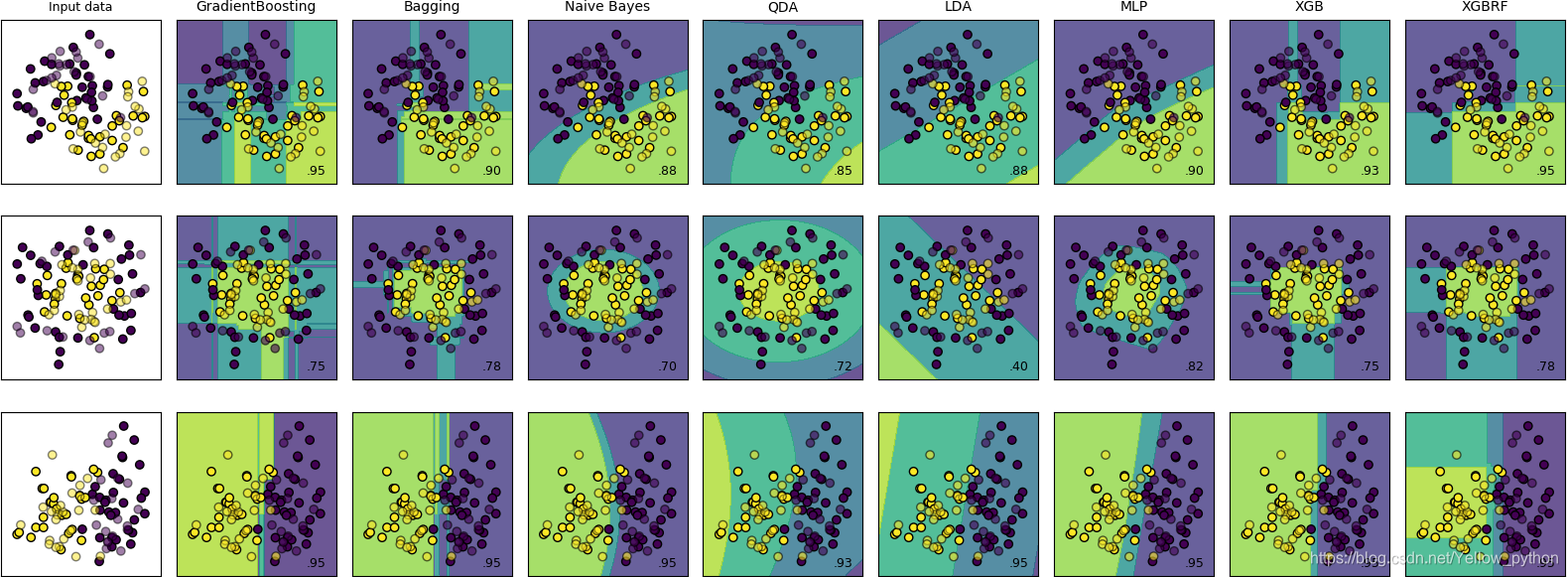

classifiers = [

('Logistic Regression', LogisticRegression()), # 逻辑回归

('Nearest Neighbors', KNeighborsClassifier(3)), # K最近邻

('Linear SVM', SVC(kernel='linear', C=0.025)), # 线性的支持向量机

('RBF SVM', SVC(gamma=2, C=1)), # 径向基函数的支持向量机

('Gaussian Process', GaussianProcessClassifier(1.0 * RBF(1.0))), # 基于拉普拉斯近似的高斯过程

('Decision Tree', DecisionTreeClassifier(max_depth=5)), # 决策树

('Random Forest', RandomForestClassifier(max_depth=5, n_estimators=10, max_features=1)), # 随机森林

('AdaBoost', AdaBoostClassifier()), # 通过迭代弱分类器而产生最终的强分类器的算法

('Extra Trees', ExtraTreesClassifier()),

('GradientBoosting', GradientBoostingClassifier()), # 梯度提升树

('Bagging', BaggingClassifier()),

('Naive Bayes', GaussianNB()), # 朴素贝叶斯

('QDA', QuadraticDiscriminantAnalysis()), # 二次判别分析

('LDA', LinearDiscriminantAnalysis()), # 线性判别分析

('MLP', MLPClassifier(alpha=1)), # 多层感知机

('XGB', XGBClassifier()), # 极端梯度提升

]

# 创建随机样本集

X, y = make_classification(n_features=2, n_redundant=0, n_informative=2, random_state=1, n_clusters_per_class=1)

rng = np.random.RandomState(2)

X += 2 * rng.uniform(size=X.shape)

linearly_separable = (X, y)

datasets = [make_moons(noise=0.3, random_state=0),

make_circles(noise=0.2, factor=0.5, random_state=1),

linearly_separable]

# 遍历样本集

figure = mp.figure(figsize=(20, 4))

i = 1 # 子图参数

h = .02 # 网眼步长(绘制等高线图的参数)

for ds_cnt, ds in enumerate(datasets):

# 数据预处理,切分训练集和测试集

X, y = ds

X = StandardScaler().fit_transform(X)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=.4, random_state=42)

# 用于绘制等高线图

x_min, x_max = X[:, 0].min() - .5, X[:, 0].max() + .5

y_min, y_max = X[:, 1].min() - .5, X[:, 1].max() + .5

xx, yy = np.meshgrid(np.arange(x_min, x_max, h), np.arange(y_min, y_max, h))

# 绘制原始样本集

ax = mp.subplot(len(datasets), len(classifiers) + 1, i)

if ds_cnt == 0:

ax.set_title('Input data', size=9)

ax.scatter(X_train[:, 0], X_train[:, 1], c=y_train, edgecolors='k') # 绘制训练集散点图

ax.scatter(X_test[:, 0], X_test[:, 1], c=y_test, alpha=0.5, edgecolors='k') # 绘制测试集散点图

ax.set_xlim(xx.min(), xx.max())

ax.set_ylim(yy.min(), yy.max())

ax.set_xticks(())

ax.set_yticks(())

i += 1

# 遍历分类器

for name, clf in classifiers:

ax = mp.subplot(len(datasets), len(classifiers) + 1, i)

clf.fit(X_train, y_train) # 训练

score = clf.score(X_test, y_test) # 模型评分

# 绘制决策边界

if hasattr(clf, 'decision_function'):

Z = clf.decision_function(np.c_[xx.ravel(), yy.ravel()])

else:

Z = clf.predict_proba(np.c_[xx.ravel(), yy.ravel()])[:, 1]

Z = Z.reshape(xx.shape)

ax.contourf(xx, yy, Z, 2, alpha=.8) # 等高线图

# 散点图

ax.scatter(X_train[:, 0], X_train[:, 1], c=y_train, edgecolors='k') # 训练集

ax.scatter(X_test[:, 0], X_test[:, 1], c=y_test, edgecolors='k', alpha=0.6) # 测试集

# 刻度、标签、标题等

ax.set_xlim(xx.min(), xx.max())

ax.set_ylim(yy.min(), yy.max())

ax.set_xticks(())

ax.set_yticks(())

if ds_cnt == 0:

ax.set_title(name, size=10)

ax.text(xx.max() - .3, yy.min() + .3, ('%.2f' % score).lstrip('0'), size=9, horizontalalignment='right')

i += 1

mp.tight_layout()

mp.show()

| En | Cn |

|---|---|

| boost | n. 推动;vt. 促进 |

| preprocess | vt. 预处理 |

| gamma | 希腊语的第三个字母:γ\gammaγ |

| quadratic | 二次方程式;二次的 |

| discriminant | 判别式 |

| percept | n. 认知 |

| radial | n. 射线,光线;adj. 半径的;放射状的 |

| MLP | Multi Layered Perceptron |

| RBF | Radial Basis Function |

| linearly separable | 线性可分 |

| tick | n. 滴答声;记号; |

本文对比了多种机器学习分类器的性能,包括逻辑回归、K近邻、支持向量机等,通过对不同数据集的训练和测试,展示了各分类器在复杂度、准确性和泛化能力上的差异。

本文对比了多种机器学习分类器的性能,包括逻辑回归、K近邻、支持向量机等,通过对不同数据集的训练和测试,展示了各分类器在复杂度、准确性和泛化能力上的差异。

2070

2070

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?