今天,我们将进入更深入的学习,包括如何使用触发词、参考作者参数进行生成,以及根据生成结果进行调整。

一、使用Lora的详细步骤

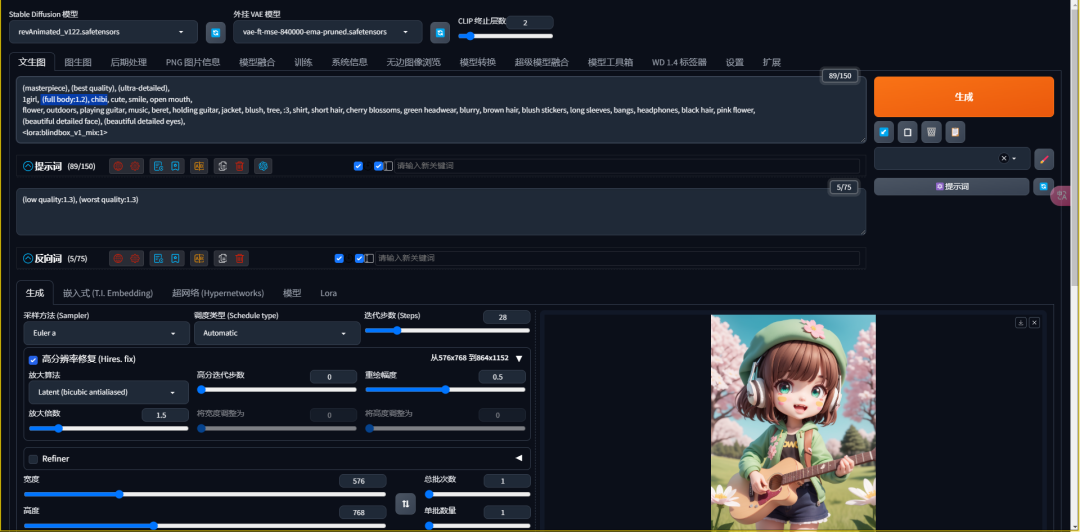

第一步:使用触发词

触发词是调用Lora时的关键。有时候,仅仅调用Lora可能不会产生预期效果,需要加入正面提示词来正确触发。例如,在生成图片时,除了使用权重和大模型外,还需要加入特定的提示词,如“full body”和“chibi”,以触发特定的风格。

有需要stable diffusion整合包以及提示词插件,可以扫描下方,免费获取

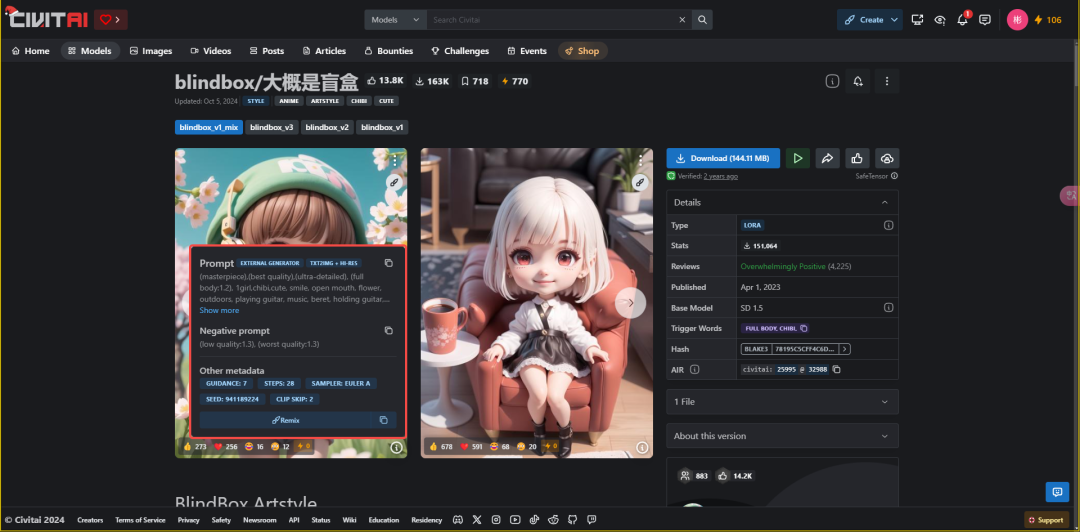

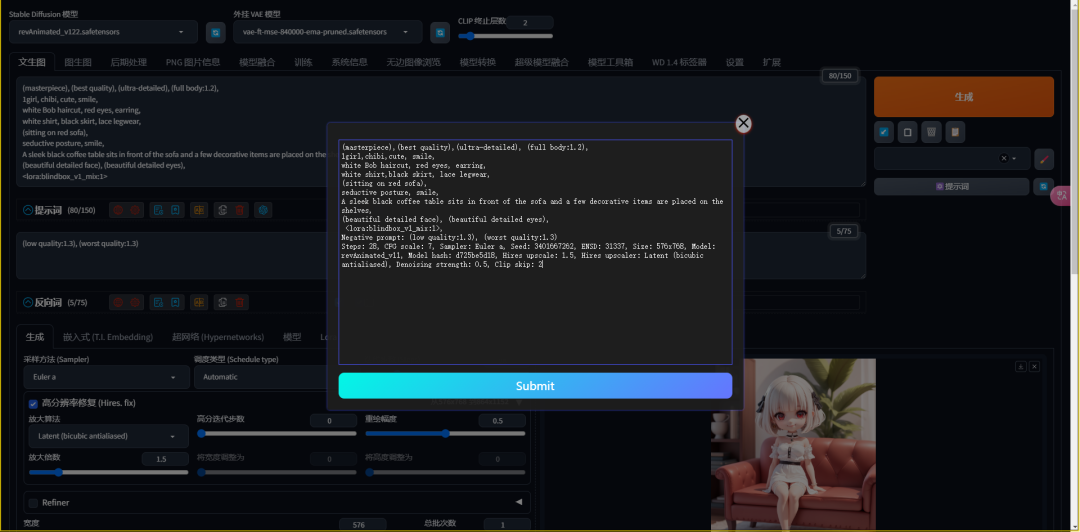

第二步:参考作者参数进行生成

在模仿作者生成的过程中,我们需要了解大模型、触发词,并参考作者使用的正面和负面提示词、CFG、种子和采样方法等参数。通过这些参数的一致性,我们可以复刻出几乎一样的图片。

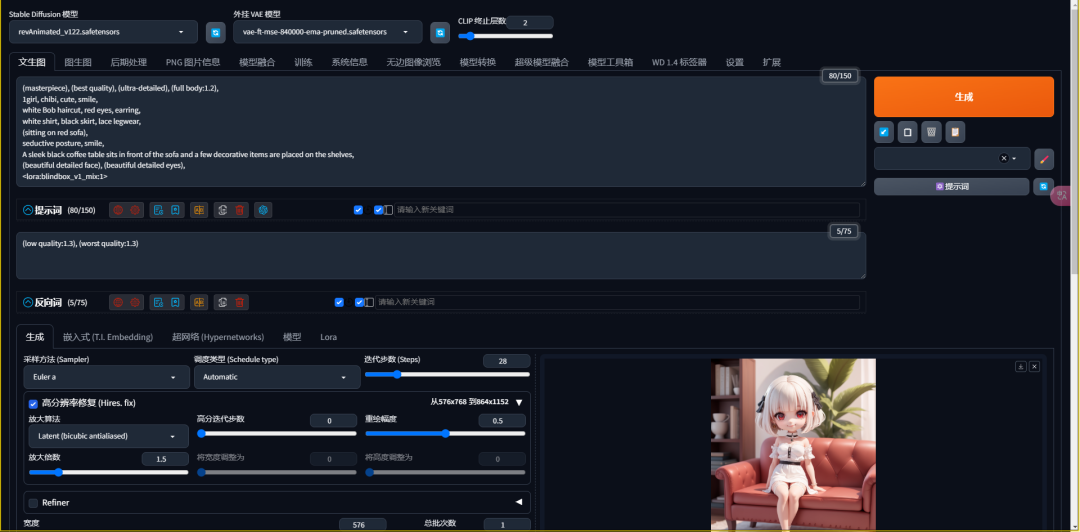

第三步:根据生成结果进行调整

最后一步是根据生成的结果进行多方面的调整,包括模型、权重和各种参数,以达到我们想要的效果。

二、使用Lora的注意事项

在使用Lora的过程中,有几点需要注意:

- \1. 模型名称一致性:确保使用的Lora名称与本地保存的名称一致,否则可能无法正确调用。

- \2. 新手慎用多个Lora:使用多个Lora需要对Lora的底层原理有一定了解,新手建议先从一个Lora开始。

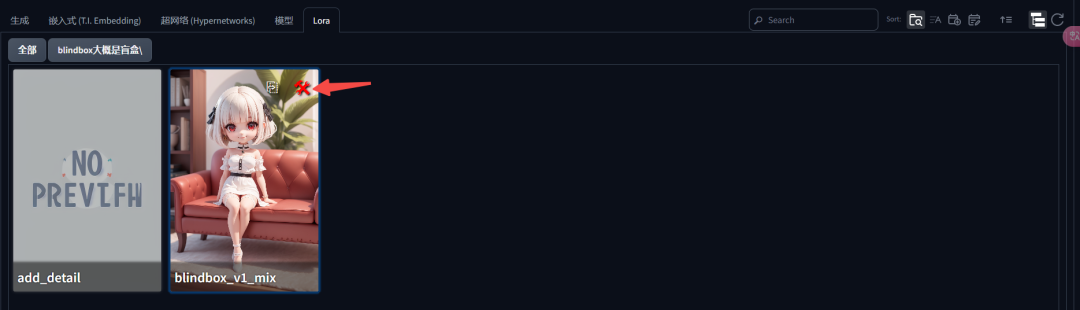

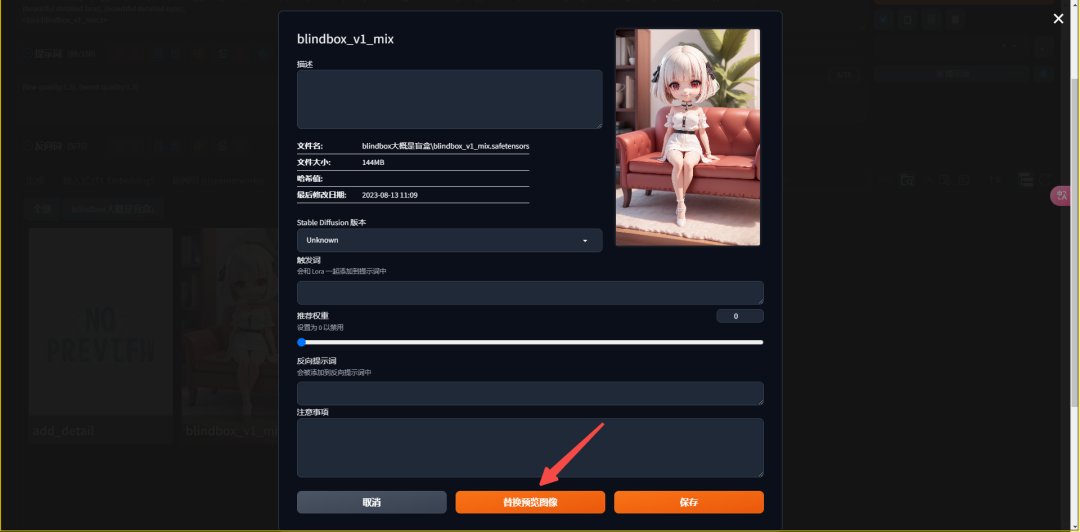

- \3. 生成图片作为提示图:可以将生成的图片设置为Lora的预览图,帮助更好地理解Lora的作用。

三、实际案例分享

接下来,我们将通过几个实际案例来展示Lora的实用性。

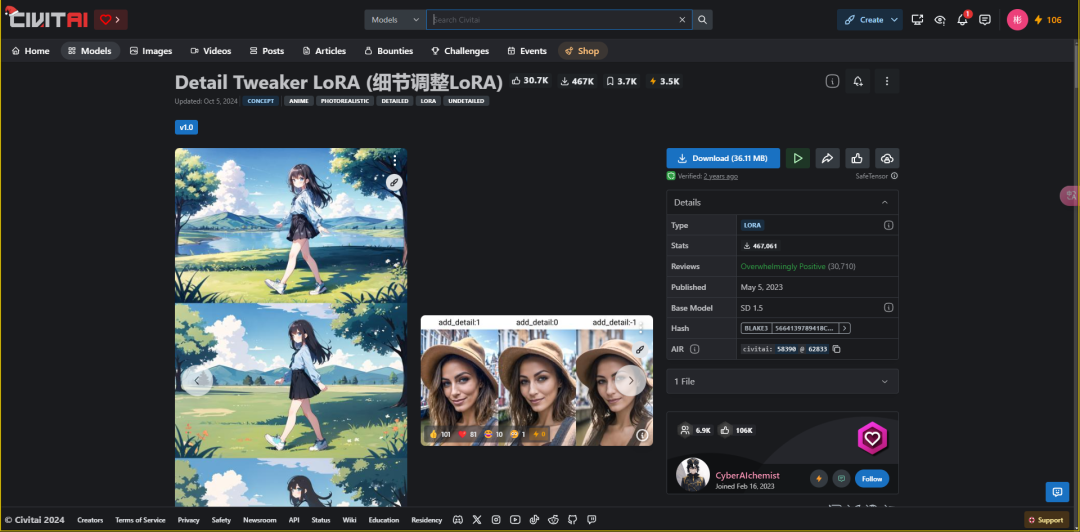

1、图片细节高清化

通过使用特定的Lora,我们可以增加图片的细节,提升质感。例如,在生成商品静物图时,加入细节增强的Lora可以使图片看起来更真实。

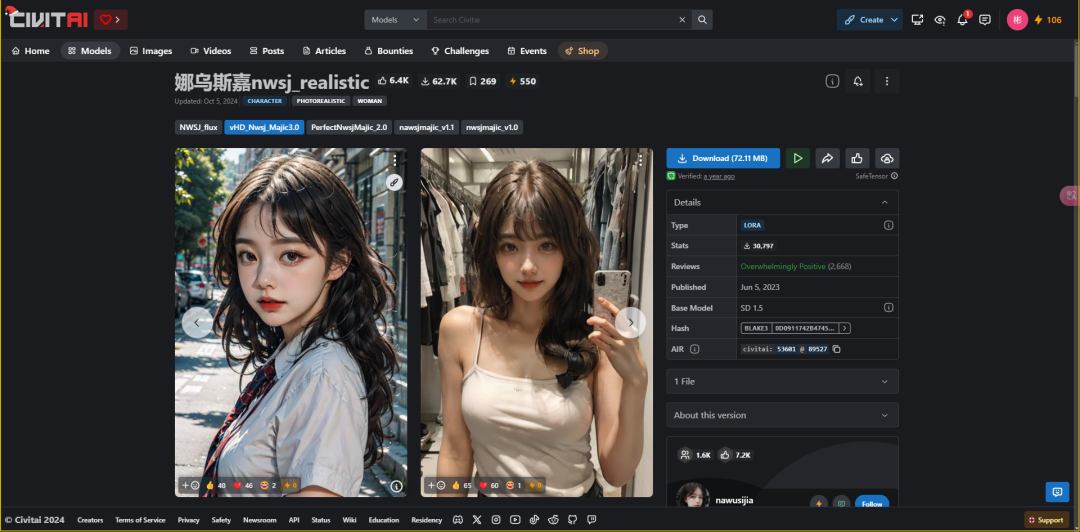

2、人物特征固定

在需要人物特征保持一致的场景中,可以使用特定的Lora来固定人物的脸型或衣着特征。

关于AI绘画技术储备

学好 AI绘画 不论是就业还是做副业赚钱都不错,但要学会 AI绘画 还是要有一个学习规划。最后大家分享一份全套的 AI绘画 学习资料,给那些想学习 AI绘画 的小伙伴们一点帮助!

对于0基础小白入门:

如果你是零基础小白,想快速入门AI绘画是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以找到适合自己的学习方案

包括:stable diffusion安装包、stable diffusion0基础入门全套PDF,视频学习教程。带你从零基础系统性的学好AI绘画!

零基础AI绘画学习资源介绍

👉stable diffusion新手0基础入门PDF👈

(全套教程文末领取哈)

👉AI绘画必备工具👈

温馨提示:篇幅有限,已打包文件夹,获取方式在:文末

👉AI绘画基础+速成+进阶使用教程👈

观看零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

温馨提示:篇幅有限,已打包文件夹,获取方式在:文末

👉12000+AI关键词大合集👈

这份完整版的AI绘画全套学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

452

452

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?