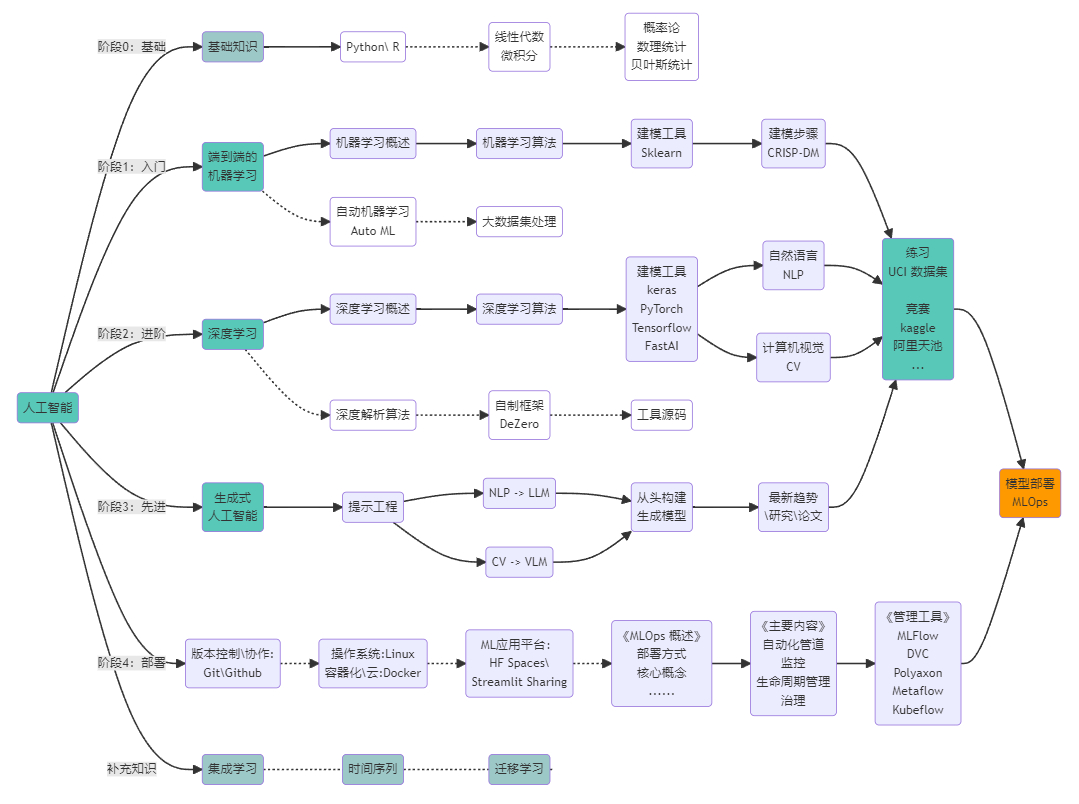

深度学习掌握这个创新方法,哪怕研二换课题都能来得及!核心就是把顶会的模型应用到小方向数据集并通过缝合模块的方式进行魔改

总结来说就八个字:排列组合,会讲故事。说直白点,就是缝模块。适合几乎所有搞深度学习神经网络的同学!

先看看别人怎么做,然后根据自己的实际情况将这些模块来一波随机组合,这些模块就像积木一样,可以按照自己的想法缝合到模型中去,从而实现高效涨点!

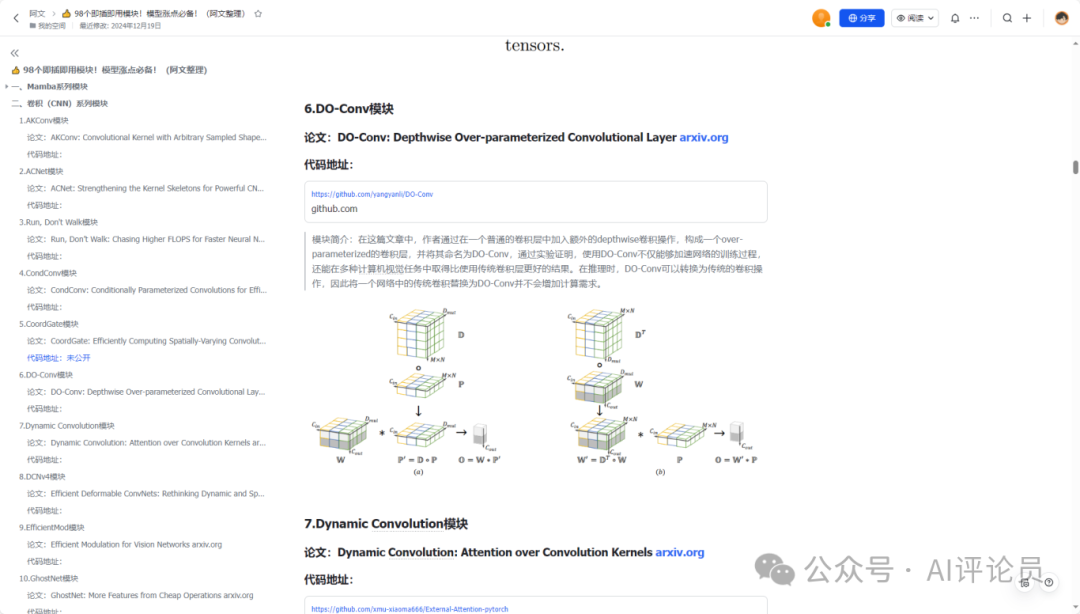

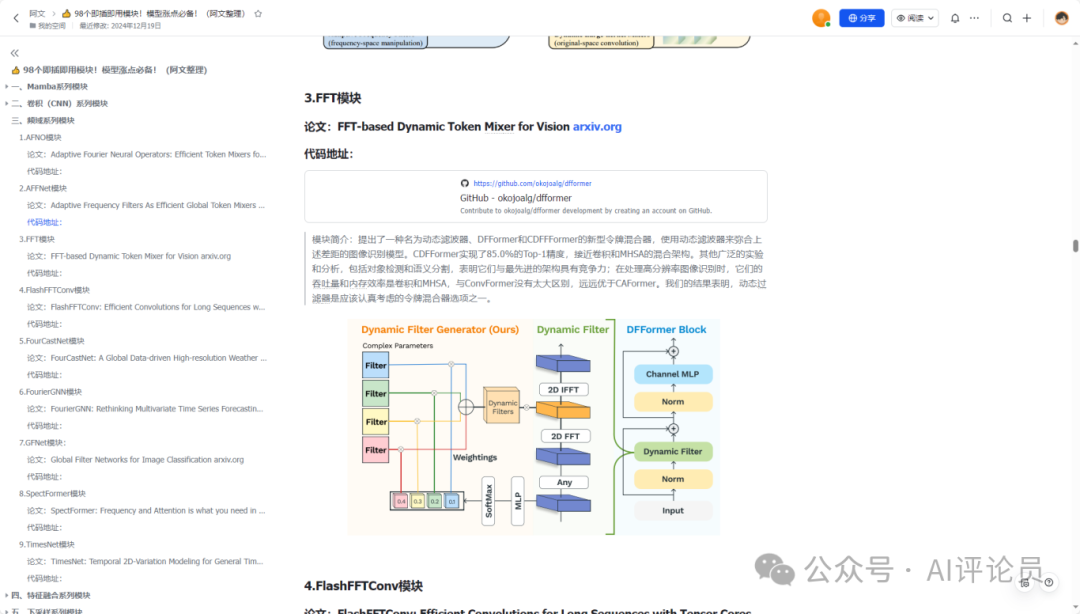

这里我收集了七大模块(Mamba模块、卷积模块、频域模块、特征融合模块、下采样模块、注意力模块、时间序列模块),共有98个即插即用的模块,都包含了论文和代码,把模块加到自己的网路中,如果有提升就可以具体看看这个模块的文章。如果没用,就重新缝合新模块,总有一款适合你的。

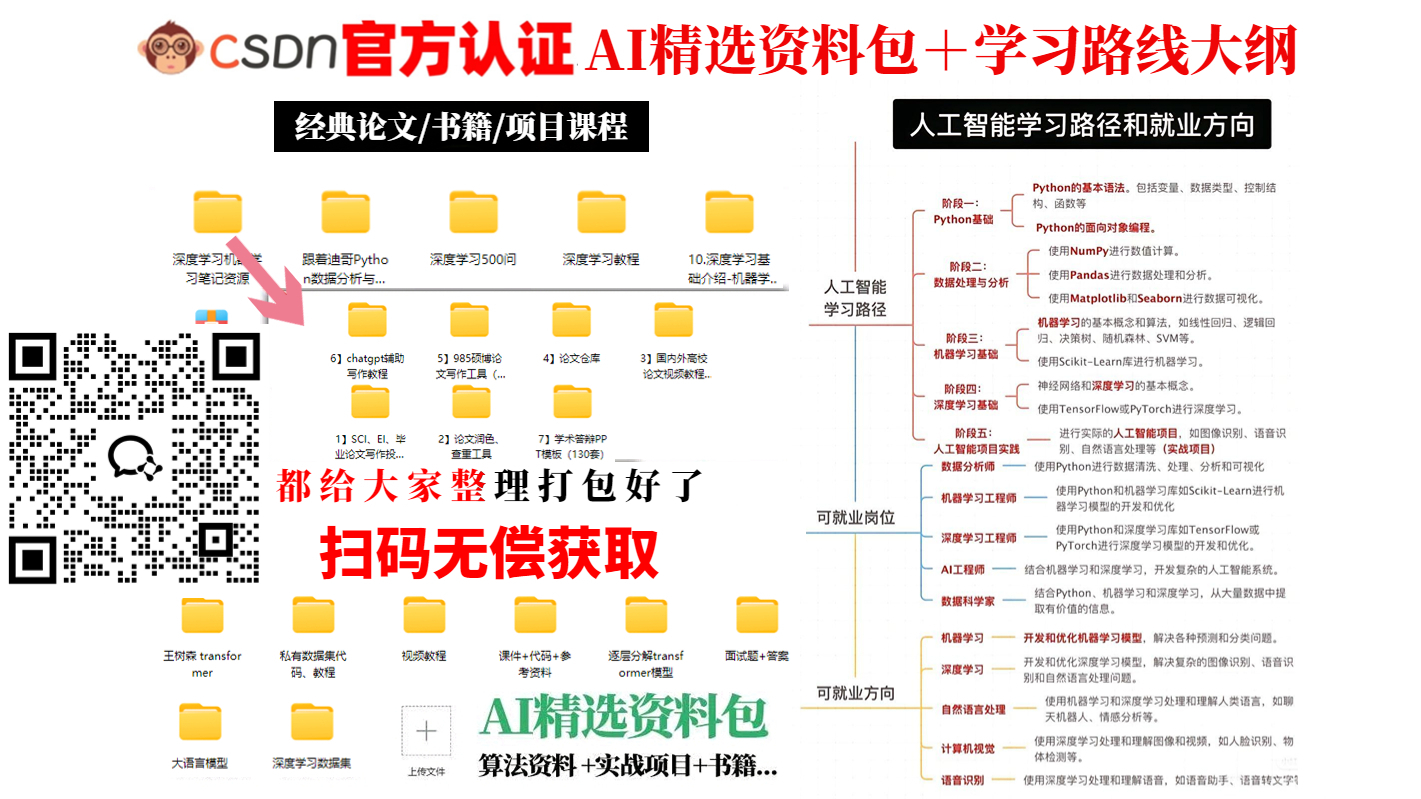

文章中所有的数据和资料,可添加小助手无偿分享~

扫码添加小助手即可无偿获取~

也可以关注“AI技术星球”公众号,关注后回复“221C”获取。

1.Mamba模块

通过选择性状态空间机制,显著提升长序列处理效率。其创新性地结合了动态权重调整和硬件感知优化,在保持模型性能的同时,实现2倍推理加速和60%内存节省。特别适用于基因测序、金融预测等需要处理超长序列的场景。

2.卷积模块

通过创新的核结构设计和动态特征选择机制,显著提升了传统卷积神经网络的表征能力。其采用可变形卷积核与自适应感受野调整策略,能够更精准地捕捉输入数据的空间特征,该模块支持即插即用,可无缝集成到现有架构中,为CV提供更高效的特征提取方案。

3.频域模块

利用FFT/IFFT变换,以O(n logn)复杂度实现全局特征交互,相比传统自注意力的O(n²)计算更高效。该模块能全面捕捉特征图的全局上下文信息,突破空间限制,显著提升模型对图像内容的理解能力,在视觉任务中展现出优越性能。

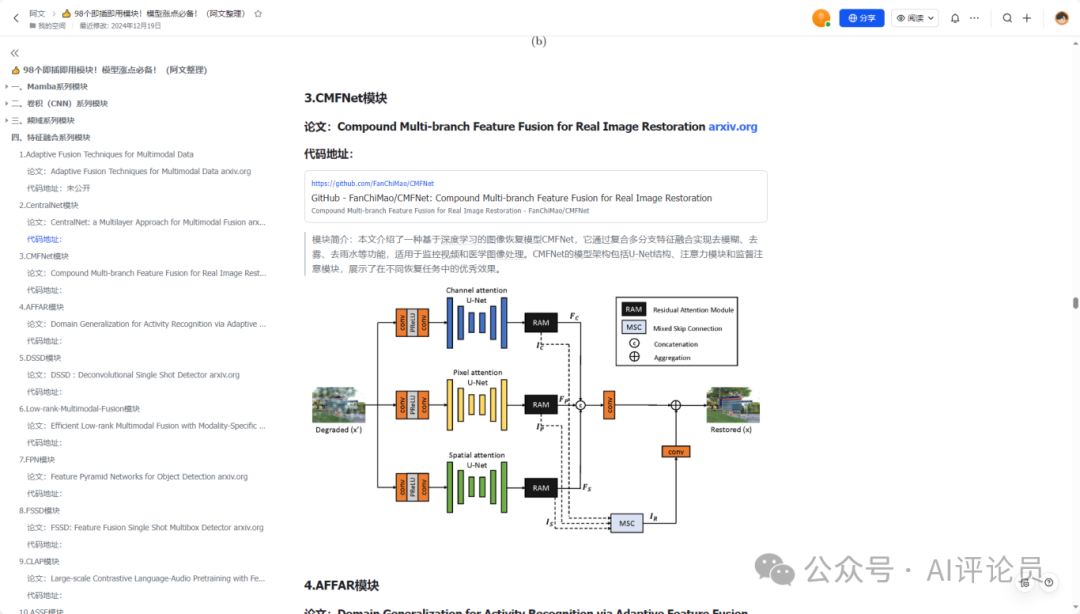

4.特征融合模块

支持多源异构特征的自适应融合,通过深度挖掘数据内在关联性,实现特征间的智能组合。该模块能显著提升模型的特征表达能力,在保证计算效率的同时,使各类任务的准确率提升10%-15%。

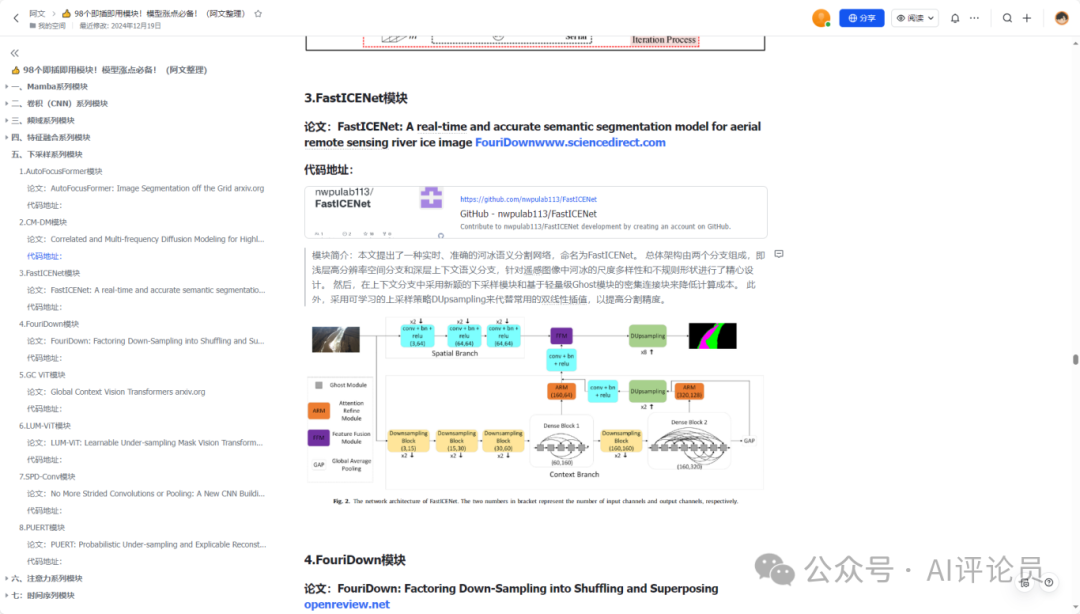

5.下采样模块

通过自适应语义感知机制,在保证特征精度的同时显著提升计算效率。其动态核调整策略赋予模型出色的通用性,可灵活适配各类数据分布,其轻量化设计支持灵活部署,可广泛应用于图像识别、语义分割等多种视觉任务

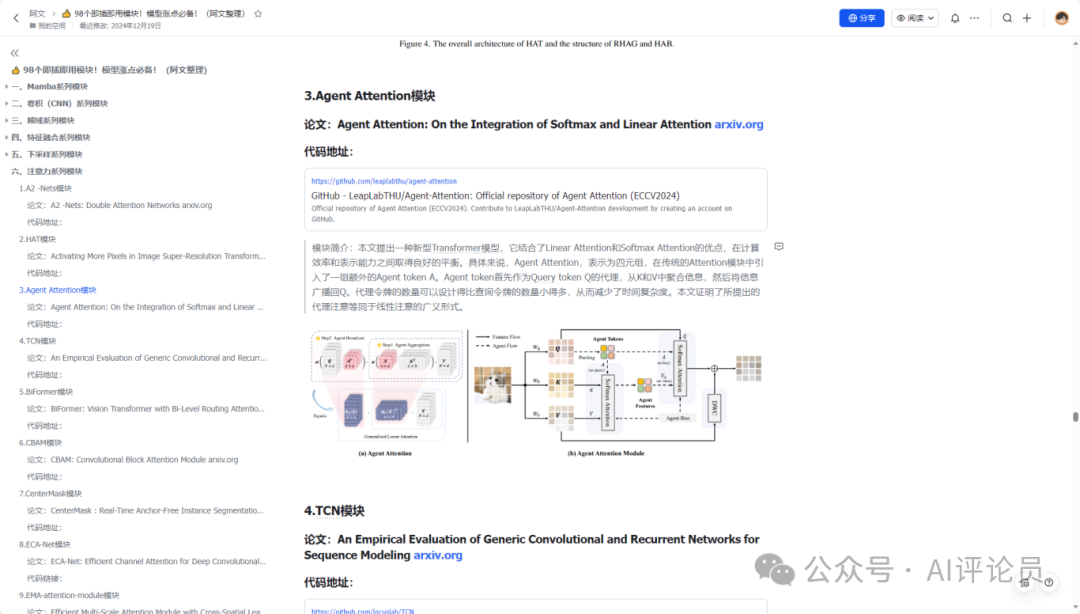

6.注意力机制模块

通过稀疏参数设计和动态特征选择策略,在显著减少50%参数量的同时保持信息完整性。该模块采用多头注意力优化架构,在自然语言处理、计算机视觉等任务中平均提升15%的准确率

放在最后:

另外想结合AI发文发刊,但不知道怎么做创新的同学,我们team磨练出了一套系统且专业的传统学科交叉AI科研入门方案,可带学生发paper,已迭代五次(持续迭代中),我们会根据你的研究方向来规划学习路径,并且根据你的实验数据分为了时序、图结构、影像三大实验室

文章中所有的数据和资料,可添加小助手无偿分享~

扫码添加小助手即可无偿获取~

也可以关注“AI技术星球”公众号,关注后回复“221C”获取。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?